Вот и начал удлиняться день, господа! Это значит, что скоро весна. А там и до лета недалеко. Ну а пока на дворе зима, и желание выбираться из дома уверенно держится около нулевой отметки, самое время неспеша подвести итоги, отделить зерна от плевел и просто вспомнить, чем радовали (или огорчали) нас (и себя), оставшиеся в очень небольшом количестве компании-ньюзмейкеры, которым мы и обязаны прогрессом в той сфере, что мы называем платформой ПК. Давайте, чтобы никому не было обидно, прямо в алфавитном порядке и начнем.

AMD

После достаточно напряженного 2007 года, в течение которого AMD откровенно «не везло», в 2008-ом собственные усилия компании, очевидно, совпали с глобальными замыслами высших сил. В результате, практически после каждого анонса (которых было немало), обозревателям приходилось констатировать очередную победу в том или ином качестве. Едва ли такое может быть исключительно следствием собственного умения «делать лучше», отсюда и мысли о доли везения. Перелистаем основные события года (и наши публикации) в хронологическом порядке.

Первой, скорее даже не технической, а больше психологической, победой стал выпуск Radeon HD 3870 X2. Двухчиповая видеокарта AMD, хоть и с большими оговорками в отношении оптимизации драйверов, имевших место проблем с качеством и неравномерным приростом скорости в ряде игр, но смогла сравниться, а местами и превзойти, казалось бы недосигаемого короля 3D-графики на тот момент: GeForce 8800 Ultra!

Дальше последовал выпуск чипсета AMD 780G: ожидаемый продукт, привлекательность которого, уже в совершенно практическом, потребительском, плане, можно было спрогнозировать, глядя на успех 690G. Однако и здесь AMD нашла чем удивить, сумев организовать выпуск этого чипсета по самому прогрессивному техпроцессу (55 нм), имевшемуся в распоряжении TSMC. Ранее чипсеты от всех производителей традиционно отставали по используемому техпроцессу на 1-2 поколения от графических и центральных процессоров. В результате графическое ядро (Radeon HD3200) вместило 40 шейдерных процессоров, а сам чипсет остался при этом примечательно экономичным. Пожалуй, начиная именно с этого чипсета, производительность в 3D уже смогла называться приемлемой для массовых игр, в том числе и современных, разумеется на невысоких настройках качества. Также этот чипсет может носить звание первого, имеющего полноценный декодер HD-видео, включая высокобитрейтные записи с дисков Blu-ray. Западные коллеги даже демонстрировали достаточность в конфигурации Bluray-плеера на таком чипсете одноядерного Sempron. Учитывая, что источником HD-видео в реальности являются, помимо оригинальных дисков, доступные в интернете образы и прочие записи, иногда перекодированные некорректным способом, мы бы рекомендовали все же поставить процессор помощнее, чтобы не возникало сложностей с декодированием подобного видео. Видимо в AMD тоже подумали, что для желающих собрать компактный медиацентр, такой чипсет надо поддержать выпуском новых процессоров со сниженным тепловым пакетом и одновременно проанонсировали пару: Athlon X2 4850e (c TDP=45 Вт) и Phenom X4 9150e (65 Вт), которые тоже стали весьма удачными нишевыми продуктами.

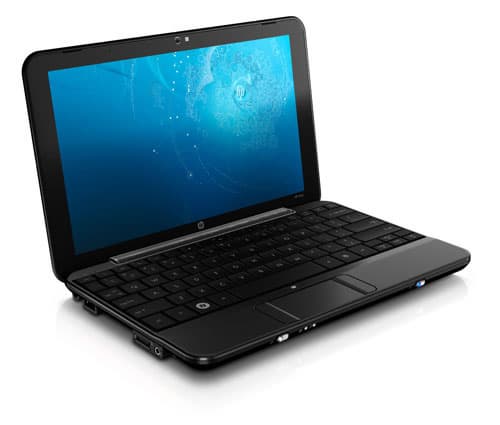

Совершенно очевидно, что экономичный чипсет с мощной интегрированной графикой, в не меньшей, а может и большей, степени важен для рынка ноутбуков, поэтому следом была выпущена мобильная платформа Puma, в состав которой входит и обновленный мобильный процессор Turion X2 Ultra с увеличенным объемом кэш-памяти и значительно усовершенствованными механизмами энергосбережения по сравнению с моделями из предыдущей линейки. Тем не менее, поскольку при производстве этих процессоров используется прежний технологический процесс (65 нм), в среднем уровень потребления остался прежним. Но поскольку большую часть времени, тем более работая от батарей, компьютер загружен лишь частично, за счет более эффективных механизмов снижения потребления в простое, время автономной работы ноутбуков на новой платформе увеличилось. А учитывая увеличившуюся по всем фронтам производительность, не удивительно, что новую платформу поддержало большинство производителей ноутбуков (всего выпущено уже более сотни моделей, что вдвое больше нежели на предыдущей, на основе Turion 64 X2). Вероятно также какую-то роль сыграла и задержка с выпуском конкурирующей Centrino 2 (к вопросу о влиянии фортуны). А к концу года к числу компаний-партнеров AMD примкнул еще один крупный производитель ноутбуков — Samsung. Весьма интересно выглядит и идея переосмысления роли док-станции, которая благодаря порту ATI XGP и наличию собственного видеоускорителя, может повысить привлекательность даже компактного ноутбука, купленного для использования в пути, в качестве замены настольного ПК. Но пока ноутбук в такой комплектации представила только компания Fujitsu-Siemens.

Ну а следом, уже летом, мы встречали линейку Radeon HD4800, в определенной степени претендующую на звание «продукта года» от AMD. Впрочем, еще задолго до анонса, все, интересующиеся темой, узнали из новостей, что AMD обещает поднять производительность своих графических процессоров вовсе не косметически, а настолько, чтобы младшая карта (HD4850) превзошла ни много ни мало GeForce 9800GTX. И хотя такие обещания многим казались слишком смелыми, на практике планы были даже немного перевыполнены, поскольку старшая карта (HD4870), как оказалось, смогла успешно побороться с GeForce GTX 260, хотя по цене позиционировалась несколько ниже, а в противовес GTX 260/280 изначально планировались лишь двухчиповые решения. А поскольку карты на чипах из 4800-семейства по себестоимости оказались явно дешевле своих прямых конкурентов, это позволило AMD контролировать ситуацию и предлагать более выгодные продукты все второе полугодие.

Впрочем, если посмотреть с более глобальной (не потребительской) точки зрения, примечательна даже не как таковая победа в конкурентной борьбе, еще важнее сам факт, что AMD удалось (и, скажем так, захотелось) довести до ума наследие ATI, то есть перебалансировать архитектуру, сделать ее более эффективной, совместно с TSMC отладить производство по 55 нм техпроцессу гораздо раньше конкурента, не поскупиться на самую прогрессивную память для 4870 и т.п. И сейчас уже можно с уверенностью сказать, что конкуренция на рынке графических процессоров для дискретных видеокарт продолжится. Что изначально с покупкой ATI совершенно не выглядело само собой разумеющимся фактом, а глядя на не очень убедительные результаты первых карт на RV600 годом раньше, руководство AMD вполне могло принять решение сократить штат графического подразделения и ограничиться дальнейшим выпуском чипсетов с интегрированной графикой, да потихоньку готовить графическое ядро в рамках проекта Fusion. Кстати, очень даже вероятно, что от самой ATI (если бы покупка не состоялась) сравнимого по характеристикам продукта мы на рынке также не увидели, архитектуру возможно и удалось бы выправить (и в AMD этим занимались преимущественно те же самые люди, перешедшие из ATI), но вот в остальных организационно-технических вопросах обойти NVIDIA шансов практически не оставалось.

Кстати, помимо игровых видеокарт, продуктом на основе RV770 пополнилась и линейка потоковых процессоров FireStream (моделью 9250). Эти «видеокарты» используются в серверах и ускоряют уже отнюдь не только графику, а финансовые, статистические и прочие расчеты. И можно сказать, что как минимум в самом «высоком» сегменте, идея Fusion (сближение функций графического и центрального процессоров) уже вполне материализовалась.

Наконец, двухчиповая RADEON HD4870 X2 смогла одержать две идеологические победы. Стала самой мощной видеокартой из доступных в продаже, что и ожидалось. Но также весьма неожиданно смогла на практике исправить имидж двухчиповых карт (решений на базе SLI и CrossFire), как неизбежно страдающих лагами и неравномерным уровнем кадров в секунду. Какие-то погрешности могут оставаться, особенно в новых играх (и от этого не застрахованы и одночиповые карты, владельцам которых также нередко приходится ждать обновления или hotfix'ов к драйверам), но благодаря усовершенствованному мосту и дополнительным линиям, соединяющим чипы, а также более серьезной отладке драйверов, обозреватели и пользователи отметили явное улучшение ситуации. Что касается вопроса не повсеместной поддержки CrossFire (в ряде игр второй чип может остаться не задействованным, и это вторая распространенная претензия к мультичиповым решениям) для этой карты гораздо менее актуален, по сравнению, например с 3870 X2, по той причине, что и одиночная 4870 достаточно (и даже избыточно) мощная для поддержки большинства современных игр. Ну а высокотехнологичные игры, где дополнительное ускорение желательно, являются приоритетными и в оптимизации драйверов, поэтому поддержка мультичипового рендеринга появляется достаточно оперативно.

Затем вновь настала очередь чипсетов. AMD 790GX упрочил, так никем и не потревоженные, позиции 780G в части производительности интегрированного видеоядра. Но смысл выпуска состоял, конечно же, не в конкуренции с собой, а намерении расширить сферу применения интегрированных чипсетов с разнообразных microATX и недорогих ATX моделей на полнофункциональные ATX с мощными схемами питания, охлаждения и даже поддержкой CrossFire. На таких платах, наконец, могла проявить себя и выделенная видеопамять SidePort, которая не получила распространения на платах с чипсетом 780G. И надо сказать, производители плат эту идею поддержали. Ну а в дополнение к перечисленным, в общем, полезным, но ожидаемым вещам, в новом чипсете (а точнее южном мосту SB750), оказалась и очередная «приятная неожиданность»: технология Advanced Clock Calibration, расширяющая разгонный потенциал процессоров Phenom (из серии Black Edition), как минимум на 100—200 МГц, а на самых талантливых в этом вопросе платах и — до 400. Пусть это и не повлияло коренным образом на расстановку сил в процессорном сегменте, но получить прирост на «ровном месте», для поклонников компании тоже приятно. Особенно учитывая, что к тому моменту уже было известно, что процессоры для настольного сегмента на новом ядре от AMD появятся лишь в 2009 году. А наблюдая за успехами во всех остальных сегментах платформенного рынка, конечно, хотелось бы увидеть какие-то действия и на процессорном фронте. Но если не считать устранение, так называемой, «ошибки TLB», что имело не особо много значения (поскольку соответствующий патч в BIOS большинство пользователей отключали, ибо никому так и не удалось выяснить, где же в реальности эта загадочная ошибка могла проявляться), единственным заметным событием был выпуск трехъядерных Phenom X3, которые пополнили ассортимент недорогих процессоров, однако на покорение новых вершин производительности претендовать не могли.

Впрочем, процессоры Phenom, благодаря снижению цен, во втором полугодии тихо и незаметно превратились из продукта для фанатов в весьма практичную покупку, особенно если рассматривать и сравнивать платформу в целом. Конечно, саму AMD такой вынужденный демпинг вряд ли радовал, но как продемонстрировало наше тестирование, архитектура процессоров Phenom (K10) демонстрирует более высокую эффективность (производительность на мегагерц) по сравнению с Athlon (K8), то есть является перспективным развитием. И есть основания предполагать, что получив возможность наращивать частоту и кэш-память (с переходом на 45 нм техпроцесс), даже в минимальной степени модифицируя само ядро, AMD сможет порадовать нас не только низкими ценами.

А вот кто никогда не был особенно избалован низкими ценами, так это любители поиграть с комфортом. Видеокарты стоимостью до $100 вообще долгое время воспринимались как бессмысленная трата денег. Приятно, что AMD решила обратить внимание и на этот сегмент, выпуском весьма шустрого Radeon HD 4670.

Предпоследней, заслуживающей внимание, новостью года стал выпуск серверных процессоров на долгожданном 45 нм ядре Shanghai. Надо отметить, что в серверном сегменте, позиции AMD Opteron и до выпуска Shanghai продолжали выглядеть достаточно сильно (причем в первую очередь с технических позиций, а не за счет ценовой политики), несмотря на перевод Intel Xeon на архитектуру Core 2. Ведь для многопроцессорных систем инфраструктура (механизм взаимодействия с памятью и другими процессорами в системе) играет ничуть не меньшую роль, чем эффективность внутренней архитектуры вычислительных ядер в процессорах.

Наконец, не слишком приметная, но если разобраться, вполне себе знаковая новость. В драйвере Catalyst 8.12 добавлена поддержка технологии ATI Stream, причем с точки зрения простого пользователя, конечно же, интересна не сама по себе потенциальная возможность занять видеокарту неграфическими расчетами (убедиться в том, что это возможно и в домашних условиях, можно было уже давно, например, поучаствовав в проекте Folding@Home). Гораздо интереснее первый работающий (и бесплатный) пример реализации достаточно обиходной процедуры: преобразование видео в тот или иной формат, необходимый пользователю, так называемое транскодирование, например, для просмотра на портативном видеоплеере. Именно это позволяет делать, имеющийся в пакете с драйвером, ATI AVIVO Video Converter. Использование ресурсов графических процессоров в конвертерах от сторонних производителей и прочем ПО (фото-, видеоредакторы и т.п.), судя по всему, дело совсем недалекого будущего. Слишком велик потенциал и уже имеющаяся у пользователей вычислительная база, простаивающая всюду, за исключением игр. А с принятием спецификации OpenCL, о поддержке которой также заявили NVIDIA, Intel и прочие, имеющие отношение к данному вопросу, производители, программистам не придется разбираться в особенностях программирования под каждый GPU, что является необходимым условием для массового задействования любой аппаратной возможности.

Резюмируя, отметим, что год выдался для AMD достаточно удачным, и хотя начавшийся экономический кризис вынуждает осторожно говорить о любых перспективах, AMD успела и в этом отношении предпринять подготовительные меры, выделив производство в отдельную компанию. Подробно свои мысли на эту тему я уже оформил в виде статьи ранее, вкраце можно отметить, что руководство и весь персонал в производственную компанию перешел из AMD, вернее перейдет, потому что завершение юридических и прочих формальностей состоится в начале 2009 года. Фактически смысл такой «реструктуризации» состоит в привлечении стратегического инвестора, причем из одной из немногих стран, на которую данный кризис имеет относительно небольшое влияние.

О более близких тематике iXBT перспективах технических мы поговорим чуть позже, поскольку в виду все того же кризиса прогнозировать имеет смысл лишь на тему общих для отрасли в целом тенденций и планов, а конкретные «раундапы» могут и наверняка будут корректироваться сообразно обстановке.

Intel

Если AMD особенно хорошо удавались видеокарты и прочие графические решения, а модернизация процессорных ядер и новый техпроцесс под них лишь готовились, то у Intel ситуация сложилась прямо противоположная: ядро Core 2 в радикальных переделках не нуждалось, а 45 нм техпроцесс был обкатан на топовых моделях еще в конце 2007 года, поэтому вполне естественно было сосредоточиться на выпуске новых процессоров.

Разумеется, имели место обновления и в ряду чипсетов, однако носившие преимущественно косметически-рутинный характер, поэтому, пожалуй, стоит сразу кратко их упомянуть, чтобы далее уже не отвлекаться. Тем более, что это вполне соответствует хронологическому принципу повествования.

В рамках CeBIT 2008 компания Intel представила очередной топовый чипсет X48, платы на котором запомнились хитросплетениями тепловых трубок и прочими атрибутами моделей для энтузиастов и поражали воображение ценами, в тоже время функциональные отличия от X38 свелись к поддержке частоты FSB1600 (а единственным процессором, официально поддерживающим эту частоту, так и остается Core 2 Extreme QX9770, имеющий все шансы войти в историю, сохранив этот статус). Также официально было объявлено об отказе от поддержке DDR2, что, конечно, сложно назвать оригинальной идеей, и не помешало производителям плат сделать гибридные модели с поддержкой обоих типов памяти, вроде MSI X48C.

Чипсеты для массового рынка P43/P45 вышли позже и, наконец, добавили поддержку PCI Express 2.0 в массовый сегмент плат на чипсетах Intel (всего 16 линий, которые могут быть распределены между двумя графическими портами для поддержки симметричной конфигурации CrossFire, остальные 6 линий для подключения интегрированных на плату контроллеров и организации портов расширения соответствуют версии 1.0). Сделать это, очевидно, было «давно пора», во всяком случае остальные производители в своих чипсетах на PCI Express 2.0 к тому моменту уже перешли, а учитывая что ранее Intel всегда в числе первых (или чаще — первой) поддерживала новые стандарты, такой лаг явно требовал устранения.

Что касается чипсетов с интегрированной графикой, то здесь планировался выпуск модели G45 (и производных от нее усечений), в которой была обещана аппаратная поддержка декодирования HD-видео, но потом оказалось, что скорее всего мы ее либо не увидим, либо это появится в будущей ревизии, да и частоты окажутся ниже первоначально запланированных, чтобы сохранить TDP на приемлемом уровне. Платы, хоть и с задержкой, впрочем, вышли, но сравнение с равными по цене платами на чипсете AMD 780G (а к тому времени уже вышел и 790GX) получается явно из серии «не бить лежачего». Напомним, что в основе графического ядра в чипсетах Intel используется развитие, некогда лицензированного у PowerVR, «тайлового» движка, поэтому скорее остается удивляться, как разработчикам вообще удается «прикручивать» поддержку очередной версии DirectX. Говорить о соревновании на равных по производительности с графическими решениями от AMD и NVIDIA явно не приходится. А вот офисные чипсеты G41/G43, пожалуй, есть за что похвалить, наконец-то и под платформу Intel появился выбор плат с несколькими видеовыходами (включая, что самое главное, цифровой, как минимум — DVI), пока еще не во всех моделях и не самых дешевых, но это ощутимый прогресс по сравнению с ситуацией, наблюдавшейся ранее.

Но давайте переключимся на новинки в процессорном сегменте. И взявшись называть «продукты года» от каждой компании, в случае с Intel эту номинацию несомненно следует присвоить процессорам на основе 45 нм ядер Wolfdale/Yorkfield (четырехъядерники формально вышли еще в конце 2007 года, но относительно доступные модели появились лишь поздней весной 2008). Сказать об этих процессорах что-то оригинальное вряд ли получится, но уже давно не секрет, что самыми популярными и «народно любимыми», как правило, и становятся процессоры, являющиеся, условно говоря, «второй версией», в которой зачастую как таковых технических инноваций немного (в отличие от «первой»), но вот привлекательность самого конечного продукта для покупателя максимальна.

Впрочем, сказанное совсем не означает, что обновления ранее разработанных ядер априори удачные, или что новые ядра всегда содержат какую-то глубокую и перспективную идею. Например, в выпуске процессоров Atom ключевую роль явно сыграла возможность к тому моменту выделить часть производственных мощностей для выпуска по техпроцессу 45 нм «чего-то еще» помимо упомянутой ревизии Core 2. И, конечно, сам по себе выпуск процессора по производительности находящегося где-то между Celeron-M 900 МГц и Penitum-III M 1,13, работающего при этом на частоте 1,6 ГГц, мог бы вызвать лишь недоумение. Либо ехидные замечания, что это вероятно происки какого-то ранее уволенного разработчика Pentium 4, который назло обидчикам разработал и подбросил в лабораторию Intel схемы процессора с рекордно низкой эффективностью. Однако! Давайте все же учтем и другие характеристики, в частности, потребляемую мощность, которая у младших одноядерных версий находится в пределах 2,5 Вт, что очень даже неплохо и с практической точки зрения реабилитирует такой процессор в глазах разработчиков ультра-мобильных устройств.

А получившая популярность усилиями ASUS идея «двухсотдолларового ноутбука» (которые было решено далее называть политкорректным термином «нетбуки», чтобы не акцентировать внимание на порою вполне ноутбучных ценах отдельных «недобуков»), к тому моменту настойчиво требовала поддержки процессорами. И вполне естественно, что ввиду отсутствия массовой доступности других, аналогичных по свойствам или более удачных процессоров, большинство моделей было основано на Intel Atom. В результате множество людей получили действительно неплохую игрушку или даже местами рабочий инструмент. И определенно можно утверждать, что число интересующихся подобными устройствами далеко не исчерпано, рынок не насыщен, хотя вполне логично предлоложить, что те, кто еще не приобрел нетбук, но интересуется самой идеей, могут быть более привередливыми и в отношении производительности, и времени автономной работы, и в других вопросах.

И здесь собственно могут быть две технические претензии к предложенной платформе от Intel (а заодно и возможность для конкурентов предложить более удачную альтернативу). В первую очередь, это конечно, неоптимальная связка данного процессора с чипсетом i945GC, имеющим TDP=22,2 Вт, что выглядит явной диспропорцией в сравнении с самими процессорами, не говоря уж о собственно не впечатляющих характеристиках старого графического ядра GMA 900. Логично предположить, что если в Intel хотя бы перевели этот чипсет с 65 на 45 нм техпроцесс, это уже позволило бы перераспределить доли в потреблении энергии более естественным образом (в пользу процессора), и возможно потребовалось в меньшей степени урезать производительность самого процессора. Ясно, что разрабатывать специальный чипсет для нетбуков невыгодно, даже с учетом тех объемов продаж, которыми оперирует Intel. Но коль скоро экономичного чипсета с интегрированной графикой у Intel нет, вполне мог бы помочь перевод имеющегося на более тонкий техпроцесс (даже с поправкой на то, что таким образом будут загружены дефицитные, наиболее современные, производственные мощности), при этом заодно несколько снизилась и себестоимость комплекта.

Второй пунктик можно назвать идеологическим: столь сильно урезая производительность процессорного ядра, разработчики имели в виду скорый переход на двухъядерные модели. Однако TDP таких моделей уже составляет от 12 Вт, и возникает естественный вопрос, насколько вообще эффективна такая концепция для слабомощных ноутбуков? Иными словами, а допустима ли такая роскошь, как возможность простаивания второго ядра, притом что первое не располагает не то что избытком, а банальным достатком мощности для типичных, повседневных операций? А то что второе ядро будет зачастую простаивать, тогда как первому придется корпеть на все 100 процентов, думается, не является ни для кого откровением. Наивно предполагать, что кто-то из производителей ПО будет что-то оптимизировать для ультрабюджетного сегмента, этому сегменту всегда придется довольствоваться остатками с барского стола. А настольные и мало-мальски современные ноутбучные процессоры, начиная с какого-нибудь Pentium M 1,2 ГГц, могут справиться с теми простенькими графическими редакторами, почтовиками, браузерами и прочим ПО, которое вообще подъемно для нетбуков, с помощью единственного ядра легко и непринужденно, то есть вопрос распараллеливания для большинства таких программ просто не возникал за ненадобностью. Говоря о том, что в сегменте «для взрослых», уже задействуются два и более ядер, мы все же имеем в виду несколько иной класс ПО, в первую очередь профессиональные программы, игры, некие поползновения на многозадачность, о чем в контексте нетбуков говорить смешно, да и просто некорректно. Иными словами, если «отняв» у чипсета избыточные ватты, пропорционально усилить одноядерный (!) процессор, наверняка могла бы получиться уже весьма и весьма резво реагирующая на команды пользователя машинка. Да собственно, почему «могла бы», вполне еще может, нетбуки только начали развиваться, и вряд ли кто знает, как будет выглядеть устоявшаяся конструкция недорогих-компактных через несколько лет.

А вот переведенные на 45 нм «нормальные» мобильные процессоры и в целом платформа Centrino 2 вряд ли может вызвать какую-то полемику, это в чистом виде товарный продукт, никаких неожиданных новшеств сама платформа не принесла, так что сравнивать и обсуждать здесь можно лишь готовые ноутбуки. Задержка с выпуском, вызванная ожиданием готовности мобильной версии чипсета G45 (ох уж эта интегрированная графика!), оказалась даже в какой-то степени на руку любителям мощных ноутбуков, в результате очень много моделей были основаны на чипсете P45 и получили дискретные видеокарты. Вообще, мнение о том, что ноутбук с видеокартой должен быть непременно тяжелым и громоздким, то есть входить в класс «замена настольного ПК», верно лишь в той части, что такие модели, действительно, преобладают. Однако вовсе не правильно считать, что компактный ноутбук с дискретным видео нельзя разработать! Автор до сих пор не без удовольствия берет в руки старенький Samsung X10 с самой настоящей, на момент выпуска, не самой плохой «дискреткой», при этом вовсе не отягощающий даже пешехода, а по габаритам до сих пор имеющий не так много последователей среди 14-дюймовых моделей. Очень жаль, что рецепт приготовления подобных устройств с тех пор утерян (или забыт), в том числе и самой Samsung. Во всяком случае, дальнейшего логического развития (на новой элементной базе, большим сроком автономной работы, увеличенным разрешением экрана, но с сохранением габаритов и массы) эта идея не получила.

Наконец, осталось упомянуть еще одну процессорную разработку, вызвавшую весьма неоднозначную реакцию среди компьютерных энтузиастов и обозревателей, хотя она рассчитана именно на первых. Кому-то не понравилось отсутствие прироста производительности в играх, некий даже регресс в разгонном потенциале и тепловыделении (во всяком случае насколько можно верить той небольшой статистике, которая накопилась в обзорах), кого-то озаботила ограниченная совместимость с модулями памяти, наконец, кто-то даже нашел упоминание о наличии «ошибки TLB» и связал отсутствие прогресса в играх с влиянием коррекции ее через BIOS (соответственно, когда ошибка будет исправлена аппаратно в следующих ревизиях процессора, скорость может подняться). Наконец, все дружно отметили дороговизну плат на чипсете X58, и явно неадекватную пока стоимость платформы в целом. Вы, конечно, уже догадались, что речь идет о процессорах Core i7, относительно недорого оцененная младшая модель уже побывала в нашей лаборатории и продемонстрировала результат лишь чуть превосходящий Сore 2 Duo E8500.

Впрочем, наверное, несправедливо говорить о i7, как о каком-то провальном продукте, нет, это нормальный, серийный продукт от компании Intel, к которым мы привыкли. Другое дело, что Core 2 Duo на момент своего выхода действительно выглядел шедевром, скажем так, уровня Athlon 64 X2 (разумеется, также на момент выхода, для своего времени, по степени влияния на индустрию и бизнес самого чипмейкера). Но согласитесь, как бы вам ни нравились песни какого-то исполнителя, неразумно ждать от кумира пластинок, состоящих преимущественно из хитов, бывают и проходные альбомчики. Сама Intel достаточно трезво оценивает перспективы новых процессоров, не собираясь принуждать пользователей на них «пересаживаться» и снимать с производства старые процессоры, пользующиеся популярностью. Другое дело, был ли ожидаем такой расклад на момент выпуска или это следствие реакции рынка? Возможно, Intel не стоило торопиться с выпуском процессора на ядре Nehalem на рынок процессоров для настольных ПК, а стартовать с серверов, где основные новшества «инфраструктурного характера» давно ожидаемы?

NVIDIA

Для компании NVIDIA прямо-таки феерический успех 2007 года, когда выпуск успешных продуктов совпал с ростом рынка, сменился едва ли не столь же резким и вряд ли кем-либо прогнозировавшимся спадом в 2008. Причем начало года никаких проблем не предвещало.

Достаточно вспомнить выпуск GeForce 9600GT. Ориентированная на недорогой сегмент, карта практически догнала предыдущий, очень удачный продукт GeForce 8800GT. И глядя на такое начало, логично было предположить, что карты из девятой серии с восьмеркой во второй позиции индекса оторвутся на недосягаемую для конкурента величину и повторят успех предшествеников. Неплохо дела шли и на рынке чипсетов: nForce 790i, хоть и вызывал некоторые нарекания в части чрезмерного тепловыделения (в результате на некоторых платах даже устанавливалось активное охлаждение, от чего мы уже успели отвыкнуть), и высокой стоимости. Но для экстремалов, желающих получить максимально возможную производительность в играх, альтернативы этому чипсету с поддержкой SLI не было вовсе, так что поддержка этого чипсета производителями плат была вполне предопределена. Менее успешным оказался GeForce 8200 на фоне собственного конкурента (AMD 780G), но и этому чипсету (да и другим аналогичным по функциям младшим моделям в линейке nForce 700a) нашлась неплохая рыночная ниша, в частности, на полноразмерных ATX-платах, для пользователей, не интересующихся играми, но желающих приобрести недорогую плату с широкими возможностями для расширения. Да и в microATX-формате таких плат выпущено немало.

А вот GeForce 8300/9300 получили ограниченную поддержку. Хотя в российской рознице первый достаточно популярен, благодаря нескольким моделям от ASUS. Второй же, ориентированный на платформу Intel, вышел позже, так что еще имеет определенные шансы. Но, откровенно говоря, не очень большие, графическое ядро в этом чипсете, хоть и слабее, чем, например, у AMD 790GX, но на голову выше по сравнению с Intel G45, а как показывает опыт, и для NVIDIA, и остальных пробовавших, весьма затруднительно проникнуть на вроде бы емкий рынок «интеграшек» для платформы Intel, вне зависимости от соотношения характеристик, лишь для самого лоу-энда сделано исключение. Хотя, может быть, в этот раз у NVIDIA все-таки получится.

Вышедшая cледующей карта GeForce 9800GX2 оказалась в прямо противоположном по отношению к 9600 GT сегменте самых высокопроизводительных решений. И ни подтвердить, ни опровергнуть предположений о том, как будут выглядеть основные модели из 9800-ой серии не могла. Естественно, что NVIDIA удалось вернуть себе статус производителя самых мощных видеокарт (к тому времени перешедший к Radeon HD 3870 X2), просто по той причине, что одиночная 8800 GT сильнее одиночной 3870, соответственно, это верно и при сравнении двухчиповых карт, с поправкой на разницу в частотах. Однако решение NVIDIA было даже не двухчиповым, а состоящим из двух печатных плат, и победа такого монстра над другим, в общем-то тоже монстриком, не позволяла сделать каких-то практических выводов. Все ждали результатов одночиповых карт из 9800-ой серии, в которой логично было предполагать и какие-то качественные оптимизации архитектуры, по сравнению с 8800, не зря же сменился модельный номер.

Но чем же на самом деле оказался GeForce 9800 GTX? По сути немного разогнанным 8800 GTS 512, для которого была обещана умеренная цена, что само по себе радовало, но вот отсутствие каких-либо качественных инноваций не могло не огорчать, ведь помимо 8800 GTS в предыдущей линейке были более мощные GTX и Ultra, в сравнении с которыми новый топ не только не выигрывал, но местами и уступал. Впрочем, компания NVIDIA тут же успокоила своих поклонников тем, что эта карта вовсе не представляет собой предел совершенства чипов от NVIDIA в 2008 году. И хотя модифицировать архитектуру серьезно, действительно, не предполагается, мощные одночиповые карты на подходе, а принцип получения чипов будет состоять в пропорциональном увеличении числа потоковых процессоров. Предполагалось, что такие чипы хоть и будут производиться сначала на прежнем 65 нм техпроцессе, но скоро мигрируют на 55 нм, что позволит вернуть экономические параметры к прежнему уровню, а производительность возрастет.

В общем-то в этом плане удалось все, кроме перехода на более тонкий техпроцесс, и, конечно же, NVIDIA вряд ли предполагала, что у AMD готовятся столь удачные продукты. Выпуск GTX 280 состоялся еще до анонса моделей из линейки HD 4800, но тут NVIDIA сама несколько сгладила эффект от выпуска самого мощного одночипового решения 2008 года, установив непомерно высокие цены, которые оказались выше, чем на тот момент у 9800GX2, при это разница в производительности в ряде тестов — не в пользу GTX 280. А вот GTX 260 уже сравнивали с Radeon HD 4870 и резюме оказывалось не в пользу первого, имея более высокую цену, карта от NVIDIA не демонстрировала особого отрыва, а местами даже проигрывала.

Поправить ситуацию NVIDIA пыталась выпуском разогнанного GeForce 9800 GTX+, но учитывая разницу в себестоимости, было очевидно, что AMD вполне сможет контролировать ситуацию, корректируя цены на HD 4850, а разогнанную карту и на основе этого GPU найти также не представляет никаких сложностей. А вот выпуск усиленного GTX 260 с 216 шейдерными процессорами, на первый взгляд, более сильный ход, тем более, что дополнительно разогнанные еще и по частотам карты на основе этого GPU в ряде тестов достигают уровня даже GTX 280. Но как, спрашивается, отличить карту с новым GPU от старого? К счастью, некоторые производители выпустили обновленные версии карт с характерными индексами, с которыми не возникает сложностей в идентификации. В остальном же возникает исключительно вопрос: для чего было вносить такую неразбериху? И ответ в общем-то вполне очевиден: учитывая сохранение все того же 65 нм техпроцесса, скорее всего, и чипы на оригинальной версии GTX 260 не радовали NVIDIA по себестоимости (вернее не радовала разница между себестоимостью и фактическими ценами, которые пришлось установить на такие карты, значительно снизив относительно первоначальных планов). А уж если еще ужесточить политику отбора, сохранив цены и обозначив новый GPU, как например, GTX 270, может вполне оказаться, что из этих самых 270-ых на рынок попадут какие-то крохи, а вот и без того слабые продажи 260-ых упадут окончательно. А так, есть шанс, что не упадут, а даже немного возрастут, если кто-то прочитав где-либо обзор нового GTX 260, вдобавок разогнанного, распространит выводы на все, имеющиеся в продаже карты с таким индексом, и отправится в магазин.

Все-таки и для компаний, во всяком случае небольших, как и для людей, сущестуют некие периоды, когда собственные усилия натыкаются на некие внешние обстоятельства, и когда наоборот все удается как бы само собой. Судите сами, если анонс видеочипов встретил такой конкурентный отпор, это, конечно, объективное рыночное обстоятельство, но почему в то же самое время должен был разразиться скандал с дефектными чипами для ноутбуков (в списке подозреваемых 8400M, 8600M, некоторые из дешевых 6000 и 7000-ых, Quadro NVS 135M и Quadro FX 360M)? Ясно, что от таких вещей никто не застрахован (разве что лучше как можно раньше признать наличие таких проблем, а не ждать, когда они вскроются сами собой, потому как вскроются непременно и в самый неподходящий момент, и само собою недовольных в результате окажется гораздо больше, а значит и убытки выше).

Но не будем заканчивать на столь минорной ноте, да и было бы несправедливо оставить NVIDIA без номинации «продукта года». Но что именно отметить? Рискну поступить максимально субъективно и присудить эту номинацию потоковому процессору Tesla C1060. Напомним, что сама торговая марка и первые продукты появились еще годом раньше, как ответ на ATI FireStream, соответственно, и после выпуска графического процессора GT200, NVIDIA обновила эту линейку. В сравнении с упомянутым FireStream 9250, решение NVIDIA при примерно равной производительности около 1 терафлопа (и сравнительно более низкой в операциях с операндами, представленными в формате с двойной точностью) потребляет больше энергии и занимает два слота. Также различия имеются в используемом языке программирования, для NVIDIA это — Cuda, для AMD — Brook+, а вот здесь уже, что удобнее в использовании и для чего, вопрос к профессионалам, в частности, с форума iXBT.

Но разумеется, речь в данном случае не о сравнительных характеристиках, а о самом факте. Ведь если информация о том, что нечто новое и мощное для серверов и суперкомпьютеров выпущено компаниями AMD или Intel, воспринимается как само собой разумеющаяся (кому же еще выпускать?), то NVIDIA с этим сегментом ранее ассоциировалась лишь косвенно (чипсеты для серверных плат, профессиональные видеокарты). Сейчас это, судя по всему, вполне серьезная претензия на участие, во всяком случае в сегменте суперкомпьютеров. Полистав сообщения на эту тему, можно обнаружить достаточно много информации о готовящихся или уже установленных системах с использованием таких процессоров.

VIA

Компания VIA изобилием выпускаемых продуктов и в прежние времена радовала редко, а теперь с решением сосредоточиться на выпуске чипсетов (и остальных компонентов) только для собственной платформы и вовсе редко отмечается в новостях с чем-то принципиально интересным. Поэтому, строго говоря, придерживаясь общественно-значимых или хотя бы практически полезных анонсов, следует сосредоточиться на одном продукте, так и поступим.

Если для Intel в процессе подготовке к выпуску процессора для нетбуков, вопрос заключался в том, как получить на основе существующих процессоров нечто с минимальным аппетитом, но при этом не совсем низкой производительностью. Для VIA вопрос, очевидно, формулировался наоборот: как поднять производительность ранее существовавших процессоров, не поплатившись за это экономичностью. Результат получил не менее звучное в сравнении с Atom название Nano, начинается линейка с процессора частотой 1 ГГц, имеющего TDP=5 Вт, а заканчивается моделью с частотой 1,8 ГГц, тепловой пакет которой составляет уже 25 Вт, но эта версия рассчитана не на ноутбуки, а на встраиваемые системы в сочетании с Mini-ITX платами, которые, похоже и составляют на сегодня основу бизнеса VIA.

Однако, конечно же, для массового рынка более интересны перспективы таких процессоров в составе нетбучных платформ. Как подтверждают существующие тесты, Nano на равной частоте с одноядерными Atom даже выигрывает. В тоже время с экономичностью дела у процессоров VIA обстоят хуже, особенно под нагрузкой (Nanо производятся по 65 нм техпроцессу), но зато чипсет (в настоящее время — VX700), имеет TDP равный всего лишь 3,5 Вт, что служит неплохой компенсацией. Таким образом, остается открытым лишь вопрос с массовой доступностью, а следовательно и заинтересованностью крупнейших производителей ноутбуков, которые отлично понимают, что какую-либо прибыль из нетбуков можно извлечь лишь за счет больших тиражей. В противном случае, разработкой VIA заинтересуются лишь мелкие региональные сборщики, которые уже активно эту платформу используют, но позволит ли все это самой VIA подняться с тех 0,6% процентов рынка, которые эта компания все еще удерживает, сказать сложно. Строго говоря, с потребительской точки зрения нам должно быть все равно сколько там у кого процентов, но для самого производителя, желающего двигаться в направлении более конкурентоспособных решений, это, конечно, важно.

Между тем есть у процессоров VIA и любопытная фирменная технология PadLock, позволяющая значительно ускорить операции шифрования. Имеющиеся бесплатные средства от самой VIA позволяют организовать защищенный обмен сообщениями и файлами, также ускорение возможно и для любых сторонних программ, например, браузеров, использующих в качестве криптопровайдера OpenSSL. Важно отметить, что это не какая-то программно-рекламная технология и действительно работает эффективно, в соответствующем тесте SiSoft Sandra был зарегистрирован результат почти вдвое превышающий успехи ни много ни мало Core 2 Quad QX9770! Для того чтобы оказаться лидером среди процессоров для настольных компьютеров, победы в таком специализированном бенчмарке, конечно же, недостаточно. Но для мобильных устройств актуальность защиты, хранящейся на дисках информации, для многих весьма существенна. И возможность реализовать это фактически бесплатно, не в ущерб производительности, может быть весомым преимуществом, с учетом общего невысокого уровня производительности нетбучных процессоров, существующих на данный момент. Очень жалко, что ни одна из утилит PGP-шифрования содержимого диска на сегодня не использует OpenSSL и не поддерживает PadLock, но технически реализовать такую поддержку не сложно, и очевидно до сих пор это не было сделано именно потому, что во встраиваемых решениях, где в основном применялась платформа VIA, востребованы другие аспекты криптозащиты.

Перспективы и прогнозы

Рассматривать «роадмапы», тем более неофициальные, «утекшие» в сеть, занятие утомительное и почти бесполезное, сроки выпуска и характеристики могут претерпеть более чем существенные изменения, так что все глубокомысленные выводы впоследствии будет просто смешно читать. Что касается общих тенденций, то на первый взгляд, исходя из спада на рынке, можно было бы предположить, что пропорционально удлинятся и периоды между обновлениями продуктовых линеек. Но это верно лишь отчасти: сменять старую линейку новой, исходя из внутренних планов, в отсутствии вынуждающих причин, конечно, можно позволить себе исключительно, когда рынок растет и надо просто хоть чем-то привлечь внимание благодушно скучающих потребителей. Но конкуренцию и в кризис никто не отменял, кроме того, все что связано с переходом на более тонкий (но уже освоенный) техпроцесс и прочие меры, направленные на снижение себестоимости, производители, скорее всего, постараются даже форсировать, насколько это позволяют имеющиеся ресурсы.

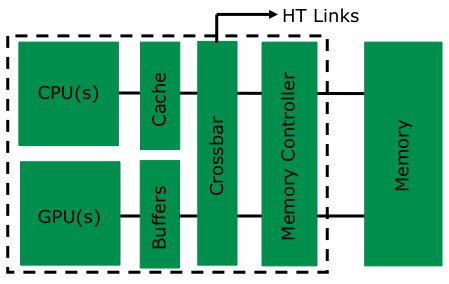

Также поскольку потребители уже вовсю начали экономить, логично предположить, что пристального внимания (и конкуренции) удостоятся среднебюджетные сегменты и, конечно же, стоит ждать дальнейшего развития идеи недорогих ноутбуков. Причем есть надежда, что активность будет проявляться не только в вызывающем уныние направлении сделать еще дешевле (и при этом выбросить уже все что только можно), заставив в итоге потребителя потратить вдвойне на попытках расширения памяти и прочего, и в результате все равно убедиться, что получившаяся игрушка ни на что не годится. Ведь из-за кризиса недорогим сегментом могут заинтересоваться и те, кто, например, ранее задумывался над тем, чтобы купить полноценный легкий ноутбук для работы в пути (и иногда — дома), но теперь к столь существенным тратам не готов. Однако, если на рынке появятся относительно недорогие легкие модели, с приемлемой для повседневных дел производительностью и размером экрана, вполне могут и присмотреться. Если посмотреть в более отдаленную перспективу, то здесь, конечно же, в первую очередь, разговор переходит на тему интеграции центрального процессора с графическим ядром. Ну что же, здесь действительно есть о чем поговорить. Напомним, что для AMD в этом суть проекта Fusion, в качестве центрально-процессорной составляющей планируются новые ядра с архитектурой Bulldozer, а для графической — актуальная на тот момент архитектура Radeon. У Intel специального названия для этого проекта нет, есть просто названия ядер (например, Havendale), в первые из которых обещают встроить графическое ядро с архитектурой, аналогичной используемой в чипсетах Intel, а в перспективе, вероятно, с этой целью используют так или иначе усеченные фрагменты готовящегося дискретного графического ядра Larrabee. Первоначально оба производителя планировали выпустить «пробные шары» уже в 2009 году, но AMD уже полуофициально сместила сроки на 2011 год, и поговаривают, что отсрочку может взять и Intel, поскольку нынешняя экономическая ситуация не особо способствует экспериментам с неясной финансовой отдачей.

Иными словами, по «процедуре» остался лишь вопрос сроков, чего тогда и обсуждать? На мой взгляд самый пикантный момент в этой истории состоит в том, что за всей суетой с обсуждением чье (еще не вышедшее!) ядро «будет круче» никто так и не задался одним маленьким вопросом: «Зачем?» Для чего нужно встраивать графическое ядро в ЦП? И еще более конкретно: с какой целью AMD выдвинула проект Fusion (и все тут же поспешили согласиться, что это перспективно)?

И тут сразу же оказывается, что наиболее естественный, подразумеваемый ответ, что это ускорит 3D-рендеринг изображения в играх, не выдерживает никакой критики. Шина между ЦП и видеокартой со времен появления AGP так более и не становилась узким местом (стандарты прогрессируют гораздо быстрее потребностей самих карт), сомневающиеся сами могут поэкспериментировать с частотами соответствующих шин. А вот наличие собственного массива памяти с большой пропускной способностью для нужд 3D-рендеринга весьма критично. И влияние видеобуфера можно проследить даже на примере, интегрированного в чипсет, видеоядра (например, включая и отключая SidePort у 790GX), ну а для мощных видеокарт на результат напрямую влияет не только само наличие, но и скоростные характеристики памяти (ширина шины, стандарт и частота памяти). Причем, что характерно, прогресс видеопамяти идет куда более быстрыми темпами по сравнению с тем, как совершенствуется подсистема памяти, связанная с ЦП.

Соответственно, цель в чем-то другом. Позволю себе предположить в чем именно. Итак, проще всего выглядит ситуация в мобильном сегменте и особенно для нетбуков, в таком гибридном процессоре, графическое ядро, действительно могло бы служить по прямому назначению. Причем о каком-то принципиальном новшестве речь не идет, у AMD этот подход используется в процессорах Geode GX довольно-таки давно, у Intel в конце 90-ых в разработке было процессорное ядро под кодовым названием Timna, где также планировалось интегрировать функции вывода изображения на экран, но идея не была доведена до практического воплощения. Ясно, что система, фактически основанная на одном чипе, может быть очень компактной, только вот производительностью, конечно, придется поступиться (как системной, так и графической), иначе чип выйдет слишком большим. Что касается совокупного TDP, то окажется ли он у такой системы ниже, чем у комбинации из экономичного центрального процессора и экономичного же чипсета с интегрированной графикой, сказать сложно, это будет зависеть от характеристик конкретных образцов. Однако тем, кто считает что первый вариант обязательно выиграет, хотелось бы напомнить пример из другой области: все помнят высокоинтегрированные чипсеты nForce 4 со встроенными сетевыми адаптерами и прочими излишествами, грелись которые куда приметнее, нежели менее насыщенные функциональностью конкуренты в паре с дискретными контроллерами на плате. Иными словами, все опять же будет зависеть от конкретной реализации и насколько удачны (экономичны, производительны) сами по себе объединяемые компоненты в отдельности.

Также совершенно ясно, что в топовые центральные процессоры встроенная графика еще долго НЕ попадет. Попросту говоря и графический, и центральный процессоры вполне достойны собственного кристалла, и как только появляется возможность за счет утончения технологических норм добавить транзисторы, получив таким образом больше вычислительных блоков, больший кэш и т.п., производители не преминут этим воспользоваться.

Ну а для чего, скажем, графическое ядро, среднебюджетным процессорам? А оно там будет. И вариантов применения несколько. Во-первых, можно, конечно, поступиться местом на кристалле, перенести из интегрированного чипсета в процессор то ядро, какое есть под рукой, и заставить работать по прямому назначению. Оно может даже заработает быстрее, чем в собственном чипсете (но не факт, что догонит чипсетную графику, планомерно наращиваемую конкурентом). Ну а вычислительная производительность самого процессора хоть немного да пострадает (и ситуация с TDP и разгонным потенциалом тоже ухудшится). А это упростит задачу конкуренту, как назло, не торопящемуся с интеграцией графики в свои процессоры! В результате, останется только насупиться и проворчать что-то в духе: «Вот AMD, вредная, сама велела интегрировать, а вместо этого на чипсеты налегает, не буду больше ее советов слушаться!» :)

Однако и сама AMD от интеграции вовсе не отказывается. Но судя по всему, и не собирается заставлять потоковые процессоры из «графической» составляющей будущих центральных процессоров работать по привычному назначению (для вывода графики)! С принятием всеми ведущими производителями графических и центральных процессоров спецификации OpenCL (и в свете грядущего DirectX 11), начало активной оптимизации ПО для исполнения хорошо распараллеливаемых алгоритмов силами GP GPU может оказаться делом ближайших нескольких лет. Ведь уже сейчас предустановленная база компьютеров, имеющих 3D-ускоритель, хотя бы в чипсете, очень велика. И в отличие от 3D-рендеринга, при использовании ресурсов GPU для вычислений в широком спектре приложений, сама возможность более тесного сообщения потоковых и универсальных ядер, благодаря интеграции, выглядит уже более насущной или во всяком случае не бесполезной. Что касается топовых систем, то, скорее всего, преимущество собственного видеобуфера и возможность внедрить еще больше потоковых процессоров на отдельный кристалл, вкупе с возможностью встроить в «дискретный» ЦП до восьми, а то и больше универсальных ядер, может сохранить традиционную концепцию на достаточно долгий срок.

Но в глобальной перспективе, вариант наращивания именно «потоковой» части ЦП выглядит разумнее увеличения числа универсальных вычислительных ядер. Ведь если присмотреться, существует достаточно четкое деление на два класса алгоритмов. Первые, скажем так, классические алгоритмы, помучавшись, можно попробовать распараллелить на пару-четверку универсальных ядер, и не всегда при этом рассчитывать на повышение производительности. В то же время существует целый класс приложений, работающих с графикой, видео и прочими мультимедийными данными, разумеется, сюда же относится и игровая физика и многое другое, для которых массовый параллелизм вполне естественен по природе. И даже не требует каких-то чрезмерных усилий при реализации, но лишь в том случае, если самих вычислительных конвейеров не 2-4 и даже не 8, а действительно много. И если начать разбираться по существу, оказывается, что именно к этому классу приложений относится львиная доля ПО, в котором пользователи хотели бы видеть прирост производительности и новые функциональные возможности. Вопрос, очевидно, даже не состоит в том, какой процессор способен продемонстрировать большую вычислительную производительность, скажем, состоящий из 8 универсальных ядер или из 4 универсальных и пары сотен потоковых (при сравнимой площади кристалла, равном TDP и прочем). Если в программах эти «сотни потоковых» будут задействованы, выигрыш может быть многократным. Будут ли задействованы? Разумеется, покажет время, и сам процесс вряд ли будет стремительным. Но предпосылки к этому есть в виду все той же предустановленной базы графических чипов и принятия упомянутых стандартов для реализации расчетов общего назначения на GPU. Иными словами, уже сейчас есть не только «на чем тренироваться», но и кому эти оптимизированные программы продавать.