Теперь уже 192 калифорнийских стрелка: Что они смогут за 399 USD?

СОДЕРЖАНИЕ

- Введение

- Особенности видеокарт

- Конфигурация стенда, список тестовых инструментов

- Результаты игровых тестов (производительность)

Да-да-да! Снова о калифорнийских стрелках, которые уже наверно всем надоели… Однако Nvidia с упорством, которому может позавидовать не одна IT-компания, выставляет все новые и новые отряды этих стрелков, то бишь шейдерных процессоров. Разница лишь в численности отрядов. Есть по 32, есть по 64, есть по 96, по 112, по 128, теперь по 192 и 240 в одной упаковке, то бишь в чипе. Осталось сделать 192-24 = 168, минус 24 = 144 стрелка, а также 192+24 = 216. И будет полный комплект, ассортимент всевозможный и на все случаи жизни с разницей в цене в 20 долларов, причем каждое решение будет носить суффикс Plus, Plus-Plus, SuperPlus, GreatPlus, GTXer, the GTXest, и поставлены клейма маркетологов насчет революционных решений. Вот когда закончится словарный запас эпитетов, тогда можно будет остановить процесс и подумать — а чего еще реально нового придумать?

Недавно по радио слушал «Хай-тек новости», так там вещали про новый мобильник с портативной стиральной машиной для носовых платков. Может стоит выпустить видеокарту, которая сможет чудесным образом превращаться в газонокосилку (все равно размеры все растут и растут), или в фен (все равно выдувает столько тепла, что хватит высушить волосы в целой парикмахерской), или плитку для подогрева завтрака или обеда (уже вон кофе варили, яйца жарили на CPU, чем видеокарта хуже, если она кушает 280Вт?)? И польза, и удобно.

В тех же новостях вещали про то, что в мусорной куче в Японии при раскопках нашли останки первого Тамагоччи. Представляете, через 100 лет найдут Geforce GTX? И что подумают? Явно про какой-то аппарат вещания в космос или приемник сигналов биологических полей, а может и прототип первого безкрылого летательного аппарата… Но то, что ЭТО отрядами выдавало шейдеры, которые в играх людям запудривали мозги, что те думали, что картинка трехмерная, — никто не подумает.

Итак, вернемся в наше время, время больших видеокарт и больших компьютерных блоков, иначе никак не вставить видеокарту с размерами 270 на 100 на 33…

Сегодня мы расскажем об ускорителе, который размерами и массой такой же как GTX 280, но вот чуточку урезан по шине и численности калифорнийских стредков, ну и по цене заметно дешевле. Это Geforce GTX 260.

Учитывая, что цена на GTX 280 очень и очень завышена, а на 260-ю модель цена — в рамках 400 долларов США, то вероятно именно этот ускоритель будет пользоваться бОльшим спросом. А что он может дать за свои деньги — мы посмотрим ниже.

Платы

| Reference Nvidia Geforce GTX 260 896MB PCI-E | |

|---|---|

| Карта имеет 896 МБ памяти GDDR3 SDRAM, размещенной в 14 микросхемах (по 7 на каждой стороне PCB) Микросхемы памяти Hynix (GDDR3). Микросхемы расчитаны на максимальную частоту работы в 1200 (2400) МГц. |  |

| Сравнение с эталонным дизайном, вид спереди | |

|---|---|

| Reference Nvidia Geforce GTX 260 896MB PCI-E | Reference Nvidia Geforce GTX 280 1024MB PCI-E |

|  |

| |

| Сравнение с эталонным дизайном, вид сзади | |

|---|---|

| Reference Nvidia Geforce GTX 260 896MB PCI-E | Reference Nvidia Geforce GTX 280 1024MB PCI-E |

|  |

| |

Как можно видеть, перед нами тот же GTX 280, на котором не распаяно 2 микросхемы памяти, от чего шина урезалась с 512 до 448 бит, а также объем памяти упал с 1024 до 896 мегабайт, ну и вместо 8-пинового разъема питания установлен привычный 6-пиновый (всего их два). Однако PCB несет в себе 512-битную шину обмена с памятью. Это заставляет размещать на текстолите 16 микросхем памяти (но распаяно 14!), поэтому потребовался дизайн с двухсторонним монтажом микросхем (по 8 штук на каждой стороне). Поэтому длина карты оказалось большой, да и PCB весьма дорогая. Не забываем, что Nvidia снова прибегла к способу разделения блоков GPU, и вынесла все блоки, отвечающие за вывод информации, в отдельную микросхему NVIO, как это было в случае G80 (8800 GTX/Ultra).

Теперь о кулере. Система охлаждения принципиально не отличается от того варианта, что мы видели еще на Geforce 8800 GTS 512. Да и форма кулера та же самая. Просто выросла длина радиатора в соответствии с размерами самой карты, ну и сзади установлена пластина для охлаждения микросхем памяти на обороте карты. Все устройство собрано так, что создает единый общий большой радиатор из крышек (задняя и передняя крышки защелкиваются, поэтому при разборе видеокарты и снятии кулера есть определенные сложности и нужен некий опыт, чтобы обнажить саму карту, не нанеся повреждений). Опыт создания 9800 GX2 с такими же защелками понравился инженерам.

Напоминаем еще раз важный момент: длина ускорителя — 270 мм, как у 8800 GTX/Ultra, поэтому в корпусе должно быть достаточно места для установки такой конструкции. А также обратим внимание на ширину кожуха, которая неизменна вдоль всей длины, а следовательно на материнской плате за PCI-E x16 разъемом не должно быть никаких портов и высоких конденсаторов, причем на ширину 30 мм (то есть не только за самим слотом PCI-E, но за соседним с ним не должно быть никаких высоких частей на системной плате).

Видеокарты этой серии оснащены гнездом для подключения звукового потока с аудио-карты для передачи его затем на HDMI (с помощью переходника DVI-to-HDMI), то есть сама видеокарта не оснащена аудио-кодеком, но осуществляет прием сигнала от внешней звуковой карты. Поэтому, если кому эта функция важна, следите за тем, чтобы в комплекте поставки видеокарты был аудио-шнурок для этих целей.

Также напомним, что питание ускорителя осуществляется с помощью ДВУХ разъемом, причем оба 6-пиновые.

У карты имеется гнездо TV-выхода, которое уникально по разъему, и для вывода изображения на ТВ как через S-Video, так и по RCA, требуются специальные адаптеры-переходники, поставляемые вместе с картой. Более подробно о ТВ-выходе можно почитать здесь.

Подключение к аналоговым мониторам с d-Sub (VGA) производится через специальные адаптеры-переходники DVI-to-d-Sub. Также поставляются переходники DVI-to-HDMI (мы помним, что данные ускорители поддерживают полноценную передачу видео и звука на HDMI-приемник), поэтому проблем с такими мониторами также не должно быть.

Максимальные разрешения и частоты:

- 240 Hz Max Refresh Rate

- 2048 × 1536 × 32bit x85Hz Max — по аналоговому интерфейсу

- 2560 × 1600 @ 60Hz Max — по цифровому интерфейсу (все DVI-гнезда с Dual-Link)

Что касается возможностей видеокарт по проигрыванию MPEG2 (DVD-Video), то еще в 2002 году мы изучали этот вопрос, с тех пор мало что поменялось. В зависимости от фильма загрузка CPU при проигрывании на современных видеокартах не поднимается выше 25%.

По поводу HDTV. Одно из исследований также проведено, и с ним можно ознакомиться здесь.

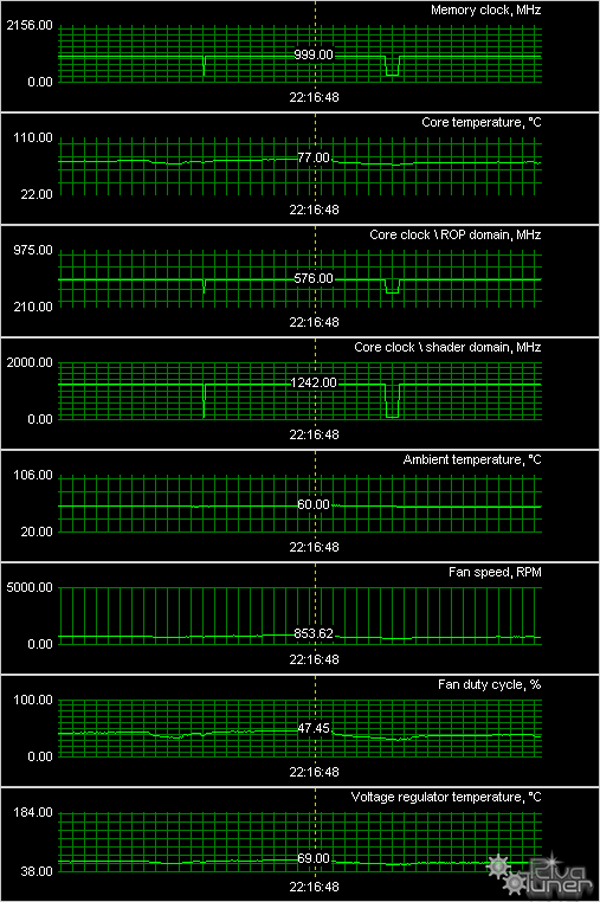

Мы провели исследование температурного режима с помощью утилиты RivaTuner (автор А.Николайчук AKA Unwinder) и получили следующие результаты:

Как мы видим, проблем с перегревом нет. И кулер работает тихо, как и в случае с 280. Отметим, что максимальная потребляемая мощность в данном случае уже не 280Вт, а всего 200.

Поскольку карта поставляется в ОЕМ-виде как сэмпл, то о комплекте поставки речь не идет.

Установка и драйверы

Конфигурация тестового стенда:

- Компьютер на базе Intel Core2 (775 Socket)

- процессор Intel Core2 Extreme QX9650 (3000 MHz);

- системная плата Zotac 790i Ultra а чипсете Nvidia nForce 790i Ultra;

- оперативная память 2 GB DDR3 SDRAM Corsair 2000MHz (CAS (tCL)=5; RAS to CAS delay (tRCD)=5; Row Precharge (tRP)=5; tRAS=15);

- жесткий диск WD Caviar SE WD1600JD 160GB SATA.

- блок питания Tagan TG900-BZ 900W.

- операционная система Windows Vista 32bit SP1; DirectX 10.1;

- монитор

Dell 3007WFP (30"). - драйверы ATI версии CATALYST 8.5; Nvidia версии 175.16 (9ххх серия) и 177.34 (GTX 260).

VSync отключен.

Результаты тестов: сравнение производительности

В качестве инструментария мы использовали:

- Call Of Juarez (Techland/Ubisoft) — DirectX 9.0, shaders 3.0 (HDR), demo (demo Тестирование проводилось при настройках, выставленных на максимальное качество. Батник для прогона прилагается.

- S.T.A.L.K.E.R. 1.003 (GSC Game World/THQ) — DirectX 9.0, демо для запуска. Файлы надо положить в рабочий каталог игры, где все savegames (Documents and settings). После запуска игры, загрузить уровень ixbt3 и, выйдя в консоль, запустить демо: demo_play ixbt3. Настройки тестирования — maximum (ВКЛЮЧЕНО ДИНАМИЧЕСКОЕ ОСВЕЩЕНИЕ).

- 3DMark Vantage 1.00 (FutureMark) — DirectX 10.0, shaders 4.0, мультитекстурирование, настройки тестирования — Extreme

- CRYSIS 1.2 (Crytek/EA), DirectX 10.0, shaders 4.0, (батник и демо для запуска), настройки тестирования — Very High, используется два уровня RESCUE и HARBOR).

Выражаем благодарность компании CRYTEK за написание timedemo для iXBT.com. - Company Of Heroes Opposing Fronts (Relic Entertainment/THQ) — DirectX 10.0, shaders 4.0, батник для запуска. После вхождения в игру вызвать опцию настроек, выбрать раздел по графике и нажать на кнопку с тестом. Тестирование проводилось при максимальном качестве.

- World In Conflict 1.007 (Massive Entertainment/Sierra) — DirectX 10.0, shaders 4.0, После вхождения в игру вызвать опцию настроек, выбрать раздел по графике и нажать на кнопку с тестом. Тестирование проводилось при максимальном качестве (very high с регулировкой АА и АФ).

- 3DMark06 1.10 (FutureMark) — DirectX 9.0c, мультитекстурирование, настройки тестирования — trilinear,

Производительность видеокарт

Читатели, которые хорошо разбираются в трехмерной графике, смогут разобраться, посмотрев диаграммы далее, и сделают для себя вывод. А для новичков и тех, кто только-только занялся вопросом выбора видеокарты, мы сделаем некоторые пояснения.

Во-первых, имеет смысл ознакомиться с нашими краткими справочниками по семействам современных видеокарт и процессоров, на основе которых они выпускаются. Следует отметить частоты работы, поддержку современных технологий (шейдеры), а также конвейерную архитектуру.

Справочник по ATI RADEON X1300-1600-1800-1900-х серий

Справочник по Nvidia Geforce 7300-7600-7800-7900-х серий

Во-вторых, в разделе 3D-Video наш читатель, который только-только столкнулся с проблемой выбора видеокарты, и растерян, может ознакомиться как с азами трехмерной графики (все равно они понадобятся, ведь запуская игру, и входя в ее настройки, пользователь столкнется с такими понятиями, как текстуры, освещение и т.д.), так и с базовыми материалами по новым продуктам. Всего компаний, выпускающих ныне популярные графические процессоры, две: AMD (графикой занимается подразделение ATI) и Nvidia (Есть еще Matrox, S3, однако их доля в дискретной графике сегодня меньше 1%, и потому их можно не брать во внимание). Поэтому основная масса информации разбита именно на две части. Ежемесячно выходит также 3DSpeed, где как бы сводятся в одно все сравнения различных карт для разных ценовых секторов.

В-третьих, посмотрим на тесты рассматриваемых сегодня карт.

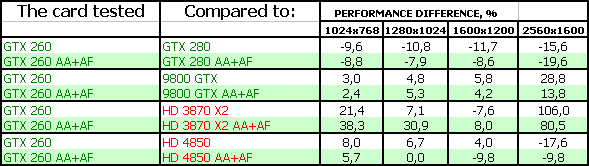

S.T.A.L.K.E.R.

Результаты тестов (ДИАГРАММЫ!!!): S.T.A.L.K.E.R.

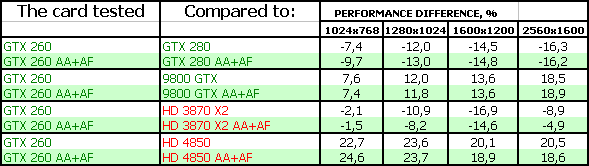

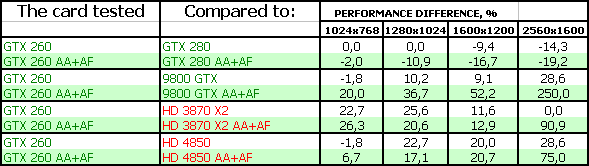

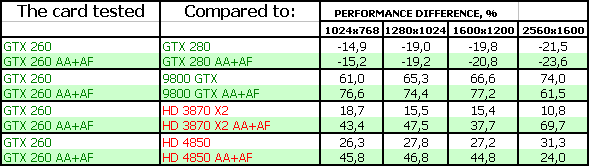

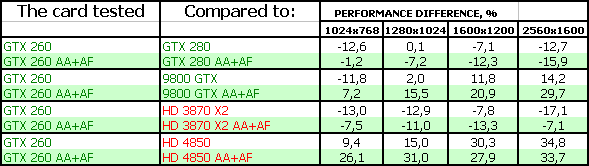

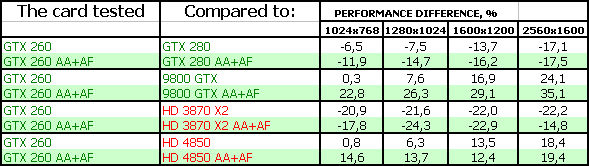

Как мы видим, GTX 260 находится аккурат посредине между 9800 GTX и GTX 280. А учитывая высокую мощь Х2, новинка проиграла сражение последнему.

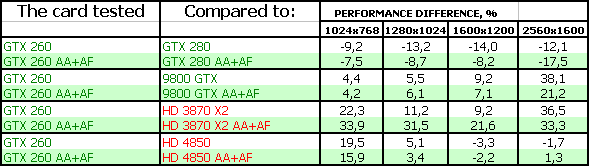

World In Conflict

Результаты тестов (ДИАГРАММЫ!!!): World In Conflict

В этой игре, во-первых, налицо видны оптимизации или самого движка, или драйверов от Nvidia, но игра явно «симпатизирует» продуктам калифорнийской корпорации. При этом GTX 260 по скорости больше тяготеет к GTX 280, нежели к 9800 GTX.

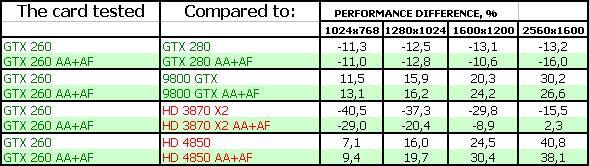

CRYSIS, Rescue, DX10, Very High

Результаты тестов (ДИАГРАММЫ!!!): CRYSIS, Rescue, DX10, Very High

А здесь ситуация более приятная для новинки. Очевидно, что GTX 260 снова находится посредине между GTX 280 и 9800 GTX, ну и опережает двухчипового гиганта Х2, у которого явные проблемы с работой CrossFire.

CRYSIS, Harbor, DX10, Very High

Результаты тестов (ДИАГРАММЫ!!!): CRYSIS, Harbor, DX10, Very High

Ситуация аналогичная.

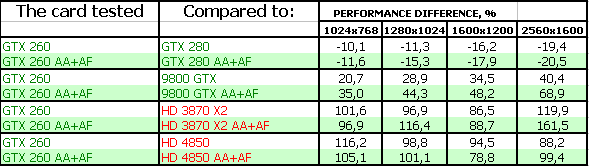

Call Of Juarez

Результаты тестов (ДИАГРАММЫ!!!): СoJ

Эта игра продемонстрировала отлаженную работу CrossFire, поэтому X2 с легкостью обошел новинку, которая по-прежнему демонстрирует срединные результаты между GTX 280 и 9800 GTX.

Company Of Heroes

Результаты тестов (ДИАГРАММЫ!!!): CoH

Ситуация аналогичная.

3DMark Vantage: Graphics MARKS

Результаты тестов (ДИАГРАММЫ!!!): 3DMark Vantage: Graphics MARKS

В принципе очень похожая на предыдущую картину, GTX 260 вышел в лидеры в своей группе, и его производительность на 20% ниже GTX 280, однако на целых 66-70% выше, чем у 9800 GTX.

3DMark06: SHADER 2.0 MARKS

Результаты тестов (ДИАГРАММЫ!!!): 3DMark06 SM2.0 MARKS

Под эти шейдеры давно уже никто ничего не оптимизирует, поэтому ситуация разноплановая и подчас малопонятная. Такой разброс еще раз доказывает нам — что четко выстроенную картину побед или поражений можно лицезреть ТОЛЬКО после оптимизаций драйверов и софта. Как только последние пропадают, уже истины, как говорится, не найти.

3DMark06: SHADER 3.0 MARKS

Результаты тестов (ДИАГРАММЫ!!!): 3DMark06 SM3.0 MARKS

Вот шейдеры 3.0 еще как-то актуальны, — под них делаются оптимизации, и картина резко меняется. Видим срединное положение GTX 260, как и ранее. А также поражение в битве с Х2, у которого для этого теста все оптимизации имеются и включены.

Выводы

Что мы видим? Ну явное положение середняка между 9800 GTX и GTX 280, то есть младший уровень Hi-End. Любопытно, что в эти дни, вероятно, от испуга перед RADEON HD 48xx серией, Nvidia изменила цены, и 9800 GTX теперь должен спуститься до 200 долларов США, согласно рекомендованным ценам, а на месте в 229 долларов появится разогнанный 9800 GTX — 9800 GTX+. И есть предположение, что разница между ним и GTX 260 станет еще меньше. А последний стоит 399 долларов США! Мысль улавливаете? — что это очень высокая цена для GTX 260. И она должна быть снижена на сотню долларов.

Просто Nvidia в погоне за конкуренцией с новыми продуктами AMD совсем забыла о том, что между GTX 260/280 и предыдущими топами, которые теперь ушли в миддл-сектор, образовалась целая пропасть (между 200-229 долларов и 399 — есть очень большая разница). И раз они скинули цены так на 9800-ю серию, то придется им скидывать и на GTX 260, а затем и на 280. Что будет очень болезненно, поскольку продукты только недавно вышли, себестоимость высока, процент выхода чипов не сильно велик (это видно по дефициту GTX-серий в начале продаж), цены завышены специально, чтобы сбить спрос… Однако, вероятно, что спрос будет сам по себе не столь велик, ибо есть конкуренты со стороны AMD, да и, как показали наши тесты, в некоторых играх GTX 260 не очень сильно опережает 9800 GTX. Не говоря про 9800 GTX+ (тесты с ним будут уже в i3D-Speed).

В целом решение по выпуску GTX 260 было верным, ибо он прекрасно заполнял нишу между 9800 GTX и GTX 280. До тех пор, пока цена на 9800 GTX была в 299 долларов США. Теперь же она падает аж на 100 долларов. И это сильно бьет по GTX 260 при его цене в 399. Придется снижать и на него цены. А будет ли это делать Nvidia? — Время покажет.

Что касается сравнения GTX 260 и 3870 Х2, то мы бы отдали предпочтение первому. Несмотря на некоторые победы второго в ряде тестов. Потому что всегда одиночный GPU на отдельной карте это лучше, чем двухпроцессорное решение с ахиллессовой пятой в виде технологий CF/SLI (когда все подчас зависит от степени оптимизаций драйверов и качества программирования).

Основной вывод: GTX 260 показал очень приличную скорость, однако, как нам кажется, в свете последних изменений в конъюктуре рынка, цена высоковата. Может быть какой-нибудь читатель откроет эту статью в момент, когда цены сильно упадут, и GTX 260 получит все преференции, — все может быть. Потенциал у продукта — стать картой с высоким спросом, имеется.

Выбор, как обычно, за нашими читателями. Мы лишь даем информацию о том или ином продукте, но не даем прямых указаний по выбору того или иного изделия.

Еще один момент, который мы будем повторять из обзора в обзор. Придя к решению о самостоятельном выборе трехмерного ускорителя, то бишь видеокарты в своем компьютере, пользователь должен осознавать, что он меняет одну из основных составляющих работы его системного блока, которая может потребовать дополнительной настройки для лучшего быстродействия или включения ряда качественных функций. Это не конечный потребительский продукт, а комплектующее звено. И поэтому пользователь должен понимать, что для получения наибольшей отдачи от новой видеокарты ему придется познать некоторые азы трехмерной графики. И графики в целом. Если он не хочет этим заниматься, то не стоит приступать к самостоятельному апгрейду в этом плане: лучше приобретать готовые системные блоки с настроенным ПО (также он будет обеспечен технической поддержкой со стороны компании-сборщика такого системника), либо приставки для игр, где не надо ничего настраивать, включено то, что надо в самой игре.

И еще: хотим отдельно сказать насчет набора тестовых инструментов:

В обновленном и дополненном материале, посвященном инструменту тестирования FRAPS, мы наглядно показали, как неточны и ненадежны тесты, полученные с помощью этой утилиты, а иного инструмента, кроме встроенных в игры бенчмарков, у тестеров и нет.

Из этой статьи, также из первичного материала становится понятно, что как-то еще сносно (хотя опять же, с огромным потенциалом ошибок, ибо точность измерения зависит от конкретного тестера: вовремя он запустит и выключит FRAPS или же по какой-либо причине опоздает или наоборот раньше положенного момента сделает это) можно тестировать игры со встроенными и ОДИНАКОВО повторяющимися демками. Однако я сам лично сталкивался со случаями, когда в начале прохода демки или в самом конце — идут резкие перепады по нагрузке. И ошибка тестера, который запустил или остановил утилиту на полсекунды или на секунду раньше или позже — приводит к изменению среднего FPS на 15-20%. Это уже не погрешность, а никуда не годный результат. На одной карте запустил чуть раньше, на другой — чуть позже (невольно, разумеется, без умысла) — и получил совсем иную картину соотношений.

Но и это не главное. Дело в том, что таких игр со встроенными демками уже почти не найти. И тестеры идут на соверщенно неприемлемый, с нашей точки зрения, шаг, когда замер в игре делается простым проходом по прямой линии от точки начала загрузки сцены до какой-то условной финишной точки (ближайщего забора, фонаря, дерева и т.д.).

Всем понятно, что нереально пройти ОДИН и тот же путь в игре ТОЧНО ДО МИЛЛИМЕТРА также на разных картах и разных разрешениях. Плюс такие игры всегда вносят элемент случайности в сцену, и объекты даже могут быть расположены чуть иначе на ТОЙ ЖЕ СЦЕНЕ.

К сожалению, читатель на ресурсах, предлагающих огромное число тестов, не найдет — как они тестировали в той или иной игре (кроме тех, где есть бенчмарк)

Поэтому мы считаем, что пусть будет не столь велик набор тестовых игр, но все тесты прозрачны, точны, и, главное, прекрасно отражают картину соотношения ускорителей.

Более полные сравнительные характеристики видеокарт этого и других классов вы можете увидеть также в наших i3D-Speed и i3D-Quality.

Блок питания для тестового стенда предоставлен компанией TAGAN

Монитор Dell 3007WFP для тестовых стендов предоставлен компанией Nvidia