В последнее время этот хорошо известный различным менеджерам и прочим царям совет предстал перед обычными покупателями в новом свете: шутка ли, стало модно дробить рынок на множество ниш, разобраться в которых не под силу не то, что простому покупателю или скромному писателю обзоров, но, порой, и самим маркетологам производящих все эти нишевые товары компаний. Пресс-релизы последних зачастую не несут никакого четкого послания, куда именно нацелен новый продукт, и несчастные писатели обзоров вынуждены самостоятельно придумывать предполагаемую аудиторию для железки А и железки Б. Приступим.

Создав новое семейство Ti (Titanium), NVIDIA, несомненно, преследовала сразу несколько целей. Первая из них ответ на весьма достойную пару от ATI Radeon 8500/7500, роды которой несколько затянулись и все еще не могут разрешиться окончательно, чтобы показать конкретные цифры производительности и вес младенцев. Ситуация, надо отметить, досадная: бедные маркетологи NVIDIA вынуждены ждать конкретных финальных цифр по Radeon второго поколения, дабы решить, что, в какие ниши и по каким ценам предлагать на рынок. Но цифр все нет и нет, а акционеры и руководство компании уже вспомнили о пресловутом шестимесячном сроке. Работать в такой обстановке не представляется возможным, и вся надежда остается только на "секретное оружие Pейха" новые драйверы. Которые мы и получили, вероятно, как заполнение неловкой паузы, в течение которой ATI и NVIDIA стремятся пропустить друг друга в рыночную дверь осеннего сезона продаж вперед себя.

Выпускать NV25 или NV17, персональных киллеров Radeon 8500 и 7500 соответственно, до начала массовых продаж последних неблагоразумно. Но и упреждающий удар нанести было бы неплохо. Сия дилемма была решена достаточно просто и в то же время красиво: рынку предложено сразу три несуществующих чипа GeForce2 Ti, GeForce3 Ti200 и GeForce3 Ti500.

- GeForce2 Ti все тот же, знакомый по GeForce2 Ultra чип (NV15A, 0.18 мкм, номинальная частота ядра 250 МГц), но в комплекте с более медленной, 200 (400) МГц DDR памятью. Очевидно, что себестоимость этого чипа не превышает оную для "рядового" GeForce2 Pro (NV15), и он призван заменить последний, предложив чуть более высокую производительность за те же деньги и заняв рыночную позицию несколько "ниже" Radeon 7500. Очевидно также, что вследствие существенной зависимости производительности чипов из семейства GeForce2 от пропускной полосы памяти, прирост производительности будет заметен только в небольших разрешениях и играх (тестах) с "тяжелой" геометрией.

- GeForce3 Ti200 "заторможенный" GeForce3 (NV20, 0.15 мкм) с частотой ядра 175 МГц и памяти 200 (400) МГц. Ясно, что цена карт на базе этого GPU будет ниже нынешней цены GeForce3, и он нацелен на прямую конкуренцию с Radeon 7500, причем будет занимать рыночную позицию немного "выше" последнего. Разумеется, главный плюс этого продукта "Берите DirectX 8.0 за цену DirectX 7.0 у конкурентов".

- GeForce3 Ti500 новая топовая модель семейства GeForce3, на основе хорошо знакомого старого степпинга NV20 (A5), производство которого уже хорошо отлажено, и имеется приемлемый выход чипов, работающих на более высоких частотах 240 МГц ядро и 250 (500) МГц DDR память. Разумеется, этот набор позиционируется туда же, куда и топ-модель конкурентов, и призван напрямую соперничать с Radeon 8500.

Итак, ситуация напомнила сложно сплетенные пальцы двух рук. Кто-то рядом, кто-то выше, кто-то ниже. Выигрывает тот, чей большой палец окажется поверх всей этой кучи. Разумеется, как у NVIDIA, так и у ATI есть собственные мысли на эту тему. Про ATI чуть позже, в будущем обзоре Radeon 8500. Ну а другая рука (NVIDIA) несомненно замышляет в скором времени выпустить истинного "киллера" Radeon 8500 тот самый мощный NV25 (Ti900 или как там он будет называться ), слухи о котором регулярно появляются на просторах Сети. Впрочем, вернемся к нашим нынешним баранам (простите, титанам).

Несомненно, просто выпускать карты с измененной сеткой частот для такой фирмы, как NVIDIA, (как бы это вернее сформулировать ) "несолидно". Посему выпуск сопровождается тремя достаточно громкими заявлениями.

Заявление первое поддержка DirectX 8.1

Тут необходимо сразу расставить точки над "Ё". Это совершенно не тот DirectX 8.1, о котором говорит ATI :-). Ну а если серьезнее, то NVIDIA просто добилась от Microsoft признания пиксельных шейдеров версий 1.2 и 1.3 достаточными для заявления о совместимости с DirectX 8.1 (см. аналитический обзор ATI R200). И если Radeon 8500 поддерживает действительно существенно видоизмененные и качественно расширенные пиксельные шейдеры (большая длина кода шейдера, много новых команд, новые возможности по произвольной выборке значений из текстур и т.д.), то в случае продуктов NVIDIA речь пока идет лишь о незначительных изменениях (добавлено несколько новых команд, число регистров и длина шейдеров остались прежними). Поэтому стоит четко различать "тот" и "этот" DirectX 8.1, оперируя конкретными версиями шейдеров, а не общими словами о совместимости с 8.1 версией API. Более того, в текущих драйверах (на момент написания статьи 21.85) пиксельные шейдеры по-прежнему остаются версии 1.1.

Ждем! По большому счету, есть подозрения, что шейдеры версий 1.2 и 1.3 мы увидим только в NV25 и NV17. Насчет слухов о грядущей поддержке NV25 фирменных шейдеров Radeon 8500 (1.4) подобный поворот событий маловероятен. Такая поддержка потребовала бы существенной переделки всего комбинационного конвейера и системы выборки значений текстур, а на это у NVIDIA уже совершенно нет времени, ведь столь существенная переделка чипа способна задержать его выход более чем на полгода.

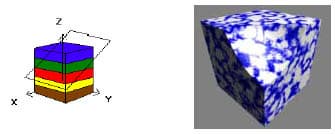

Заявление второе поддержка объемных (3D) текстур

Здесь NVIDIA выглядит более пристойно, хотя и наличествует одно "но". Полностью поддержка 3D-текстур, о которой далее пойдет речь, реализована только для чипов ревизии А05. Старые карты (образцы карт на базе NV20 ревизии А02 и первые продукты на базе А03) в приложениях DirectX объемные текстуры не поддерживают. Они остается заблокированными по неизвестной причине (даже программы из SDK в упор не видят 3D текстур на ранних ревизиях NV20), хотя следы их присутствия в D3DCAPS совершенно очевидны. Судя по всему, была обнаружена какая-то ошибка в чипе, и если в OpenGL, который пропускает через себя все данные, создавая списки запросов к ускорителю на основе вызовов API, она поддалась устранению на уровне драйверов, то в Direct3D, где большинство структур данных исполняется чипом напрямую, это осталось невозможным. В отличие от ATI, которая худо-бедно, но имеет поддержку 3D-текстур (еще со времен первого Radeon) как в Direct3D, так и в OpenGL драйверах. Впрочем этот аспект нельзя считать серъезным недостатком, т.к. карты на базе старых ревизий чипа продавались в очень ограниченных колличествах, удивляет только отсутствие официальной информации по этому поводу.

Однако надо отдать должное NVIDIA объемные текстуры реализованы существенно лучше, нежели в случае первого Radeon. Поддерживаются истинно сжатые (по всем трем измерениям, с коэффициентом сжатия 1:4 и 1:8) форматы текстур, мип-мэппинг объемных текстур и их процедурная генерация, а также использование их как 3D или даже 4D параметризованных таблиц для расчета каких-либо эффектов. Сжатие просто необходимо в случае объемных текстур одна 256х256х256 текстура спокойно занимает 64Мб в несжатом виде, что, понятно, совершенно неприемлемо. Использование сжатия позволяет сократить ее объем до 8Мб. Но даже в этом случае нам предстоит только мечтать о сценах, где множество объектов имеют собственные 3D-текстуры пока размеры локальной памяти ускорителей позволяют нам использовать лишь несколько объемных текстур для создания впечатляющих спецэффектов, таких как истинно объемный туман или сложное освещение.

Мип-мэппинг также позволяет снизить объем данных (уменьшая его по мере удаления от объекта) и, кроме того, повысить визуальное качество изображения объектов с 3D-текстурами.

Процедурные текстуры позволяют генерировать данные на лету, по какой-либо формуле, которая, впрочем, пока вычисляется центральным процессором системы. Такой подход позволителен для различных спецэффектов с быстро меняющимися объемными текстурами, но вряд ли оправдан как мера для экономии памяти в случае большого числа различных объектов с 3D-текстурами производительность будет ниже всякой критики.

На сегодня есть чуть ли не единственное игровое приложение, использующее 3D-текстуры DroneZ:

Это довольно примитивная по сюжету игра (аркада), однако она просто изобилует спецэффектами и использует все последние новации, доступные в OpenGL (в том числе и 3D-текстуры):

Впрочем, есть несколько неожиданный аспект применения объемных текстур а именно, Imposters (однозначно перевести не берусь :-). Так именуются плоские спрайты, которые обычно быстро отрисовываются с использованием прямоугольных 2D-текстур (за счет того, что имеют константное значение Z и не требуют поточечной интерполяции параметров). Подобные спрайты применяются для оптимизации вывода множества одинаковых небольших объектов, например, систем частиц.

Использование для них 3D-текстур открывает новые перспективы мы можем анимировать эти объекты, например, в зависимости от позиции воображаемого источника света. Если использовать набор заранее просчитанных изображений, то можно создать иллюзию огромного числа истинно трехмерных объектов, выводимых с фантастической скоростью ведь в действительности это всего лишь двумерные спрайты.

Итак, подведем итог: объемные текстуры остаются пока достаточно ресурсоемкой игрушкой, реально применимой только для создания спецэффектов. Их реализация в чипах семейства GeForce3 достойна всяческой похвалы, но может быть задействована полноценно только начиная с NV20 ревизии А05.

Заявление третье поддержка Windows XP

Здесь все прекрасно в наличии как полный набор 2D возможностей, необходимых для полноценного ускорения Windows XP, так и поддержка на низком уровне нового 2D API Microsoft GDI+. С точки зрения программистов последний представляет собою гораздо более удобный (личное мнение), нежели прежний GDI, объектно-ориентированный API, который, кроме всего прочего, с практической точки зрения обеспечивает еще и более быстрое построение изображений (проверенный факт) и более эффективное использование аппаратного ускорения. Не секрет, что еще несколько лет назад GDI зашел в тупик его производительность уперлась в архитектурные недостатки API. И GDI+ является попыткой преодолеть эти ограничения. Кроме того, он вносит несколько новых возможностей, уже широко применяющихся в интерфейсе Windows XP, таких как градиентные заливки. Ждем появления новых 2D тестов, рассчитанных на GDI+. Ziff Davis вы все еще спите? :-)

Помимо этого новые драйверы поддерживают давно анонсированный буфер теней. Учтем один важный момент: хотя все эти заявления и приурочены к выходу "титанового" семейства, нигде не сказано, что ранее выпущенные карты на базе GeForce3 будут лишены этих возможностей. Так и есть, драйверы не различают с этой точки зрения новые и старые карты на базе GeForce3, и даже самые первые образцы со степпингом А2 предоставляют нам все вышеупомянутые бонусы.

Перед тем, как перейти к практической части материала, я представлю список наших обзоров, посвященных исследованию разных карт на базе GeForce3, в том числе и разогнанных (поэтому уже можно составить представление о том, какую производительность мы можем получить от Ti500 на разных тестах).

- Теоретико-аналитические материалы и обзоры видеокарт, в которых рассматриваются функциональные особенности GPU NVIDIA GeForce3

- Обзор GPU NVIDIA GeForce3 и карт на его базе

- Исследование оптимизации NVIDIA GeForce3 под Intel Pentium4 и AMD Athlon

- MadOnion 3DMark2001 и NVIDIA GeForce3 любовь с первого взгляда

- Исследование NVIDIA GeForce3 с помощью Vulpine GLMark

- Экстремальный разгон NVIDIA GeForce3

- Обзор ASUS AGP-V8200 Deluxe затрагиваются вопросы: анти-алиасинг, масштабируемость, работа в тяжелых условиях на примерах Giants, Aquanox, Quake3 (Maximum,Quaver)

- Обзор Leadtek WinFast GeForce3 затрагиваются вопросы: анизотропия в Direct3D на примере 3DMark2001, работа в тяжелых условиях на примере GLMark с приведением графиков распределения FPS по времени

- Обзор Gigabyte GV-GF3000D затрагиваются вопросы активизации анизотропии и анти-алиасинга совместно и комплексное их влияние на производительность на примере Quake3

- Обзор Inno3D Tornado GeForce3 затрагиваются вопросы активизации технологии компрессии текстур DXTC на примере 3DMark2001

- SUMA Platinum GeForce3 на базе NVIDIA GeForce3 затрагиваются вопросы работы в Direct3D на примере 3DMark2000, анизотропии в Direct3D

- Gainward CARDEXpert GeForce3 PowerPack !!! на базе NVIDIA GeForce3 затрагиваются вопросы зависимости производительности GeForce3 от частоты работы центрального процессора на примере Quake3

- Palit Daytona GeForce3 на базе NVIDIA GeForce3 затрагиваются вопросы активизации анизотропии Level8 в Direct3D

- MSI GF3-VD64T (MS 8822) на базе NVIDIA GeForce3 (с VIVO) тестирование новейшей игры DroneZ, использующей возможности GeForce3

- ABIT Siluro GF3 VIO на базе NVIDIA GeForce3 (с VIVO) тестирование нового драйвера Detonator XP (версия 21.81) под Windows 98SE

- Краткие обзоры видеокарт на базе GeForce3 без исследования особенностей процессора GeForce3

Итак, вооружившись информацией о том, что готовят нам новое семейство Titanium и новые драйверы от NVIDIA, мы приступаем к "препарированию" самого старшего представителя Ti. Почему только его? Не спешите, читайте дальше. :-)

Платы

Действительно "новой" картой является только GeForce3 Ti500, так как именно она имеет повышенные частоты относительно традиционного GeForce3, поэтому представлять я буду только ее. Работу GeForce3 Ti200 мы эмулировали на ней же, понизив частоты до 175/200 (400) МГц. Работу GeForce2 Ti мы проверяли на базе видеокарты Leadtek WinFast GeForce2 Ultra, понизив у той частоту работы памяти до 200 (400) МГц.

Эталонная карта (reference card) NVIDIA GeForce3 Ti500 имеет AGP x2/x4 интерфейс, 64 Мб DDR SDRAM памяти, размещенной в 8-ми микросхемах на лицевой стороне PCB.

Микросхемы памяти марки ESMT (компания Elite Semiconductor), время выборки 3.5 ns, что соответствует примерно 285 (570) МГц. |  |

Память работает на частоте 250 (500) МГц. Несмотря на то, что по внешнему виду NVIDIA GeForce3 Ti500 очень похожа на обычную карту на базе GeForce3 и на микросхемах памяти установлены уже привычные радиаторы для охлаждения, частоты работы памяти по-прежнему занижены относительно номинальных. Я полагаю, что это не просто перестраховка, а, по-видимому, рекомендации производителя этой очень быстрой и сильно греющейся памяти. Однако я надеюсь, что разгон до номиальных частот будет возможен.

Графический процессор работает на частоте 240 МГц. Это всего на 40 МГц больше, чем было ранее (разница даже меньше, чем была в свое время между GeForce2 GTS и GeForce2 Ultra). На фотографии выше мы видим, что используется не только тот же GeForce3-чип (согласно маркировке), но даже степпинг его тот же А05 (А5). Разумеется, надо учитывать, что мы исследуем reference card, то бишь опытный образец, и не знаем, что будет у серийных карт. Во всяком случае, памятуя тот факт, что GeForce3-карты в достаточной мере сбалансированы, и повышение частоты работы чипа дает реальную прибавку в производительности, мы можем ожидать, что даже дополнительные 40 МГц весьма положительно скажутся на скорости. Впрочем, обо всем этом уже есть информация в наших материалах, так как в 3DGiТогах есть данные о производительности GeForce3, разогнанного аж до 255/280 (560) МГц, что даже выше, чем у Ti500. Если посмотреть обзоры по GeForce3 (список дан выше), то многие карты разгоняются до более высоких частот, нежели 240/250 (500) МГц.

Как я уже писал, на первый взгляд GeForce3 Ti500 очень похожа на эталонную карту GeForce3, однако различия есть:

Очень хорошо видно, что самые существенные изменения коснулись части PCB около VGA-гнезда:

За счет изменения блока питания ядра набор логики, отвечающей за качество 2D-картинки (фильтры и т.д.), был перенесен с оборотной стороны PCB на лицевую. Анализ качества изображения будет проведен ниже, а здесь я могу лишь констатировать, что инженеры NVIDIA в свое время вняли справедливым нареканиям и постоянно работают над совершенствованием качества 2D-графики.

Разгон

При наличии дополнительного охлаждения карта NVIDIA GeForce3 Ti500 дала возможность поднять частоты до 260/290 (580) МГц. Если разгон по памяти впечатляет (хотя, собственно, всего на 10 МГц выше номинальной для 3.5 ns памяти частоты), то повышение частоты работы GPU всего на 20 МГц выше номинала явно очень скромное достижение. Как и ожидалось, Ti500 это что-то вроде отобранных GeForce3, хотя, думаю, на серийно выпускаемых картах чипы будут более разгоняемыми.

Подчеркну два важных момента:

- при разгоне обязательным условием является наличие дополнительного охлаждения, в частности, обдувающего карту (прежде всего ее память) вентилятора;

- разгон любой карты зависит от конкретного экземпляра, и поэтому нельзя обобщать вышеприведенные возможности повышения частот на все видеокарты этой марки и даже серии. Показатели разгона мы приводим только как интересное явление; они ни в коей мере не входят в состав обязательных характеристик видеокарты.

Установка и драйверы

Рассмотрим конфигурацию тестовых стендов, на которых проводились испытания карт:

- Компьютер на базе Athlon:

- процессор AMD Athlon 1200 MHz (133*9);

- системная плата Chaintech 7KJD (AMD760);

- оперативная память 512 MB DDR SDRAM PC2100;

- жесткий диск IBM DTLA 45GB;

- операционная система Windows 98 SE.

- Компьютер на базе Pentium 4:

- процессор Intel Pentium 4 1500 MHz;

- системная плата ASUS P4T (i850);

- оперативная память 512 MB RDRAM PC800;

- жесткий диск Quantum FB AS 20GB;

- операционная система Windows 98 SE.

На стенде использовались мониторы ViewSonic P810 (21"), NOKIA 447Xav (17") и ViewSonic P817 (21").

При тестировании использовались драйверы от NVIDIA версии 21.85. VSync отключен, технология S3TC активизирована.

Для сравнительного анализа были использованы результаты тестирования видеокарт:

- ATI Radeon 7500 DDR (64MB, 290/230 (460) MHz, использовались драйверы от ATI версии 7.184);

- Leadtek WinFast GeForce2 Ultra (250/230 (460) MHz, 64MB);

- Hercules 3D Prophet II Pro (GeForce2 Pro, 200/200 (400) MHz, 64MB).

Результаты тестов

О качестве изображения (2D-графика) я могу сказать примерно то же самое, что говорил уже в массе обзоров по GeForce3-картам: нареканий нет. В разрешении 1600х1200 при 85Гц можно комфортно работать при наличии высококачественного монитора, который штатно поддерживает такой режим. Я лично не заметил каких-либо изменений в этом плане, возможно вызванных тем, что дизайн PCB был изменен.

Приступаем к оценке производительности видеокарты в 3D. В качестве инструментария мы использовали несколько уже ставших традиционными тестов:

- id Software Quake3 v.1.17 игровой тест, демонстрирующий работу платы в OpenGL с использованием стандартного демо-бенчмарка demo002;

- MadOnion 3DMark2001 Pro синтетический тест, демонстрирующий работу платы в DirectX 8.0

Quake3 Arena

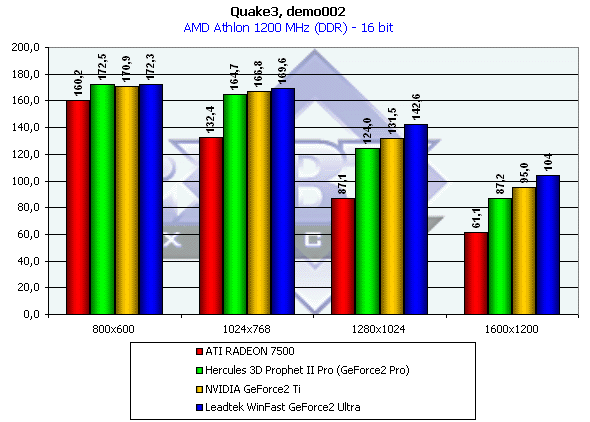

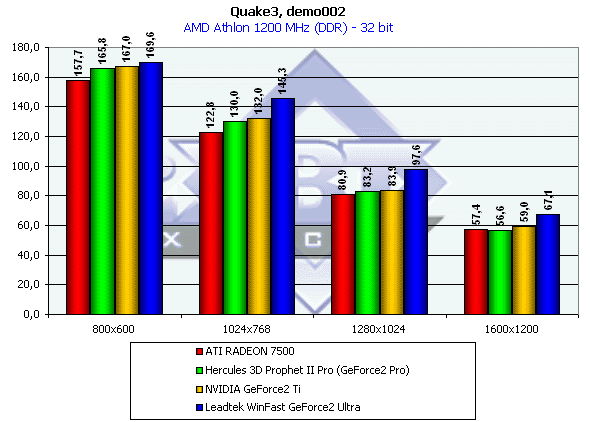

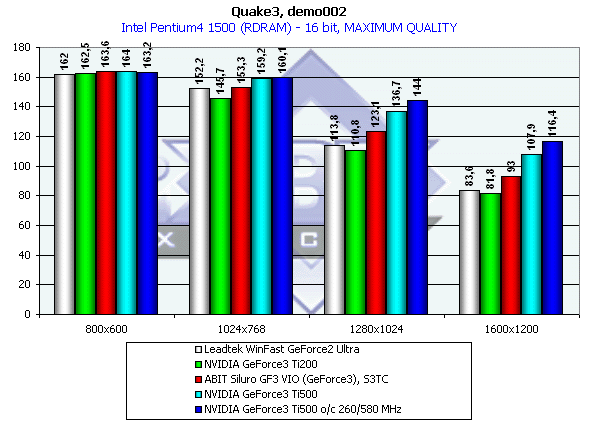

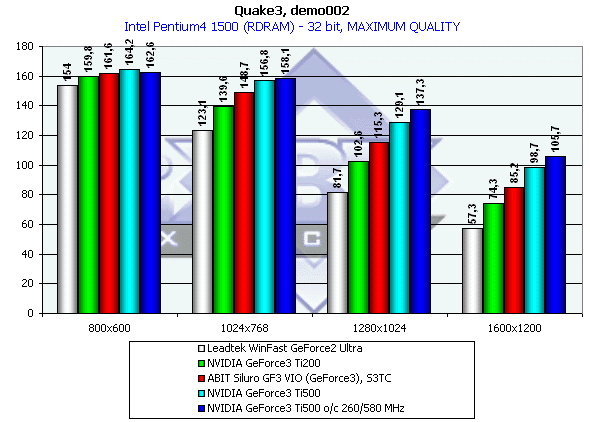

demo002, стандартные режимы

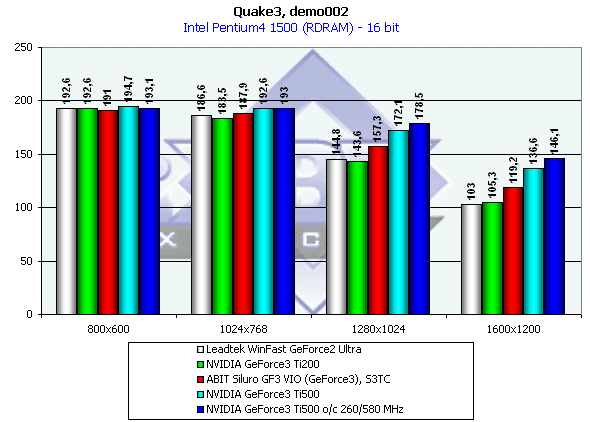

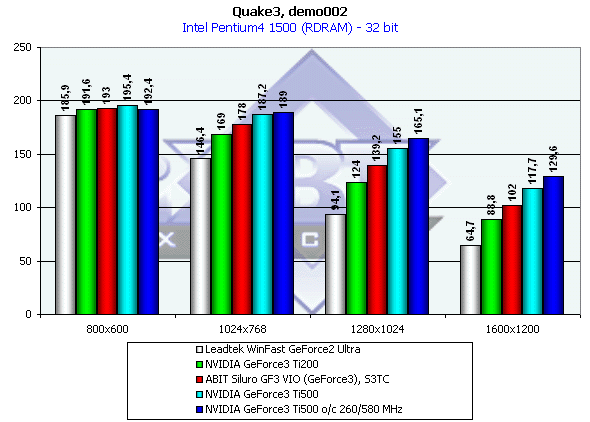

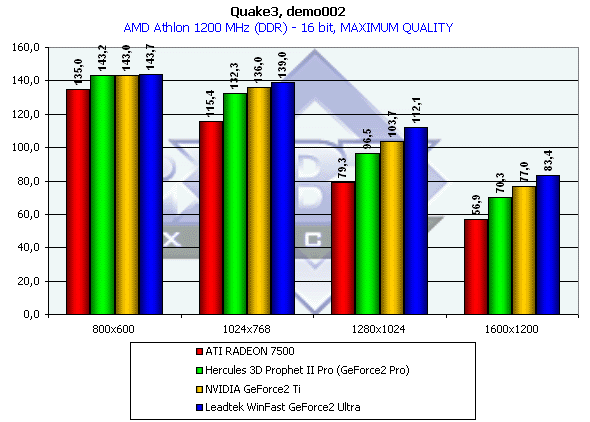

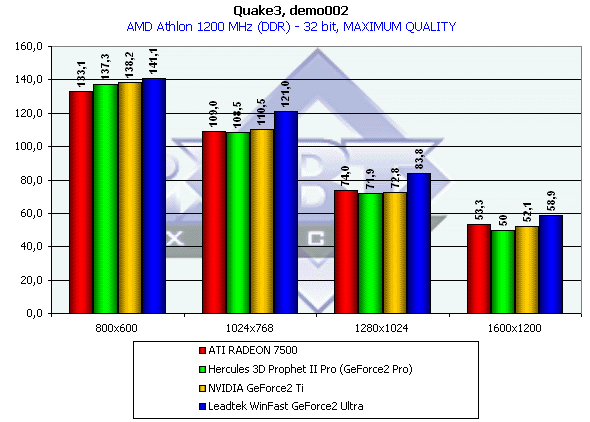

Тестирование на примере demo002 проводилось в режимах Fast (демонстрирует работу карты в 16-битном цвете) и High Quality (демонстрирует работу карты в 32-битном цвете).

Повторю, что работа GeForce2 Ti эмулировалась при помощи видеокарты Leadtek WinFast GeForce2 Ultra путем установки частот работы 250/200 (400) МГц. Работа GeForce3 Ti200 эмулировалась при помощи NVIDIA GeForce3 Ti500 путем установки частот работы 175/200 (400) МГц.

Поскольку видеокарты GeForce2 Ti и GeForce3 Ti относятся к разным категориям (рыночным нишам), я разделил диаграммы по анализу производительности на два соответствующих блока.

NVIDIA GeForce2 Ti

Как и следовало ожидать, "новая" карта на базе GeForce2 Ti от "старой" GeForce2 Pro мало чем отличается.

NVIDIA GeForce3 Ti200/500

Хорошо видно, что Ti200 занял промежуточную позицию между GeForce2 Ultra и GeForce3 (в 16-битном цвете разницы между ним и GeForce2 Ultra практически нет). В 32-битном цвете все, как положено согласно частотным рамкам. Да и странно было бы ожидать чего-то иного от тех же GeForce3, работающих лишь на разных частотах.

demo002, режимы максимальных качества и нагрузки

Тестирование на примере demo002 проводилось при условии максимальной детализации геометрии и текстур, при этом настройки были еще "утяжелены" повышенной сложностью объектов, содержащих "кривые" (r_subdivisions "1" r_lodCurveError "30000").

NVIDIA GeForce2 Ti

Мы видим, что за счет более высокой частоты ядра GeForce2 Ti немного выиграл у предшественника в 16-битном цвете, но в 32-битном его "поставила" на свое место пропускная способность памяти.

NVIDIA GeForce3 Ti200/500

Столь значительное снижение частоты работы чипа у Ti200 не могло не сказаться в легком для GeForce2 Ultra режиме работы 16-битном цвете, где первый отстал от последнего. А вот 32-битный цвет все расставил по своим местам.

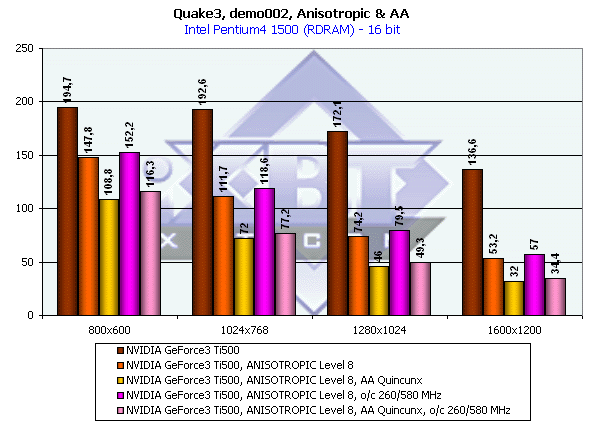

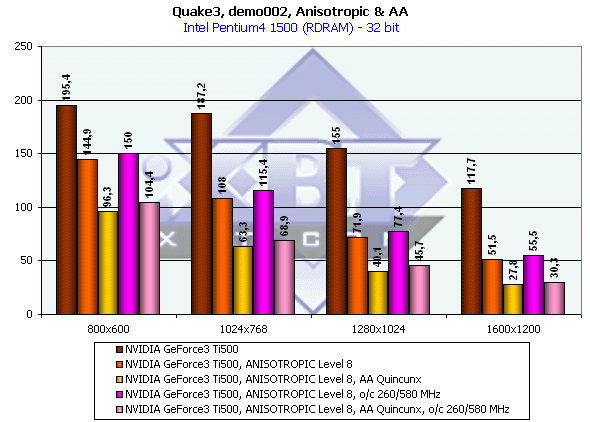

demo002, тестирование анти-алиасинга и анизотропной фильтрации

Информированные читатели знают, что GeForce3 обладает двумя важными функциями в 3D: анти-алиасингом и анизотропной фильтрацией. Тех, кто впервые читает материал по карте на GeForce3, я приглашаю прочитать наши обзоры, посвященные этому продукту NVIDIA (список приведен выше). В нескольких статьях я уже приводил данные о том, что самым оптимальным режимом анти-алиасинга для GeForce3 является Quincunx, а самое лучшее качество графики мы получаем при активизации анизотропной фильтрации Level 8, которая использует до 32-х текстурных сэмплов. Само собой разумеется, падение производительности при этом весьма велико. В свое время при разгоне GeForce3 я упоминал, что даже разрешение 1024х768 становится малоиграбельным при одновременном использовании анти-алиасинга Quincunx и анизотропии Level 8. Посмотрим, насколько сможет поднять играбельность Ti500:

Хорошо видно, что падение производительности весьма велико, и даже разгон Ti500 (не говоря уж о его работе на штатных частотах) едва спасает играбельность в высоких разрешениях. Однако если учесть, что существует много игр, где не требуется сто и более FPS, то в разрешении 1024х768 в 32-битном цвете можно прекрасно играть при АА и анизотропии самой высокой пробы. Я не стану приводить скриншоты, поскольку качество анизотропии у GeForce3 можно увидеть в разделе 3DGiТогов, посвященном этой теме.

3DMark2001

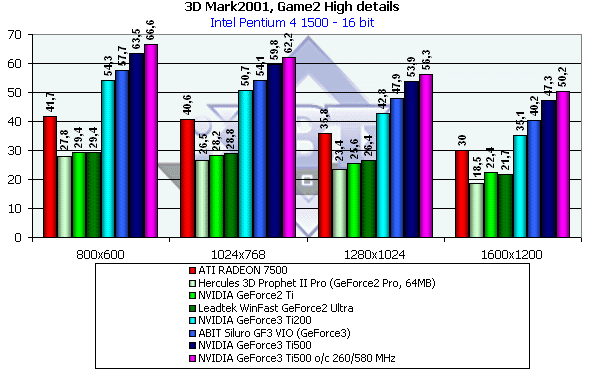

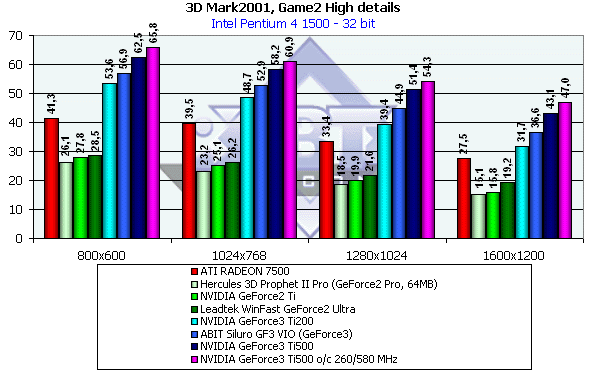

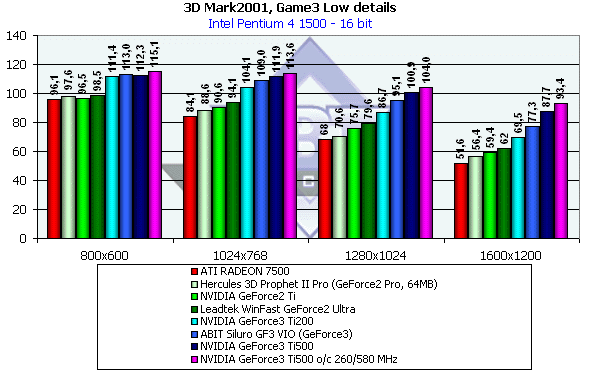

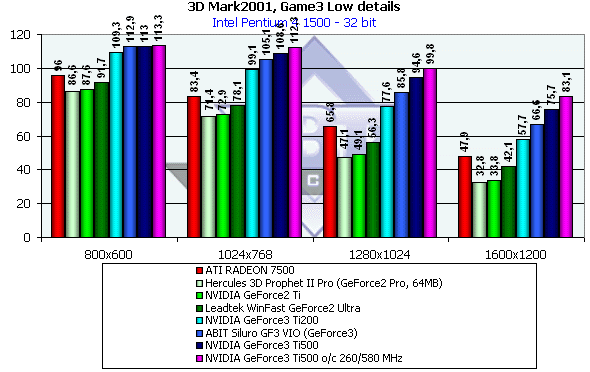

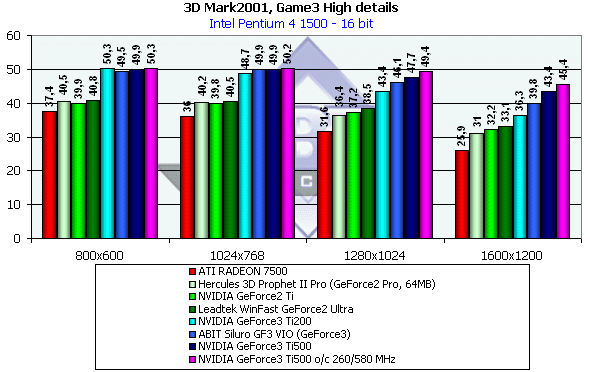

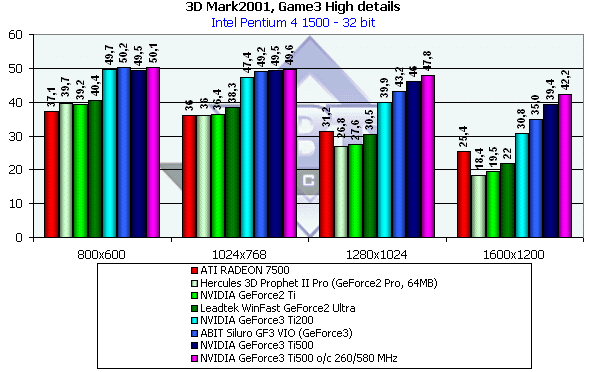

Учитывая, что этот тест состоит из нескольких подчиненных, и диаграмм получается весьма много, я не стал разделять GeForce2 Ti и GeForce3 Ti200/500 на разные диаграммы. Думаю, что по цвету столбиков читатели легко поймут, кого с кем надо сравнивать. Да и разница в производительности подчас может подсказать :-).

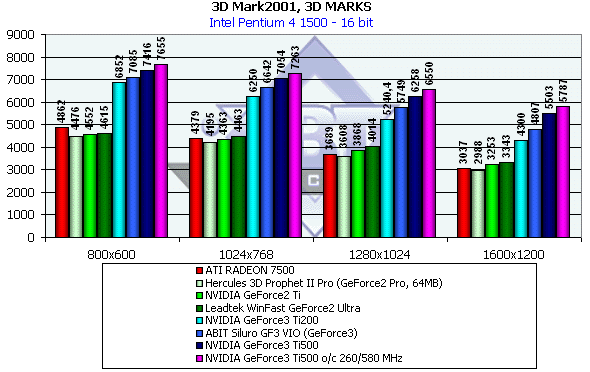

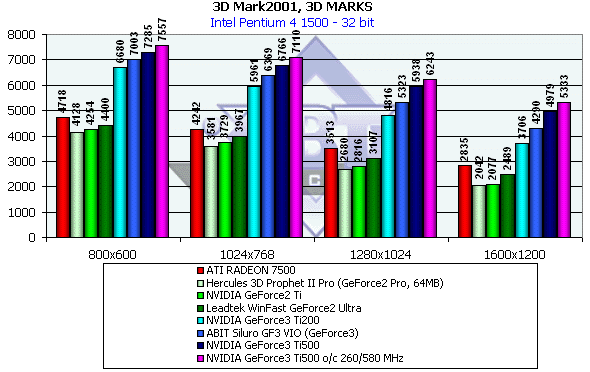

3D Marks

Общие результаты по 3DMark2001 нам демонстрируют промежуточное положение GeForce2 Ti между GeForce2 Pro и GeForce2 Ultra и явное превосходство над всеми ними новинки от ATI Radeon 7500.

В стане GeForce3 все, как положено согласно таблице рангов. Четкие ступеньки прироста производительности при перемещении от GeForce3 Ti200 к Ti500.

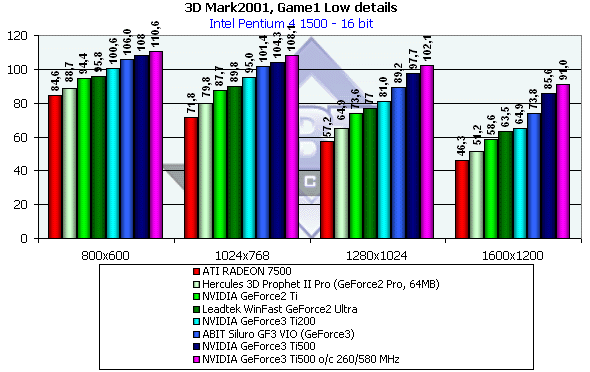

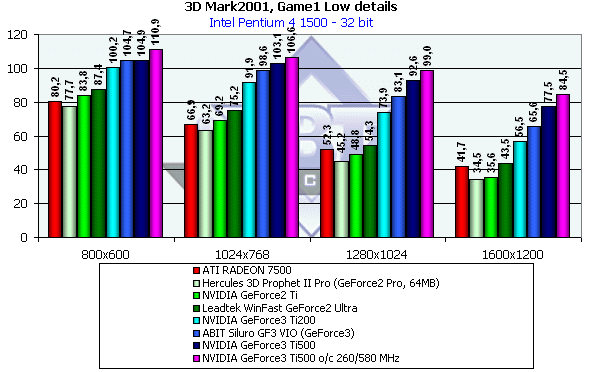

Game1, Low details

Я сразу приношу извинения читающим эти строки и прочитавшим предыдущий материал по Radeon 7500 за то, что описания сцен из 3DMark2001 я возьму из той статьи, т.к. по сути говорить об одном и том же по-новому нет смысла.

Game1 представляет собой сцену из автогонок с возможностью "пострелять". Здесь много всего: и эффектов, и детализированных объектов. Что же касается результатов, то в 16-битном цвете видим прямо-таки ровную лесенку (ну словно из списка номенклатурных должностей! :-), а вот 32-битный цвет принес GeForce2 Ti поражение от ATI Radeon 7500. Про GeForce3 Ti200/500 даже говорить нечего там все, как положено.

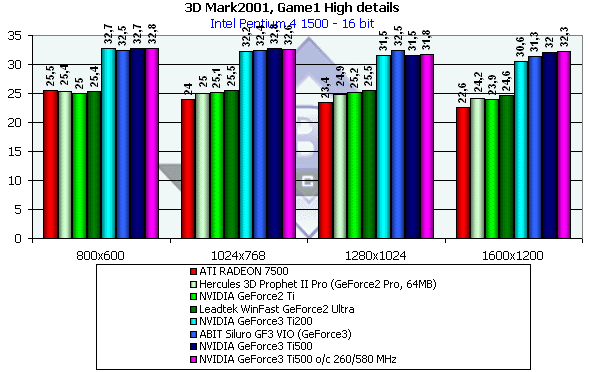

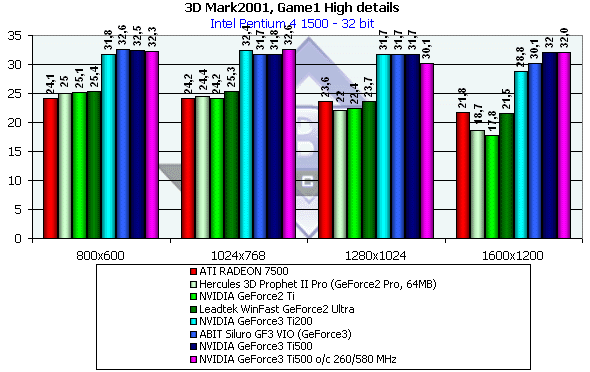

Game1, High details

Как я уже говорил в обзоре Radeon 7500, резкое усложнение той же сцены сделало ее уже скорее процессорным тестом, малопригодным для исследования 3D-ускорителей. В 16-битном цвете почти все оказались на равных внутри своих "кланов", а в 32-битном картина с выигрышем Radeon 7500 у GeForce2 Ti повторилась.

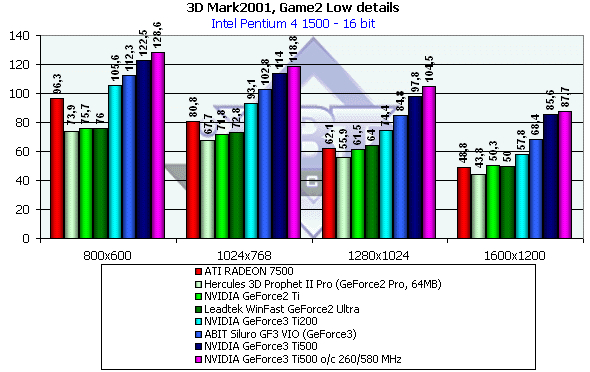

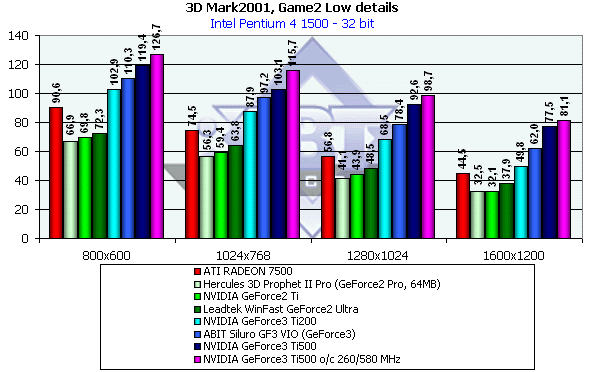

Game2, Low details

Мы видим, что Radeon 7500 в данном случае не только победил в своем классе, но и в 32-битном цвете уже вплотную подобрался к GeForce3 Ti200. Разумеется, тут сказывается то, что эта игровая сцена имеет очень высокий коэффициент перекрытий (overdraw), и традиционные ускорители, не имеющие оптимизации работы с Z-буфером, сильно просаживаются, так как "вырисовывают" кучу невидимых глазу поверхностей, то есть выполняют лишнюю работу. GeForce3 имеет возможность осуществлять подобные оптимизации, поэтому и производительность намного выше.

Game2, High details

Комментарии излишни, видим аналогичную картину.

Game3, Low details

Эта сцена из "академической" уже стрелялки демонстрирует нам ожидаемое соотношение производительностей в "клане" GeForce2 в 16-битном цвете и превосходство ATI Radeon 7500 в 32-битном. В стане GeForce3 "тишь да гладь, да божья благодать".

Game3, High details

Комментарии излишни, соревнования в весовой категории GeForce2 Pro дали нам понять, что в 32-битном цвете король Radeon 7500, а вот в 16-битном А может, ну его вообще, этот 16-битный? Играть в современные игры и смотреть на "сеточку" дизеринга уже неэстетично просто.

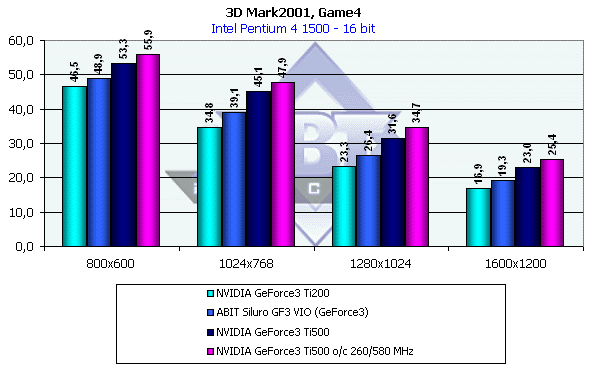

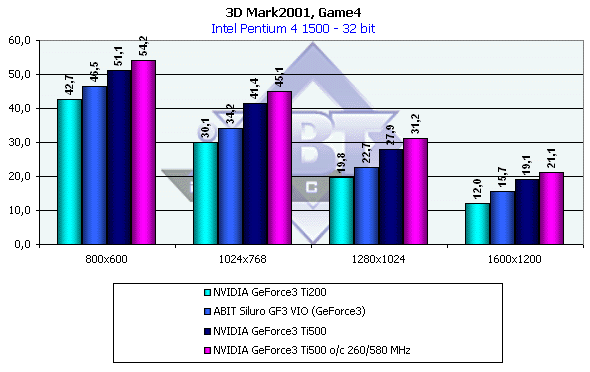

Game4

Вот, вот и оно! Да, самое красивое! Ради которого некоторые втайне от знакомых и покупают GeForce3. Чтобы смотреть на эту сцену! И показывать друзьям, гордо глядя на их вытянутые лица. Да, наверно для того, чтобы побольше народу смогло осуществить свою мечту и увидеть "озеро с речкой" на Nature, компания NVIDIA и выпускает более дешевый GeForce3 Ti :-).

Конечно же, это шутки, однако мы видим, что несмотря на свою "опущенность" по частотам, GeForce3 Ti200 очень неплохо справляется с этой сценой благодаря новому драйверу Detonator XP.

Выводы

Мы с вами рассмотрели новую серию графических процессоров Titanium от NVIDIA, куда входят три карты: GeForce2 Ti, GeForce3 Ti200, GeForce3 Ti500.

В отношении GeForce2 Ti все достаточно ясно. Применив уже знакомую нам по GeForce2 Ultra модификацию чипа, NVIDIA удалось поднять частоту процессора до 250 МГц. Однако позиционирование этой карты одевает на нее узы пропускной способности памяти в 200 (400) МГц, и дальнейшее поднятие частоты работы чипа выше 250 МГц просто нерационально. Лозунг NVIDIA "GeForce2 Ti производительность GeForce2 Ultra за деньги GeForce2 Pro", мягко говоря, преувеличен, поскольку в 32-битном цвете скоростью "ультры" и не пахнет, однако позиционирование этой карты на замещение прежней GeForce2 Pro говорит о том, что стоимость таких карт будет не только не выше, но даже ниже цен ныне продаваемых карт на базе GeForce2 Pro.

Линейка GeForce3 Ti200/500 призвана убить двух зайцев: приблизить к пользователю мощнейший акселератор с возможностями DirectX 8.0 (Ti200) и выставить на рынке достойного конкурента ATI Radeon 8500 (Ti500). Да и NVIDIA снова сможет хвалиться самым мощным в мире игровым 3D-акселератором для PC. Будет ли таковым GeForce3 Ti500 покажет время (мы пока ничего не знаем о производительности ATI Radeon 8500).

Покупать ли новые акселераторы? Думаю, что популярность у Ti200 будет велика. А вот Ti500 вряд ли будет востребован сразу. Разумеется, ныне существующий GeForce3 уйдет в прошлое, он будет заменен на линейку Ti, поэтому потом выбора уже не будет. Однако к тому моменту, возможно, NVIDIA представит нечто уже принципиально новое. Поэтому владельцам GeForce3-карт я советую подождать выхода NV25, а у кого еще нет такого мощного акселератора тем можно посоветовать обратить внимание на Ti200, либо подождать недели 23 до выхода на рынок Radeon 8500 и прояснения ситуации с ценами. Сейчас очень трудно что-то рекомендовать, так как никто не может назвать тех цен, по которым все представленные ныне карты будут продаваться.

Плюсы:

- Замена более старого GeForce2 Pro на новый GeForce2 Ti даст шанс получить "ультру" при разгоне памяти за относительно небольшие деньги;

- Выпуск относительно дешевого GeForce3 Ti200 позволит купить полноценный, по сути, GeForce3 желающим потратить до $200 на мощную видеокарту;

- Скорая замена GeForce3 на Ti500 приведет к снижению цен на последний, и можно будет купить за те же деньги более сильный в плане производительности акселератор;

- Наличие всех достоинств GeForce3 у линейки Ti200/Ti500.

Минусы:

- Не обнаружено.

Учитывая, что перед самым выходом материала появились сведения о розничных ценах, которые максимально могут составлять $349 для GeForce3 Ti500, $199 (!!!) для GeForce3 Ti200 и $149 для GeForce2 Ti, мы можем сказать, что они являются вполне привлекательными по возможностям и производительности картами. Конечно, мы привели цены на момент выпуска вышеуказанных карт; думаю, что в ближайшее время и эти цифры уменьшатся. Ждем выхода ATI Radeon 8500, а также появления в реальной продаже ATI Radeon 7500, стоимость которых может стать некой точкой отсчета в новой войне цен.

А нашим читателям мы советуем ожидать наших обзоров новой линейки уже серийно выпускаемых карт Titanium.