Весна идет по северному полушарию Земли все уверенней с каждым днем. Уже пришли теплые дни (по крайней мере, в Москве уже было +25 градусов), огнедышащие Athlon-ы с тоской ждут прихода жаркой погоды, выматывая из кулеров последние силы… Новенькие акселераторы, разогнанные до почернения (не зря SUMA, а теперь и ASUSTeK стали выпускать черного цвета видеокарты, чтобы не было видно напряжения этих тружеников трехмерной графики), выплескивают в тесное пространство корпусов дополнительное тепло… UPS-ы стонут, проклиная эти куски кремния, а заодно и хозяев, которым непременно надо получить в любимом Quake3 или Unreal Tournament лишние 5–10 fps.

Но как опускается на Землю ночь, с такой же неизбежностью придет лето с жарой, и 0.25 микронные чипы вскипят, послав операционную систему куда подальше. Хотя, ровно год назад у NVIDIA на свет родились 0.18 микронные детки, ныне стоящие в весьма распространенных картах на GeForce2 GTS и MX, и уж куда менее напрягающие по питанию как источники последнего, так и регуляторы на системных платах.

Как, уже год пролетел? Да-да, 28 апреля 2000 года явился миру тот самый GigaTexel Shader, который потом плюнул на свое название, а заодно и на DirectX 8.0. А как же куча эффектов, прежде всего по рельефному текстурированию, обещанная через эти самые шейдеры? Извольте познакомиться с наследником GeForce2 GTS, внуком GeForce256, ныне любимым детищем NVIDIA — GeForce3.

Вообще-то, этот процессор появился тогда, когда мы все еще в шубах ходили, однако из роддома он вышел только вот-вот. Всякого рода послеродовые операции, знаете ли, доводки, наладки, выпрямление костей и мозгов создателям… Но зато теперь во всей красе 0.15 микронный ребенок перед нами!

Да, так получилось, что год назад вышел в свет вовсе не революционный GPU, а простой потомок GeForce256, имеющий в силу более совершенной технологии повышенную частоту, а также по 2 текстурных модуля на каждом из четырех конвейеров рендеринга. Собственно, это и все. Блок Hardware TCL у GeForce2 GTS был также разогнанным вариантом предыдущего геометрического сопроцессора у GeForce256. Разумеется, были и еще улучшения (в частности по части 2D-графики), но все же революционно-нового не было ничего. Даже поддержки EMBM не получилось.

Безусловно, в 0.18 мкм чип не запихнуть и высокие скоростные возможности, и существенные изменения в качественной поддержке многих современных и перспективных функций 3D-графики. Тем более, что год назад выход GeForce GTS нам продемонстрировал малоприятное явление сильнейшего упирания производительности в пропускную способность видеопамяти. Все мы были свидетелями того, что видеокарты, имеющие цену в 1.5 раза выше, чем предыдущее поколение (GeForce256 DDR), укомплектовывались той же 166-мегагерцовой DDR-памятью, которая урезала потенциал GeForce2 GTS чуть ли не наполовину. И снова пострадал 32-битный цвет…

Разумеется, раз вышел такой "ляпсус" с поддержкой DirectX 8.0, и стало очевидно, что полноценная поддержка шейдеров появится только в следующем чипсете (выпуском простой ревизии старого процессора тут не обойтись), то встал вопрос и о достаточно серьезной переработке технологии, ведь протоптанные дорожки по наращиванию конвейеров и частот уже не дают своего эффекта из-за все более возрастающей требовательности к скорости работы памяти, которая вовсе не бесконечно может ускоряться. Рецептов достаточно много в этом направлении, в той или иной степени связанных с тайловой архитектурой, либо иерархическим Z-буфером. Мы уже рассказывали об этих технологиях, поэтому не стану останавливаться на них.

Все эти новшества позволяют сильно экономить пропускную способность памяти, не загружая ее в принципе излишними вычислениями. Ну, например, взять хотя такие издержки традиционной архитектуры, как вырисование всех поверхностей в трехмерной сцене, даже если львиную долю из них не будет видно наблюдателю. Отсечение таковых поверхностей даст весомый вклад в прирост производительности графического процессора.

Вернемся к GeForce3. Как я уже отметил, ровно через год после выхода в свет GeForce2 GTS, видеокарты на базе его потомка — NVIDIA GeForce3 — начинают постепенно появляться на рынке. Новая политика NVIDIA по формированию когорты видеочипсетов и карт на них с обязательным флагманством High-End — решения предусматривала роль флагмана на сегодня как раз для GeForce3, установив еще в конце зимы на видеокарты с этим GPU просто запредельные цены. Я понимаю, что это High-End, что он предназначен не для всех пользователей, а только для крутых, однако надо понимать и оценивать грустные мины производителей видеокарт на GeForce3, которым надо эти платы как-то продавать, и продавать в немалых объемах, иначе производство будет невыгодным. Кое-какие фирмы потому и отказались от выпуска таких "сладких", на первый взгляд, карт (все новое - сладкое). Пользователи тяжело вздыхали, вспоминая минувшие времена, когда новый акселератор не превышал по цене $250. Однако у NVIDIA есть возможность диктовать свои условия, так как иных, производителей видеопроцессоров, выпускающих на рынок чипы, пользующиеся массовым спросом, собственно, и нет. Matrox сам выпускает карты на своих чипсетах, ATI — то же самое. Куда деваться многим и многим фирмам, уже многие годы выпускающие видеокарты? Конечно, к NVIDIA.

Однако, у нашего "Тома" (NVIDIA) появился и свой "Джерри" (STMicroelectronics), который, пробегая мимо первого, ловко дал "Тому" подзатыльник, заодно отняв и одну из любимых игрушек (Hercules/Guillemot). Я думаю, что эту аллегорию все поняли. Да, действительно выпуск KYRO II со стороны STM и Imagination Technologies, дал некоторый всплеск уже почти умирающей конкуренции. И это не могло не остаться без последствий.

Этот факт, а также задержка по выходу в свет GeForce3, и стали причиной снижения цен на еще не вышедшие в свет видеокарты на GeForce3. Если зимой говорили о $550-600 за такую плату, то теперь верхний потолок обрисовался в $399. А это значит, что реальные цены будут $360-380, что почти равно стоимости год назад вышедшим платам на базе GeForce2 GTS с 32-мя мегабайтами памяти. Это уже радует, потому как на те GeForce2 Ultra — карты цены были куда выше, чем сейчас просят за GeForce3.

Вот мы все ближе подходим к рассмотрению непосредственно видеокарты на этом сильнейшем GPU. Я подчеркну, что именно видеокарты, а не самого GeForce3. Сам процессор и его особенности мы уже описывали на примере опытных образцов, и в цикле наших статей, рассматривающих GeForce3 с разных сторон, можно с ними подробно ознакомиться:

- Обзор GPU NVIDIA GeForce3 и карт на его базе

- Исследование оптимизации NVIDIA GeForce3 под Intel Pentium4 и AMD Athlon

- MadOnion 3DMark2001 и NVIDIA GeForce3 — любовь с первого взгляда

- Исследование NVIDIA GeForce3 с помощью Vulpine GLMark

Поэтому я в этом материале опускаю все теоретические выкладки, а также подробные исследования особенностей архитектуры GeForce3, а заострю внимание на конкретной серийно уже выпускаемой карте от ASUSTeK — ASUS AGP-V8200 Deluxe.

Конечно же, на некоторых важных моментах я еще раз остановлюсь, несмотря на то, что в вышеуказанных материалах это уже освещалось, однако напомнить не помешает.

Плата

Карта ASUS AGP-V8200 Deluxe имеет AGP x2/x4 интерфейс, 64 Мб DDR SDRAM памяти, размещенной в 8-ми микросхемах на лицевой стороне PCB.

Микросхемы памяти марки EliteMT, время выборки — 3.8 ns, что соответствует примерно 260 (520) МГц. Память работает на частоте в 230 (460) МГц. Эта частота нам уже известна по видеокартам на GeForce2 Ultra, однако тогда использовались микросхемы со временем выборки 4 ns. Даже установка чуть более быстрой памяти не сняла с разработчиков страха перед перегревом, и перестраховка налицо. Впрочем, это оправдано, так как модули памяти действительно сильно греются.

Я уже отмечал, что ныне самая быстрая память (среди серийно выпускаемых) принадлежит фирме Elite Semiconductor. Ниже, при описании разгона, мы вернемся к этой теме.

Как можно видеть, дизайн карты полностью разработан инженерами ASUSTeK и поэтому оригинальный. Впрочем, это касается всех видеокарт с суффиксом Deluxe от этого производителя.

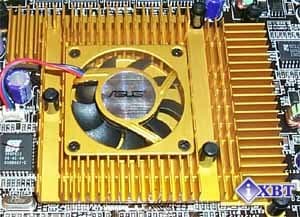

Прежде всего бросается в глаза массивная система охлаждения золотистого цвета. На этой карте ASUSTeK применил совершенно новую и необычную конструкцию, состоящую из центрального радиатора с вентилятором и примыкающих к нему боковых реберных радиаторов.

В новом дизайне (это относится ко всем картам на GeForce3, не только к Deluxe) модули памяти расположены ближе к графическому процессору, поэтому увеличение радиатора на чипсете дало возможность как бы срастить его с радиаторами, охлаждающими микросхемы памяти (их мы видим на фотографии выше справа).

Однако, на первый взгляд, целостная конструкция на деле оказывается вовсе не такой. Центральный и боковые радиаторы друг с другом не соприкасаются (это видно на фотографии справа, стрелкой отмечена щель между радиаторами), поэтому вентилятор охлаждает только центральный радиатор. Если посмотреть на фотографию выше справа, то можно увидеть, что ради такого стильного дизайна верхний радиатор потерял значительную часть ребер, и поэтому не столь эффективен, как, например, элемент, охлаждающий вертикальный ряд микросхем и расположенный справа.

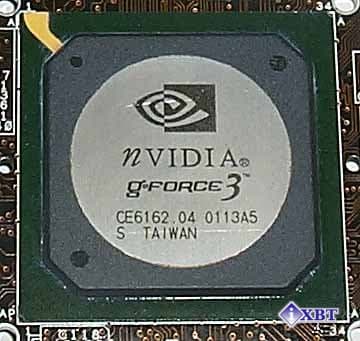

Еще на фотографии выше можно было заметить, что на данной карте установлен GPU, имеющий маркировку GeForce3, а не NV20, как мы могли видеть на опытных образцах. По маркировке можно увидеть, что степпинг данного процессора — А05 (что и следовало ожидать), и выпущен он на 13-й неделе 2001 года (в конце марта). Несмотря на то, что этот чипсет выполнен по 0.15 мкм техпроцессу, он очень сложный и содержит более 50 млн. транзисторов, поэтому нагрев его хоть и не столь велик, но существенен. Как мы видим, поэтому он имеет металлическую крышку на пластиковом корпусе, что позволяет улучшить охлаждение чипа.

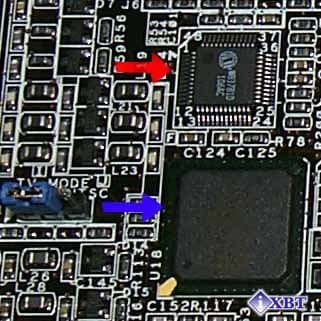

Если обратить внимание на левую сторону PCB, то внизу можно увидеть микросхему термоконтроля (отмечена красной стрелкой), а также модуль Philips 7100, отвечающий за VIVO (Video Input, Video Output) — он отмечен синей стрелкой (к сожалению, маркировка на нем настолько нечеткая, что подбор разного ракурса и освещения для ее демонстрации не помог).

Впервые ASUSTeK стал применять для видеокарт класса Deluxe (или TVR) один процессор, отвечающий для преобразование видеосигнала из цифрового в аналоговый и обратно. Ранее устанавливались разные чипы для TV-out и для TV-in. Забегая вперед, скажу, что пока обрадовать любителей "оцифровки" описанием работы этих функций не смогу, так как поставляемое с видеокартой программное обеспечение пока в бета-стадии и сильно глючит, а прежние утилиты не знакомы с преобразователем от Philips.

На этой же фотографии можно увидеть джампер, отвечающий за выбор формата сигнала TV-out (NTSC/PAL). Впрочем, выбор можно осуществить и через настройки в драйверах.

Далее можно заметить, что эта карта оснащена поддержкой технологии мониторинга состояния SmartDoctor (я уже упоминал о наличии микросхемы термоконтроля, а у кулера имеется тахометр). Мы уже рассказывали об этой технологии, можно почитать об этом наших обзорах видеокарт от ASUSTeK, например, ASUS AGP-V6800. Я лишь добавлю, что SmartDoctor интересен лишь как информатор о текущем состоянии карты с точки зрения температуры, вольтажа и частоты вращения кулера. Постоянно его использовать я не советую, поскольку программная часть будет пытаться постоянно снижать частоты, что может негативно сказываться на 2D-графике.

В заключение рассмотрения особенностей самой видеокарты обратим внимание на цвет PCB. В обзоре ASUS AGP-V7100 Pro я уже упоминал о необычности для фирмы ASUSTeK темного окраса PCB. Хочу заметить, что ASUS AGP-V8200 Deluxe цвет не черный, а темно-коричневый, похожий на цвет кофейного напитка. Видимо, ASUSTeK и впредь будет продолжать экспериментировать с цветовыми решениями своих видеокарт, и мы увидим, может быть, когда-нибудь белую видеокарту :-).

Карта поставляется в Retail-упаковке традиционно большого размера для Deluxe-серий. Поставка включает в себя:

- руководство пользователя;

- диск с драйверами и утилитами;

- ASUS DVD 2000 — программный DVD-плеер;

- Ulead Video Studio v.4.0 SE;

- CyberLink VideoLive Mail 4;

- 3Deep v.3.2;

- удлинители S-Video и RCA;

- переходник для Video In: S-Video-to-RCA;

- стерео-очки.

В качестве небольшого отвлечения интересно заметить, как перечислены языки, на которые переведено руководство пользователя. Если везде можно видеть просто English и т.п., то русский язык представлен "По-русски" (а не Russian или Русский) :-).

Как видно из комплекта поставки, в нее входят уже ставшие традиционными для Deluxe-серий стерео-очки. В драйверах от ASUSTeK имеются закладки для активизации стерео-режима и настройки его под глаза. Я должен напомнить, что использование подобного рода очков требует наличие достаточно мощного монитора, поддерживающего частоту смены кадров не менее 140 Гц в разрешениях 800х600 и выше. А еще лучше, чтобы поддерживал 150 Гц, так как на монитор будет выводиться изображение с удвоенной частотой (чередование картинки для левого и правого глаза с частотами 70-75 Гц). Все должны понимать, что комфортным стерео-режим может быть только при частоте для каждого глаза не менее 70 Гц, а это значит, что монитор должен уметь поддерживать частоту в 2 раза больше. Остальные настройки — индивидуальны, и единых рекомендаций нет. В состав настроек входят так называемые пресеты (предустановки) для популярных игр.

И напоследок следует отметить, что TV-out имеет два гнезда (S-Video и RCA), поэтому никакие переходники не нужны для владельцев видеотехники, не имеющей S-Video.

Разгон

ASUS AGP-V8200 Deluxe разогналась до значений 240/270 (540) МГц. Это является абсолютным рекордом среди исследуемых нами ранее видеокарт на GeForce3! Разумеется, сыграли роль факторы установки на карту чипа более новой ревизии, а также использование радиаторов на памяти. Даже на видеокартах класса GeForce2 Ultra я не припомню, чтобы память смогла на 540 МГц работать (экстремальное охлаждение я не считаю, конечно :-). Вопросы разгона мы рассмотрим отдельно в разделе производительности.

Установка и драйверы

Рассмотрим конфигурацию тестовых стендов, на которых проводились испытания карты ASUS AGP-V8200 Deluxe:

- Компьютер на базе Pentium III:

- процессор Intel Pentium III 1000 MHz:

- системная плата ASUS CUSL2-C Black Pearl (i815EP);

- оперативная память 256 MB PC133;

- жесткий диск IBM DPTA 20GB;

- операционная система Windows 98 SE;

- Компьютер на базе Athlon:

- процессор AMD Athlon 1200 (133MHz x 9):

- системная плата Soltek 75KAV-X (VIA KT133A);

- оперативная память 256 MB PC133;

- жесткий диск Fujitsu 10GB;

- операционная система Windows 98 SE;

На стенде использовались мониторы ViewSonic P810 (21") и ViewSonic P817 (21").

При тестировании использовались драйверы от NVIDIA версии 12.00, VSync отключен.

Для сравнительного анализа были использованы показания с видеокарт:

- SIGMA Cyber5500 (GeForce2 MX),

- SIGMA Cyber6000 (GeForce2 GTS),

- Hercules 3D Prophet II Pro (GeForce2 Pro),

- Leadtek WinFast GeForce2 Ultra,

- ATI RADEON 64MB DDR (183MHz).

В качестве опытной платы на NVIDIA GeForce3 использовалась Leadtek WinFast GeForce3 (ревизия A03).

Надо сказать, что поставляемые с картой драйверы от ASUSTeK версии 12.00-бета (на базе такой же версии драйверов от NVIDIA) весьма сырые, и часто при вхождении в настройки зависают, поэтому они не использовались. Хотя настройки стерео-режима работают отлично.

В качестве обновления о дополнения статьи отмечу, что когда эти видеокарты появились в массовой продаже, то с ними уже поставлялись драйверы версии 12.10, в которых указанные недостатки были исправлены, и само ПО уже устойчиво работает.

Хочу отметить, что существует уже много программ-твикеров для более тонкой настройки драйверов от NVIDIA. Мне наиболее из всех нравится Riva Tuner (автор Алексей Николайчук). Последняя версия этой утилиты уже адаптирована под Детонатор последнего выпуска — 12.00.

C помощью Riva Tuner можно корректно включать анизотропную фильтрацию не только в OpenGL (где настройки в драйверах позволяют это сделать), но и в Direct3D (а не копаться в Registry в поисках нужных ключей). Мы уже писали ранее о возможности включения у GeForce3 трех степеней анизотропии: при выборке 8-ми, 16-ти и 32-х текстурных сэмплов. Последняя степень — самая красивая по эффекту, но одновременно и очень прожорливая в плане падения производительности. Об этом можно почитать в нашем обзоре по GeForce3.

Riva Tuner дает возможность включить анти-алиасинг (эффект сглаживания неровных краев объектов) не только по документированному NVIDIA списку степеней, но и убранную из настроек в драйверах высшую степень MSAA — 2x2tap9, которая использует выборку не из 4-х субпикселей (2х2), а из 9-ти (3х3) (как бы залезая по маске в соседние квадраты выборки), но при этом разрешение для рендеринга увеличивается не в 9 раз, а в 4. Что позволяет получить более высокое качество анти-алиасинга, чем при простой степени 2х2. Посмотрите, что дает в этом плане панель настроек NVIDIA — драйверов:

Возвращаясь к Riva Tuner, отмечу, что эта программа дает возможность корректно разгонять видеокарты, не требуя при первом разгоне перезагрузки компьютера:

Результаты тестов

Несмотря на то, что видеокартам на GeForce3 предсказывали мрачную картину с точки зрения 2D-графики, я отмечу, что ASUS AGP-V8200 Deluxe продемонстрировала прекрасный уровень качества в 2D. И это притом, что видеокарта перегружена дополнительными функциями (VIVO), которые обычно портят качество картинки. Качество разводки карты и элементов выходных цепей находится на очень высоком уровне.

Приступаем к оценке производительности видеокарты в 3D. В качестве инструментария мы использовали следующие программы:

- id Software Quake3 v.1.17 — игровой тест, демонстрирующий работу платы в OpenGL с использованием стандартного демо-бенчмарка demo002, а также quaver, использующего уровень q3dm9 с большими текстурами;

- PlanetMoon Giants v.1.396 (gamegauge) — игровой тест, демонстрирующий работу платы в Direct3D в режиме мультитекстурирования в стрессовых условиях очень сложных сцен;

- Massive Development AquaNox (AquaMark v.2.2) — игровой тест, демонстрирующий работы платы в Direct3D при использовании пиксельных шейдеров в условиях чрезвычайно сложных сцен (до 170000 полигонов).

Quake3 Arena

demo002

Тестирование проводилось в двух режимах: Fast (демонстрирует работу карты в 16-битном цвете) и High Quality (демонстрирует работу карты в 32-битном цвете).

Этот тест нам просто показывает положение флагмана 3D-игровой графики в линейке чипсетов от NVIDIA. Хорошо видно, что в 16- битном цвете GeForce3 отстает от предшественника GeForce2 Ultra (мы уже говорили об этом в нашем первом обзоре), но зато в 32-битном цвете это безусловный король. Видеокарта ASUS AGP-V8200 Deluxe продемонстрировала производительность на уровне ранее рассмотренных карт на этом чипсете.

demo002, максимальное качество

Тестирование проводилось в 16- и 32-битном цвете при всех максимально возможных настройках.

Как мы видим, картина повторяется и при более жестких условиях, GeForce3 немного отстает от GeForce2 Ultra в 16-битном цвете, но зато резко вырывается вперед в 32-битном.

quaver, максимальное качество

Тестирование проводилось в 16- и 32-битном цвете при всех максимально возможных настройках.

Если условия тестирования еще более ужесточить, то есть использовать уровень Q3dm9, в котором применяется очень большой массив текстур, да еще и поставить максимально возможный уровень качества, то мы увидим аналогичную предыдущим картину с той лишь разницей, что в 32-битном цвете карта на GeForce3 справляется с работой еще лучше, и разрыв между ней и GeForce2 Ultra вырос.

Масштабируемость (Scalability), то есть зависимость производительности от частоты CPU

Тестирование проводилось в двух режимах: Fast (демонстрирует работу карты в 16-битном цвете) и High Quality (демонстрирует работу карты в 32-битном цвете).

В этом тестировании принимали участие два процессора: Intel Pentium III-1000 (с номинальной частотой и пониженной до 750 МГц), AMD Athlon 1200 (133 x 9).

Рассмотрим картину по разрешениям:

800x600 — это самое процессорозависимое разрешение, когда от видеокарты практически ничего не зависит. При этом хорошо видно, что в 16-битном цвете на слабом процессоре GeForce3 (фиолетовые столбцы) вчистую проигрывает не только предшественнику (синие столбцы), но и намного более слабой карте на GeForce2 GTS (зеленые столбцы). И только ATI RADEON 64MB DDR (красные столбцы) остался позади. А вот в 32-битном GeForce3 терпит фиаско от GeForce2 Ultra только на Pentium III-750.

1024х768 — в этом разрешении в 16-битном цвете почти у всех карт (кроме ATI RADEON) производительность зависит от частоты процессора, а в 32-битном цвете ATI RADEON 64MB DDR и GeForce2 GTS уже начинают зависеть и от собственной мощности. И поэтому в 16-битном цвете картина очень схожая с предыдущей, где GeForce3 проиграл GeForce2 Ultra. А вот в 32-битном цвете проигрыш наблюдается только на самом слабом процессоре Pentium III — 750 MHz. На более мощных процессорах GeForce3 берет реванш благодаря своей мощи, когда иные карты уже от частоты процессора мало зависят.

1280х1024 — в этом разрешении мы уже видим изменения ситуации в пользу GeForce3. Только еще в 16-битном цвете можно наблюдать отставание от GeForce2 Ultra (впрочем, наши предыдущие тесты это и так ясно показали), а в 32-битном цвете даже на самом слабом процессоре флагман уходит вперед, хотя отчетливо видно, как низкая частота процессора не дает ему резко оторваться от конкурентов. Остальные карты уже давно от процессора не зависят.

1600х1200 — в 16-битном цвете отлично видно, что GeForce3 почти сравнялся с GeForce2 Ultra, и практически все карты уже от процессора мало зависят, они "уперлись" в свои возможности. 32-битный цвет — это "Лебединая песня" GeForce3, когда даже на слабом процессоре видеокарта значительно опережает соперников. Однако тут уже и сама ASUS AGP-V8200 Deluxe достигла предела своего потенциала, и производительность не растет с увеличением частоты CPU.

По итогам этого исследования мы очень хорошо видим, что приобретать видеокарту класса ASUS AGP-V8200 Deluxe имеет смысл только владельцам высокочастотных центральных процессоров (от 1 ГГц и выше). Даже такая относительно высокая частота в 750 МГц (а у многих российских пользователей даже такие частоты — еще в диковинку) сильно урезает потенциал видеокарты, делая ее выгодной только в очень высоких разрешениях.

Anti-aliasing

Тестирование проводилось в двух режимах: Fast (демонстрирует работу карты в 16-битном цвете) и High Quality (демонстрирует работу карты в 32-битном цвете).

В данном разделе мы рассмотрим падение производительности при активизации анти-алиасинга. Я исследовал все возможные виды АА (спасибо Riva Tuner-у за 2х2-tap9). В первой статье по GeForce3 мы уже рассказывали о возможностях этой функции применительно к GeForce3. Поэтому я не стану акцентировать внимание на теории. Добавлю лишь, что NVIDIA реализовала свой весьма хитрый способ MSAA — Quincunx, при котором разрешение увеличивается в 4 раза, как при обычном 2х2 АА, однако выборка субпикселей ведется особым способом: используется не только квадрат 2х2, но и захватываются частично субпиксели с соседних так, что получается выборка из 5-ти субпикселей (крест-накрест). То есть, по сути, для реализации выходного пикселя берется квадрат 3х3, но учитываются не все 9 субпикселей, а только 5 (в первом обзоре есть пояснительные схемы). Поэтому мы получаем качество почти как у АА 3х3, но с гораздо меньшими затратами. АА 2х2-tap9 — это тот же Quincunx, но при этом учитываются все 9 субпикселей, и поэтому падение скорости выше. Чтобы не перегружать данный обзор повторными скриншотами, желающим посмотреть на качество АА я посоветую обратиться к обзору NVIDIA GeForce3.

Как видно из диаграмм, очень хороший уровень играбельности при АА всех типов дает разрешение 800х600, в 1024х768 можно комфортно играть при 32-битном цвете при АА Quincunx (а более тяжелая степень АА, собственно, и не нужна, качество, получаемое при Quincunx очень высокое). А в некоторых играх и в 1280х1024 АА дает возможность получить приличную играбельность.

Подводя итоги рассмотрению АА, просто ради интереса приведу цифры падения производительности при работе АА в той или иной степени.

Разгон (Overclocking)

Тестирование проводилось в двух режимах: Fast (демонстрирует работу карты в 16-битном цвете) и High Quality (демонстрирует работу карты в 32-битном цвете). Использовались два разрешения: 1280х1024 и 1600х1200, поскольку в более низких разгон видеокарты почти не оказывает никакого влияния на производительность из-за влияния частоты центрального процессора.

Разрешение 1280х1024

В 16-битном цвете все зависит только от частоты работы графического процессора, повышение частоты работы памяти никакого влияние не оказывает. Что, в общем-то, соответствует логике, поскольку пропускной способности памяти более чем достаточно для "удовлетворения" нужд GPU, и производительность зависит только от него самого.

А вот в 32-битном цвете картина складывается более пропорционально: видно, что производительность в равной степени зависит от частоты GPU и частоты работы памяти. Это лишний раз доказывает, что видеокарты на GeForce3 представляют собой более сбалансированное решение, нежели ранее выпускаемые платы на GeForce256/GeForce2.

Разрешение 1600х1200

Картина весьма похожа на предыдущую, только в 16-битном цвете увеличение частоты работы памяти уже хоть немного, но играет роль. Это объяснимо возросшими потребностями графического процессора к памяти на таком супер-большом разрешении. В 32-битном цвете мы видим весьма сбалансированную картину равного влияния на производительность частот работы GPU и памяти.

Поэтому следует сделать вывод, что если на предыдущем поколении чипсетов от NVIDIA мы старались разгонять прежде всего память, то у видеокарт на GeForce3 следует разгонять уже как сам GPU, так и память. Разумеется, это не совет и не руководство к действиям по непременному разгону видеокарт. Более того, ни я, ни сайт iXBT, не несем ответственности за последствия разгона видеокарт, так как это внештатный режим, и активизируя его, пользователь берет всю ответственность на себя.

Подчеркну, что все мероприятия, связанные с разгоном, проводились при наличии дополнительного охлаждения в виде вентилятора, обдувающего карту. И я не рекомендую разгонять видеокарты, не установив дополнительного охлаждения.

И в конце этого подраздела я отмечу, что разгон — это индивидуальный процесс, его возможности и последствия зависят от конкретного экземпляра карты, и совершенно неправильно обобщать данные по оверклокингу на все карты данной марки или серии.

Giants

На примере данной игры мы посмотрим на скорость карты в Direct3D. Все установки в игре стоят на максимуме, поэтому этот тест является очень жестким и даже стрессовым для многих видеокарт. Использование Hardware T&L активизировано.

Весьма хорошо видно, что в низких разрешениях в основном играет роль частота центрального процессора, однако, заметьте, что в 16-битном цвете GeForce3 уже не отстает от GeForce2 Ultra. Очень сильная нагрузка, которую дает игра на видеокарты, сказывается, и даже более высокая частота у GeForce2 Ultra не спасает карту на этом GPU от проседания ниже, чем у ASUS AGP-V8200 Deluxe. Соответственно, в 32-битном цвете последняя ушла в еще больший отрыв от соперников. Как видно, общий фон производительности не столь высокий, множество эффектов и очень сложные сцены привели к тому, что даже ASUS AGP-V8200 Deluxe не смогла выдать более 61 fps в 32-битном цвете. Впрочем, для игр класса Giants (одиночные) это не столь важно, там сотни FPS просто не требуются.

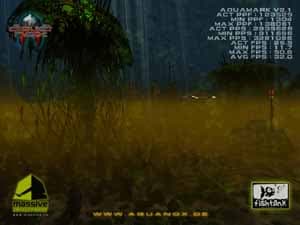

AquaNox

Эта игра была анонсирована примерно одновременно с анонсом самого GPU GeForce3, поскольку будет полностью поддерживать DirectX 8.0 в части использования шейдеров при создании. Прежде всего, речь идет о пиксельных. Почему только еще будет? Ну, пока мы можем лицезреть только демо-версию (и то в виде Rolling-demo, то есть играть в нее невозможно). Но зато на базе этой демо-версии был создан бенчмарк AquaMark. А как тестерам не хватает бенчмарков под Direct3D — это хорошо известно, поскольку на надоевший Expendable уже невозможно смотреть, да и не знает он множества современных эффектов.

Так вот, на примере данного бенчмарка мы посмотрим на скорость карты в Direct3D при использовании пиксельных шейдеров, а также без них (настройки AquaMark позволяют это регулировать). Все установки в игре сводятся к выбору размера массива текстур, я использовал тот массив, которые предлагался по умолчанию — 24 мегабайта. Сразу отмечу, что по стрессовости этот тест даже более сильный, чем Giants, поскольку кроме множества эффектов он использует сцены колоссальной сложности, около 170000 полигонов! Разумеется, Hardware T&L активно используется.

Да, вот это тест! Даже такая махина, как ASUS AGP-V8200 Deluxe не смогла не провалиться до минимальных значений, намного ниже предела играбельности! А про другие карты и говорить нечего. К сожалению, ATI RADEON не заработал на этом бенч-марке (говорить о заточенности AquaMark под карты на чипах от NVIDIA не приходится, так как многие иные платы например, Matrox G400, работают в этом тесте без сбоев). И как в случае с Giants, жесткая ситуация с очень тяжелыми сценами выводит ASUS AGP-V8200 Deluxe в лидеры даже в 16-битном цвете.

Конечно, можно ожидать, что при выпуске уже готовой игры разработчики в число настроек введут достаточно число опций, чтобы можно было облегчить ситуацию с такими нагрузками на акселераторы, а иначе просто никто играть не сможет в такие игры. К тому же, до выхода игры еще далеко, и потому следует ждать оптимизаций ее движка, что должно способствовать увеличению производительности видеокарт в AquaNox. Ниже представлены скриншоты из этого теста:

Вопросы качества в 3D

Мы уже подробно рассматривали проблему качества в 3D у видеокарт на базе GeForce3 в нашем первом обзоре, а также в 3DGiТогах эти моменты очень подробно освещены (имеются даже две галереи скриншотов). Рекомендую почитать эти материалы, а также подраздел в 3DGiТогах, связанный с анизотропной фильтрацией.

В состав Demo-CD, поставляемого с видеокартами на GeForce3, будет входить и новая версия демо будущей игры X-Isle: Dinosaur Island. Это программа, сочетающая в себе удивительную красоту графики, а также насыщенность эффектами, дает возможность пользователю погулять по острову с динозаврами. Сама игра в стиле Adventure с элементами 3D-Action появится под Рождество этого года. Я хочу предложить ряд скриншотов из этой демо, полученных на ASUS AGP-V8200 Deluxe.

Дополнительные функции: VIVO (Video In, Video Out), DVD

Как я уже сказал выше, в поставку входит переходник S-Video-to-RCA для того, чтобы владельцы видеотехники, не имеющей разъемов S-Video, могли подключить выход с видеомагнитофона или видеокамеры к Video In на ASUS AGP-V8200 Deluxe.

Версия 12.10 драйверов от ASUSTeK включает в себя также драйверы по видеозахвату, и поэтому работа фирменной утилиты ASUS Live по приему аналогового видеосигнала, а также Ulead VideoStudio возможна лишь при условии установленных последних драйверов от ASUSTeK версии 12.10 или 12.60.

Я не стану подробно останавливаться на особенностях приема видеосигнала, поскольку эта тема заслуживает отдельного рассмотрения в рамках большого обзора видеокарт любительского уровня с VIVO, поэтому могу лишь посоветовать немного подождать, пока столь долгожданный материал не появится на нашем сайте.

Видеовыход работает по принципу: или монитор, или телевизор, однако уже имеется поддержка разрешения 1024х768.

Можно с сожалением отметить, что поставляемый с картой DVD-плеер ASUS DVD 2000 не знает такого чипа, как GeForce3 и отказывается активизировать аппаратную поддержку DVD со стороны видеокарты. Ранее установленный WinDVD 2.1 смог без проблем это сделать, и проигрывание DVD-видео было беспроблемным. При этом процент загрузки CPU был на уровне 22-24%.

Выводы

Вот мы и познакомились с первой ласточкой из серийно выпускаемых видеокарт на базе NVIDIA GeForce3 — ASUS AGP-V8200 Deluxe. Надо сказать, что работа этой карты, да и сама она произвели на меня сильное впечатление. Это действительно нечто класса High-End уже не по декларациям и пресс-релизам, а по ощущениям.

Мы уже выражали свое мнение о видеокартах этого уровня и о самом чипсете GeForce3, действительно, со времен появления GeForce256 произошел рывок вперед в плане новых технологий и совершенствования прежних. Видеокарты этого класса способны воспроизводить практически все эффекты, известные на сегодня в сфере игрового 3D. Поэтому для игроков, жаждущих не только великолепной скорости в 32-битном цвете (про 16-битный можно вообще забыть раз и навсегда!), но и всевозможных эффектов, которые можно ныне получить при наличии воли разработчиков игр через шейдеры, приобретение таких видеокарт, как ASUS AGP-V8200 Deluxe, даст им как получение морального удовлетворения от собственной крутости :-), так и быстрейшей производительности в труколоре. Вот с шейдерами пока придется подождать, так как множество игр, реализуемых "под DirectX 8.0", пока находится в процессе разработки. По крайней мере, до осени ждать выхода таких игр не стоит.

Да, могут мне возразить, что осенью появится новый чип, и нет смысла тратиться на GeForce3 — карты. Не совсем так. Во-первых, осенью появится лишь разогнанный вариант GeForce3, однако мы не знаем, насколько заоблачными будут цены на подобные карты, а платы типа ASUS AGP-V8200 Deluxe уже успеют изрядно подешеветь. А новый, революционный продукт от NVIDIA ожидается только примерно через год.

Конечно, покупать ныне очень дорогие карты на GeForce3 смогут очень и очень немногие. Но падение цен на такие вещи — уже явление закономерное, и поэтому можно ожидать, что через небольшое время эти видеокарты станут более доступными. Однако, как показали исследования, перед приобретением такого мощного акселератора надо подумать: а есть ли в вас соответствующая платформа с не менее мощным процессором? Уже ясно, что ставить видеокарту уровня ASUS AGP-V8200 Deluxe на систему с процессором менее 1 ГГц — бессмысленно, последний может значительно урезать потенциал видеокарты даже в популярном разрешении 1024х768.

Возвращаясь к ASUS AGP-V8200 Deluxe, мне хочется еще раз отметить великолепное качество исполнения продукта, оригинальный дизайн. Ну, разумеется, на счету уже проверенная временем марка ASUS, которая в плане видеокарт в последнее время практически не подводила (ну если не считать казусов типа 16-ти мегабайтного GeForce2 MX :-).

Более полные сравнительные характеристики видеокарт этого и других классов вы можете увидеть в наших 3DGiТогах.

Плюсы:

- Блестящая производительность в 3D графике, прежде всего в 32-битном цвете;

- Отличное качество исполнения продукта;

- Прекрасная разгоняемость карты;

- Стильный и оригинальный дизайн;

- Наличие Hardware Monitoring в виде технологии SmartDoctor;

- Сочетание мощи в 3D с поддержкой мультимедийных функций и стерео-очков.

Минусы:

- Очень высокая стоимость для массового пользователя на сегодня.