и Исследование производительности в 2560x1600,

а также кратко об:

MSI RADEON X1300 (RX1300) 256MB PCI-E

MSI RADEON X1300 PRO (RX1300 PRO-TD256E) 256MB PCI-E

MSI RADEON X1600 XT (RX1600 XT-T2D256E) 256MB PCI-E

MSI RADEON X1650 PRO (RX1650 PRO-T2D256E) 256MB PCI-E

MSI RADEON X1950 XTX (RX1950 XTX-VT2D512E) 512MB PCI-E

СОДЕРЖАНИЕ

- Введение

- Особенности видеокарт

- Конфигурации стенда, список тестовых инструментов

- Результаты тестов

- Выводы

В этот раз будет не совсем обычный материал. Дело в том, что в лабораторию к нам попало несколько видеокарт на базе RADEON разных серий, плюс новинка на базе GeForce 8800 GTX. Но все они были объединены одним производителем — MSI.

А поскольку мы еще не изучали работу 8800 GTX в самом высоком разрешении на сегодня — 2560х1600, то займемся и этим вопросом. Ведь не зря в заголовке есть намек, что GeForce 8800 GTX лишь с наклейкой MSI. Всегда трудно говорить о вендорах как о производителях, если их дело заключается лишь в покупке видеокарты у NVIDIA, наклеивании своих ярлыков и упаковку в свою коробку (со своим, разумеется, комплектом). Да, еще и еще раз: все GeForce 8800 GTX производятся на сторонних фабриках, а партнеры NVIDIA закупают эти карты целиком у последней, и выдают за свое.

А поскольку тайваньская компания MSI еще работает и на два фронта, то в наше поле зрения попали и продукты на базе процессоров от AMD (ATI). Конечно, трудно их назвать новыми, кроме X1950 XTX, однако, не наша вина в том, что так поздно они попали в наш тестлаб. Все же надо просто показать читателям, что такие карты есть на рынке, что они из себя представляют.

Поэтому без лишних слов приступим к изучению карт.

Платы

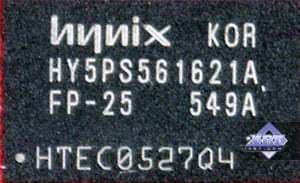

| MSI RADEON X1300 (RX1300) 256MB PCI-E; MSI RADEON X1300 PRO (RX1300 PRO-TD256E) 256MB PCI-E; MSI RADEON X1600 XT (RX1600 XT-T2D256E) 256MB PCI-E; MSI RADEON X1650 PRO (RX1650 PRO-T2D256E) 256MB PCI-E | |

|---|---|

| Карта имеет 256 МБ памяти GDDR2 SDRAM, размещенной в 8-ми микросхемах на лицевой и оборотной cторонах PCB. Микросхемы памяти Hynix (GDDR2). Время выборки у микросхем памяти 2.5 ns, что соответствует частоте работы 400 (800) МГц. |  |

| MSI GeForce 8800 GTX (NX8800 GTX-T2D768E) 768MB PCI-E | |

| Карта имеет 768 МБ памяти GDDR3 SDRAM, размещенной в 12-ти микросхемах на лицевой стороне PCB. Микросхемы памяти Samsung (GDDR3). Время выборки у микросхем памяти 1.1ns, что соответствует частоте работы 900 (1800) МГц. |  |

| MSI RADEON X1950 XTX (RX1950 XTX-VT2D512E) 512MB PCI-E | |

| Карта имеет 512 МБ памяти GDDR4 SDRAM, размещенной в 8-ми микросхемах на лицевой cторонe PCB. Микросхемы памяти Samsung (GDDR4). Время выборки у микросхем памяти 0.9 ns, что соответствует частоте работы 1100 (2200) МГц. |  |

Сразу в глаза бросается то, что MSI очень сэкономила на X1650/X1600-картах, сделав их дизайн на основе X1300 с использованием медленной DDR2-памяти, поэтому и 1600ХТ, и 1650PRO получились с заниженной по частоте памятью, что не есть хорошо.

Продукты на базе X1300-серии также на своем дизайне, отличающемся от эталонного, но там ничего такого сверхестественного нет. Стоит заметить, что частота работы памяти на X1300 заметно выше номинала, и X1300 от X1300 PRO отличаются только по частотам работы ядер.

Остальные платы — купленные у ATI или NVIDIA референсы. Ну кроме некоторых нюансов.

У карт имеются гнезда TV-выхода, которые уникальны по разъему, и для вывода изображения на ТВ как через S-Video, так и по RCA, требуются специальные адаптеры-переходник, поставляемые вместе с картами. Более подробно о ТВ-выходе можно почитать здесь. А карта на базе X1950XTX оснащена и Video-In. Более подробно про Video-In можно почитать здесь.

Подключение к аналоговым мониторам с d-Sub (VGA) производится через специальные адаптеры-переходники DVI-to-d-Sub. Максимальные разрешения и частоты:

- 240 Hz Max Refresh Rate

- 2048 × 1536 × 32bit x85Hz Max — по аналоговому интерфейсу

- 2560 × 1600 @ 60Hz Max — по цифровому интерфейсу

Что касается возможностей видеокарт по проигрыванию MPEG2 (DVD-Video), то еще в 2002 году мы изучали этот вопрос, с тех пор мало что поменялось. В зависимости от фильма загрузка CPU при проигрывании на всех современных видеокартах не поднимается выше 25%.

Теперь о системах охлаждения.

Вот здесь вернемся к нюансам. Дело в том, что видеокарта X1950 XTX оснащена водяной системой охлаждения от ThermalTake, мы о ней уже писали.

В общем-то, скажу сразу, что на эффективность разгона сей факт сказался минимально, а как известно, новый кулер на X1950XTX-сериях не шумит. И поэтому зачем придумали такое усложнение — не знаю. Ну во всяком случае, хуже не стало, плюс возможно, кому-то из оверклокеров повезет лучше с разгоном. Микросхемы памяти греются весьма сильно, а их лишили централизованного охлаждения через единую подошву кулера, что не есть хорошо.

А с MSI GeForce 8800 GTX (NX8800 GTX-T2D768E) 768MB PCI-E вообще все штатно. Система охлаждения от NVIDIA-референс, мы уже подробно такую конструкцию изучали. Поэтому нет смысла на этом останавливаться.

Комплектация.

Упаковки.

Установка и драйверы

Конфигурация тестового стенда:

- Компьютер на базе Intel Core2 Duo (775 Socket)

- процессор Intel Core2 Duo Extreme X6800 (2930 MHz) (L2=4096K);

- системная плата EVGA nForce 680i SLI на чипсете NVIDIA nForce 680i;

- оперативная память 2 GB DDR2 SDRAM Corsair 1142MHz (CAS (tCL)=5; RAS to CAS delay (tRCD)=5; Row Precharge (tRP)=5; tRAS=15);

- жесткий диск WD Caviar SE WD1600JD 160GB SATA.

- операционная система Windows XP SP2; DirectX 9.0c;

- монитор

Dell 3007WFP (30") (иMitsubishi Diamond Pro 2070sb (21")). - драйверы ATI версии CATALYST 6.11; NVIDIA версии 96.94.

VSync отключен.

Результаты тестов: сравнение производительности

В качестве инструментария мы использовали:

- Splinter Cell Chaos of Theory v.1.04 (Ubisoft) — DirectX 9.0, мультитекстурирование, настройки тестирования — maximum, shaders 3.0 (for NVIDIA cards)/shaders 2.0 (for ATI cards); HDR OFF!

- Half-Life2 (Valve/Sierra) — DirectX 9.0, demo (ixbt01 Тестирование проводилось при максимальном качестве, опция -dxlevel 90, в файле dxsupport.cfg убраны предустановки для видов карт.

- FarCry 1.4beta (Crytek/UbiSoft), DirectX 9.0, мультитекстурирование, demo из уровня Research (запуск игры с опцией -DEVMODE), настройки тестирования все Very High. Бета-версия патча — потому, что в ней есть поддержка HDR+AA, чего нет в релизе.

- DOOM III (id Software/Activision) — OpenGL, мультитекстурирование, настройки тестирования — High Quality (ANIS8x). Имеется пример автоматизации запуска с увеличением скорости и уменьшением числа рывков (прекешинг). (НЕ ПУГАТЬСЯ черного экрана после первого меню, так и должно быть! Он будет секунд 5-10, а потом должна пойти демка)

- 3DMark05 1.20 (FutureMark) — DirectX 9.0, мультитекстурирование, настройки тестирования — trilinear,

- The Chronicles Of Riddick: Escape From Butcher Bay 1.10 (Starbreeze/Vivendi) — OpenGL, мультитекстурирование, настройки тестирования — максимальное качество текстур, Shader 2.0.

Выражаю благодарность Ринату Досаеву (AKA 4uckall) и Алексею Островскому (AKA Дучче) за написание демо к данной игре, а также большое спасибо Алексею Берилло AKA Somebody Else за помощь

- F.E.A.R. v.1.05 (Multiplayer) (Monolith/Sierra) — DirectX 9.0, мультитекстурирование, настройки тестирования — maximum, Soft shadows выключены.

- Call Of Duty 2 DEMO (Ubisoft) — DirectX 9.0, мультитекстурирование, настройки тестирования — maximum, shaders 2.0, тестирование с помощью Benchemall, demo и скрипт для запуска, в readme есть инструкция

Производительность видеокарт

Здесь надо отдельно поговоритть о разрешениях. Прежде всего, это касается самых мощных ускорителей, таких как GeForce 8800 GTX, не говоря уж о режиме SLI. Не секрет, что в ряде игр даже при очень сильной нагрузке потенциал таких акселераторов настолько велик, что общая производительность все равно упирается в системные ресурсы. Поэтому имеет смысл увеличивать разрешение, что даст не только усиление нагрузки на акселератор, но и больший комфорт от игры. Конечно тут многие столкнутся с ограничениями, наложенными возможностями того или иного монитора. Поэтому уже надо думать об этом до приобретения новой видеокарты, ибо покупать GeForce 8800 GTX, имея только 15-17-дюймовый монитор с возможностями не выше 1024х768 или 1280х1024, глупо. Да, можно сейчас найти игру, которая так сильно грузит ускоритель при включении всех его возможностей, что даже в 1024 мы можем ощутить отсутствие запредельных скоростей, однако много и иных, для которых и 1280х1024 — разрешение, где ускоритель еще не уперся в свой потенциал, а значит, рамки накладывают системные ресурсы. Тут не может быть единого рецепта связки ускорителя и монитора, здесь пользователю надо думать самому, исходя из опубликованных результатов тестовв в том или ином разрешении.

Исходя из этого мы решили увеличить планку максимального разрешения в 3D с 2048х1546 до 2560х1600. Разумеется, мы понимаем, что в настоящий момент 30дюймовые мониторы, которые поддерживают такое разрешение, очень дороги и малодоступны, и потому только считанные единицы процентов пользователей будут заинтересованы таким разрешением. Однако, наличие подобных результатов даст и всем остальным посмотреть просто на потенциал карты, и оценить ее возможности. К тому же, в таком разрешении уж точно все будет упираться уже в видеоускоритель, а не в системные ресурсы, особенно с нагрузкой в виде АА+АФ.

Теперь о широком формате. Мы видим, что старый формат 1024х768/1600х1200, применяемый традиционно уже многие годы, уходит постепенно в прошлое. Ему на смену спешат новые форматы 1600х1000, 1920х1200, 2560х1600 и т.д. Вместо старых соотношений 1.25 и 1.33, теперь в моде 1.6 и 1.77. То есть экран становится более широким. Простым сравнением 1600х1200 и 1920х1200 понятно, что во втором случае на экране поместится больше информации. Поэтому стало все больше появляться игр, поддерживающий Wide-screen. Хороший пример — Oblivion:

Прекрасно видно, что во втором случае (wide-screen — скриншоты справа) игрок видит больше, чем в первом, на сцене появляются кусочки, которые не видны в обычном режиме. Следовательно, там может что угодно, в т.ч. и враг, стреляющий в игрока, которого просто можно не заметить в обычном режиме. Понятно, что это все возможно только в случае, если игра поддерживает широкие разрешения. В остальных случаях сцена будет просто растягиваться по диагонали, занимая весь монитор, и будет не очень красиво.

Переходмм к изучению производительности. В ряде тестов проведем анализ процентных соотношений скоростей GeForce 8800 GTX в 1600х1200 и 2560х1600.

Желающие скачать все результаты в формате Excel (формата Office 2003) — могут взять архив формата RAR 3.0 или ZIP.

- 1. Far Cry, Research (No HDR)

- Все разрешения на одной странице, No AA, No AF

- Все разрешения на одной странице, AA 4x + AF 16x (High Quality for ATI)

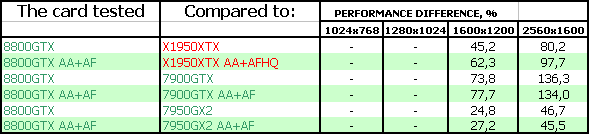

Исследование производительности GeForce 8800 GTX в 2560х1600

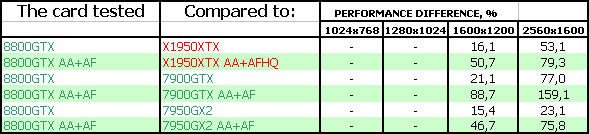

В данном тесте прекрасно видно, что в 2560х1600 все соперники 8800GTX из ранее выпущенных поколений резко сбавили по скоростям, уже точно упершись в свои возможности, и потому процент превосходства 8800 резко вырос.

- 2. Far Cry, Research (HDR)

- Все разрешения на одной странице, No AA, No AF

- Все разрешения на одной странице, AA 4x + AF 16x (High Quality for ATI)

- 3. Splinter Cell Chaos Theory (No HDR)

- Все разрешения на одной странице, No AA, No AF

- Все разрешения на одной странице, AA 4x + AF 16x (High Quality for ATI)

Исследование производительности GeForce 8800 GTX в 2560х1600

Эта игра посложнее для ускорителей, и потому упираться в свои ресурсы начал и 8800 GTX, а не только его соперники, хотя те все равно более резко снизили производительность в 2560х1600, нежели в 1600х1200.

- 4. Splinter Cell Chaos Theory (HDR)

- Все разрешения на одной странице, No AA, No AF

- Все разрешения на одной странице, AA 4x + AF 16x (High Quality for ATI)

- 5. Half Life2, ixbt01

- Все разрешения на одной странице, No AA, No AF

- Все разрешения на одной странице, AA 4x + AF 16x (High Quality for ATI)

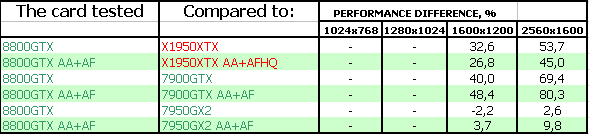

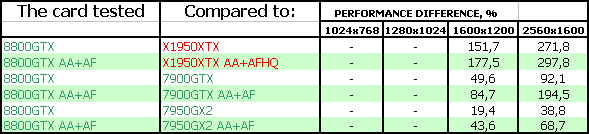

Исследование производительности GeForce 8800 GTX в 2560х1600

НА примере этой игры становится ясно, что несмотря на то, что она слывет очень легкой для последних поколений видеокарт, все равно в 2560х1600 резко упали по скорости и х1950, и 7900, и 7950. Когда как 8800 GTX все еще не исчерпал свой потенциал и в этом разрешении. Отсюда и просто огромная разница между 1600 и 2560 по соотношениям производительности.

- 6. DOOM III

- Все разрешения на одной странице, No AA, No AF

- Все разрешения на одной странице, AA 4x + AF 16x (High Quality for ATI)

- 7. 3DMark05 MARKS

- Все разрешения на одной странице, No AA, No AF

- Все разрешения на одной странице, AA 4x + AF 16x (High Quality for ATI)

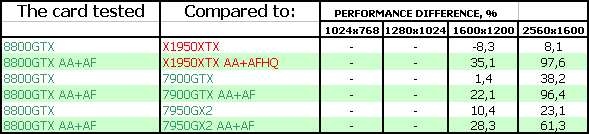

Исследование производительности GeForce 8800 GTX в 2560х1600

Ситуация почти аналогичная

- 8. Chronicles of Riddick, demo 44

- Все разрешения на одной странице, No AA, No AF

- Все разрешения на одной странице, AA 4x + AF 16x (High Quality for ATI)

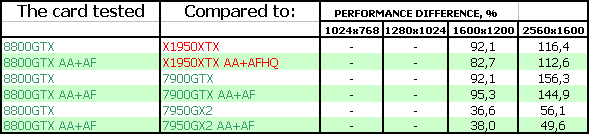

Исследование производительности GeForce 8800 GTX в 2560х1600

Эта игра еще легче для 8800, чем HL2, и потому вышеупомянутый разрыв просто огромен.

- 9. F.E.A.R.

- Все разрешения на одной странице, No AA, No AF

- Все разрешения на одной странице, AA 4x + AF 16x (High Quality for ATI)

- 10. Call Of Duty 2 DEMO

- Все разрешения на одной странице, No AA, No AF

- Все разрешения на одной странице, AA 4x + AF 16x (High Quality for ATI)

- 11. 3DMark 06, Shader Model 2.0 MARKS

- Все разрешения на одной странице, No AA, No AF

- Все разрешения на одной странице, AA 4x + AF 16x (High Quality for ATI)

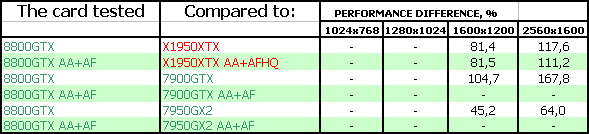

Исследование производительности GeForce 8800 GTX в 2560х1600

Тест весьма сложен и для 8800 GTX, потому разрыв не столь велик.

- 12. 3DMark 06, Shader Model 3.0 MARKS

- Все разрешения на одной странице, No AA, No AF

- Все разрешения на одной странице, AA 4x + AF 16x (High Quality for ATI)

Исследование производительности GeForce 8800 GTX в 2560х1600

Аналогично.

Выводы

О видеокартах MSI на процессорах от ATI хочу сказать в целом. Продукты на базе X1300/1600 ничем особо не выделяются, лишь частота работы памяти на Х1300 выше, чем положено, однако это мало помогает такому слабому ускорителю, поскольку вся производительность упирается именно в GPU, пора в Low-сектор уже выводить 8-конвейерные решения, а не продолжать поставлять 4-х конвейерные, натягивая их по частоте «по самые помидоры». Карты на базе х1600 смотрятся хуже конкурентов, потому что занижены частоты работы памяти.

Продукт на базе х1950 ХТХ представляет собой эталонный продукт, по сути карта куплена у ATI, а не своего производства. Заменена лишь система охлаждения. Нужен ли такой кулер? — Не думаю. Вот для X1900 XTX — да, нужен, поскольку референс-система охлаждения очень шумная и портящая впечатление о продукте. А у X1950 XTX эталонный кулер и так хорош. В плюс можно отнести то, что дополнительный блок водянки можно установить в любой слот, освобождая первый после видеокарты, если тот нужен. Возможно нам попался экземпляр карты, который слабо гонится, а на других картах этот кулер с водянкой сможет показать лучший потенциал по охлаждению при разгоне.

Теперь о GeForce 8800 GTX. Читатели смогли еще раз убедиться в том, что перед нами просто референс-карта с наклейками от MSI, никаких иных отличий нет. Комплект поставки, хоть и включает в себя некоторые игры, все равно скудноват для столь дорогого продукта, а ведь не так давно мы могли восхищаться комплектами от MSI… Увы, все хорошее когда-то кончается.

Карта отработала стабильно, проблем не было. Остальные подробности здесь.

Что касается высоких и широких разрешений, то мы видим, что они все больше и больше входят в нашу жизнь, поэтому за ними будущее. Понятно, что многое будет зависеть от цен на такие огромные мониторы, надеюсь, что они вскоре резко упадут, сделав такие разрешения доступными хотя бы большинству покупателей Hi-End ускорителей.

Более полные сравнительные характеристики видеокарт этого и других классов вы можете увидеть также в наших 3DGiТогах.

По результатам исследования награду в номинации «Оригинальный дизайн»

получает MSI RADEON X1950 XTX (RX1950 XTX-VT2D512E) 512MB PCI-E (за декабрь 2006 года).

Справочник по ATI RADEON X1300-1600-1800-1900-х серий

Справочник по NVIDIA GeForce 7300-7600-7800-7900-х серий

Блок питания для тестового стенда предоставлен компанией TAGAN

Монитор Dell 3007WFP для тестовых стендов предоставлен компанией NVIDIA