За три месяца, прошедшие с момента публикации предыдущей статьи, на рынке 3D-видеокарт случилось два крупных события, несколько мелких, а одно событие так и не случилось, хотя все его ждали.

Кроме того, второй квартал 2005 года охарактеризовался полным исчезновением с новостных лент упоминаний о ком-либо, кроме двух североамериканских конкурентов. Как мы и предполагали в прошлой статье, демонстрации новинок от S3 на демонстрациях и закончились, а планы XGI в очередной раз оказались очень отдаленными.

А потому, не отвлекаясь на незначительные происшествия, перейдем к основным событиям прошедших месяцев.

Главные события второго квартала 2005 года

Как и в прошлый раз, начнем с событий, виновником которых стала канадская компания ATI.

ATI

За прошедшие с конца апреля месяцы ATI, в хронологическом порядке, успела сделать следующее:

- Выпуск Radeon X800 XL (R430) с 512 МБ памяти

- Участие в анонсе приставки MS Xbox 360 (ATI C1/R500/Xenos)

- Анонс технологии ATI CrossFire — ответ на NVIDIA SLI

- Перенос сроков анонса видеокарт на базе чипа R520

Выпуск Radeon X800 XL (R430) с 512 МБ памяти

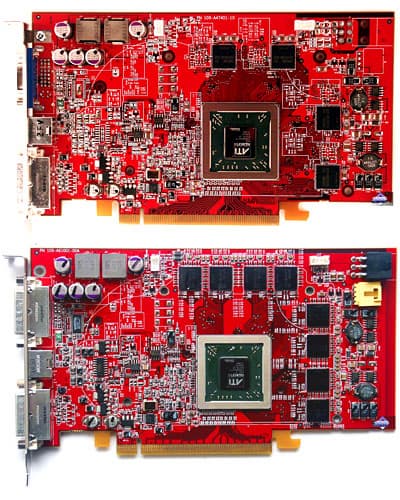

Хронологически первым незначительным событием стал анонс компанией ATI видеокарт Radeon X800 XL с 512 МБ набортной памяти. Напомним, что видеокарты RX800XL используют сравнительно новый чип R430, обладающий PCIE-интерфейсом. Примечательно, что PCB видеокарт RX800XL были изначально разработаны с учетом возможности установки 512 МБ памяти, поэтому изменения, внесенные инженерами ATI в уже знакомую нам видеокарту, были весьма незначительны:

Обратите внимание на наличие разъема дополнительного питания на видеокарте с 512 МБ памяти — увеличение количества чипов памяти GDDR3 привело к превышению лимита потребляемой мощности слота PCIE x16.

Почему мы относим это событие к числу незначительных? Во-первых, проведенные нами тесты Radeon X800 XL 512 МБ не показали практически никакого превосходства подобной видеокарты над своими 256-мегабайтными собратьями. Во-вторых, Radeon X800 XL 512 МБ не стала первой видеокартой с подобным объемом памяти — поэтому и с точки зрения чисто теоретического интереса к влиянию дополнительных 256 МБ видеопамяти на производительность мы ничего нового не узнали.

В линейке PCIE-видеокарт на базе чипа R430 видеокарты Radeon X800 XL 512 МБ заняли самую верхнюю строчку с MSRP 449 USD:

| Видеокарта | Ядро | Память | PP | VP | Шина | MSRP |

| Radeon X800 XL | 400 МГц | 512 МБ 500 МГц 256 bit GDDR3 | 16, PS2b | 6, VS2 | PCIE | 449 |

| Radeon X800 XL | 400 МГц | 256 МБ 500 МГц 256 bit GDDR3 | 16, PS2b | 6, VS2 | PCIE | 299 |

| Radeon X800 | 400 МГц | 256 МБ 350 МГц 256 bit GDDR3 | 12, PS2b | 6, VS2 | PCIE | 229 |

| Radeon X800 | 400 МГц | 128 МБ 350 МГц 256 bit GDDR3 | 12, PS2b | 6, VS2 | PCIE | 199 |

Участие в анонсе приставки MS Xbox 360 (ATI C1/R500/Xenos)

Событие, конечно, трудно признать имеющим прямое отношение к рынку компьютерного 3D-видео, и, полагаем, что все подробности о новой игровой консоли от Microsoft мы расскажем в другой раз, в другой статье. Однако есть одна тонкость, которая не позволяет нам совсем проигнорировать анонс Xbox 360 в рамках данного текста. Дело в том, что видеочип с кодовым названием ATI C1 — или Xenos — по сути, является работающим прототипом будущего компьютерного видеочипа от ATI с поддержкой DirectX 10.

Чем интересен Xenos? Во-первых, Xenos — первый в истории видеочип с унифицированными конвейерами. Другими словами, конвейеры Xenos одинаково подходят для обработки как пикселей, так и вершин; деление на вершинные и пиксельные конвейеры в чипе отсутствует. За распределением нагрузки следит специальный блок, динамически определяющий, что в данный момент требует первоочередной обработки: вершины или пиксели.

Более того, в рамках принципиально новой архитектуры Xenos устарело и само понятие «числа конвейеров», поскольку конвейеры были разбиты на составные части, коммуникация между которыми также осуществляется динамически. Так, в чипе есть 16 блоков выборки значений из текстур и 48 универсальных АЛУ (организованных, насколько нам известно, в три «ядра», каждое из которых может работать или над пикселями, или над вершинами, но не над тем и другим одновременно). Поскольку спецификации чипа Xenos как минимум соответствуют уровню DX9 SM3, то вся мощь 16 полноценных TMU может использоваться и при выборке значений текстур в вершинных шейдерах.

Не менее интересен выбранный ATI для Xenos подход к записи значений во фреймбуфер:

ATI разделила графический конвейер на два чипа: большой чип (232 млн транзисторов), в котором осуществляются все операции по расчетам вершинных и пиксельных шейдеров (shader core); и меньший чип (105 млн транзисторов), бОльшей частью состоящий из высокоскоростной памяти (10 МБ), но несущий в себе также логику, отвечающую за запись результатов и работу с фреймбуфером (memory core).

Чем интересно подобное решение? Во-первых, интеграция ROP в один чип с памятью позволила ATI связать ROP и память широченной шиной с пропускной способностью 256 ГБ/сек. На практике это позволяет реализовывать практически бесплатный MSAA, причем, не только для стандартных форматов буфера кадра, но и в случае использования FP16-буферов для столь модного в последнее время HDR. При этом шина между shader core и memory core обладает ПС всего лишь 32 ГБ/сек., то есть, воспользоваться высокой ПС внутри memory core shader core не может, и эта высокая ПС, по большому счету, будет использоваться только для ускорения работы MSAA и блендинга буферов высокой точности. Что «потеряно» в подобной организации работы с буфером кадра? В первую очередь, сложные эффекты постпроцессинга, требующие возврата значений фреймбуфера в shader core. Впрочем, справедливости ради заметим, что даже в этом случае возможности Xenos в области постпроцессинга как минимум не уступают возможностям современных компьютерных видеокарт.

Следует отдельно оговорить, что подобная архитектура памяти все же не является EDRAM в традиционном смысле этого термина (EDRAM в видеокартах подразумевает интеграцию памяти в shader core), однако маркетинг MS не особенно смущаясь продвигает видеосистему Xbox 360 как обладающую 10 МБ EDRAM.

Также весьма оригинален подход ATI к использованию этих 10 МБ «высокоскоростной» памяти для рендеринга кадров в высоком разрешении: вполне очевидно, что объема в 10 МБ будет недостаточно для заявленного MS рендеринга в HDTV-разрешениях. В частности, в разрешении 720p (1280x720), в случае использования стандартного 32-битного буфера кадра с 32-битным Z-буфером применение даже MSAA 2x приведет к превышению объема в 10 МБ. Значит ли это, что Xenos не сможет использовать MSAA в HDTV-разрешениях? Если да, то зачем городили огород с memory core и диковинной ПС в 256ГБ/сек.?

Для решения проблемы ATI предложила строить изображение тайлами, хотя в данном случае, чтобы избежать путаницы в понятиях, лучше говорить — «частями». Xenos строит кадр в несколько тактов, первый из которых используется для заполнения значений Z-буфера, после чего кадр обрабатывается частями — а заполненный в первом такте Z-буфер используется для определения того, какие треугольники попадают в обрабатываемую в данный момент часть изображения. Когда обрабатываемая часть кадра закончена, она записывается в системную память Xbox 360 (причем, на данном этапе производится даунсэмплинг MSAA-буфера), а чип начинает строить следующую часть кадра.

В целом, можно смело констатировать, что архитектура чипа ATI Xenos является, вне всяких сомнений, революционной, причем, сразу в двух областях: конвейерах рендеринга и механизмах работы с буфером кадра. Отметим, впрочем, что если унификация конвейеров является вполне ожидаемым развитием сегодняшних 3D-видеочипов, и мы с легким сердцем прогнозируем ее появление и на рынке ПК-видеокарт в 2006-м году, то новации в области работы с буфером кадра требуют определенной поддержки со стороны программного кода, и потому вряд ли будут реализованы на ПК в том же виде, в каком мы увидели их в Xbox 360.

Анонс технологии ATI CrossFire — ответ на NVIDIA SLI

Первым большим событием прошедших месяцев стал анонс ATI технологии CrossFire — долгожданного ответа канадской компании на NVIDIA SLI, который еще в декабре прошлого года некоторые называли то AMR, то MVP.

Подробности о работе технологии CrossFire вы можете узнать в статье «Асимметричный ответ ATI: новая технология CrossFire», мы же в рамках данного текста отметим лишь основные отличия CF от SLI, а также затронем особенности выхода CF на рынок, ставшие более очевидными за прошедшие со дня анонса месяцы.

Итак, ATI CF имеет три основных отличия от NVIDIA SLI: иной тип соединения двух видеокарт для совместной обработки кадра, возможность использования особых режимов MSAA и иной режим совместного рендеринга изображения.

Видеокарты в технологии CrossFire соединяются при помощи специального кабеля, подключаемого, в отличие от SLI, не к особенным разъемам на самих картах, а к DVI-портам объединяемых видеокарт (забавно, но в этом смысле технология CrossFire совершенно неожиданно вызвала у автора этих строк ностальгию по временам видеокарт 3dfx Voodoo Graphics и Voodoo 2 :-)).

Разумеется, ATI пытается преподнести подобный тип соединения как преимущество технологии — и в определенном смысле так оно и есть — но в реальности у ATI не было особенного выбора. Дело в том, что, в отличие от NVIDIA, которая изначально оснащала видеокарты на базе чипов NV45 и NV43 SLI-коннекторами, ATI продала внушительное количество видеокарт на чипах R423, R430 и R480 безо всяких дополнительных разъемов — то есть, нужно было что-то придумывать для объединения их в тандемы. Вот инженеры ATI и придумали: для создания CF-конфигурации вам необходимо купить новую видеокарту так называемой CrossFire Edition (эти видеокарты оснащены блоком, объединяющим работу нескольких видеокарт); купить чипсет, на котором в данный момент разрешена работа CrossFire; после чего использовать вашу старую PCIE-видеокарту на чипе R423, R430 или R480 в тандеме с новой видеокартой (видеочипы у них, разумеется, должны быть одинаковыми, а вот совпадения частот и числа конвейеров не требуется) при помощи внешнего DVI-DVI соединительного кабеля.

Официально анонсированы видеокарты Radeon X800 CrossFire Edition (на базе чипа R430) и Radeon X850 CrossFire Edition (на базе чипа R480, к которому можно смело подключать чип R423 — они отличаются лишь частотами). На момент анонса работа конфигураций CrossFire гарантировалась только на чипсетах ATI Radeon Xpress 200 CrossFire Edition, но данное ограничение связано не столько с техническими особенностями работы CF, сколько с необходимостью тщательного тестирования работы CrossFire на других системных чипсетах.

Второе существенное отличие технологии CrossFire от SLI заключается в новых режимах MSAA, доступных владельцам CF-конфигураций. Вкратце данное преимущество в очередной раз сводится к использованию ATI дальновидно реализованных еще в чипе R300 программируемых шаблонов расположения субпикселей на решетке MSAA: если одна видеокарта рассчитывает 4 субпикселя и другая видеокарта рассчитывает 4 субпикселя, но взятые из других точек решетки, то при объединении результатов мы получим пиксель с 8 субпикселями, т.е. фактически получим режим MSAA 8x. Правда, прирост скорости в этом случае равняется нулю, поскольку каждая видеокарта рисует каждый следующий кадр целиком.

Более того, не останавливаясь на этом, ATI реализовала два режима, в которых в конечном кадре объединяются два кадра со смещенными геометрическими координатами — эти режимы позволяют владельцам CF-конфигураций получить весьма не лишнее в некоторых случаях сглаживание текстур с альфа-тестом и являются в некотором роде ответом на гибридные MSAA+SSAA-режимы, доступные владельцам видеокарт GeForce.

Наконец, третьим существенным отличием стал новый режим мультичипового рендеринга, при котором изображение делится на прямоугольники, обработкой которых карты занимаются в шахматном порядке — собственно, именно отсюда и пошло название CrossFire. Утверждается, что данный режим обладает более эффективным распределением нагрузки между обрабатывающими кадр видеокартами. В теории этому режиму присущи все те же ограничения, что и режиму Split-Frame Rendering. Также любопытно отметить, что ATI прилежно реализовала в технологии CrossFire как режим SFR, так и режим AFR — оба являются практически клонами аналогичных режимов NVIDIA SLI.

Здесь мы подходим к минорной ноте повествования об ATI CrossFire: проверить все заявления канадской компании и наши собственные теоретические выкладки пока что негде, поскольку даже спустя полтора месяца после анонса пресловутые чипсеты и видеокарты со стикерами CrossFire Edition в продаже отсутствуют. Почему? Наши мысли об этом мы изложим в следующих главах.

Перенос сроков анонса видеокарт на базе чипа R520

Мы вплотную подошли к важному событию в стане ATI, которое все ждали, но которое так и не случилось — к анонсу видеокарт на базе нового чипа R520. Напомним, что изначально подобный анонс ожидался едва ли не в мае, потом был перенесен на июнь, затем зазвучали даты, располагавшиеся в конце июля и вот, по последним данным «разведки», речь уже идет о сентябре.

Что же случилось с R520? Если верить заявлениям ATI на последнем ежеквартальном собрании акционеров компании, то с архитектурой чипа проблем нет, а задержка связана с неудовлетворительным выходом годных к использованию чипов с 90-нанометрового конвейера TSMC. То есть, ATI «напоролась» на проблемы с новым техпроцессом точно так же, как на аналогичные проблемы «напоролась» NVIDIA при выпуске чипа NV30.

Впрочем, сразу оговоримся, что сравнивать в высшей степени неудачный и практически отсутствовавший в продаже чип NV30 с R520 пока что рановато: вряд ли R520 повторит судьбу NV30 в смысле непреодолимого отставания от своего конкурента как по скорости, так и по качеству изображения. На наш взгляд, худшим из возможных вариантов развития событий является примерный паритет чипа R520 по скорости и качеству с чипом G70 при отставании в сроке выхода на рынок где-то на полгода. Причем, вполне возможно, что R520 будет и более мощным чипом, чем G70, несмотря на то, что мы уже практически на 100% уверены, что число пиксельных конвейеров в R520 будет по-прежнему равным 16.

Впрочем, о слухах и спекуляциях — в заключительной главе нашей статьи.

NVIDIA

Если большинство событий в стане конкурента (за исключением, пожалуй, анонса Xbox 360) по разнообразным причинам оказались минорными, то NVIDIA в мае, июне и июле 2005 года без единого сбоя продолжала возвращать себе потерянный двумя годами ранее авторитет.

- Участие в анонсе приставки Sony PlayStation 3 (NVIDIA RSX)

- Анонс видеокарт GeForce 7800 GTX (G70)

- Продолжение эволюции NVIDIA SLI — новые видеокарты и возможности

- Появление в продаже видеокарт на базе чипа NV48

Участие в анонсе приставки Sony PlayStation 3 (NVIDIA RSX)

За пару часов до анонса MS Xbox 360 случилось еще одно сугубо консольное событие, которое неминуемо скажется и на рынке компьютерных игр: Sony решилась анонсировать PlayStation 3. Напомним читателям, что в декабре прошлого года NVIDIA объявила о заключении контракта с Sony на разработку видеосистемы консоли PlayStation 3 — что делает ее одним из ключевых участников всего проекта.

Итак, что нам известно про чип NVIDIA RSX, использующийся в PS3? Официально — довольно немного (большинство деталей закрыто NDA и предоставляется только разработчикам игр для новой консоли Sony). Так, достоверно известно, что чип RSX будет производиться по 90-нанометровому техпроцессу на фабрике Sony в Нагасаки. Известно, что чип RSX будет иметь выделенную 128-битную шину к 256 МБ памяти GDDR3, работающей на частоте 700 МГц (1400 МГц эффективная частота). Вместо интерфейса AGP/PCIE чип использует высокоскоростную шину FlexIO разработки Rambus с суммарной пропускной способностью 35 ГБ/с (20 ГБ/с CPU→GPU и 15 ГБ/с GPU→CPU). Заявленная частота работы чипа RSX — 550 МГц.

На этом официально разглашенная информация заканчивается (мифические цифры пиковой производительности на неопознанных операциях мы, если позволите, проигнорируем) и начинаются слухи и домыслы, судить о степени правдивости которых мы вам предлагаем самостоятельно.

По слухам, чип RSX есть ничто иное, как чип G70, портированный на 90нм техпроцесс, лишенный половины контроллеров памяти и оснащенный интерфейсом FlexIO вместо интерфейса PCIEx16. По слухам, Sony до последнего колебалась в своем решении заключить контракт с NVIDIA, из-за чего у NVIDIA не было времени на существенную переработку ПК-видеочипа G70 для консольного рынка (в частности, EDRAM-буфер был бы совсем не лишним для более устойчивой обратной совместимости с PS2; да и 256-битную шину памяти наверняка удалось бы сохранить, если бы хватило времени на вдумчивую разводку чипа). По все тем же слухам, изначально чип для PS3 должна была делать компания Toshiba, и назывался этот чип RS. Но после массы негативных отзывов со стороны разработчиков игр для PS3 и, думаем, после знакомства со спецификациями X360, Sony решила поменять производителя видеосистемы.

Если сложить все слухи вместе и вспомнить то, что мы писали о Xenos, то картина получается довольно интересная: обладая более высокой пиковой производительностью, RSX не имеет никаких существенных новшеств в области работы с памятью. Другими словами, для рендеринга в HDTV-разрешениях с AA чипу RSX может не хватить ПСП — особенно, если вспомнить, что шина памяти на RSX и вовсе 128-битная.

Продолжая сравнение, мы не можем не отметить заметно большую продвинутость чипа Xenos в функциональном плане: в то время как G70 (а, следовательно, если слухи не врут, и RSX) поддерживает лишь DX9 SM3, Xenos является «почти» DX10-чипом. При этом есть вероятность, что RSX будет работать заметно быстрее Xenos на DX9-коде, однако остается вопрос нехватки ПСП для MSAA в разрешениях 1280x720 и выше.

Разумеется, любое сравнение двух консолей по техническим характеристикам чисто условно: платформы слишком разные, чтобы можно было «тупо» сравнивать числа конвейеров, ПС шин и мегагерцы. Однако мы все же рискнем высказать следующее предположение: если Xenos более гибок, позволяет рисовать более сложные эффекты и при этом с легкостью обеспечивает антиалиасинг в любых разрешениях, RSX является монстром-дробилкой сравнительно простых шейдеров — но, эта «простота» должна быть сбалансирована так, чтобы видеочип не простаивал большую часть времени в ожидании записи результатов рендеринга в буфер кадра.

Опять же, позже мы напишем о PlayStation 3 более детально — следите за обновлениями нашего сайта ;-)

Анонс видеокарт GeForce 7800 GTX (G70)

Главным событием прошедших трех месяцев, несомненно, стал анонс видеокарт GeForce 7800 GTX, изготовляемых на базе нового чипа NVIDIA — G70. С подробнейшим обзором возможностей нового чипа, с показателями производительности видеокарты вы можете ознакомиться в посвященной этому статье под лаконичным названием NVIDIA GeForce 7800 GTX 256MB PCI-E.

Одним из приятных «нововведений» анонса GF7800GTX стала практически повсеместная доступность новых видеокарт едва ли не через неделю после их объявления — вспоминая муки рождения GF6800U и RX800XTPE, чувствуешь огромное удовольствие от немедленной доступности мощнейшей на сегодняшний день видеокарты.

Впрочем, причины подобного успеха NVIDIA не столь очевидны и даже отчасти случайны: попробуйте найти на рынке конкурента GF7800GTX. Что, нет конкурента? Вот то-то и оно.

Дело в том, что чип G70 был сделан NVIDIA довольно давно (на некоторых GF7800GTX стоят чипы, выпущенные аж в феврале этого года), но успешные продажи карт линейки GF6800 и отсутствие достойной конкуренции заставили NVIDIA ждать появления видеокарт на базе чипа R520. А он, как мы уже говорили, все никак не хочет появляться. NVIDIA ждала-ждала, но так и не дождалась — а побочным эффектом продолжительного ожидания и стала немедленная доступность видеокарт GF7800GTX в рознице.

Конечно, нельзя утверждать, что тут совсем не сказались ни многократно опробованный 110нм техпроцесс TSMC, ни проверенная и вылизанная архитектура NV4x, однако, на наш взгляд, главной причиной широкой доступности GF7800GTX все же стало неожиданное опоздание ATI, а не заслуги NVIDIA.

| Видеокарта | Ядро | Память | PP | VP | Шина | MSRP |

| GeForce 7800 GTX | 430+40 МГц | 256 МБ 600 МГц 256 bit GDDR3 | 24, PS3 | 8, VS3 | PCIE | 599 |

Вы наверняка заметили, что NVIDIA, вслед за ATI, пошла на повышение верхней планки MSRP аж до 599 USD. Но прежде чем рыдать и жаловаться на жадных капиталистов полезно вспомнить, по каким ценам реально продавались первые карты GF6800U, а затем посмотреть на розничные цены на GF7800GTX. Картина получается прелюбопытная: имея MSRP 499 USD, GF6800U едва ли не полгода продавалась по ценам 600-700 USD; GF7800GTX же при MSRP 599 USD уже сейчас, через месяц после начала продаж, можно найти по цене 600-700 USD. Другими словами, подобное «повышение» цены правильнее называть «приведением рекомендованной цены в соответствие реальности», чем повышением. Более того, на западе цены начинаются уже с 500 USD — на 100 USD ниже MSRP!

Что же принес чип G70 помимо вполне ожидаемых приростов производительности? По поддерживаемым функциям API чип остался прежним: DX9 SM3, отсутствие возможности делать MSAA для FP16-буферов, довольно квелая производительность динамических ветвлений в пиксельных шейдерах — в общем, полный аналог любого NV4x. Основные новшества G70 пришлись, как не странно, на качество антиалиасинга и на оптимизацию питания и энергопотребления.

Про новинки в области антиалиасинга подробно написано в нашем обзоре GF7800GTX: видеочип впервые обладает возможностью сглаживания прозрачных текстур с альфа-тестом; кроме того, «легализована» опция включения гамма-коррекции, доступная ранее пользователям видеокарт на чипах NV4x через правку реестра. Впрочем, согласно заявлениям NVIDIA, гамма-коррекция в чипе G70 реализована аппаратно, в то время как в линейке NV4x используется программная реализация, влияющая на производительность. Так ли это, мы проверим позже, в рамках другой статьи.

А про оптимизацию энергопотребления и писать ничего не нужно — достаточно посмотреть на фотографии видеокарты, чтобы увидеть, что, несмотря на возросшую частоту и сложность кристалла, NVIDIA отказалась от использования двухслотового кулера.

Наконец, нельзя не вспомнить об еще одной особенности чипа G70, которая открылась уже после появления в продаже карт GF7800GTX: об отдельных частотах для разных функциональных блоков чипа. Так, если пиксельные конвейеры (шейдерные АЛУ и ROP) в видеокарте GF7800GTX работают на частоте 430 МГц, то вершинные конвейеры используют частоту 470 МГц! При этом частоты пиксельных конвейеров и ROP изменяются с громадным шагом в 27 МГц, а выставленные пользователем значения округляются в меньшую сторону.

То есть, если вы выставите для чипа G70 частоту 450 МГц, то на практике вы получите частоту 459 МГц (432 default + 27 = 459); но в случае попытки выставить частоту 470 МГц, вы опять получите частоту 459 МГц, поскольку 459 + 27 / 2 = 473,5, то есть, частота пиксельных конвейеров изменится на «следующую», 486 МГц, только при превышении пользователем значения 473,5 МГц. Частота же работы геометрических конвейеров выставляется точно такой, как ее указывает пользователь, но BIOS всегда прибавляет к ней 40 МГц.

Пока не ясно, насколько будут свободны пользователи в регулировке частот чипа G70 (которых пока что обнаружено три: изменяющиеся синхронно частоты шейдерных АЛУ и частоты блоков ROP, а также частота вершинных конвейеров). Некоторые косвенные данные позволяют утверждать, что шаг в 27 МГц не является непреодолимым, и пиксельные конвейеры G70 можно тактовать с более высокой точностью. Кроме того, возможно, что всеми обнаруженными частотами можно управлять независимо: выставлять разные, никак не связанные друг с другом частоты для шейдерных АЛУ, ROP и вершинных конвейеров.

Впрочем, интересна подобная функциональность исключительно теоретически. Например, возможность независимо повысить частоту работы ROP позволила бы провести ряд любопытных тестов того, насколько G70 упирается в производительность ROP, число которых осталось неизменным со времен выхода NV40.

Продолжение эволюции NVIDIA SLI — новые видеокарты и возможности

События вокруг и около NVIDIA SLI можно охарактеризовать фразой «вижу цель!» :-) Анонс ATI технологии CrossFire позволил NVIDIA найти хоть какую-то точку отсчета в работах над SLI и немедля приняться за устранение недостатков технологии в сравнении с предложением канадской компании.

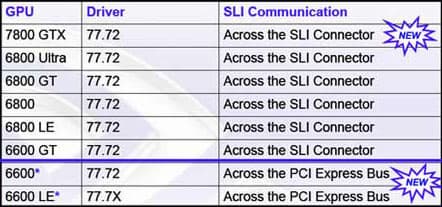

Думаем, упоминать о поддержке SLI объявленным в конце июня видеочипом G70 бессмысленно. А вот о возможности создавать SLI-конфигурации из двух видеокарт без SLI-коннекторов упомянуть стоит. Впервые подобная возможность была реализована в драйвере 77.72 для видеокарт GF6600 (что, впрочем, не мешает на этих драйверах работать без SLI-коннектора любым поддерживающим SLI видеокартам). Драйвер 77.76 добавил поддержку SLI для новых видеокарт GF6600LE (о выпуске которых мы даже писать не стали — это те же самые GF6200 на базе чипа NV43 под новым названием, главное и единственное отличие которых — поддержка для них SLI на уровне драйверов).

Мера, разумеется, вынужденная — у видеокарт GF6600 попросту нет SLI-коннекторов, а сделать громкую и хвастливую технологию SLI доступной и для самых бедных пользователей NVIDIA очень уж хочется.

Возникает вопрос — почему этого же не сделала ATI? Зачем городить сложные DVI-соединения? Здесь две причины. Во-первых, SLI без коннектора ощутимо менее эффективно, чем обычное SLI, поскольку трафик по синхронизации работы карт и передаче отрендеренных кадров ложится на системную PCIE-шину. Во-вторых, у старых чипов ATI нет никакой поддержки CF — в отличие от абсолютно всех чипов NV43, содержащих прямо на кристалле блок, отвечающий за SLI.

Следующим значительным событием в области SLI стала презентация SLI AA — практически прямого ответа на хитрые режимы антиалиасинга, представленные ATI в CrossFire. Тонкая ирония ситуации заключается в том, что SLI AA доступен всем владельцам SLI-систем непосредственно после выпуска бета-версии драйверов 77.76, в то время как ATI CrossFire в продаже пока что не появилась...

Идею NVIDIA позаимствовала у ATI, снабдив ее собственными доработками и адаптировав под возможности чипов NV4x/G70. В режиме SLI AA, как и у ATI CF, отсутствует прирост производительности от использования SLI — обе карты рассчитывают каждый кадр целиком. За счет небольшого сдвига геометрических координат (не больше, чем на четверть пикселя в SLI AA 8x и еще меньше в SLI AA 16x) при объединении двух кадров сэмплы приходятся на разные места решетки, за счет чего и получается пресловутый антиалиасинг:

Опытный пользователь сразу заметит, что SLI AA 8x есть ничто иное, как MSAA 4x + MSAA 4x, в то время как SLI AA 16x это 8xS + 8xS.

Решетки, заметим, в обоих случаях получаются довольно страшненькие и весьма далекие от эффективных, что вызвано жесткостью шаблонов выборки значений на чипах NV4x/G70 и отсутствием возможности взять больше 4 значений в режиме MSAA. Вместе с тем, режим SLI AA 16x «численно» превосходит максимальный режим AA ATI CrossFire — MSAA 6x + MSAA 6x. При случае мы обязательно проверим, какой из режимов обладает более высоким качеством.

От себя, впрочем, заметим, что в настоящее время разница по качеству в режимах выше MSAA 4x плавно стремится к нулю — особенно, если речь идет о динамичных играх. И если режим 8xS на GeForce еще имеет свою собственную, отдельную ценность (сглаживание текстур и «побочная» анизотропная фильтрация), то искать отличия режима 6x от 4x на картах ATI приходится буквально с лупой. Поэтому нам трудно сказать, есть ли вообще какой-то смысл во всех этих безумных режимах, вроде ATI CF 14x или NV SLI 16x...

Раззадоренная анонсом CrossFire NVIDIA решила на этом не останавливаться и пообещала, что в новых драйверах (начина с версии 77.62) сделает возможным объединение в SLI одинаковых карт от разных производителей (раньше карты должны были быть полностью идентичными — включая версии BIOS); со временем будет дозволено разгонять карты независимо друг от друга; а в перспективе возможно разрешение SLI на материнских платах со слотами PCIE x16 + PCIE x4. В общем, анонс ATI CrossFire определенно удался в смысле ответа на него со стороны NVIDIA :-)

Затем, некоторые производители пораскинули мозгами и решились выпустить двухчиповые карты на базе NV45, о которых мы упоминали в прошлой статье. В частности, разродились ASUS (ASUS Dual 6800GT, прототип которой вы могли видеть в прошлой статье цикла) и Gigabyte (Gigabyte 3D1-68GT):

Де-факто подобные карты являются все тем же SLI, причем, не без своих проблем с совместимостью — сказываются как физические размеры подобных плат (тут, кстати, неожиданно отличилась Gigabyte, сделавшая довольно вменяемую по масштабам PCB), так и особенности поддержки SLI в драйверах NVIDIA.

Однако автора этих строк не покидает ощущение, что производители опоздали: кому сейчас нужны эти шумные, прожорливые монстры с кучей проблем с совместимостью, если одна единственная GF7800GTX при аналогичной стоимости обеспечивает такой же или даже более высокий уровень производительности, да еще и предлагает ряд улучшений качества антиалиасинга? Зачем вообще выпускались эти карты? Единственное разумное предположение заключается в том, что карты эти разрабатывались с оглядкой на G70 — и если это так, то в скором времени мы можем получить подобные тандемы на базе нового чипа NVIDIA. Хотя трудно себе даже представить стоимость подобных чудовищ.

Появление в продаже видеокарт на базе чипа NV48

Последним событием в стане NVIDIA, которое мы не можем не упомянуть в нашей статье, стало «тихое» появление в продаже видеокарт на базе чипа NV48, о котором мы пространно и, как выяснилось, неправильно рассуждали в прошлом тексте.

Итак, NV48 — это все тот же «старый-добрый» NV40, банально портированный на конвейер TSMC, причем, пока не понятно какой — 130нм или все-таки 110нм. Другими словами, NVIDIA целиком и полностью отказалась от услуг IBM в области изготовления чипов, и все новые чипы NVIDIA будут производиться у TSMC.

Любопытна также судьба GF6800GT PCIE — если GF6800U PCIE заменят на видеокарты линейки GF7800, а в AGP-секторе будут выпускать NV48, то будут ли они использовать чип NV48 для изготовления GF6800GT PCIE? Вопрос пока открыт.

Текущие линейки видеокарт

Прежде чем перейти к разговору о перспективах 3D-видео на ближайшие два-три месяца, давайте сведем воедино все изменения линеек, о которых мы говорили выше, и посмотрим на предложение двух лидирующих компаний по разным графическим шинам.

Линейки видеокарт ATI и NVIDIA, июль 2005 года

| Диапазон цен, USD | ATI | NVIDIA |

| Шина PCI Express x16 | ||

| >500 | CF-конфигурации Radeon X850 XT PE (R480) | SLI-конфигурации GeForce 7800 GTX (G70) |

| 300-500 | Radeon X850 XT (R480) Radeon X850 Pro (R480) Radeon X800 XL (R430) | GeForce 6800 Ultra (NV45) GeForce 6800 GT (NV45) |

| 150-299 | Radeon X800 XL (R430) Radeon X800 (R430) Radeon X700 Pro (RV410) | GeForce 6800 (NV41/42) GeForce 6800 LE (NV41/42) GeForce 6600 GT (NV43) |

| 80-149 | Radeon X700 (RV410) Radeon X600 XT (RV380) Radeon X600 Pro (RV380) | GeForce 6600 (NV43) GeForce 6600 LE (NV43) GeForce 6200 (NV43) GeForce 6200 TC (NV44) |

| <80 | Radeon X550 (RV370) Radeon X300 (RV370) Radeon X300 SE (RV370) Radeon X300 SE HM (RV370) | GeForce 6200 TC (NV44) GeForce PCX 5750 (NV36+мост) GeForce PCX 5300 (NV34+мост) |

| Шина AGP 8x | ||

| >500 | Radeon X850 XT PE (R481) | — |

| 300-500 | Radeon X850 XT (R481) Radeon X850 Pro (R481) | GeForce 6800 Ultra (NV40) GeForce 6800 GT (NV40/48) |

| 150-299 | Radeon X800 XL (R430+мост) Radeon X800 (R430+мост) Radeon X700 Pro (RV410+мост) Radeon 9800 Pro (R350) | GeForce 6800 (NV40/48) GeForce 6800 LE (NV40/48) GeForce 6600 GT (NV43+мост) |

| 80-149 | Radeon 9800 SE (R350) Radeon 9600 XT (RV360) Radeon 9600 Pro (RV350) Radeon 9600 (RV350) | GeForce 6600 (NV43+мост) GeForce 6200 (NV43+мост) GeForce 6200 (NV44A) |

| <80 | Radeon 9550 (RV370) Radeon 9250 (RV280) | GeForce 5700 LE (NV36), GeForce 5500 (NV34), GeForce 5200 (NV34) |

Ближайшее будущее рынка

Разобравшись с сегодняшней ситуацией на рынке, приступим к самому вкусному — спекуляциях о его ближайшем будущем :-) Начнем опять с продукции компании ATI.

ATI

Гадать здесь особенно не о чем — ближайшим событием должен стать анонс видеокарт на долгожданном чипе R520. За прошедшие месяцы удалось более-менее окончательно определиться со спецификациями этого чипа, хотя мы по-прежнему не исключаем того, что ошибаемся:

- 90нм TSMC (low-k);

- 250-275 млн транзисторов;

- 16 пиксельных конвейеров;

- 8 вершинных конвейеров;

- соответствие требованиям DX9 SM3 (FP32);

- частота работы ядра в диапазоне 600–700 МГц.

Предположительно R520 поддерживает FP16-блендинг, что позволит без особенной головной боли (и потери производительности на дополнительные расчеты в пиксельных шейдерах) реализовывать на R520 FP16 HDR, как это уже больше года делается на чипах NV4x/G70. Приятным дополнением должны стать полностью ортогональные к формату буфера кадра ROP, что позволит R520 осуществлять MSAA в случае использования FP16 HDR — подобная функция отсутствует у NV4x/G70. Впрочем, остается вопрос практической полезности подобного антиалиасинга: скоростные показатели G70 в режиме HDR в Far Cry и SC: Chaos Theory ставят под сомнение возможность дальнейшего снижения производительности — она и так довольно скромная.

Вполне очевидно, что R520 будет поддерживать CrossFire, причем, не исключаем отказа ATI от внешнего DVI-соединения в пользу специального коннектора, как у NV SLI. Более того, рискнем предположить, что CrossFire (материнские платы и видеокарты CrossFire Edition) реально появится в продаже не раньше выпуска карт на чипе R520. Дело в том, что даже два Radeon X850 XT PE сегодня обеспечивают уровень производительности сопоставимый с одной GeForce 7800 GTX, а потому смысл их вывода на рынок практически теряется — они вчистую проигрывают конкуренцию гораздо более дешевому и поддерживающему больше функций решению от NVIDIA.

Итак, у ATI все упирается в анонс R520. Когда же случится это долгожданное событие? Слухи ходят довольно разнообразные. Мы можем лишь констатировать, что дата 26 июля, на которую был намечен анонс карт на базе R520 до того, как появились карты GF7800GTX, уже миновала, а это значит, что анонс опять отложен на более поздний срок. Когда? Скорее всего, на конец августа или даже на первую половину сентября. Причем, есть определенные сомнения насчет способности ATI и ее партнеров обеспечить столь же массовое предложение карт на базе R520 через пару недель после анонса, как это сделала NVIDIA с чипом G70.

Что будет дальше? После анонса R520 должны последовать анонсы чипов RV515 и RV530 — бюджетных вариантов новой архитектуры ATI. Пока что рано думать об их характеристиках, но, полагаем, можно смело предположить, что эти чипы сохранят все функции своего старшего брата — R520. Также, согласно имеющейся информации, чип RV530 будет первым чипом ATI, обладающим функцией удвоенной скорости записи результатов в Z/S-буфер в случае отсутствия MSAA — подобно почти всем чипам NVIDIA, начиная с NV30. Чип RV515 займет самую нижнюю строчку в новой линейке видеочипов ATI, заменив собой всевозможные RV3x0.

Затем ATI должна представить нового флагмана — чип R580. О сроках появления этого чипа судить пока рановато: называются самые разнообразные даты, от осени этого года (и чуть ли не совместно с анонсом сильно задержавшегося R520) до весны 2006. Понятно, что в таких условиях глупо рассуждать о спецификациях, однако мы все же рискнем высказать ряд предположений. Так, чип R580, скорее всего, сохранит 16-конвейерную архитектуру, но его шейдерные АЛУ подвергнутся существенной переработке, что в итоге приведет к заметно большей эффективности R580 по сравнению с R520 при исполнении кода, изобилующего шейдерами версий 2.0 и 3.0. Также вполне логичным выглядит предположение о дальнейшем развитии архитектуры R300 (напомним, что все сегодняшние ПК-видеочипы ATI в той или иной мере являются развитием чипа R300; из этого списка пока выпадает лишь приставочный Xenos, использующий действительно новую архитектуру). Вероятнее всего, R580 также будет DX9 SM3-чипом.

Заглядывать дальше уже опасно — чипы серии R6x0 должны соответствовать базовым требованиям по поддержке DX10 и обладать схожей с ATI Xenos архитектурой. Появления этих чипов следует ждать во второй половине следующего года, вместе с выходом в продажу Windows Vista, ранее известной как Longhorn ;-)

NVIDIA

В ближайших планах конкурента значится выпуск новых видеокарт на базе уже знакомого нам чипа G70 — почти гарантированно можно ожидать появления в августе видеокарты GeForce 7800 GT, призванной заменить на магазинных полках бывшего лидера — GeForce 6800 Ultra (соответственно, MSRP будет, видимо, равна 499 USD). Уже озвучены примерные характеристики новинки: 20 пиксельных конвейеров, 7 вершинных и частота ядра 400 МГц. Предварительные тесты показывают, что G70 в подобной конфигурации находится где-то посередине между GF7800GTX и GF6800U по показателям производительности.

Кроме того, нельзя забывать о потенциальной возможности NVIDIA выпустить более быструю видеокарту на базе чипа G70 — это позволяет как зафиксированный обозревателями разгонный потенциал видеокарт GF7800GTX, так и довольно скромная система охлаждения этих видеокарт. Подобная GeForce 7800 «Ultra» могла бы работать на частотах порядка 500 МГц. Впрочем, необходимость выпуска такой видеокарты будет определяться успехами ATI R520 в противостоянии с GF7800GTX.

Ближайшим же новым чипом NVIDIA должен стать G72, упоминания о котором уже появились в новейших бета-версиях драйверов ForceWare. По имеющейся у нас информации G72 должен занять положение между G70 и NV43, заменив собой остатки NV45 и NV42 в секторе PCIE. Впрочем, достоверность этой информации в данный момент вызывает массу сомнений.

Как бы там ни было, вполне очевидно, что в ближайшие полгода NVIDIA заменит все чипы NV4x на новинки из линейки G7x. Предположительно, по мере снижения производительности чипы займут следующий порядок: G70 > G72 > G74. Кроме того, NVIDIA планирует представить чип G71, сведения о котором пока что довольно противоречивы.

Еще одним немаловажным для NVIDIA событием должен стать выпуск драйверов ForceWare 80-й серии. Помимо вполне возможных оптимизаций производительности рекомпилятора шейдеров для чипов линейки G7x, драйверы серии 80 могут привнести любопытный механизм распределения обработки вершинных шейдеров между GPU и простаивающим CPU, что будет совсем не лишним для новых двуядерных CPU, одно ядро в которых довольно продолжительное время будет бесполезным в игровых приложениях.

Продолжение следует

На этой ноте позвольте объявить о завершении третьей статьи нашего цикла :-) Следующий обзор событий на рынке 3D-видео для ПК вы сможете прочитать на сайте iXBT.com уже этой осенью. Мы надеемся, что к тому времени ATI наконец-то разродится чипами серии R5x0, NVIDIA предложит новинки поколения G7x и — чем черт не шутит — возможно, из добровольной комы выйдут S3, Matrox или XGI?