Новый однопроцессорный флагман 3D-графики игрового класса

Содержание

- Часть 1 — Теория и архитектура

- Часть 2 — Практическое знакомство

- Часть 3 — Результаты игровых тестов (производительность)

Несмотря на самые мрачные прогнозы, предвещающие рынку ПК тяжелые времена, бизнес продолжается и даже развивается. Пусть в IT-индустрии доля, выпадающая на производство комплектующих для ПК, уменьшается, но она еще очень велика, да и не упадет так катастрофично, как уже кричат истеричные аналитики и псевдоэксперты. Выпуск новинок для этого сегмента рынка был, есть и будет.

И вот сегодня мы будем изучать новый флагман Nvidia — однопроцессорное решение, призванное не только победить всех конкурентов среди ускорителей с одним GPU, но и вплотную приблизиться к производительности нынешних двухпроцессорных королей. Почему «королей», а не «короля» (в условиях официального выпуска только одного продукта — Geforce GTX 690)? Потому что уже есть Asus ARES II (два Radeon HD 7970 GHz на одной плате), да и официальный выпуск Radeon HD 7990 очень близок. Итак, о новинке расскажет Алексей Берилло.

Часть 1: Теория и архитектура

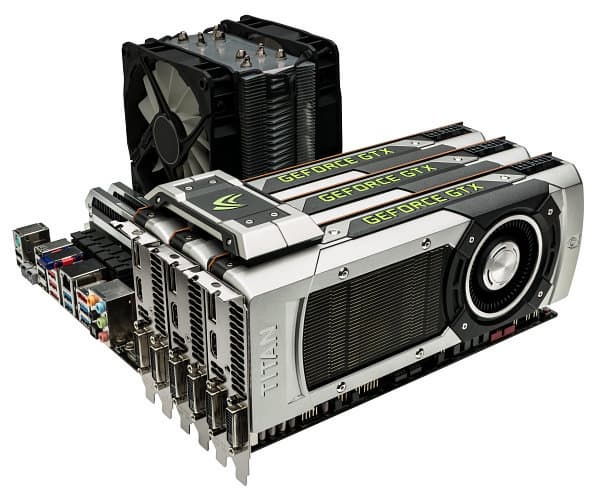

Ну вот мы и дождались настоящего топового решения компании Nvidia. Анонсированная недавно модель Geforce GTX Titan, которую мы сегодня рассматриваем, основана на самом мощном графическом процессоре и предназначена для экстремальных игровых ПК максимальной мощности. Компания Nvidia делает серьезную ставку на энтузиастов, предполагая широкое распространение и многочиповых систем, в том числе 3-way SLI из трех видеокарт Geforce GTX Titan, но также предполагается и применение новой модели в компактных игровых ПК — так называемых моделях small form factor (SFF).

Новая видеокарта базируется на долгожданном графическом чипе Nvidia GK110, который еще давно должен был стать основой топовых решений компании, но по некоторым причинам так и не стал. В свое время представители Nvidia высказывались на тему того, что на рынке игровых видеокарт для успешной конкуренции им хватит и графического процессора, предназначавшегося изначально для верхнего/среднего ценового уровня — GK104. Собственно, практика показала, что они не ошиблись, Geforce GTX 660 Ti, GTX 670 и GTX 680 успешно конкурировали с предложениями AMD на рынке видеокарт, а двухчиповая GTX 690 стала быстрейшей видеокартой вообще.

Но время шло, конкурент успел вывести на рынок свое наиболее мощное одночиповое решение — Radeon HD 7970 GHz, и Nvidia все-таки решила выпустить решения на базе GK110 и на игровой рынок. Ранее такие платы вышли для профессиональных применений в неграфических вычислениях в виде продуктов серии Tesla, а теперь и время Geforce подошло. Вероятно, и с производством сложных чипов на TSMC стало попроще, да и заинтересовывать застоявшийся рынок какими-то новыми продуктами нужно, даже если у них нет конкурентов.

Естественно, что у Nvidia получилась весьма производительная видеокарта. Если немного забежать вперед, то можно выделить, что чип GK110 отличается огромной вычислительной мощью, он включает 14 мультипроцессоров SMX, содержащих 2688 потоковых вычислительных ядер, что в итоге дает пиковую производительность до 4,5 терафлопс для расчетов с одинарной точностью (FP32) и до 1,3 терафлопс для расчетов с двойной точностью (FP64). Но возросли не только вычислительные способности, Geforce GTX Titan также имеет 6 гигабайт видеопамяти, соединенной с GPU при помощи 384-битной шины памяти, что дает возможность использования сверхвысоких разрешений и максимальных уровней полноэкранного сглаживания, а также максимальных графических настроек в любых приложениях.

Кроме этого, для Geforce GTX Titan была улучшена технология GPU Boost, получившая в итоге версию 2.0, а также разработано новое высокоэффективное устройство охлаждения, которое отличается улучшенными акустическими характеристиками. Обещается, что все это обеспечивает не только высочайшую производительность, но и тихую работу при высокой энергоэффективности. Но давайте обо всем по порядку…

Так как рассматриваемая сегодня видеокарта Nvidia основана на базе графического процессора архитектуры «Kepler», о которой мы уже не раз подробно рассказывали и которая близка к родственной архитектуре «Fermi», то читателям будет полезно ознакомиться со статьями и о более ранних моделях графических решений компании:

- [31.10.12] Nvidia Geforce GTX 650 Ti — соперник GTX 560, значительно опережающий GTX 550 Ti

- [13.09.12] Nvidia Geforce GTX 660 — хороший добротный современный середнячок

- [10.05.12] Nvidia Geforce GTX 670 — 7/8 от однопроцессорного лидера GTX 670: много это или мало?

- [22.03.12] Nvidia Geforce GTX 680 — новый однопроцессорный лидер 3D-графики

- [09.11.10] Nvidia Geforce GTX 580 — новый король 3D-графики на закате 2010 года

- [27.03.10] Nvidia Geforce GTX 480 — архитектура нового графического процессора изнутри; как реализована поддержка DirectX 11

А сейчас давайте рассмотрим подробные характеристики недавно анонсированной видеоплаты Geforce GTX Titan, основанной на топовом графическом процессоре GK110.

Графический ускоритель Geforce GTX Titan

- Кодовое имя чипа GK110;

- Технология производства 28 нм;

- 7,1 миллиардов транзисторов;

- Унифицированная архитектура с массивом процессоров для потоковой обработки различных видов данных: вершин, пикселей и др.;

- Аппаратная поддержка DirectX 11 API, в том числе шейдерной модели Shader Model 5.0, геометрических и вычислительных шейдеров, а также тесселяции;

- 384-битная шина памяти, шесть независимых контроллеров шириной по 64 бита каждый, с поддержкой GDDR5-памяти;

- Частота ядра 836 (турбочастота — 876) МГц;

- 15 потоковых мультипроцессоров, включающих 2880 скалярных ALU для расчетов с плавающей запятой одинарной точности (FP32) и 960 скалярных ALU для расчетов двойной точности (FP64) в рамках стандарта IEEE 754-2008;

- 240 блоков текстурной адресации и фильтрации с поддержкой FP16- и FP32-компонент в текстурах и поддержкой трилинейной и анизотропной фильтрации для всех текстурных форматов;

- 6 широких блоков ROP (48 пикселей) с поддержкой режимов сглаживания до 32 выборок на пиксель, в том числе при FP16- или FP32-формате буфера кадра. Каждый блок состоит из массива конфигурируемых ALU и отвечает за генерацию и сравнение Z, MSAA, блендинг;

- Интегрированная поддержка RAMDAC, двух портов Dual Link DVI, а также HDMI и DisplayPort;

- Интегрированная поддержка 4 мониторов, включая два порта Dual Link DVI, а также HDMI 1.4a и DisplayPort 1.2;

- Поддержка шины PCI Express 3.0.

Спецификации референсной видеокарты Geforce GTX Titan

- Частота ядра 836 (876) МГц;

- Количество универсальных процессоров 2688;

- Количество текстурных блоков — 224, блоков блендинга — 48;

- Эффективная частота памяти 6000 (1500×4) МГц;

- Тип памяти GDDR5, 384-битная шина памяти;

- Объем памяти 6 ГБ;

- Пропускная способность памяти 288,4 ГБ/с;

- Вычислительная производительность (FP32/FP64) 4,5/1,3 терафлопс;

- Теоретическая максимальная скорость закраски 40,1 гигапикселей в секунду;

- Теоретическая скорость выборки текстур 187,3 гигатекселей в секунду;

- Два разъема Dual Link DVI-I, один mini HDMI, один DisplayPort 1.2;

- Шина PCI Express 3.0;

- Энергопотребление до 250 Вт;

- Один 8-контактный и один 6-контактный разъемы питания;

- Двухслотовое исполнение;

- Рекомендуемая цена для рынка США — $999 (для России — 34990 руб).

Nvidia отошла от своего принципа наименования видеокарт для Titan, но в подобной эксклюзивной модели вполне можно пойти на такой шаг. Единственная исключительная модель получила слово, а не цифры в конце названия, что отличает новинку от всех видеокарт линейки Geforce GTX 600. Ускоритель вычислений Nvidia Tesla K20X также основан на наиболее мощном чипе семейства Kepler, содержащем 2688 вычислительных CUDA-ядер, и вообще — это почти что близнец вышедшей игровой карты на этом же GPU, который применяется в быстрейшем суперкомпьютере мира под названием Titan. Поэтому неудивительно, что Nvidia решила назвать свою игровую карту Geforce GTX Titan, чтобы рынок ассоциировал их игровые решения с успешными суперкомпьютерными.

На рынке Geforce GTX Titan не заменяет никакую модель видеокарты в линейке компании Nvidia, а будет сосуществовать с двухчиповой Geforce GTX 690 в самых верхних ее строчках. Модель GTX 690 будет продолжать производиться и продаваться, так как эти две видеокарты друг другу ничуть не мешают — они очень разные. Geforce GTX 690 лучше подходит для одних целей, когда важен максимальный FPS, несмотря на объективные недостатки мультичипового AFR-рендеринга, а Titan лучше подойдет в качестве универсального решения с большим объемом локальной памяти и быстрым к ней доступом, что скажется в сверхвысоких разрешениях. Кроме того, Titan компактнее и требует меньше энергии, поэтому подойдет для большего количества систем, а еще он тише и предлагает дополнительные возможности вроде GPU Boost 2.0 и полноскоростных вычислений с двойной точностью.

Что касается решений конкурента — компании AMD — то вполне понятно, что новая Geforce GTX Titan осталась без прямого соперника. У AMD просто нет чипов такой сложности, да даже и официальной двухчиповой платы на менее сложных пока что не существует, хотя партнеры компании и предлагают подобные модели, в т. ч. совсем уж экстремальные варианты, вроде Asus Ares II с тремя 8-контактными (!!!) разъемами питания. Прямого соперника для Titan в линейке Radeon HD 7000 можно и не ждать, хотя официальная двухчиповая модель вроде Radeon HD 7990 все же ожидается.

В отличие от предыдущих быстрейших видеокарт на базе одного GPU компании Nvidia последнего поколения, Titan сделан на базе чипа GK110 и имеет 384-битную шину памяти. Поэтому объем установленной на нее видеопамяти теоретически мог быть равен 3 или 6 ГБ. В случае столь дорогой и элитной модели установка 6 ГБ памяти совершенно оправдана, хотя из практических соображений было бы вполне достаточно и 3 ГБ. Но ведь это ровно как у лучших моделей конкурента, ставить с которыми Titan на одну полку Nvidia явно не хочет. Ну и для серьезных вычислений объем в 6 ГБ может быть вполне актуальным. Так что даже в условиях самых требовательных приложений и максимальных настроек качества с полноэкранным сглаживанием любого уровня видеопамяти у Titan всегда хватит.

Конструкция платы и системы охлаждения

Длина платы Geforce GTX Titan — 10,5 дюймов (267 мм), для питания она использует один 8-контактный и один 6-контактный разъемы от блока питания. Для вывода изображения используется стандартный набор из двух разъемов Dual-Link DVI, одного HDMI и одного разъема DisplayPort.

Дизайн корпуса Geforce GTX Titan схож с дизайном другой топовой видеокарты Nvidia — Geforce GTX 690. Выглядит плата в целом очень солидно, и качество сборки и материалов на уровне. Понятно, что для премиум-сегмента принято использовать соответствующие материалы, и инженеры Nvidia решили накрыть конструкцию «Титана» алюминиевой крышкой. В центре крышки есть прозрачное пластиковое окно, открывающее пытливому взору чудесный вид на испарительную камеру и двухслотовый алюминиевый радиатор, участвующий в охлаждении чипа GK110.

Логотип Geforce GTX на боковом торце видеокарты имеет светодиодную подсветку. Она служит также индикатором включения, а интенсивность подсветки светодиодами можно отрегулировать вручную, используя специальное ПО от партнеров Nvidia. Можно даже настроить светодиоды так, чтобы интенсивность их свечения изменялась в зависимости от нагрузки на GPU.

Так как Geforce GTX Titan спроектирован и предназначен для энтузиастов и любителей выжать из системы все до последнего, это не могло не сказаться на некоторых технических решениях, примененных в конструкции. Сам чип GK110 снабжает энергией 6-фазная схема питания с защитой от перенапряжения, а дополнительная схема с двумя фазами используется для питания GDDR5 видеопамяти. 6+2-фазная схема обеспечивает плату питанием даже с учетом возможного разгона, процесс которого стал еще легче благодаря возможности повышения напряжения (читайте об этом ниже). К слову, сама Nvidia уверяет, что при стандартном охлаждении для графического процессора возможно достижение тактовой частоты выше 1 ГГц.

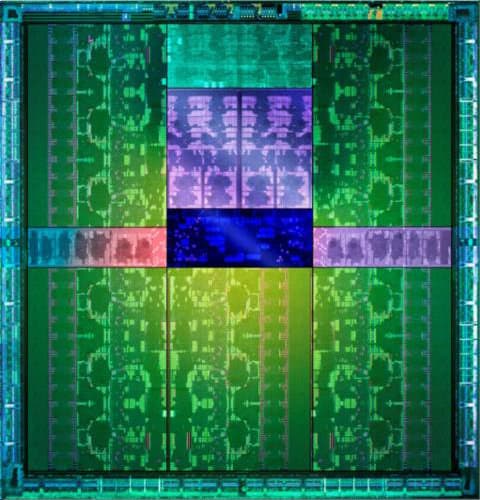

Для своей новой видеокарты высшего класса инженеры Nvidia разработали новую систему охлаждения, которая отличается высокой эффективностью. В кулере используется технология испарительной камеры, которая отлично рассеивает тепло, были увеличены ребра радиатора, а также в очередной раз улучшена схема управления вентилятором, изменяющая рабочее напряжение и частоту его вращения для достижения оптимального сочетания акустического и температурного режимов.

Медная испарительная камера в кулере Geforce GTX Titan работает как тепловая трубка, но она более мощная и эффективная. Кроме того, для улучшения работы камеры используется новый материал термоинтерфейса от компании Shin-Etsu, который обеспечивает двукратное преимущество перед тем, что применялся ранее в Geforce GTX 680. В результате, новая испарительная камера и термоинтерфейс позволяют отводить больше тепла от GK110, давая возможность работы на более высокой тактовой частоте.

Тепло от испарительной камеры отводится при помощи большого двухслотового радиатора из алюминиевого сплава. По сравнению с предыдущими решениями линейки Geforce GTX 600, в кулере Titan применяются удлиненные ребра радиатора, что увеличивает площадь рассеивания и повышает его эффективность. На Geforce GTX Titan также установлена алюминиевая пластина с обратной стороны, которая дополнительно охлаждает печатную плату и компоненты на ней. В конструкции вентилятора используются те же демпфирующие материалы, что и в Geforce GTX 680 — они служат для снижения уровня шума.

К слову, о шуме. Nvidia приводит цифры собственных акустических замеров, но не для одночиповых видеосистем, а для экстремальных многочиповых — чтобы разница была ощутимей. Так вот, при запуске бенчмарка Unigine Heaven в разрешении 1920×1080 с полноэкранным сглаживанием и экстремальным уровнем тесселяции различные системы на базе трех видеокарт показали следующий уровень шума:

Как видите, кулер Geforce GTX Titan справляется с работой просто отлично. Мало того, что работа трех GK110 должна обеспечивать заметно более высокую производительность (об это читайте далее), так эти три видеокарты GTX Titan еще и тише работают, по сравнению как с тремя GTX 680, так и с тремя Radeon HD 7970. Причем, если замеры корректны, разница в шуме между лучшими решениями AMD и Nvidia должна быть просто колоссальной!

Графическая архитектура

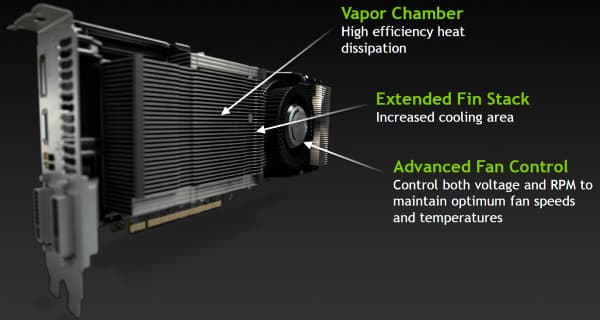

Новая модель Geforce GTX Titan основана на базе самого сложного видеочипа Nvidia, да и вообще в мире. Интересно, что первое практическое применение процессор GK110 впервые получил в суперкомпьютере Окриджской национальной лаборатории, который получил имя собственное — Titan. Еще в ноябре прошлого года этот суперкомпьютер был включен в «суперкомпьютерный» список TOP500 как самое быстрое подобное устройство. Всего в конструкции Titan используется 18668 профессиональных вычислительных систем Nvidia Tesla K20X, что позволило суперкомпьютеру показать рекордный результат в 17,59 петафлопс (речь о вычислениях двойной точности) в общепризнанном тесте Linpack.

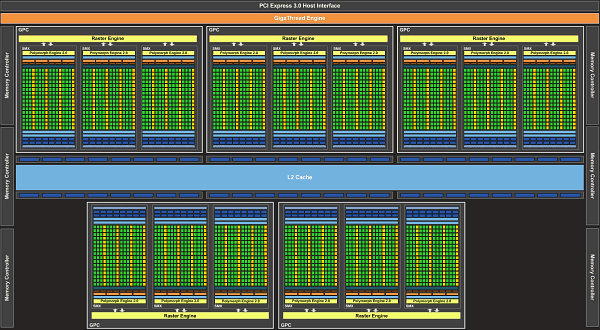

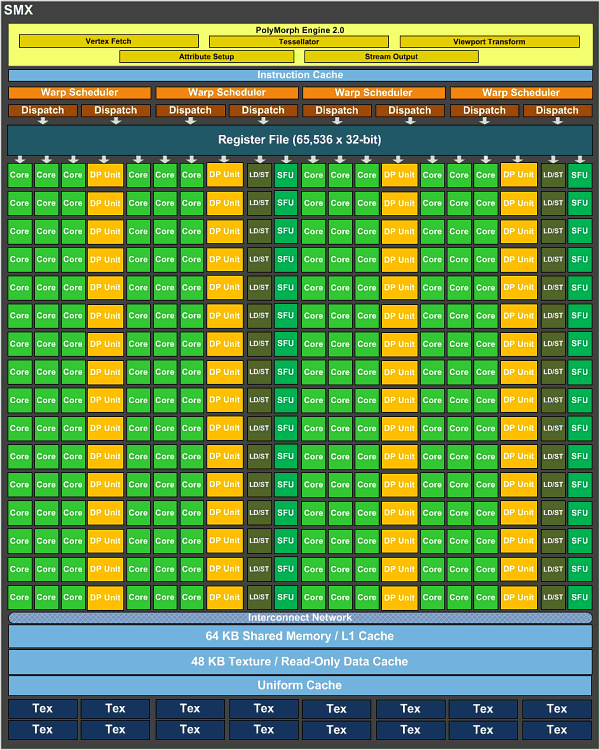

Топовый GPU компании поддерживает все возможности, появившиеся в GK104 (Geforce GTX 680), и все особенности архитектуры Kepler относятся и к нему, включая организацию мультипроцессоров SMX, хотя есть и явные отличия. Графический процессор GK110 имеет в своем составе пять (нечетное число, что необычно) кластеров графической обработки Graphics Processing Cluster (GPC), состоящих из трех (снова нечетное!) мультипроцессоров SMX каждый, то есть схема 5×3, в отличие от схемы 4×2 для GK104. Видимо, при схеме 8×2 чип получался слишком сложным. Для наглядности рассмотрим диаграмму топового чипа:

Кроме нечетных чисел, вроде бы все почти привычно для Kepler — примерно те же мультипроцессоры SMX, но есть отличия. Как и GK104, GK110 состоит из мультипроцессоров SMX, содержащих по 192 вычислительных блока (самые маленькие зеленые квадратики), но что это за оранжевые блоки в количестве 64 штуки на каждый SMX? Таким образом Nvidia выделяет ALU, способные вычислять с двойной точностью (FP64), в отличие от FP32-точности «зеленых». Это основное отличие устройства SMX в GK110 от всех других чипов.

В остальном все ровно так же, как и в GK104, каждый SMX имеет по движку PolyMorph Engine, 64 КБ общей памяти, 48 КБ текстурной кэш-памяти и по 16 блоков текстурной фильтрации (всего 240 TMU в чипе физически). Подсистема памяти GK110, лежащего в основе Geforce GTX Titan, содержит шесть 64-битных каналов памяти, что в сумме дает 384-битный доступ к ней. И так как блоки растровых операций ROP «привязаны» к контроллерам памяти, то их количество в данном GPU равно 48 блокам. Объем кэш-памяти второго уровня на весь чип составляет 1,5 МБ.

Как мы уже писали, объем локальной GDDR5 видеопамяти для Titan равен 6 ГБ. Столь огромный даже по нынешним меркам объем памяти явно предназначен для энтузиастов. Компания Nvidia неоднократно получала запросы об увеличенном объеме памяти от пользователей — они хотят еще более высокой производительности в высоких разрешениях с применением нескольких мониторов в современных играх и проектах будущего. Пожалуй, в случае продукта премиум-класса и такой объем памяти вполне оправдан. А практически он может понадобиться разве что в расчетных GPGPU-задачах да при появлении первых мультиплатформенных игр, предназначенных для будущего поколения консолей, которые будут иметь довольно большой объем памяти. 6 ГБ памяти с 384-битным интерфейсом должны дать Geforce GTX Titan все необходимое для достижения высокой частоты кадров во всех возможных играх и условиях, даже в ближайшие годы.

Как и другие старшие модели, Geforce GTX Titan поддерживает фирменную технологию GPU Boost, теперь уже второй версии (подробнее см. ниже). Это комбинация программно-аппаратных решений, позволяющая автоматически увеличивать рабочие частоты GPU в зависимости от его энергопотребления для достижения максимальной производительности. Базовая тактовая частота графического процессора GK110 в Geforce GTX Titan равна 836 МГц, а средняя турбочастота (Boost Clock) равна 876 МГц, что немногим больше. Как и в случае предыдущих решений, это лишь средняя частота, которая изменяется в зависимости от игры и нагрузки, а реальные частоты GPU в играх могут быть и выше. Частота памяти GDDR5 в Geforce GTX Titan составляет традиционные 6008 МГц, как и в предыдущей топовой плате компании. Результирующей пропускной способности в 187 ГБ/с должно быть достаточно даже для такого мощного решения, но в некоторых случаях ее может и не хватить.

Технология GPU Boost 2.0

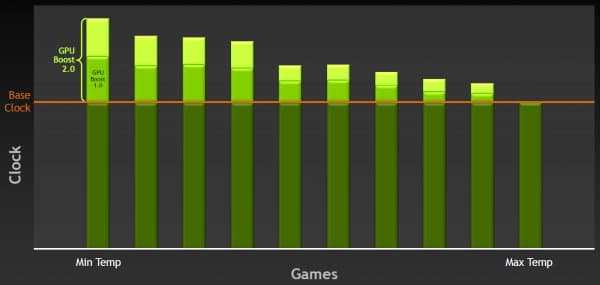

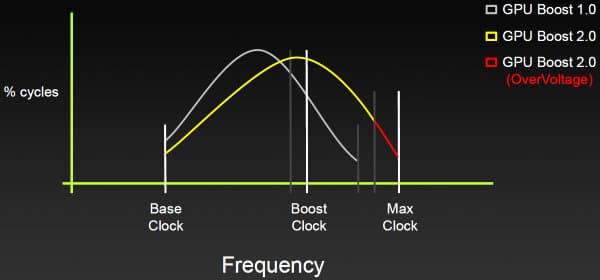

В Geforce GTX Titan внедрена поддержка второй версии технологии GPU Boost. Она включает все возможности GPU Boost 1.0 и служит для того же самого — автоматически увеличивает рабочую частоту GPU в зависимости от нагрузки, потребления и температуры. Технология GPU Boost впервые появилась в Geforce GTX 680, и она динамически управляет частотой в зависимости от условий работы видеочипа, а главной целью является достижение максимально возможной производительности в рамках определенного потребления (и выделения) энергии. К примеру, частота GPU в GTX 680 автоматически повышается, если уровень потребления не превышает 170 Вт.

Но в Titan инженеры пошли дальше. Они определили, что уровень потребления GPU не всегда ограничивает производительность при низких рабочих температурах видеочипа. И во второй версии GPU Boost ограничителем для роста частоты служит уже не уровень потребления, а рабочая температура GPU, установленная для Titan на 80 градусов.

В случае модели Geforce GTX Titan, частота видеочипа автоматически увеличивается, пока температура ядра остается равной или ниже 80 градусов. Сам GPU отслеживает температуру, изменяя частоту и напряжение так, чтобы поддерживать этот уровень нагрева. Такое изменение в GPU Boost 2.0 сказывается и на уровне шума от вентилятора системы охлаждения — при выборе целевой температуры ее проще контролировать, и частота вращения вентилятора изменяется в меньших пределах, что снижает общий уровень шума.

В дополнение к переходу от контроля потребления к температурному пределу, Nvidia дала энтузиастам широкие возможности по настройке работы GPU Boost. При использовании программного обеспечения, разработанного партнерами Nvidia, счастливые пользователи видеокарт Titan могут изменять целевую температуру GPU на свой вкус. К примеру, если пользователь хочет достичь большей производительности от Geforce GTX Titan, то он может изменить температурный предел с 80 до 85 градусов. Тогда у GPU будет больше возможностей для поднятия частоты и напряжения, пока им не достигнута измененная целевая температура.

Из-за этих изменений в логике работы GPU Boost 2.0 целевой уровень потребления (power target) уже не показывает типичное потребление в среднем, а является максимально возможным значением для данной модели видеокарты. При установке целевого потребления в 100% максимальное потребление будет ограничено значением в 250 Вт, а максимально возможное значение в 106% установит этот уровень на планке в 265 Вт. Типичный же уровень потребления видеокартой будет изменяться в зависимости от температуры среды.

К слову, поэтому GPU Boost 2.0 хорошо подходит для экстремального разгона с применением водяного охлаждения, ведь оно обеспечивает температуру ядра GPU значительно ниже целевой, что в результате должно привести к возможности достижения более высоких частот и напряжений. Иными словами, если раньше некоторые энтузиасты разгона ругались на то, что GPU Boost 1.0 им мешает, то теперь они будут недовольны чуть меньше, как минимум. Более того, для них есть еще одна хорошая новость, связанная с возможностью повышения напряжения.

Пользователям Geforce GTX Titan доступна еще одна новая настройка GPU Boost 2.0 — управление перенапряжением (overvoltage). Так как в Titan турбочастота и уровень напряжения теперь зависят от рабочей температуры GPU, то теперь нет причин ограничивать напряжение видеочипа слишком строго. А возможность повышения напряжения серьезно упрощает достижение высоких тактовых частот. По умолчанию напряжение графического процессора Titan ограничено рамками, установленными в Nvidia. Этот предел напряжения нужен для того, чтобы предотвратить необратимые повреждения кристалла, обеспечив работоспособность и надежную работу видеокарты. Ведь подача слишком высокого напряжения на GPU может привести к быстрой деградации чипа и вызвать поломку.

Но экстремальных энтузиастов разгона это не страшит, они всегда хотят получить максимальные возможности по повышению напряжения. И GPU Boost 2.0 дает им эту возможность, открывая настройку «перенапряжения». Естественно, она отключена по умолчанию и при попытке включения покажет устрашающее предупреждение о риске повреждения видеокарты. Полной демократии нет и тут, каждый из производителей видеокарт может ограничивать возможности по повышению напряжения для моделей, вышедших под их маркой. Да и в целом поддержка этой возможности необязательна и может быть заблокирована производителем в BIOS видеокарты.

Разумеется, при повышенном напряжении Geforce GTX Titan сможет достичь еще более высоких частот, особенно при условии соответствующего экстремального охлаждения. Да и в некоторых случаях простое повышение предела частоты GPU не вызывает роста реальной частоты, что случается тогда, когда прирост ограничен недостатком питания. Именно в этих случаях повышение предела напряжения для GPU поможет достичь более высокой частоты работы.

Нововведения GPU Boost 2.0 позволили Nvidia достичь более высокой производительности и в типичных условиях без пользовательского разгона, позволяя выставить более высокое напряжение и частоту GPU. При включении возможности превышения стандартного напряжения GPU появляется дополнительная возможность увеличить производительность, но повышается и риск повреждения GPU и выхода его из строя.

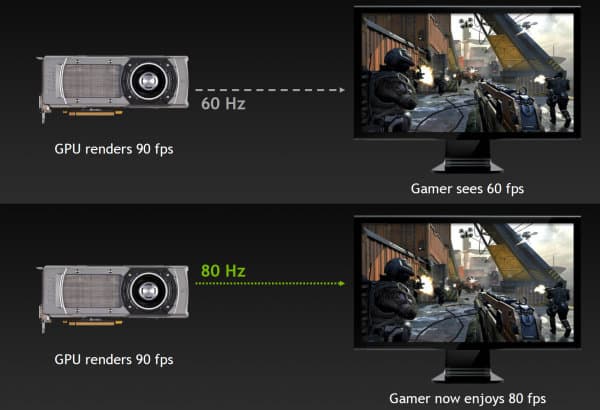

Еще одним интересным нововведением GPU Boost 2.0 можно назвать «разгон дисплея», как его называет сама Nvidia. Многим игрокам нравится играть с включенной вертикальной синхронизацией (VSync), потому что это позволяет избежать артефактов вроде разрыва картинки, когда VSync выключен. Но при включении вертикальной синхронизации, частота кадров ограничивается сверху частотой обновления монитора, обычно равной 60 Гц для всех современных устройств вывода изображения. В результате, производительность игры ограничена на уровне 60 FPS, несмотря на то, что видеочип может рендерить сцену и на более высокой скорости.

И только увеличение частоты обновления экрана соответственно скажется и на итоговой частоте кадров в секунду. Скажем, если GPU может отрендерить 90 FPS, то при включенном VSync монитор сможет показать лишь 60 FPS, но если повысить частоту обновления до 80 Гц, то GPU получит возможность работать быстрее — на 80 FPS при том же отсутствии артефактов разрыва картинки.

В GPU Boost 2.0 была добавлена возможность «разгона дисплея». При помощи соответствующих утилит от производителей видеокарт, пользователь Geforce GTX Titan получает возможность увеличения частоты следования пикселей (pixel clock) для собственного дисплея, что позволяет добиться более высокой частоты обновления экрана, а соответственно и увеличения итоговой частоты кадров. Естественно, не все мониторы поддерживают такой разгон, так что тут у пользователей есть богатое поле для экспериментов.

Вычисления с двойной точностью на Geforce GTX Titan

Интересно, что компания Nvidia решила сделать из Geforce GTX Titan первую игровую видеокарту серии Geforce, которая обеспечивает неграфические вычисления двойной точности с полной скоростью, предусмотренной архитектурой графического процессора, да еще и не ограниченную программно. Не секрет, что предыдущие видеокарты Geforce имеют весьма низкую скорость вычислений с двойной точностью (double-precision, DP). К примеру, каждый мультипроцессор в GK104, применяемый в Geforce GTX 680, имеет по 192 потоковых ядра для вычислений с одинарной точностью (single-precision, SP) и лишь 8 ядер для DP-вычислений. Поэтому скорость вычислений с двойной точностью была равна лишь 1/24 от скорости SP-вычислений. В случае чипа GK110, который лежит в основе Geforce GTX Titan, на каждый SMX приходится по 64 ядер, способных на вычисления с двойной точностью (и те же 192 SP-ядра), так что производительность в DP-вычислениях составляет 1/3 от SP-скорости, что заметно выше.

Еще до выхода Titan в Сети появились слухи о том, что в Geforce на основе чипа GK110 скорость вычислений с двойной точностью будет искусственно ограничена, чтобы не создавать конкуренцию с линейкой Tesla. К счастью, слухи остались лишь слухами и Nvidia решила оставить производительность DP-вычислений на полноценном уровне, чтобы обеспечить разработчиков ПО, инженеров и студентов недорогим аппаратным обеспечением, которое способно обеспечить производительность выше 1 терафлопса при DP-вычислениях. Вероятно, компания рассчитывает, что распространение сравнительно недорогого (по меркам профессиональных решений) Geforce GTX Titan в среде разработчиков, использующих неграфические вычисления на GPU, позволит им разрабатывать и оптимизировать свои приложения под процессоры Nvidia, что увеличит распространение GPGPU задач, столь желанное компанией.

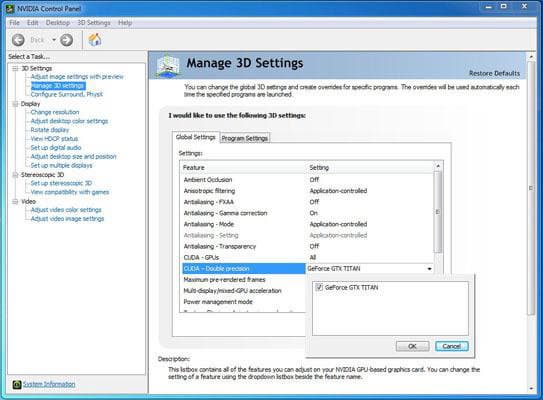

Включение возможности полноскоростных DP-вычислений на Geforce GTX Titan возможно из настроек драйвера. По умолчанию Geforce GTX Titan запускает DP-вычисления лишь на 1/24 от скорости вычислений с одинарной точностью (количество соответствующих мультипроцессоров SMX меньше втрое, но они еще и работают в 8 раз медленнее), аналогично Geforce GTX 680. Чтобы включить возможность полноскоростных вычислений, нужно открыть панель управления Nvidia и в панели «Управление параметрами 3D» («Manage 3D Settings») найти настройку «CUDA — Double Precision» и пометить галочку напротив строки «Geforce GTX Titan». При включении настройки она будет применена сразу же, без необходимости перезагрузки. Причем, записывается в BIOS видеокарты и не требует постоянного включения после каждой перезагрузки.

Зачем нужны столь сложные телодвижения, не лучше ли было просто включить быстрые DP-вычисления на постоянной основе? Секрет кроется в том, что при полноскоростной работе DP-ядер графический процессор GK110 потребляет больше энергии и не может работать на частоте, выбранной для «игрового» режима Geforce. Компания Nvidia обошла проблему очень просто — при включении этой настройки видеочип Geforce GTX Titan будет всегда работать на пониженной частоте и при меньшем напряжении.

Соответственно, если вы не используете никаких специфических GPGPU-приложений, использующих расчеты с двойной точностью, то в настройке нет никакого смысла — она только снизит производительность в игровых приложениях и других 3D-задачах. Игр, использующих такие вычисления, просто не существует (да и не факт, что они появятся в обозримом будущем). Поэтому, чтобы отключить полноскоростные DP-вычисления, нужно проделать обратное действие, сняв «галочку» в настройке «CUDA — Double Precision» в панели управления Nvidia.

Оценка производительности

Переходим к вопросу предварительной оценки производительности нового решения — модели Geforce GTX Titan. По сравнению с Geforce GTX 680, в Titan значительно больше вычислительных ядер и текстурных блоков, поэтому скорость шейдерных вычислений, обработки геометрии и текстурной фильтрации серьезно выросла. Правда, с учетом пониженной до 836(876) МГц тактовой частоты для GPU, реальный теоретический прирост по этим параметрам не превысит 45%. По теоретической скорости заполнения преимущество перед GTX 680 еще меньше — лишь 25%, зато показатель эффективного филлрейта вырос ощутимее. Так как Geforce GTX Titan имеет 384-битную шину памяти, а ее микросхемы работают на эффективной частоте в 6 ГГц, то общая пропускная способность памяти Geforce GTX Titan выросла на 50%, по сравнению с лучшим решением, основанным на чипе GK104.

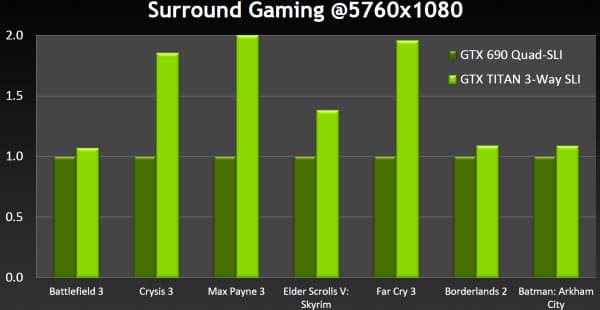

В данной теоретической части статьи мы приводим только собственные данные тестов самой компании Nvidia. Понятно, что Geforce GTX Titan должен стать быстрейшим одночиповым решением на рынке видеокарт, но насколько он быстрее? Подробные тесты будут далее, а мы приведем оценку Nvidia, которая утверждает, что три видеокарты Geforce GTX Titan — единственная возможность поиграть в одну из самых современных игр Crysis 3 с максимальными настройками на трех дисплеях в итоговом разрешении 5760×1080, да еще с применением полноэкранного сглаживания методом мультисэмплинга MSAA 2x. В таком режиме три карты обеспечили 46 FPS.

Естественно, что тут свою роль играют как огромный объем локальной видеопамяти в 6 ГБ, так и 384-битная шина, обеспечивающая высокую ПСП. Но не только Crysis 3 выделяется, во многих современных играх три GTX Titan быстрее, чем четыре GTX 690. Хотя в некоторых проектах производительность таких систем весьма близка, что тоже неплохо:

Данное тестирование проводилось на системе с процессором Intel Core i7 3960X, работающим на частоте 3,3 ГГц, а также при включенном 4x MSAA-сглаживании и максимальных настройках. Похоже, что именно три Geforce GTX Titan, работающие в связке 3-Way SLI стали максимально производительной видеосистемой, так как в среднем они превосходят две Geforce GTX 690, работающие в режиме Quad SLI.

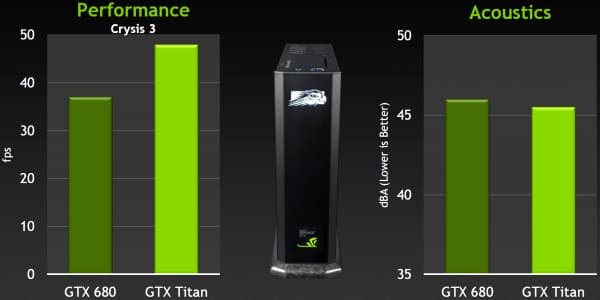

Но Geforce GTX Titan подходит не только для энтузиастов и любителей разгона, имеющих просторные корпуса. У них то и с двухчиповыми Geforce GTX 690 никаких проблем не было. А вот у тех, кому нужна максимальная мощь в компактном корпусе, возможности установки таких «горячих» ускорителей просто не было. К примеру, для так называемых моделей small form factor (SFF), имеющих малые размеры и сравнительно тихое охлаждение, видеокарта Geforce GTX 690 слишком крупная по размеру, потребляет слишком много энергии и выделяет столь же много тепла, да еще и кулер шумит ощутимо. Поэтому в них приходилось обходиться одночиповыми Geforce GTX 680.

Теперь же в такие системы можно установить и Geforce GTX Titan, обладающий производительностью, близкой к Geforce GTX 690, но имеющий остальные указанные параметры, близкие к GTX 680. Такая видеокарта вполне помещается в SFF-системы и обеспечивает рост производительности по сравнению с GTX 680, оставаясь при этом даже немного более тихой!

Тесты проводились на системе с центральным процессором Intel Core i7-3770K, работающим на частоте 3,5 ГГц, в разрешении 1920×1080, с максимальными настройками и включенным полноэкранным сглаживанием 4x MSAA. Немудрено, что производители подобных систем просто в восторге от такой мощи в столь малом размере и уже нацелились на применение новой видеокарты в SFF-системах. Компактные игровые ПК стали еще мощнее.

Итак, Geforce GTX Titan — это экстремальная видеокарта для тех энтузиастов компьютерных игр и любителей разгона, кто не стеснен в средствах. Перед двухчиповыми решениями вроде GTX 690 у нее есть важное преимущество в том, что некоторые игры предпочитают одночиповые решения, да и в целом игры работают на одном GPU лучше, чем на двух и более (проблемы AFR-рендеринга и их причины мы не раз называли в своих материалах). Кроме того, можно установить три штуких таких карт, и это будет очень быстрая система, а вот двухчиповых три — уже не поставить.

Естественно, что Titan поддерживает все современные технологии компании Nvidia, о которых мы ранее неоднократно писали, в том числе Adaptive VSync и PhysX. Обо всех этих технологиях подробно написано в базовом обзоре Geforce GTX 680 — первой видеокарты семейства Kepler. И так как Geforce GTX Titan имеет в своей основе топовый графический процессор GK110 на основе этой архитектуры, то новая модель предлагает все современные возможности в виде DirectX 11, PhysX, TXAA, адаптивного VSync и других технологий.

Следующая часть нашей статьи посвящена практической части исследования в привычном наборе синтетических тестов, в которых мы сравним производительность новой топовой видеокарты на базе одного графического чипа Geforce GTX Titan со скоростью остальных решений компаний Nvidia и AMD.

Nvidia Geforce Titan — Часть 2: видеоплаты и синтетические тесты →