что получится, если урезать GTX 670 по шине?

Содержание

- Часть 1 — Теория и архитектура

- Часть 2 — Практическое знакомство

- Часть 3 — Результаты игровых тестов (производительность)

Если следовать логике образования наименований у продуктов Nvidia предыдущих поколений, то Geforce GTX 660 Ti должен основываться на новом чипе (кристалле), новом ядре, как в свое время произошло с Geforce GTX 560 Ti (GF114). Однако если мы посмотрим на цепочку кодовых названий: GF104 — GTX 460, GF114 — GTX 560, то получается, что GTX 660 — это GK104. То есть вышло так, что изначально планировавшийся на средний уровень GK104 показал чудеса скорости и выступил наравне с топовыми конкурентами — об этом мы уже писали в нашем базовом материале по GTX 680. И лишь в сильно урезанном виде он обрел изначально соответствующее кодовому название — Geforce GTX 660 Ti. Так или иначе, очевидно, что в компании Nvidia сильно ошиблись, давая наименование GK104 такому процессору. И, как ни смешно это звучит, выпуском GTX 660 Ti этот казус кое-как исправляется. Можно было бы возразить в том ключе, что если на одном ядре выпускаются три продукта, то логично давать им схожие имена: GTX 680, GTX 670, GTX 665. Однако если заглянуть в корень системы наименований, то как раз GTX 660 Ti — правильное название, а вот GTX 670 и GTX 680 — нет :)

Ладно, запутали всех этими названиями, перейдем к главному: что же еще урезали в GK104, чтобы получилось младшее решение на том же ядре? В названии статьи ответ дан. Но все ли так просто?

Алексей Берилло расскажет нам обо всем.

Часть 1: Теория и архитектура

Уж скоро полгода пройдёт, как был выпущен графический процессор GK104 и первая видеокарта от Nvidia на его основе. Новая вычислительная архитектура Nvidia Kepler позволила этому GPU стать наиболее быстродействующим и энергоэффективным видеочипом. Это наиболее мощный GPU, созданный в компании, и выпущенные до сегодняшнего дня модели видеокарт на его основе доступны лишь в верхнем ценовом сегменте, предназначенном для энтузиастов ПК игр.

Сразу же после анонса Geforce GTX 680, многие игроки, рассчитывающие на менее дорогие модели видеокарт, начали ждать скорого выхода менее мощных решений. Массовый рынок ждал менее дорогих вариантов, вроде хорошо известных Geforce GTX 460 и GTX 560 (Ti). Но Nvidia не выпускала и не выпускала ничего медленнее Geforce GTX 670, который вышел в мае хоть и по более низкой, но всё же не такой уж малой цене. И вот ожидание закончено, сегодня вышла модель Geforce GTX 660 Ti, предназначенная для ценового сегмента порядка $300.

Что интересно, видеокарта для этого сегмента в этот раз основана не на менее мощном чипе, а на урезанном топовом (по крайней мере, который является топовым на момент её выхода). И новый Geforce GTX 660 Ti очень похож на GTX 670, похож настолько, что в последней модели и вовсе исчезает практический смысл. Судите сами, новинка основана на том же чипе GK104, что и все вышедшие модели GTX 690, GTX 680 и GTX 670, и весьма слабо отличается от последнего варианта, имея ровно те же характеристики по частоте и количеству основных исполнительных блоков, кроме ROP и контроллеров памяти.

Неудивительно, что производительность решения ожидается весьма высокой — лишь немногим ниже уровня Geforce GTX 670. При этом уровень энергопотребления Geforce GTX 660 Ti был снижен относительно более мощных моделей, и максимальный уровень потребления энергии составляет 150 Вт, что сравнимо с потреблением Geforce GTX 560. Но по скорости GTX 660 Ti то должен быть быстрее, чем GTX 580! А если сравнивать с аналогичными по цене решениями предыдущих поколений, то прирост скорости ещё более впечатляющий.

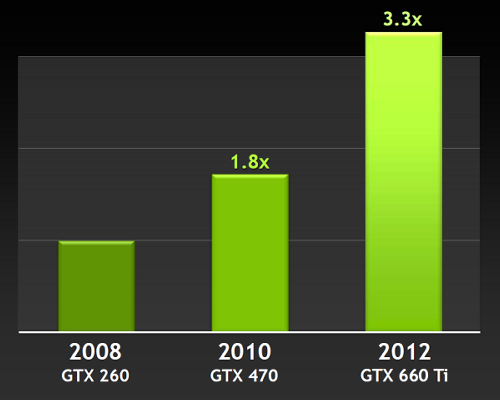

Новый Geforce GTX 660 Ti становится весьма выгодным вариантом для игроков, планирующих обновление своей игровой системы, особенно имеющих очень старые GPU. Так, по сравнению с Geforce GTX 260 новая видеокарта будет более чем втрое быстрее, и даже не такую уж старую Geforce GTX 470 новинка опережает почти вдвое.

Выход решений, подобных GTX 660 Ti, сейчас весьма актуален, ведь рынок игр для ПК переживает свой очередной расцвет. Как это уже было ранее в периоды устаревания текущего поколения игровых консолей, лидирующей платформой по инновациям становятся именно ПК игры. Выходят и эксклюзивы и специальные ПК-версии с заметно улучшенными движками, по сравнению с консольными собратьями.

Так происходит и сейчас. Xbox 360 и PlayStation 3 устарели технологически, и акцент многих разработчиков переместился на ПК. В том числе потому, что именно ПК даёт часть возможностей будущих игровых консолей. То есть, если сейчас активно заниматься современными игровыми движками на ПК, то в последующем их будет легко перенести и на будущие игровые консоли, которые будут основаны на GPU, так или иначе являющиеся родственными для нынешних ПК-видеочипов.

Поэтому ПК игры сейчас развиваются даже быстрее их консольных вариантов. К примеру, на игровых выставках, вроде E3 2012, многими игровыми журналистами отмечалось, что лучшие технологически и графически игры были показаны именно в виде ПК-версий. Даже если игра будет мультиплатформенной (а таких большинство), то именно на ПК она может раскрыть себя полностью с визуальной точки зрения, и именно в таком виде её демонстрируют потенциальным покупателям.

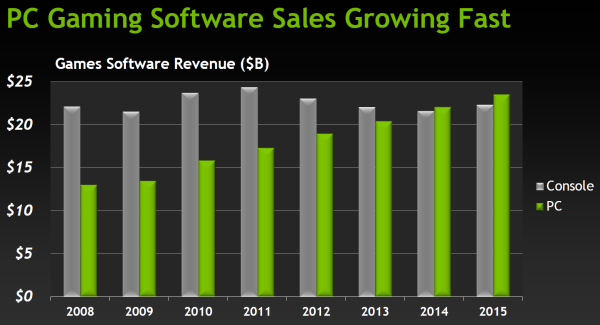

Причем, что интересно, если консольный игровой рынок застыл в своём развитии, то рынок ПК-игр плавно растёт. Продажи игр, предназначенных для компьютеров, уже почти догнали продажи консольных проектов, а по прогнозам аналитиков, скоро и вовсе их превзойдут. Например, Nvidia не устаёт приводить исследование DFC Intelligence, продажи ПК-игр по которому догонят и перегонят продажи консольных игр уже в 2014-2015 гг.

Это и неудивительно, если вспомнить такие удачные примеры как Diablo 3. По данным Blizzard, за первый день продаж (с учётом предзаказов, естественно) они реализовали 3.5 миллиона копий игры Diablo 3. А до отметки в 10 миллионов игра Diablo 3 дошла через три месяца после начала продаж. Но одной игрой дело не ограничивается, список проектов, ожидаемых к выходу в 2012 довольно широк. Вот лишь некоторые из наиболее известных: Call of Duty: Black Ops II, Far Cry 3, Planetside 2, Hawken, Mechwarrior Online, Borderlands 2, Assasin's Creed III, The Secret World, Guild Wars 2. А некоторые игры, вроде Max Payne 3, вышли совсем недавно.

Многие из перечисленных игровых проектов пусть и мультиплатформенные, но они имеют поддержку таких ПК-эксклюзивных возможностей, как DirectX 11 и GPU PhysX. Большая часть игр предлагает использование DX11 для улучшения качества картинки, а такие игры, как Borderlands 2, Planetside 2 и Hawken поддерживают продвинутые физические эффекты при помощи PhysX. И тут новинка Geforce GTX 660 Ti пригодится как нельзя кстати.

Так как анонсированная сегодня новая видеокарта Nvidia основана на уже известном нам графическом процессоре GK104 архитектуры «Kepler», о которой мы уже подробно рассказывали и которая близка к родственной архитектуре «Fermi», то читателям будет полезно ознакомиться со статьями о ранних моделях графических решений компании:

- [10.05.12] Nvidia Geforce GTX 670 — 7/8 от однопроцессорного лидера GTX 670: много это или мало?

- [22.03.12] Nvidia Geforce GTX 680 — новый однопроцессорный лидер 3D-графики

- [09.11.10] Nvidia Geforce GTX 580 — новый король 3D-графики на закате 2010 года

- [27.03.10] Nvidia Geforce GTX 480 — архитектура нового графического процессора изнутри; как реализована поддержка DirectX 11

Итак, с текущей архитектурой видеочипов компании Nvidia читатели уже знакомы, рассмотрим подробные характеристики очередной видеоплаты Geforce GTX 660 Ti, основанной на графическом процессоре GK104.

Графический ускоритель серии Geforce GTX 660 Ti

- Кодовое имя чипа GK104;

- Технология производства 28 нм;

- 3,54 миллиардов транзисторов;

- Площадь ядра 294 мм²;

- Унифицированная архитектура с массивом процессоров для потоковой обработки различных видов данных: вершин, пикселей и др.;

- Аппаратная поддержка DirectX 11 API, в том числе шейдерной модели Shader Model 5.0, геометрических и вычислительных шейдеров, а также тесселяции;

- 192-битная шина памяти, три независимых контроллера шириной по 64 бита каждый, с поддержкой GDDR5-памяти;

- Базовая частота ядра 915 МГц;

- Средняя турбо-частота ядра 980 МГц;

- 7 потоковых мультипроцессоров, включающих 1344 скалярных ALU для расчётов с плавающей запятой (поддержка вычислений в целочисленном формате, с плавающей запятой, с FP32- и FP64-точностью в рамках стандарта IEEE 754-2008);

- 112 блоков текстурной адресации и фильтрации с поддержкой FP16- и FP32-компонент в текстурах и поддержкой трилинейной и анизотропной фильтрации для всех текстурных форматов;

- 3 широких блока ROP (24 пикселя) с поддержкой режимов антиалиасинга до 32 выборок на пиксель, в том числе при формате буфера кадра FP16 или FP32. Каждый блок состоит из массива конфигурируемых ALU и отвечает за генерацию и сравнение Z, MSAA, блендинг;

- Интегрированная поддержка RAMDAC, двух портов Dual Link DVI, а также HDMI и DisplayPort;

- Интегрированная поддержка четырёх мониторов, включая два порта Dual Link DVI, а также HDMI 1.4a и DisplayPort 1.2;

- Поддержка шины PCI Express 3.0.

Спецификации референсной видеокарты Geforce GTX 660 Ti

- Базовая частота ядра — 915 МГц;

- Средняя турбо-частота — 980 МГц;

- Количество универсальных процессоров — 1344;

- Количество текстурных блоков — 112, блоков блендинга — 24;

- Эффективная частота памяти — 6008 (1502×4) МГц;

- Тип памяти GDDR5, 192-битная шина памяти;

- Объем памяти — 2 ГБ;

- Пропускная способность памяти — 144,2 ГБ/с;

- Теоретическая максимальная скорость закраски — 22,0 гигапикселей в секунду;

- Теоретическая скорость выборки текстур — 102,5 гигатекселей в секунду;

- Два разъема Dual Link DVI-I, один HDMI, один DisplayPort;

- Двойной SLI-разъем;

- Шина PCI Express 3.0;

- Энергопотребление до 150 Вт;

- Два 6-контактных разъёма питания;

- Двухслотовое исполнение;

- Рекомендуемая цена для России 11 999 руб.

В линейке решений компании Nvidia новая модель Geforce GTX 660 Ti занимает место между старшей Geforce GTX 670 и младшими Geforce GT 640, замещая топовые платы предыдущего поколения, вроде Geforce GTX 570 и GTX 580, предлагаемые до выхода решений на базе архитектуры Kepler среднего уровня. Принцип наименования видеокарт Nvidia сохранился, модель в шаге от более старших получила изменение средней цифры индекса, а также суффикс «Ti», означающий то, что в будущем будет выпущен ещё и GTX 660 без этой приставки, как в линейке предыдущего поколения.

Интересно, что до выхода ожидаемого чипа GK106 и видеокарт среднего уровня на его основе, было принято решение выпустить ещё более урезанную модель на базе GK104. Вероятно, и с производством на TSMC получше стало, и бракованные GK104 уже накопились, да и запас топовых видеокарт серии GTX 500 потихоньку иссякает. Кроме того — надо уже конкурировать с Radeon HD 7870 чем-то более современным. Кстати, ещё одним конкурентом для GTX 660 Ti стала модель Radeon HD 7950, с ними двумя мы и будем сравнивать новинку. Рекомендуемая рыночная цена Geforce GTX 660 Ti для российского рынка была установлена равной 11 999 руб. В целом, цена неплохая, хотя и традиционно превышает североамериканскую.

В отличие от топовых моделей серии GTX 600, новая видеокарта имеет 192-битную шину памяти, хотя объём видеопамяти (по крайней мере, для референсной платы) остался равным 2 ГБ. О подробностях такого сочетания читайте далее. В условиях современных приложений и максимальных настроек качества этого объёма может иногда не хватать, и тут GTX 660 Ti может даже иметь некоторое преимущество перед GTX 670 и GTX 680, так как 192-битная шина позволяет легко и просто установить на неё 3 ГБ памяти, чем уже воспользовались некоторые партнёры Nvidia, выпустив соответствующие модели.

Архитектура Kepler

Вышедшая сегодня видеокарта Geforce GTX 660 Ti основана на графическом процессоре архитектуры Kepler, уже давно известном нам под кодовым именем GK104, поэтому этот раздел будет весьма коротким, — всё уже было очень подробно рассказано ранее. В данном материале мы традиционно лишь остановимся на отличиях конкретной модификации GTX 660 Ti и повторим базовую информацию.

Основы архитектуры Kepler были заложены ещё в вышедших пару лет назад чипах семейства Fermi (Geforce GTX 480 и затем GTX 580), но, несмотря на сходство, Kepler является практически полностью переработанной архитектурой, основной задачей при разработке которой было повышение энергоэффективности. Установленный на Geforce GTX 660 Ti графический процессор GK104 состоит из четырёх кластеров графической обработки Graphics Processing Clusters, и отличается от GPU, который мы рассматривали в обзорах GTX 680 и GTX 670, только количеством активных блоков (заблокированные блоки выделены цветом):

Как видите на схеме, видеочип в модели Geforce GTX 660 Ti имеет 7 активных мультипроцессоров SMX, состоящих из 1344 вычислительных CUDA ядер, точно как и Geforce GTX 670. То есть, лишь один из блоков SMX в чипе отключен аппаратно. А вот подсистема памяти у Geforce GTX 660 Ti отличается от той, что имеет GTX 670 — активными оставлены лишь три из четырёх 64-битных контроллеров видеопамяти. Но при этом её объём у референсной платы составляет 2 ГБ, а вовсе не 1,5 или 3 ГБ, как можно было бы предположить, исходя из разрядности шины.

Мы знаем, что контроллер памяти, встроенный в графические процессоры Nvidia, поддерживает использование чипов памяти смешанной ёмкости, что и позволяло ранее использовать буфер в 2 ГБ в той же Geforce GTX 550, например. Но тогда именно чипы памяти были разные, а в некоторых образцах GTX 660 Ti объём в 2 ГБ набран при помощи 8-ми микросхем, а не 12-ти. При этом два из трёх 64-битных контроллеров памяти используют по два 32-битных чипа, а третий — четыре чипа 32-битной же памяти, но к каждой из них доступ у GPU лишь 16-битный. Видимо, такое решение помогает сэкономить на себестоимости чипов памяти. К слову, ничто не мешает производителям ставить на свои варианты GTX 660 Ti по 3 ГБ памяти, и такие варианты появятся в продаже сразу же. Ну а рабочая частота GDDR5-видеопамяти в новой модели идентична значению частоты, на которой она работает в GTX 670 и GTX 680 — 6008 МГц.

Что касается частот видеочипа, то в GTX 660 Ti они также полностью соответствуют значениям, установленным для GTX 670. Базовая тактовая частота чипа в Geforce GTX 660 Ti равна 915 МГц, а средняя турбо-частота GPU Boost равна 980 МГц, что лишь на 8% меньше, чем в топовой GTX 680. Напомним, что GPU Boost позволяет графическим процессорам архитектуры Kepler автоматически увеличивать частоту GPU для достижения максимально возможной производительности в случае наличия запаса по энергопотреблению. Об этой технологии можно подробно прочитать в базовом обзоре Geforce GTX 680. Реальная турбо-частота GK104 в случае модели GTX 660 Ti зависит от конкретного 3D-приложения, и чаще всего составляет значение выше 1 ГГц.

Производительность и энергоэффективность

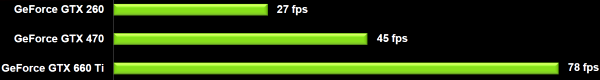

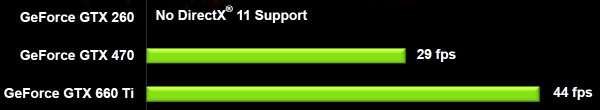

А что же с производительностью новой Geforce GTX 660 Ti? Хотя бы по мнению самой Nvidia, для начала. Обычно, если новинка показывает средние результаты, то диаграмм в презентациях от производителей не очень много, да и сравнивается она не всегда с тем, с чем надо бы. В случае с GTX 660 Ti всё совершенно не так — и диаграмм много, и все прямые конкуренты присутствуют. Это говорит о том, что хвастать явно есть чем. Что же, давайте сначала посмотрим на производительность новинки в свежих играх с применением DirectX 11, GPU PhysX и TXAA.

The Secret World

Max Payne 3

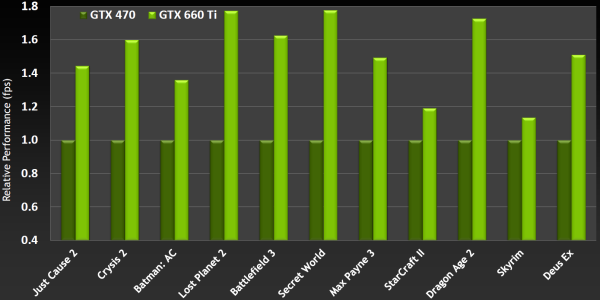

По сравнению с GPU предыдущих поколений, Geforce GTX 660 Ti обеспечивает весьма приличный прирост скорости в условиях современных игр. Благодаря применению мощнейшего чипа GK104 с высокими частотами в решении такого уровня, производительность 3D-рендеринга заметно возросла, а энергоэффективность улучшилась ещё больше. Ведь архитектура Kepler как раз и разрабатывалась для достижения лучших показателей скорости в расчёте на потребление. Иными словами, производительность выше топовой для предыдущего поколения обеспечивается в GTX 660 Ti со значительно меньшими затратами энергии. Переходим к сравнению в широком наборе игр, сначала с той же GTX 470:

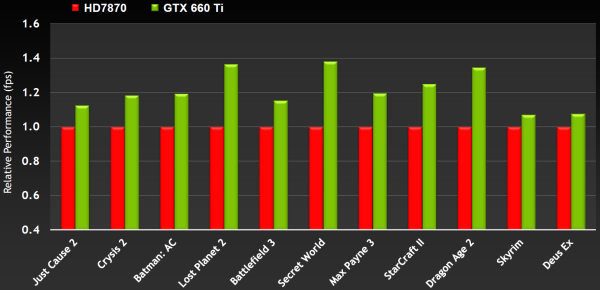

Как видим, новинка заметно быстрее одной из своих предшественниц на базе чипа архитектуры Fermi. Но всё это сравнения с устаревшими видеокартами предыдущих поколений. А что же будет, если сравнить скорость Geforce GTX 660 Ti с нынешними конкурентами от AMD? Надо полагать, что Geforce GTX 660 Ti с его 1344 вычислительными ядрами и 112 текстурными модулями, работающими на частоте GTX 670, составит очень сильную конкуренцию для одного из своих прямых соперников — Radeon HD 7870. Давайте посмотрим данные тестов самой Nvidia:

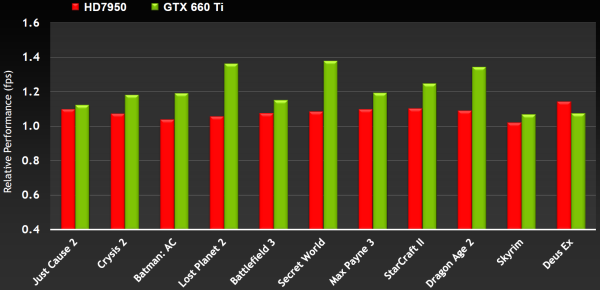

Судя по диаграмме, Geforce GTX 660 Ti обеспечивает производительность выше этого уровня (а ведь Radeon HD 7870 потребляет до 175 Вт!). И, несмотря на то, что новинка целит примерно в тот же ценовой сегмент, что и Radeon HD 7870, видеокарта от Nvidia способна соперничать и с более дорогим Radeon HD 7950. Конечно, пока что это лишь данные одной из заинтересованных сторон, но, судя по характеристикам GTX 670, можно сделать вывод о том, что новый GTX 660 Ti действительно способен на большее:

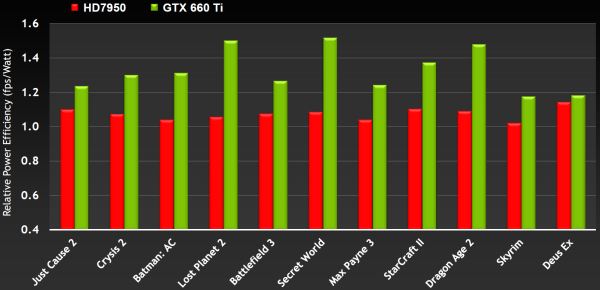

И действительно, в выбранных Nvidia играх и условиях, их решение оказалось быстрее конкурирующего. Во многих современных играх, вроде Max Payne 3, Battlefield 3 и Crysis 2, видеокарта Nvidia по их собственным данным оказалась быстрее. Мы обязательно проверим эти данные в практической части, а сейчас посмотрим на сравнительные показатели энергоэффективности (также по данным производителя):

С учётом потребления обеими видеокартами и сравнительной производительности по тестам выше, неудивительно, что новая Geforce GTX 660 Ti одержала победу над Radeon HD 7950 по энергетической эффективности, ведь она и немного быстрее и одновременно потребляет меньше энергии.

Программная поддержка

Мы уже писали выше о том, что многие игровые проекты 2012 года имеют поддержку DirectX 11 (особенно тесселяции и DirectCompute), GPU PhysX и других возможностей, используемых для улучшения качества картинки. Важно, что такие вещи как тесселяция, способны заметно улучшить качество рендеринга, а пользователи старых систем с видеокартами предыдущих поколений, поддерживающих только DirectX 10, а то и DirectX 9, уже не получают в современных играх максимальное качество изображения.

Кроме особенностей DirectX 11, которые доступны как на решениях Nvidia, так и на конкурирующих видеокартах компании AMD, у первых есть свои преимущества. Так, многие из выходящих в 2012 году игр будут иметь поддержку таких технологий Nvidia, как физические эффекты на GPU — PhysX и полноэкранное сглаживание методом TXAA. С увеличивающимся количеством игр с поддержкой всех современных возможностей, время для апгрейда на что-то вроде Geforce GTX 660 Ti — самое подходящее.

Как видите на иллюстрации, 8 из 12 выбранных проектов, имеют поддержку DirectX 11, в виде тесселяции и/или методов постобработки, использующих DX11. Три игры — Borderlands 2, Hawken и Planetside 2 — будут поддерживать физику PhysX, а первыми играми с поддержкой метода сглаживания TXAA станут The Secret World и MechWarrior Online.

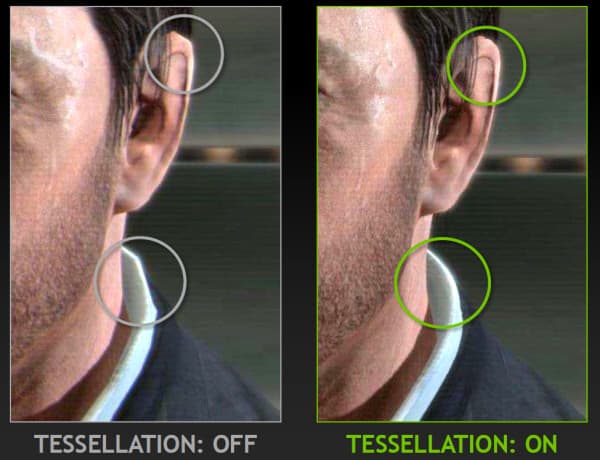

Чтобы не быть голословными в том, насколько всё это улучшает изображение, давайте рассмотрим несколько конкретных примеров со скриншотами. Так, не без помощи компании Nvidia, DX11-тесселяция была внедрена в такие хорошо известные игры, как Max Payne 3 и The Secret World.

Компания Rockstar использует аппаратную тесселяцию при помощи DirectX 11 для улучшения геометрии на персонажах игры, на самом Максе и других. Благодаря этому, 3D-модели персонажей становятся менее угловатыми, обретают плавные очертания и выглядят реалистичнее. Другое дело, что это не так уж заметно, если не приглядываться с лупой, на что при игре просто нет времени.

В игре The Secret World от Funcom аппаратная DX11-тесселяция используется не для персонажей, а для улучшения других объектов сцены, таких как кирпичи на зданиях, камни на дорогах и т. п. После включения тесселяции они становятся более реалистичными, обретая объём, как видно на скриншоте выше.

Кроме тесселяции, в современных играх можно отметить продвинутые физические эффекты, выполняемые на графических процессорах Nvidia при помощи технологии PhysX: физически корректные системы частиц, динамическую имитацию тканей и жидкостей. Всё это выполняется на GPU в некоторых играх, в число которых входит и Borderlands 2:

К сожалению, количество игр с поддержкой GPU PhysX в таком объёме совсем мало, хотя эффекты имитации тканей и частиц и физики жидкостей, выполняемые на графических процессорах, всегда отлично выглядят и обогащают игровой процесс.

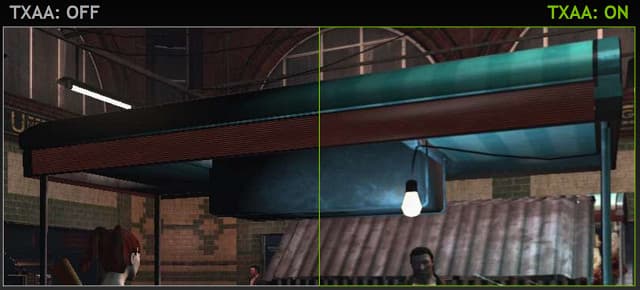

Новый метод сглаживания TXAA

Долгие годы под полноэкранным сглаживанием чаще всего подразумевался метод мультисэмплинга (MSAA — MultiSample Anti-Aliasing). Он стал стандартным для сглаживания краёв полигонов ещё несколько лет назад, но с увеличением популярности отложенного (deferred) затенения, ресурсоёмкость MSAA возросла. Да и по качеству к мультисэмплингу всегда были претензии, для чего даже пришлось вводить гибридные методы сглаживания, вроде MSAA+SSAA. Ведь MSAA не способен качественно сглаживать мелкую геометрию и полупрозрачные текстуры, и особенно это заметно при движении, когда начинают появляться артефакты, вроде «ползущих» и «мерцающих» пикселей.

Позднее появились методы сглаживания, использующие постобработку изображения, вроде MLAA и FXAA. Эти техники отличаются очень малой ресурсоёмкостью и поддерживаются во многих современных играх. Так, поддержка FXAA есть в Batman: Arkham City и The Elder Scrolls V: Skyrim, а также его можно включить в панели настроек драйвера Nvidia и для других игр. В этих методах для постобработки используется пиксельный шейдер, который повышает время отрисовки кадра (и снижает FPS, соответственно) лишь на 3-7%, по сравнению с 30-50% потери производительности от включения MSAA.

Но у этих методов есть свои недостатки — отсутствие временно́го (temporal) сглаживания и пропуск при обработке некоторых граней треугольников, которые нуждаются в сглаживании. Иными словами, качество FXAA иногда даже несколько хуже, чем у MSAA, а отдельные недостатки присущи обоим указанным методам.

Чтобы улучшить качество сглаживания, почти не повысив его ресурсоёмкость, в Nvidia был разработан ещё один метод — TXAA. Этот метод сглаживания также использует постобработку, но не только её, это — гибридный метод, которые включает использование аппаратных MSAA мультисэмплов и специального сглаживающего постфильтра с опциональной временно́й компонентой. TXAA был специально разработан для того, чтобы снизить артефакты временного алиасинга — «мерцающие» и «ползущие» пиксели, которые хорошо заметны при движении.

Для сглаживания пикселей в TXAA используется выборка субпикселей как внутри так и снаружи пикселя, да ещё в сочетании со значениями из предыдущих кадров (опциональная временная компонента), что обеспечивает отличное качество фильтрации. В сценах с движением камеры, при помощи TXAA достигается качество сглаживания, аналогичное тому, что мы видим при оффлайновом рендеринге, например, в 3D-мультфильмах. Сглаживающий фильтр методом TXAA работает качественнее, чем MSAA, и особенно это заметно на растительности и прочих подобных объектах. К сожалению, есть и небольшой недостаток — TXAA-фильтрация многим пользователям покажется слишком «замыливающей» изображение — оно немного теряет в резкости из-за того, что берутся сэмплы вне пикселя, а также из предыдущих кадров. Но это — дело вкуса.

Метод сглаживания TXAA существует в двух вариантах. Первый предлагает качество сглаживания, аналогичное методу 8x MSAA, но с производительностью, идентичной 2x MSAA, а второй обеспечивает ещё лучшее качество, но с производительностью, примерно соответствующей 4x MSAA. Соответственно, они используют 2 или 4 аппаратных мультисэмпла. Влияние метода TXAA на общую производительность в разных играх отличается и в основном зависит от скорости MSAA, так как использует и мультисэмплинг.

Можно сказать, что если FXAA обеспечивает максимальную производительность при неплохом качестве, то TXAA обеспечивает максимальное качество при небольшом снижении скорости рендеринга. Новый алгоритм уже внедряется в игровые приложения — все заинтересованные игровые разработчики, среди которых есть такие компании как Crytek, Epic, Bitsquid, уже получили соответствующий исходный код, так что появление TXAA не заставит себя долго ждать. К сожалению, TXAA не будет работать на видеокартах архитектуры Fermi и более ранних, метод поддерживается лишь на новых Kepler и требует применения видеокарт серии GTX 600. Да и форсировать TXAA из драйвера не удастся.

Игра Secret World стала первой, в которой используется метод TXAA, доступный для Kepler, а для владельцев других DX11-видеокарт есть и FXAA — более простой метод сглаживания. Всего в Secret World предлагается четыре уровня фильтрации: No AA, FXAA, FXAA HQ, TXAA 2x и TXAA 4x. Без включения сглаживания вовсе, на экране будет наблюдаться несглаженная геометрия и артефакты, которые мы описали выше. При включении же TXAA, картинка получается полностью сглаженной — все треугольники и отдельные объекты не имеют рваных граней. Лучше всего это заметно по следующему видеоролику (к сожалению, в нём показано сравнение только несглаженного и сглаженного методом TXAA кадра, а сравнения разных методов нет):

Вопросы субъективной оценки качества сглаживания у таких методов мы пока что оставим до подробного исследования качества сглаживания на видеокартах Nvidia и AMD. Но ещё раз поясним, что полностью убрать алиасинг без некоторого снижения чёткости просто невозможно. Тем более это касается артефактов, видимых только в динамике. На статических скриншотах всё может быть прекрасно и чётко, но в движении недостатки проявятся. И TXAA отлично справляется именно в таких случаях и призван в очередной раз улучшить качество сглаженной картинки. Вот ещё один пример, но уже статический:

Сглаживание TXAA действительно качественно работает, хотя у любителей чёткой и резкой картинки могут появиться вопросы к излишнему «замыливанию». Оно возникает из-за самого принципа сглаживания методом постобработки, и никуда от него не деться. Но на скриншоте Nvidia наше внимание привлёк совершенно другой момент — посмотрите на лампочку в середине кадра. Не это ли тот самый объект, к которому так и просится применение тесселяции, которая была красиво продемонстрирована парой картинок назад? Сколько ещё лет мы будем наблюдать угловатые лампочки и колёса? Вот что нужно улучшать, а то получается, что «слона то мы и не заметили»…

Плата Geforce GTX 660 Ti и модификации

Референсная плата Geforce GTX 660 Ti повторяет модель GTX 670. Сама по себе печатная плата весьма короткая и для неё возможно применение сравнительно компактных кулеров. PCB эталонного дизайна упрощена по сравнению с GTX 680, а из-за сниженных требований по питанию силовая часть перемещена на другую сторону платы. Графический процессор повёрнут вокруг оси, часть элементов перенесена на заднюю часть платы, и схема питания расположена к GPU ближе, чем обычно. Ровно как у GTX 670, только микросхемы питания размещены иначе.

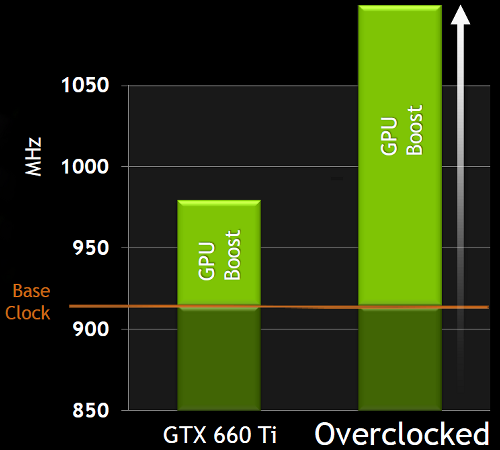

Несмотря на и так не самые низкие тактовые частоты GPU (применение технологии GPU Boost приводит к тому, что Geforce GTX 660 Ti в играх часто работает на частоте, близкой к 1 ГГц), представленная модель Geforce GTX 660 Ti вполне может обеспечить любителям разгона неплохие возможности по дальнейшему поднятию частот.

Ведь даже при большой нагрузке Geforce GTX 660 Ti с референсными частотами потребляет порядка 134 Вт энергии в игровых приложениях, что не превышает официального предела TDP, установленного в 150 Вт. А если изменить настройку «power target» в драйвере, увеличив её со 100% до +123%, что обычно рекомендуется при разгоне, плата в целом будет потреблять в таких приложениях лишь до 165 Вт, что совсем немного — очевидно, что у GTX 660 Ti имеется неплохой запас по разгону. А косвенно приличный разгонный потенциал может подтвердить факт единовременного выпуска разогнанных вариантов GTX 660 Ti партнёрами компании.

В случае с представленной сегодня видеокартой партнёры компании Nvidia получили возможность разработать платы собственного дизайна и продавать их прямо с самого начала продаж. И, начиная с сегодняшнего дня, в рознице появятся различные модели Geforce GTX 660 Ti разных производителей, имеющие оригинальный дизайн печатных плат, систем питания и охлаждения, а также повышенные тактовые частоты.

Приведём лишь несколько моделей, отличающихся от стандартных: Asus GTX 660 Ti DirectCU II Top, видеочип которой работает на частоте 1072(1137) МГц, Gigabyte GV-N66TOC-2GD и Zotac Geforce GTX 660 Ti AMP! Edition, графический процессор которых имеет частоту 1033(1111) МГц, а также MSI N660Ti-Power Edition 2GD5/OC, видеочип которой работает на 1019(1097) МГц.

Вероятно, некоторые из подобных моделей имеют усиленные системы питания с 8- и 6-контактными разъёмами дополнительного питания, увеличенным числом фаз и т. п. То же самое касается и систем охлаждения — как видите на фото, даже разогнанные варианты Geforce GTX 660 Ti имеют короткие, но эффективные кулеры с увеличенным количеством вентиляторов большого диаметра, что позволяет улучшить эффективность охлаждения.

Всё остальное в Geforce GTX 660 Ti повторяет то, что мы уже видели в предыдущей видеокарте Geforce GTX 670. Для вывода изображения на референсной плате имеется два выхода Dual Link DVI, один HDMI и один DisplayPort. Такое решение позволяет вывести стереоизображение сразу на несколько мониторов при помощи технологии 3D Vision Surround, что ранее было доступно лишь в SLI-конфигурации. Понятно, что новая модель поддерживает и все остальные технологии компании Nvidia, в том числе Adaptive VSync и PhysX.

Подведём краткие выводы. Благодаря применению мощнейшего графического процессора GK104, новая модель Geforce GTX 660 Ti предлагает все возможности (DirectX 11, PhysX, TXAA, адаптивный VSync и др.) наиболее совершенной топовой видеокарты GTX 680, а также уровень производительности, лишь немногим уступающий модели GTX 670, но по заметно более привлекательной цене. Новинка грозит стать одним из бестселлеров рынка ПК-комплектующих для игровых энтузиастов, особенно с учётом большого количества игровых систем, имеющих устаревшее DirectX 10-совместимое аппаратное обеспечение. Geforce GTX 660 Ti способна предложить владельцам таких ПК очень мощный прирост производительности вместе со всеми возможностями последнего поколения графики Nvidia.

На этом краткая теоретическая часть нашего материала закончена. Следующая часть статьи посвящена практической части исследования в синтетических тестах, в которой мы сравним производительность новой видеокарты Geforce GTX 660 Ti со скоростью других решений компании Nvidia, а также конкурирующих видеокарт компании AMD.

Nvidia Geforce GTX 660 Ti — Часть 2: видеоплаты и синтетические тесты →