Уже 112 быстрых калифорнийских стрелков…

Часть 1: Nvidia Editor's Day, октябрь 2007

«Дни редакторов» Nvidia, как правило, достаточно насыщены и интересны. Дата прошедшего, как обычно в Санта Кларе, Editors Day переносилась и уточнялась несколько раз. Редакция iXBT.com рисковала лишиться возможности участвовать в мероприятии по причине того, что паспорт с американской визой «репортёра» не удавалось получить до последнего момента. За восемь часов до рейса всё, наконец, было готово к трансатлантическому перелёту и, проведя почти двадцать часов на борту самолётов и в аэропортах, мы достигли цели.

Перелёт через 11 часовых поясов, взлёты-посадки, питание полуфабрикатами, были щедро сглажены шикарнейшим длинным линкольном и любезнейшим водителем, который доставил утомлённого редактора iXBT.com в отель.

Подобное гостеприимство — привычная практика устроителей Nvidia Editors Day в Калифорнии, но подача столь оригинального транспорта, годящегося, скорее, для свадебной церемонии — это что-то новенькое.

Калифорния встретила тёплым, но не палящим солнцем. Проблемные для многих жителей США и губернатора Калифорнии Арнольда Шварцнегера лесные пожары на юге штата никак не отражались на окрестностях Сан-Франциско и Санта Клары.

Ранним утром, тщетно разгоняя сон, редакторы разных изданий толпились у столика, получая бедж со своим именем. Представителям изданий из Европы приходилось особенно тяжко, ведь их соотечественники заканчивали рабочий день, а некоторые уже активно вели приготовления ко сну.

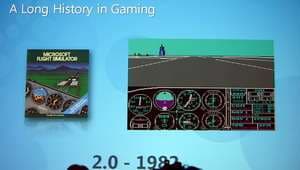

Лёгкий завтрак, и все уже внимательно слушают первого выступающего, представителя компании Microsoft. Бойкий мужчина с трудно выговариваемым именем Кевин Юнангст (Kevin Unangst) решил продемонстрировать эволюцию компьютерных игр для ОС Windows на примере известных симуляторов-леталок «Microsoft Flight Simulator».

Трогательная надпись на коробке с игрой версии 2.0 из серии Flight Simulator: «Now taking off in color on RGB monitors» (Игра доступна в цвете при использовании RGB-мониторов).

Новейшее поколение игры Microsoft Flight Simulator × Accelerator, поддерживающее DirectX 10, безусловно, громадный шаг после далёкого уже 1982 года. Скриншот из игры не уступает фотографии: натуральные тени, плавные, без «лесенок», линии, поражающая своей реалистичностью вода. Всё это уже стало возможным сегодня, но при одном условии: ваша система должна, нет, обязана поддерживать DirectX 10 для игр подобного уровня. Более того, никакая современная игровая консоль не предоставит нужного уровня производительности, чтобы достичь нового качества и реалистичности в играх. Так и только так вы сможете насладиться всем великолепием современных трехмерных игр… Во всяком случае, именно в этом убеждал собравшихся представитель Microsoft.

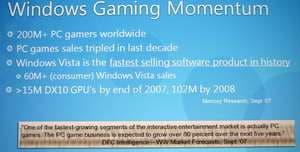

В подтверждение своих слов Кевин продемонстрировал слайд, из которого следовало, что объём продаж игр утроился за последнее десятилетие, а Windows Vista — самый быстро продающийся программный продукт в истории. Всё великолепие Vista и DX10 поддержат 15 млн. проданных до конца 2007 года графических процессоров (GPU), число которых к концу 2008 года должно вырасти до 102 млн.

Вторит Microsoft и Рой Тейлор (Roy Taylor), вице-президент Nvidia, ответственный за создание и появление нового контента, которым могут и должны воспользоваться современные hardware-разработки компании.

Свои слова он подкрепляет ещё более впечатляющими цифрами: 254 игры выпущены с момента запуска программы The way Nvidia: It's meant to be Played.

Общий тираж игр обеспечил оборот в 13 миллиардов долларов, 217 миллионов человек играют в онлайн-игры на текущий момент.

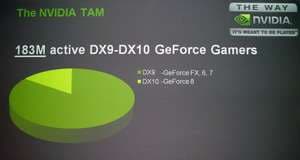

При этом Nvidia оценивает свою армию «активных геймеров, идущих в ногу со временем», в 183 миллиона.

Технология DirectX 10, по мнению Тейлора, позволила в два раза быстрее создавать новый и качественный контент. Так, например, тогда как с момента анонсирования DirectX 9 в декабре 2002 года прошло более года до появления первой настоящей DirectX 9 игры, первую DirectX 10 версию «Lost Planet» мы увидели всего через восемь месяцев, в июне 2007 года.

Об эффектах, позволяющих DirectX 10 играм быть столь впечатляющими, рассказано много, помочь их наглядно продемонстрировать помогли Nvidia разработчики, среди которых оказались Ирина Семёнова («Акелла», Россия), Олег Яворский («GSC», Украина), Ingo Horn и Pavel Miechowski («Metropolis», Польша), а также Fernando Paiz и Adam Mersky («Turbine», США).

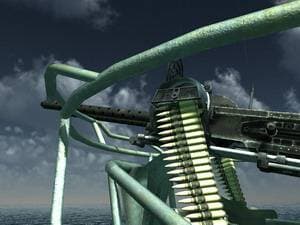

«Акелла» продемонстрировали стратегическую морскую баталию «PT Boats: Knights of the Sea».

Ребята из «GSC» доказали мощь DX10 на примере находящегося в разработке «S.T.A.L.K.E.R.: Clear Sky».

Польские коллеги из Варшавы впечатлили новым шутером от первого лица THEY с массой нововведений и эффектов.

Американские разработчики продемонстрировали необходимость DirectX 10 технологий и в онлайновых RPG, для чего привезли на Editors Day рабочую демо-версию «Lord of the Rings».

После столь массированной атаки на умы присутствующих, ни у кого уже не должно было остаться сомнений в том, что только DX10 технологии способны обеспечить необходимый уровень качества в играх, а необходимый минимум сможет обеспечить лишь Geforce 8800GT, речь о котором пойдёт далее.

Перед тем, как перейти к «гвоздю» нашего обзора хотелось бы отметить, что сотрудники Nvidia, как обычно, сосредоточены не только на разработке современных и производительных GPU, но и стараются предлагать комплексные решения для экстремальных (и не очень) геймеров. О некоторых вещах говорить во всеуслышание пока рано. О некоторых можно говорить только шёпотом. Приоткрывая завесу таинственности, отметим, что в самом скором времени чипсету P35 и X38 найдётся достойный ответ. Помимо поддержки DDR3 и современных процессоров Intel, Nvidia предложит новый уровень SLI, допускающий не только привычный «традиционный» и «квад» SLI, но и производительный «тройной SLI».

Полагаем, можно сказать, что компьютерным энтузиастам с оппозиционными взглядами также найдётся достойный вариант для модернизации своей платформы.

Вернёмся в настоящее, позволившее сделать компьютерную реальность ещё более завораживающей: на арене новый лидер соотношения цена/производительность Geforce 8800GT.

Часть 2: Теория и архитектура

В исследовании, посвященном выходу новых видеочипов среднего уровня из линейки Nvidia G8x, мы посетовали на то, что эти решения для среднего и низшего сегментов были слишком сильно урезаны по количеству исполнительных блоков ALU и TMU, по сравнению с ожидаемым всеми пользователями уровнем, а также на то, что даже в старшем mid-end так и не появилась 256-битная шина памяти. Ещё тогда мы высказали опасения, что новые видеокарты покажут сравнительно слабые результаты в современных играх, и поддержка DirectX 10 им не поможет. Так и получилось — в дальнейших исследованиях low-end и mid-end продукты линейки G8x показали свою явную слабость.

И теперь, через полгода после анонса чипа G84 и решений на его основе, выходит новый видеочип — G92. Первые видеокарты на его основе нацелены на так называемый верхний средний уровень, от $200 до $250. Именно этот видеочип стал основой мощнейших видеокарт среднего уровня, принесших как 256-битную шину памяти в этот ценовой диапазон, так и сравнительно большое количество универсальных исполнительных блоков. Итак, сегодня мы знакомимся с обновленным mid-end решением Nvidia на базе обновленной унифицированной архитектуры G9x.

Перед прочтением данного материала мы рекомендуем внимательно ознакомиться с базовыми теоретическими материалами DX Current, DX Next и Longhorn, описывающими различные аспекты современных аппаратных ускорителей графики и архитектурные особенности продукции Nvidia и AMD (ранее ATI).

- [06.06.05] Longhorn — ускорители и шейдеры для DirectX 10

- [01.03.05] DirectX.Update — Ускорители 3D-графики: полшага вперед

- [09.04.04] DX.Next: ближайшее и ближнее будущее аппаратного ускорения 3D-графики

Эти материалы достаточно точно спрогнозировали текущую ситуацию с архитектурами видеочипов, оправдались многие предположения о будущих решениях. Подробную информацию об унифицированной архитектуре Nvidia G8x на примере предыдущих чипов можно найти в следующих статьях:

- [08.11.06] Nvidia Geforce 8800 GTX (G80) — новый монстр в 3D-графике и первый DX10-ускоритель

- [17.04.07] Nvidia Geforce 8600 GTS (G84) — 32 калифорнийских стрелка в действии

Сразу отметим, что информация в этом теоретическом обзоре будет неполной — Nvidia не спешит выдавать все подробности о своих новых чипах и картах. Например, мы точно не знаем, поддерживает ли чип какие-то новые особенности, недоступные линейке G8x (например, Shader Model 4.1 и расчеты с точностью FP64 для CUDA и других соответствующих применений). Не совсем понятно, чем объяснить такую секретность, то ли опасениями перед выпуском соответствующих решений единственными конкурентами, то ли просто тем, что в Nvidia сильно расслабились. А ещё может быть, что название G9x оправдывается только новым техпроцессом, хотя раньше такие (и даже большие) обновления чипов старались включать в ту же линейку, вспомните G71 или NV35.

Архитектура обновленного чипа основана на давно известной нам архитектуре Geforce 8 (G8x). Чип G92 включает в себя все преимущества G8x, такие как унифицированная шейдерная архитектура, полная поддержка DirectX 10, качественные методы анизотропной фильтрации и новый алгоритм антиалиасинга CSAA с количеством сэмплов до шестнадцати. Некоторые блоки отличаются от тех, что были в G80, в лучшую сторону. На данный момент на основе G92 планируются готовые решения по цене от $199 до $249, то есть среднем ценовом диапазоне. Основное изменение — технология производства 65 нм, которая позволяет снизить себестоимость, очень важную для сравнительно недорогих продуктов. Возможно, именно более тонкая технология позволила вывести решения в этот ценовой сектор.

Графический ускоритель Geforce 8800 GT

- Кодовое имя чипа G92

- Технология 65 нм

- 754 миллиона транзисторов (больше, чем у G80)

- Унифицированная архитектура с массивом общих процессоров для потоковой обработки вершин и пикселей, а также других видов данных

- Аппаратная поддержка DirectX 10, в том числе шейдерной модели — Shader Model 4.0, генерации геометрии и записи промежуточных данных из шейдеров (stream output)

- 256-бит шина памяти, четыре независимых контроллера шириной по 64 бита

- Частота ядра 600 МГц (Geforce 8800 GT)

- ALU работают на более чем удвоенной частоте (1.5 ГГц для Geforce 8800 GT)

- 112 (это у для Geforce 8800 GT, а всего, вероятно, 128) скалярных ALU с плавающей точкой (целочисленные и плавающие форматы, поддержка FP 32-бит точности в рамках стандарта IEEE 754, MAD+MUL без потери тактов)

- 56 (64) блоков текстурной адресации с поддержкой FP16 и FP32 компонент в текстурах (пояснения см. ниже)

- 56 (64) блоков билинейной фильтрации (как и в G84 и G86, нет бесплатной трилинейной фильтрации и более эффективной анизотропной фильтрации)

- Возможность динамических ветвлений в пиксельных и вершинных шейдерах

- 4 широких блока ROP (16 пикселей) с поддержкой режимов антиалиасинга до 16 сэмплов на пиксель, в том числе при FP16 или FP32 формате буфера кадра. Каждый блок состоит из массива гибко конфигурируемых ALU и отвечает за генерацию и сравнение Z, MSAA, блендинг. Пиковая производительность всей подсистемы до 64 MSAA отсчетов (+ 64 Z) за такт, в режиме без цвета (Z only) — 128 отсчета за такт

- Запись результатов до 8 буферов кадра одновременно (MRT)

- Все интерфейсы (два RAMDAC, два Dual DVI, HDMI, HDTV) интегрированы на чип (в отличие от вынесенных на внешний дополнительный чип NVIO у Geforce 8800)

Первые видеокарты на базе чипа G92

Спецификации референсной карты Geforce 8800 GT 512MB

- Частота ядра 600 МГц

- Частота универсальных процессоров 1500 МГц

- Количество универсальных процессоров 112

- Количество текстурных блоков — 56, блоков блендинга — 16

- Эффективная частота памяти 1.8 ГГц (2*900 МГц)

- Тип памяти GDDR3

- Объем памяти 512 мегабайт

- Пропускная способность памяти 57.6 гигабайта в сек.

- Теоретическая максимальная скорость закраски 9.6 гигапикселя в сек.

- Теоретическая скорость выборки текстур до 33.6 гигатекселя в сек.

- Энергопотребление до 110 Вт

- Два DVI-I Dual Link разъема, поддерживается вывод в разрешениях до 2560х1600

- SLI разъем

- Шина PCI Express 2.0

- TV-Out, HDTV-Out, поддержка HDCP

- Рекомендуемая цена $249

Спецификации референсной карты Geforce 8800 GT 256MB

- Частота ядра 600 МГц

- Частота универсальных процессоров 1500 МГц

- Количество универсальных процессоров 112

- Количество текстурных блоков — 56, блоков блендинга — 16

- Эффективная частота памяти 1.4 ГГц (2*700 МГц)

- Тип памяти GDDR3

- Объем памяти 256 мегабайт

- Пропускная способность памяти 44.8 гигабайта в сек.

- Теоретическая максимальная скорость закраски 9.6 гигапикселя в сек.

- Теоретическая скорость выборки текстур до 33.6 гигатекселя в сек.

- Энергопотребление до 110 Вт

- Два DVI-I Dual Link разъема, поддерживается вывод в разрешениях до 2560х1600

- SLI разъем

- Шина PCI Express 2.0

- TV-Out, HDTV-Out, поддержка HDCP

- Рекомендуемая цена $199

Как видите, выпуск Geforce 8800 GT планируется в двух вариантах, отличающихся объёмами видеопамяти и её частотами, а соответственно, и пропускной способностью. Частота памяти более дорогого варианта с 512 мегабайтами локальной видеопамяти, который и появится на рынке первым, равна 1800 МГц, а для второго — лишь 1400 МГц. Вариант с меньшим количеством памяти появится в продаже позже, подобные продукты будут выпускаться некоторыми из партнеров Nvidia. Geforce 8800 GT должен усилить позиции Geforce 8600 и продолжить линейку успешных решений Nvidia среднего ценового диапазона, одних из самых и массовых.

Очень важно сделать отступление по поводу необходимого современным играм количества видеопамяти. Как показало наше недавнее исследование, последние игры весьма требовательны к объему видеопамяти, они используют до 500-600 мегабайт. И хотя это не значит, что все ресурсы игр должны обязательно находиться именно в локальной памяти видеокарты, часто менеджмент ресурсов может отдаваться в управление API, тем более что в Direct3D 10 используется виртуализация видеопамяти. Тем не менее, в современных 3D-приложениях прослеживается четкая тенденция к увеличению требуемых объемов локальной памяти. 256 мегабайт стали минимально необходимым объёмом, а оптимальным количеством памяти на данный момент является 512 Мбайт. И при выборе между двумя вышеуказанными вариантами Geforce 8800 GT это нужно обязательно иметь в виду.

Архитектура

По предоставленной компанией Nvidia информации непонятно, отличается ли архитектурно G92 от G8x или нет. По тому, что известно, можно грубо сказать, что G92 — это флагман линейки (G80), переведенный на новый техпроцесс, с небольшими изменениями. Это значительно лучше, чем предыдущий чип G84, являющийся не то одной третьей частью G80, не то его четвертью. Nvidia указывает в своих материалах, что чип имеет семь больших шейдерных блоков и, соответственно, 56 текстурных блоков, а также по четыре широких ROP, число транзисторов в чипе вызывает подозрения, что они что-то не договаривают. Вполне вероятно, что в анонсированных сегодня решениях задействованы не все блоки, существующие в чипе физически, и в G92 физическое их количество больше, чем активных в Geforce 8800 GT. Хотя увеличенная сложность чипа объясняется включением в его состав ранее отдельного чипа NVIO, а также видеопроцессора нового поколения. Кроме того, на количество транзисторов повлияли и усложненные блоки TMU. Также, вполне вероятно, были увеличены кэши для увеличения эффективности 256-битной шины памяти.

Итак, в этот раз, чтобы составить достойную конкуренцию будущим чипам AMD, в Nvidia решили оставить в mid-end чипе довольно большое количество блоков. Подтвердилось наше предположение из обзора G84 и G86, что на основе технологии 65 нм выпустят гораздо более производительные чипы для среднего ценового диапазона. Чуть позже мы обязательно оценим производительность новых чипов в синтетических и игровых тестах, но уже сейчас можно точно сказать, что решения на основе G92 будут очень быстры из-за большого количества блоков ALU, TMU, ROP и хорошей пропускной способности шины памяти.

Архитектурных изменений в чипе G92 немного, и мы не будем на этом останавливаться подробно, изменений по сравнению с G8x нет, судя по представленным Nvidia данным. Всё сказанное в обзорах предыдущих решений из серии Geforce 8 остаётся в силе, мы повторим только некоторые основные моменты, посвященных архитектурным спецификациям нового чипа.

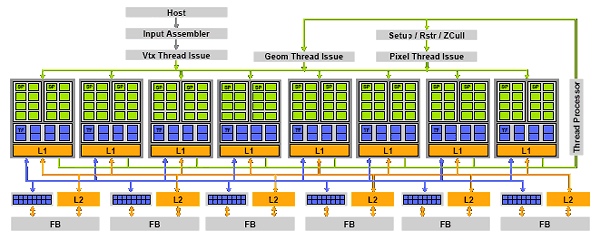

Диаграмма чипа унифицированной архитектуры G80 выглядит так:

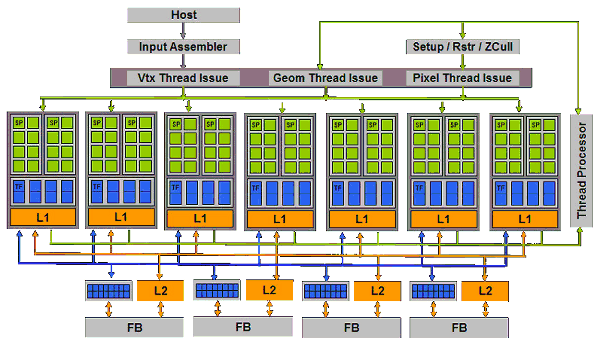

А для нового решения Nvidia в своих документах приводит такую схему:

Универсальные процессоры и TMU

Схема шейдерных блоков и оценка их пиковой вычислительной производительности G80 приводилась в соответствующей статье, для G92 она не изменилась, их производительность пересчитать несложно, исходя из изменений в тактовой частоте. ALU в чипах работают на более чем удвоенной частоте, они скалярные, что позволяет добиться высокого КПД. Про функциональные отличия пока что неизвестно, доступна ли точность расчетов FP64 в этом чипе или нет. Точно есть поддержка вычислений в целочисленном формате, а при реализации всех вычислений соблюден стандарт IEEE 754, важный для научных, статистических, экономических и других расчетов.

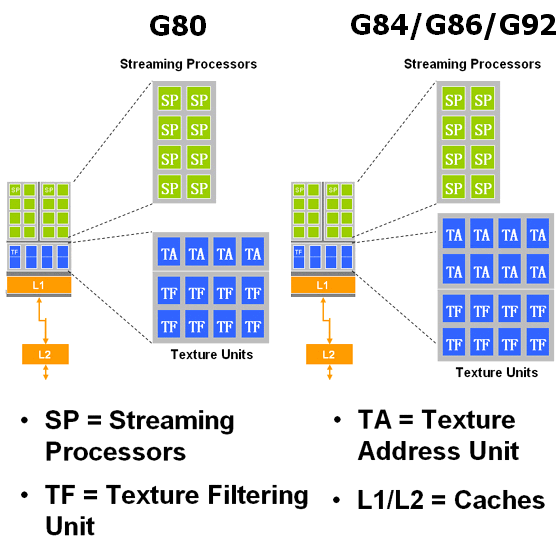

Текстурные модули в G92 не такие, как в G80, они повторяют решение TMU в G84 и G86, в которых были сделаны архитектурные изменения для увеличения производительности. Напомним, что в G80 каждый текстурник мог вычислять по четыре текстурных адреса и выполнять по восемь операций текстурной фильтрации за такт, а в G84/G86 TMU способны на большее в два раза количество текстурных выборок. То есть, каждый из блоков имеет восемь модулей адресации текстур (определения по координатам точного адреса для выборки) TA и ровно такое же количество модулей билинейной фильтрации (TF):

Блоки ROP, запись в буфер кадра, сглаживание

Блоки ROP сами по себе также не изменились, но их количество стало другим. В G80 было шесть ROP, а в новом решении их стало четыре, для снижения себестоимости производства чипов и PCB видеокарт. Также это урезание может быть связано с тем, чтобы не создавать слишком сильную конкуренцию существующим решениям верхнего уровня.

Каждый из блоков обрабатывает по четыре пикселя или 16 субпикселей, и всего получается 16 пикселей за такт для цвета и Z. В режиме только Z обрабатывается в два раза большее количество сэмплов за один такт. При MSAA 16х чип может выдавать два пикселя за такт, при 4х — 8 и т.д. Как и в G80, полноценно поддерживаются форматы буфера кадров FP32 и FP16 совместно с антиалиасингом.

Поддерживается известный по предыдущим чипам серии новый метод сглаживания — Coverage Sampled Antialiasing (CSAA), который был подробно исследован в соответствующем материале:

- [15.12.06] Детальное исследование Coverage Sampling Antialiasing, реализованного в серии GPU Geforce 8800

Вкратце, суть метода такова, что цвета отсчетов и глубина хранятся отдельно от информации об их местоположении, на один пиксель может приходиться по 16 отсчетов и всего восемь вычисленных значений глубины, что экономит пропускную способность и такты. CSAA позволяет обойтись передачей и хранением одного значения цвета или Z на каждый субпиксель, уточняя усредненное значение экранного пикселя за счёт более подробной информации о том, как этот пиксель перекрывает края треугольников. В итоге, новый метод позволяет получать режим сглаживания 16х, заметно более качественный, чем MSAA 4х, с не слишком большими вычислительными затратами.

Еще одним нововведением стало то, что в Geforce 8800 GT был обновлен алгоритм антиалиасинга полупрозрачных поверхностей (transparency antialiasing). На выбор пользователя предлагались два варианта: мультисэмплинг (TRMS) и суперсэмплинг (TRSS), первый отличался очень хорошей производительностью, но эффективно работал не во всех играх, а второй был качественным, но медленным. В Geforce 8800 GT декларируется новый метод мультисэмплинга полупрозрачных поверхностей, улучшающий его качество и производительность. Этот алгоритм даёт почти такое же улучшение качества, как и суперсэмплинг, но отличается высокой производительностью — лишь на несколько процентов хуже для режима без включенного антиалиасинга полупрозрачных поверхностей.

PureVideo HD

Одним из ожидаемых изменений в G92 стал встроенный видеопроцессор второго поколения, известный по G84 и G86, получивший расширенную поддержку PureVideo HD. Уже известно, что этот вариант видеопроцессора почти полностью разгружает CPU при декодировании всех типов видеоданных, в том числе «тяжелых» форматов H.264 и VC-1.

Как и в G84/G86, в G92 используется новая модель программируемого PureVideo HD видеопроцессора, включающая так называемый BSP движок. Новый процессор поддерживает декодирование H.264, VC-1 и MPEG-2 форматов с разрешением до 1920x1080 и битрейтом до 30-40 Мбит/с, выполняя работу по декодированию CABAC и CAVLC данных аппаратно, что позволяет воспроизводить все существующие HD-DVD и Blu-ray диски даже на средних по мощности одноядерных ПК. Декодирование VC-1 не такое эффективное, как H.264, но оно всё же поддерживается новым процессором.

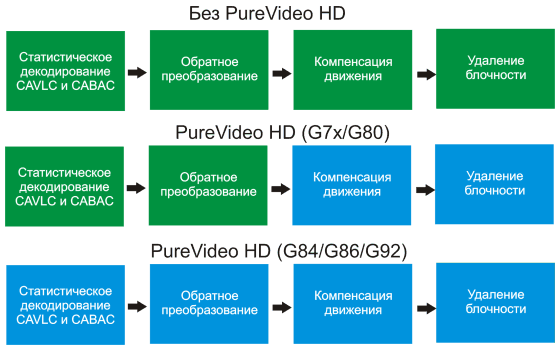

Подробнее о видеопроцессоре второго поколения можно прочитать в обзоре G84 и G86, а тут мы приведем наглядную схему, показывающую различия в степени аппаратной поддержки декодирования видео на разных видеочипах:

Голубым цветом выделены задачи, выполняемые видеочипом, а зелёным — центральным процессором. Старые чипы помогали процессору только в части задач, а новый видеопроцессор, применяемый во всех последних чипах Nvidia, делает задачи самостоятельно. Работа современных видеорешений была частично проверена в последнем материале по исследованию эффективности аппаратного декодирования видеоданных.

PCI Express 2.0

Из настоящих нововведений в G92 можно выделить поддержку шины PCI Express 2.0. Вторая версия PCI Express увеличивает стандартную пропускную способность в два раза, с 2.5 Гбит/с до 5 Гбит/с, в результате, по разъему x16 можно передавать данные на скорости до 8 ГБ/с в каждом направлении, в отличие от 4 ГБ/с для версии 1.x. При этом очень важно, что PCI Express 2.0 совместим с PCI Express 1.1, и старые видеокарты будут работать в новых системных платах, и новые видеокарты с поддержкой второй версии останутся работоспособными в платах без его поддержки. При условии достаточности внешнего питания и без увеличения пропускной способности интерфейса, естественно.

Для обеспечения обратной совместимости с существующими PCI Express 1.0 и 1.1 решениями, спецификация 2.0 поддерживает как 2.5 Гбит/с, так и 5 Гбит/с скорости передачи. Обратная совместимость PCI Express 2.0 позволяет использовать прошлые решения с 2.5 Гбит/с в 5.0 Гбит/с слотах, которые будут работать на меньшей скорости, а устройство, разработанное по спецификациям версии 2.0, может поддерживать и 2.5 Гбит/с и 5 Гбит/с скорости. В теории с совместимостью всё хорошо, а на практике с некоторыми сочетаниями системных плат и карт расширения возможно возникновение проблем.

Поддержка внешних интерфейсов

Как и следовало ожидать, имеющийся на платах Geforce 8800 дополнительный чип NVIO, поддерживающий вынесенные за пределы основного внешние интерфейсы (два 400 МГц RAMDAC, два Dual Link DVI (или LVDS), HDTV-Out), в данном случае был включен в состав самого чипа, поддержка всех указанных интерфейсов встроена в сам G92.

На видеокартах Geforce 8800 GT обычно устанавливают два Dual Link DVI-I выхода с поддержкой HDCP. Что касается HDMI, поддержка этого разъема реализована полностью, она может быть выполнена производителями на картах специального дизайна, которые могут быть выпущены несколько позже. Хотя наличие разъема HDMI на видеокарте необязательно, его с успехом заменит переходник с DVI на HDMI, который прилагается в комплекте большинства современных видеокарт.

В отличие от видеокарт серии RADEON HD 2000 компании AMD, Geforce 8800 GT не содержит встроенный аудиочип, необходимый для поддержки передачи звука по DVI при помощи переходника на HDMI. Подобная возможность передачи видео- и аудиосигнала по одному разъему востребована, прежде всего, на картах среднего и низшего уровней, которые устанавливаются в маленькие корпусы медиацентров, а Geforce 8800 GT вряд ли подходит на эту роль.

Практическая часть исследования, посвященная тому, насколько сильно новое решение Nvidia отличается от предыдущих и конкурирующих, будет опубликована чуть позже — из-за позднего получения тестового образца видеокарты Geforce 8800 GT.