Уже довольно много времени прошло с момента публикации нашей теоретической статьи о наборе технологий ATI AVIVO, но до практического тестирования аппаратно ускоренного проигрывания видеоданных дело не доходило. Частично это связано с тем, что на тот момент и ATI и NVIDIA так активно развивали поддержку декодирования видео в драйверах, что почти в каждом из релизов были большие нововведения в этом плане, и сравнивать производительность чипов разных вендоров было тяжело, так как ситуация менялась каждый месяц. Но сейчас всё вроде бы более-менее устоялось, то ли ATI и NVIDIA "вылизали" поддержку упомянутых в теоретической статье возможностей по поддержке декодирования видео, то ли надоело им заниматься этой задачей. Мы решили проверить на практике, насколько хорошо обстоят дела по декомпрессии и выводу видеоданных с аппаратной помощью видеочипов.

Воспроизведение видеоданных высокого разрешения ("High Definition", сокращенно — HD) в современных форматах сжатия, весьма требовательных к мощности системы, является ресурсоемкой задачей даже для мощных ПК. Основная нагрузка приходится на центральный процессор, но современные видеокарты берут на себя выполнение части вычислений по декодированию и постобработке. В современных видеочипах ATI и NVIDIA есть программируемые блоки для задач ускорения декодирования и постобработки разных видеоформатов. Технология, задействующая возможности видеочипов при воспроизведении видео, называется DirectX Video Acceleration (DXVA). Она позволяет использовать помощь видеопроцессора в декодировании и постобработке (деинтерлейсинг, шумоподавление и т.п.), а возможности чипов последних выпусков от ATI и NVIDIA по декодированию видео включают поддержку основных форматов: MPEG2, WMV9 и H.264. Для этого требуются специальные декодеры (ATI DVD Decoder, PureVideo Decoder, CyberLink MPEG2 и H.264 video decoder), и проигрыватели, поддерживающие DXVA, такие, как Windows Media Player 10. Сначала появились DXVA декодеры для аппаратного ускорения MPEG2, затем выпустили дополнение для WMP10 с поддержкой DXVA для декодирования WMV9 формата, а в последние два года появились H.264 декодеры с DXVA-ускорением, одним из первых был CyberLink. А совсем недавно, весной этого года, вышел качественный программный декодер формата H.264, под названием CoreAVC, который мы также рассмотрим в статье.

С проигрыванием MPEG2 видео в невысоких разрешениях (до используемого в DVD дисках 480p/480i) на данный момент особых проблем с производительностью не возникает, но в начале распространения DVD видео, когда типичные процессоры не очень хорошо справлялись с декодированием MPEG2, была ситуация, когда только с помощью аппаратной поддержки от видеокарт компьютеры того времени могли справиться с этой задачей. И сейчас, без соответствующей поддержки, даже некоторые новые CPU не всегда могут полностью удовлетворить требования по декодированию такого современного формата, как H.264 в самых высоких разрешениях, например, в 1080p (прогрессивный 1920x1080). По заявлениям ATI и NVIDIA, их последние видеочипы помогают процессорам в декодировании наиболее требовательного к ресурсам формата H.264, в дополнение к уже известным WMV и MPEG2, в том числе в высоких разрешениях.

Для разных чипов существуют некоторые ограничения, так, не все low-end чипы обладают необходимыми возможностями и производительностью для поддержки самых высоких разрешений, уровень аппаратной поддержки зависит от модели карты и установленного чипа. Но возможности, предоставляемые последними видеокартами по аппаратному ускорению декодирования H.264, позволяют говорить о теоретическом решении проблем с воспроизведением таких файлов. Так ли это или на практике проблемы еще остались? В статье мы рассмотрим сравнительные производительность и качество воспроизведения видео разных форматов, начиная с MPEG2 и заканчивая все тем же относительно свежим H.264/AVC, информацию о котором можно найти в уже упомянутом теоретическом материале. Особое внимание мы обратим на полностью программный декодер CoreAVC, который показал себя с хорошей стороны с момента его выпуска. CoreAVC оказался значительно более эффективным, по сравнению с другими известными H.264 декодерами от CyberLink и Nero, не говоря уже о декодере QuickTime, при том же качестве картинки. Кстати, на данный момент аппаратно ускоренная версия CoreAVC пока еще отсутствует в публичном доступе, но, судя по заявлениям его разработчиков, планы по поддержке видеочипов у них есть.

Конфигурация тестовой системы, используемое программное обеспечение и настройки

Аппаратная конфигурация тестовой системы:

- Процессор: AMD Athlon 64 3200+ Socket 939

- Системная плата: Foxconn WinFast NF4SK8AA-8KRS (NVIDIA nForce4 SLI)

- Оперативная память: 2048 Мб DDR SDRAM PC3200

- Жесткий диск: Seagate Barracuda 7200.7 120 Gb SATA

- Операционная система: Microsoft Windows XP Professional SP2

Для тестов использовались две видеокарты на чипах основных производителей:

- Видеокарта: ATI RADEON X1800 XL 256MB (500/1000 МГц), драйвер Catalyst 6.9

- Видеокарта: NVIDIA GeForce 7800 GTX 256MB (430/1200 МГц), драйвер ForceWare 92.91 Official Beta

Использовалась последняя, доступная на момент написания версия драйвера CATALYST и последняя официальная бета-версия ForceWare, так как именно в ней, по заявлению NVIDIA, были сделаны некие нововведения и изменения, связанные с технологией PureVideo.

Используемое программное обеспечение (проигрыватели, кодеки):

- Microsoft Windows Media Player 10.00.00.3923 (с Windows Media Video Decoder 10.00.00.3923 в комплекте)

- CyberLink PowerDVD 7.0 Deluxe

- Apple QuickTime Player 7

- ATI MPEG Video Decoder 9.14.0.60504

- NVIDIA PureVideo Decoder 1.02.223 (NVIDIA Video Decoder 04.02-223)

- CoreAVC Pro 1.1.0.5

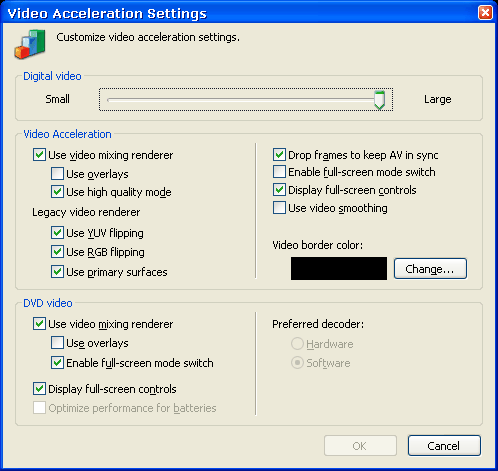

Все настройки драйверов и программного обеспечения оставлены по умолчанию. Основные настройки производительности Windows Media Player 10, использованные при тестировании, приведены на скриншоте:

"High quality mode" в настройках WMP10 отвечает за использование Video Mixing Renderer 9 (VMR9). Скриншоты захватывались в разрешении 1024x768 при полноэкранном выводе изображения, а тестирование производительности проводилось в 1920x1080. Поддержка оверлеев была отключена, чтобы производить захват скриншотов в одинаковых условиях для карт ATI и NVIDIA.

Список видеороликов, используемых в тестах

| Видеофайл | Формат | Разрешение, пикс | HD формат | Частота кадров, FPS | Битрейт, Мбит/с |

| da_vinci_code-tsr2_h720p.mp4 | H.264 | 1280x720 | 720p | 24 | 5 |

| ice_age_2-tlrD_h1080p.mp4 | H.264 | 1920x1080 | 1080p | 24 | 10 |

| PGR3_E32005_Xbox360_Video.wmv | WMV HD | 1280x720 | 720p | 30 | 5 |

| MP10_Striker_10mbps.wmv | WMV HD | 1920x1080 | 1080p | 24 | 10 |

| opening2.mpg | MPEG2 | 720x480 | 480i | 30 | 7 |

| emotion.mpg | MPEG2 | 1920x1080 | 1080i | 30 | 18 |

| test-hdtv.mpg | MPEG2 | 1920x1080 | 1080p | 25 | 20 |

Как видите, в состав тестового материала вошли ролики во всех наиболее востребованных видеоформатах, чаще всего в двух распространенных разрешениях — 1280x720 и 1920x1080. Помимо этого, в состав тестов вошел и небольшой MPEG2 ролик с разрешением всего лишь 720x480 (480i), так как DVD диски до сих пор весьма широко используются. Единственное отличие ролика от формата большинства DVD дисков — его чересстрочность (интерлейсинг). Если исключить влияние деинтерлейсинга, с MPEG2 видео проблем обычно не бывает.

Тесты проводились в разрешении 1920x1080 при помощи собственной утилиты с использованием ActiveX компоненты Windows Media Player 10, позволяющей замерять использование ресурсов процессора во время проигрывания, получать статистику WMP10, а также снимать скриншоты с точной установкой позиции ролика на нужный кадр видеопоследовательности. Замерялась средняя загрузка центрального процессора системы при трехкратном проигрывании каждого из роликов. Проводился также сбор и попытка использования таких значений, как количество пропущенных кадров в секунду и достигнутая при проигрывании частота кадров, но оба эти значения на некоторых сочетаниях роликов и декодеров получались явно некорректными, и от затеи пришлось отказаться. С подсчетом среднего времени загрузки CPU никаких проблем нет, и это значение было принято для использования в тестах при определении качества аппаратной поддержки декодирования видео платами ATI и NVIDIA. Лишь в одном случае упомянута и цифра пропущенных кадров видеопоследовательности.

Результаты тестирования

Тесты мы начнем с самого интересного формата — H.264. Обе видеокарты тестировались с применением двух декодеров — полностью программного CoreAVC Pro, в который еще не встроили поддержку аппаратного ускорения видеокартами, и поддерживающем DXVA ускорение CyberLink H.264/AVC Decoder из комплекта PowerDVD 7 Deluxe. Также, для сравнения, приведена цифра загрузки процессора при помощи программного декодера H.264, встроенного в пакет QuickTime. Этот декодер появился одним из первых, и большая часть заслуги в продвижении H.264 как весьма ресурсоемкого формата принадлежит именно ему.

H.264 (720p)

Цифры показывают, что декодирование формата H.264 даже в не самом высоком разрешении 720p с применением устаревшего программного декодера QuickTime почти полностью задействует мощности не самого слабого тестового процессора. Наблюдаются явные рывки и пропуски кадров, пусть и не такие массовые, но все же неприятные. Декодер CyberLink нормально справляется с работой на обеих видеокартах, загрузка на ATI оказалась чуть ниже, чем на NVIDIA. То же самое мы видим и на примере CoreAVC, хотя он и полностью программный, NVIDIA все же немного отстает от ATI по производительности. Но разница совсем невелика — 7-8%, и с учетом того, что CPU загружен менее чем наполовину, я бы сказал, что ее почти нет, она не будет ощутима практически.

Теперь проверим получаемое качество картинки. Оно во всех случаях оказалось почти идентичным, никакой значительной разницы я не нашел, но пару примеров привести обязан.

Никаких претензий по качеству ни к одному из сочетаний видеокарт и декодеров не возникло, все показывают одинаковую картинку, есть лишь небольшая разница в производительности.

H.264 (1080p)

Второй ролик формата H.264 отличается от первого тем, что использует самое высокое разрешение — 1920x1080, вместе с прогрессивной разверткой. Посмотрим, будет ли отличаться достигнутая производительность при использовании разных декодеров и видеокарт в этот раз, и сможет ли Athlon 64 3200+ справиться с декодированием такого материала.

QuickTime почти на 100% использовал мощности центрального процессора при проигрывании ролика такого высокого разрешения. Мало того, он пачками пропускал кадры и тормозил при этом. Почему я обращаю на это внимание, спросит читатель? Ведь в материале рассматривается аппаратное ускорение видео, которое в декодере QuickTime не применяется. А пример приведен потому, что в начале распространения роликов в H.264, QuickTime был чуть ли не единственным доступным декодером видеофайлов этого формата. По нему все и ориентировались, удивляясь, какой же "тяжелый" этот новый формат…

При взгляде на результаты CoreAVC, второго программного декодера, становится ясно, что не формат тяжелый, а декодеры нужно уметь писать. Посмотрите — не имеющий аппаратной поддержки декодирования CoreAVC и на втором ролике обгоняет продвинутый (на словах) CyberLink с заявленной DXVA поддержкой! Карты ATI и NVIDIA показывают в этот раз более близкие результаты, но небольшое преимущество у ATI все же остается. Особенно для CyberLink, не зря же они начинали разрабатывать декодер совместно с ATI. При этом чисто субъективное впечатление от работы декодера на NVIDIA хуже, чем показанные на графике сравнительные цифры. На карте NVIDIA в этом случае было отмечено больше дерганий и нестабильности в достигнутом FPS, что подтверждается и статистикой количества пропущенных кадров в секунду. Это единственный ролик обзора, в котором при проигрывании стабильно пропускались кадры (около 15-20 и 140-150 на ATI и NVIDIA, соответственно). Повторюсь — речь идет только о декодере CyberLink.

Как и в случае первого ролика, никаких значительных изменений в качестве при использовании разных H.264 декодеров я не увидел. Все абсолютно такое же и на ATI, и на NVIDIA, за исключением явно разных контраста и яркости, которые при настройках по умолчанию оказались на ATI несколько приятнее для глаза. В любом случае, GeForce можно настроить точно также, это не проблема, проверено.

Второй кадр показывает то же самое, что и первый, лишь заметная разница по настройке контрастности и яркости отличает скриншоты ATI и NVIDIA. Небольшие отличия есть еще в четкости букв и логотипов внизу, но однозначно нельзя сказать, где оно лучше, тем более что и тут может сказываться иная настройка контрастности.

Итоги по H.264 будут такими — с незначительным преимуществом по производительности впереди оказалась ATI, и то — из-за результатов декодера производства CyberLink, в случае CoreAVC результаты почти одинаковые. С CoreAVC всё значительно лучше. Вывод — не все то золото, что блестит. Иными словами, поддержка аппаратного декодирования сама по себе не означает лучшей производительности и/или качества. CoreAVC по скорости лучше, а по качеству ничем не уступает. Третий вывод — в качестве декодирования H.264 никаких проблем не обнаружено.

WMV HD (720p)

Диаграммы по декодированию WMV будут проще, в них указан лишь один возможный декодер — от самой Microsoft. Он поставляется вместе с Windows Media Player и является единственным доступным декодером WMV (вроде бы в ffdshow есть какая-то альтернативная возможность, но она пока не работает).

Первый WMV HD ролик имеет разрешение 1280x720 (720p) и закодирован со сравнительно низким битрейтом 5 Мбит/с. Производительность при проигрывании этого ролика оказалась чуть выше у видеокарты на базе чипа NVIDIA, но разница очень небольшая. Как и в случае с H.264, декодирование 720p ролика не отняло даже половины мощности тестового процессора, никаких проблем с проигрыванием не наблюдалось, все было гладко и плавно.

Разницы не было обнаружено и по качеству, за исключением уже указанных отличий в настройке яркости и контрастности. Впрочем, битрейт первого тестового WMV HD ролика слишком низок и его качество невысоко, возможно, что на 1080p материале будет иначе.

WMV HD (1080p)

1080p ролик с бОльшим битрейтом отнимает у CPU лишь немногим больше ресурсов, по сравнению с 720p. И опять NVIDIA выигрывает совсем чуть-чуть у ATI, около 5%, которые не будут заметны в реальной жизни. Получается, что даже с 1080p материалом не самая мощная тестовая система справляется очень хорошо. Возможно, на других WMV HD роликах ситуация будет иной, но этот проигрывается без всяких проблем. Осталось проверить получаемое качество.

Первый сюрприз по качеству картинки! У ATI остается лучшая настройка яркости и контраста по умолчанию, но зато появляется явный бандинг на плавных цветовых переходах, более всего заметный на выделенном фрагменте, но существенный и на других участках скриншота. Нужно проверить качество на еще одном тестовом скриншоте…

И опять на ATI явные проблемы с качеством на выделенном участке тестового скриншота, только уже в виде еле заметных полосок. Хотя и небольшой бандинг на плавных синих переходах также остался.

Выводы по WMV HD для ATI не очень утешительные — наблюдаются явные проблемы с качеством декодируемой и выводимой на экран картинки. Возможно, это проблема конкретной версии драйверов или сочетания тестовой конфигурации, но факт остается фактом — качество проигрывания WMV на ATI было неидеальным. А по производительности претензий ни к кому нет, даже на роликах высокого разрешения загрузка центрального процессора лишь незначительно превышала 50%, небольшой выигрыш по эффективности в данном случае у видеокарты NVIDIA.

MPEG2 (480i)

Переходим к MPEG2, самому старому и знакомому формату. Для начала мы взяли ролик в наиболее распространенном DVD разрешении 720x480, усложнив задачу выбором тестового материала с наличием двух полей (интерлейсинга). При декодировании и проигрывании таких форматов, от декодеров, прежде всего, необходима качественная и быстрая постобработка — деинтерлейсинг. Посмотрим, как с ней справились видеокарты ATI и NVIDIA на двух разных MPEG2 декодерах…

Для ATI использовался MPEG2 декодер из поставки CyberLink PowerDVD 7 и собственная разработка компании — ATI MPEG Video Decoder. Для NVIDIA, помимо декодера CyberLink, принятого за основной, как дополнительный использовался еще и платный декодер — NVIDIA PureVideo последней версии.

Результаты, признаться, меня несколько озадачили. Напоминаю, что все декодеры, драйверы и плееры использовали настройки по умолчанию, кроме Windows Media Player, который был настроен для использования VMR9, без оверлеев. По проведенным тестам получилось, что использование декодера CyberLink на ATI значительно меньше загружает процессор, чем на NVIDIA. И наоборот, если сравнивать декодеры самих компаний, PureVideo дает меньшую нагрузку процессору, по сравнению с "родным" декодером ATI, они как бы меняются местами… Но не нужно забывать, что PureVideo стоит отдельных денег, которые придется отдавать за возможность использования самых последних нововведений в плане поддержки аппаратного декодирования и постобработки, так что стоимость PureVideo нужно учитывать. С другой стороны, и CyberLink PowerDVD стоит недешево…

Но производительность — еще не самое главное, тем более что загрузка процессора составила от четверти до половины ресурсов процессора. Основная цель, все-таки — достижение максимального качества, которое мы сейчас и попытаемся проверить.

Первый же пример MPEG2 показывает серьезные отличия на большинстве картинок. Декодер CyberLink на ATI зачем-то начал смешивать поля… Можно было бы предположить, что или DXVA не включился, или видеоролик закодирован неправильно, или такие настройки по умолчанию у декодера или драйверов. Мы специально попробовали повторить тесты еще раз, с переустановкой всего — всё осталось прежним. Возможно, драйверы ATI лучше "заточены" под воспроизведение видео с использованием оверлеев, а не VMR9? И эта догадка не подтвердилась, при включении оверлея все осталось по-старому.

"Родной" декодер ATI показал какие-то остатки предыдущих кадров в виде еле различимых полосок над птицей и надписью… Оба кадра на NVIDIA, даже, несмотря на то, что декодеры использовались разные, и нагрузка на CPU была разной, очень похожи друг на друга. Странности воспроизведения на карте ATI продолжились и на втором скриншоте из этого ролика:

Опять все та же проблема ATI с CyberLink — деинтерлейсинг смешиванием полей, со своим декодером у них такого не наблюдается. Зато на крыле самой крупной птицы появились следы то ли предыдущего кадра, то ли другого поля. У NVIDIA на CyberLink качество нормальное, но у PureVideo лучше. По этому примеру можно было бы дать первое место за качество именно PureVideo, так как при его работе наблюдается лучшая четкость, достаточно посмотреть на горизонтальные линии верхнего края стены, тень персонажа и детали на поверхности земли. Надо лишь помнить, что за этот декодер придется платить отдельные деньги и в этом его главный недостаток.

MPEG2 (1080i)

Второй MPEG2 ролик также содержит interlaced материал, но уже в большем разрешении. Очень интересно, как справятся наши испытуемые с такой задачей, не слишком ли большой окажется нагрузка при постобработке такой сложности?

Совсем плохие результаты для ATI, их видеокарта RADEON X1800 XL при использовании как декодера самой компании ATI, так и декодера производства CyberLink, показала результаты хуже, чем плата, основанная на видеочипе основного конкурента. Декодер CyberLink на ATI в этот раз показал себя лишь чуть лучше родного декодера ATI MPEG Video Decoder, а карта NVIDIA испытывала гораздо меньше проблем во время проигрывания этого 1080i MPEG2 ролика.

70-80% для MPEG2 — это почти на грани, слишком большая цифра, но проблем с воспроизведением ролика на ATI все же не было. Посмотрим на полученное качество, не было ли каких-то необычных проблем, которые мы еще не встречали?

В целом — всё то же самое. На ATI декодер CyberLink использует деинтерлейсинг методом смешивания полей, в остальных случаях — менее заметные и более продвинутые методы. Также заметна разная настройка яркости и контрастности у ATI и NVIDIA по умолчанию. В остальном — все более или менее нормально. Декодер ATI чуть больше "шумит", на небе виден явный бандинг, а лучше всех с задачей справляется PureVideo Decoder.

На втором тестовом кадре этого ролика проблем с деинтерлейсингом не обнаружено, движения в нем мало, всё внимание обращаем на четкость и алиасинг логотипа в углу экрана. Лучше всего этот элемент выглядит на скриншоте, полученном на видеокарте ATI при помощи декодера CyberLink, затем идет NVIDIA, качество которой в обоих случаях почти идентичное, и хуже всего с задачей справился декодер ATI — налицо заметная зубчатость (алиасинг) темных линий логотипа. И опять хорошо видно отличие цветовых настроек у ATI и NVIDIA по умолчанию.

MPEG2 (1080p)

Рассмотрим результаты, полученные при тестировании третьего и последнего MPEG2 ролика, прогрессивного и с самым высоким HD разрешением.

В этом случае отставание ATI уже не так велико, как в прошлый раз. Если не брать в расчет использование PureVideo, то можно сказать, что по скорости карты почти равны. Однако использование MPEG2 декодеров собственного производства выводит GeForce далеко вперед, мы видим почти двукратное отставание ATI от NVIDIA при использовании ATI MPEG Video Decoder и PureVideo Decoder, соответственно. Убеждаемся еще раз, что PureVideo действительно очень эффективен при декодировании MPEG2 видео. К сожалению, видеокарта ATI в данном случае отработала хуже.

Но в целом, даже 60-70% загрузка центрального процессора не ставит крест на воспроизведении MPEG2 видео в разрешении 1920x1080, ведь оставшихся 30-40% ресурсов CPU хватит на большинство задач, обычно выполняемых в фоне при просмотре видео на домашнем ПК. Посмотрим лучше на качество:

А с качеством в этот раз никаких проблем не отмечается, все декодеры и обе карты отработали нормально, единственная проблема — небольшая размытость некоторых деталей на NVIDIA при использовании декодера CyberLink, встроенного в их PowerDVD. В остальном, все картинки похожи, в очередной раз отличаются только цветовыми настройками.

Подведем выводы по тестированию MPEG2 роликов в этом материале. NVIDIA показывает себя чуть лучше, с учетом возможности использования удачного PureVideo декодера, а на ATI заметны проблемы с деинтерлейсингом при использовании декодера CyberLink и заметно большее использование ресурсов CPU при декодировании роликов высокого HD разрешения в MPEG2 формате. В любом случае, производительности используемого в тестах процессора при помощи двух тестовых видеокарт оказывается достаточно для декодирования, деинтерлейсинга и вывода MPEG2 видео на экран, небольшая разница по использованию ресурсов есть, но в реальной жизни она роли не играет. В отличие от качества, с которым нужно разбираться…

Так как наибольшее количество вопросов с качеством возникло именно по декодированию и деинтерлейсингу видео в формате MPEG2, мы планируем провести отдельное исследование AVIVO и PureVideo в задаче декодирования MPEG2 с применением специализированного теста HQV benchmark. Надеемся, он ответит на все возникшие в этом материале вопросы. От наших читателей хотелось бы получить комментарии по поводу того, что было сделано в статье неправильно, и как лучше настроить видеокарты ATI и NVIDIA на получение максимального качества и производительности.

Выводы

Сначала приведем общие выводы — тестовая система смогла справиться с проигрыванием всех роликов, но не все декодеры показали себя с хорошей стороны. Например, софтовый QuickTime H.264 декодер очень неразумно тратит ресурсы процессора, и все ролики высокого разрешения этого формата проигрывает неидеально. С другой стороны, CoreAVC декодирует те же файлы при тех же ресурсах процессора, но тратит их много меньше, позволяя обходиться без помощи видеокарт и не испытывать проблем с любым H.264 материалом, в том числе в самом "тяжелом" разрешении 1080p. То же самое и по MPEG2 декодерам — универсальный CyberLink обеспечивает проигрывание MPEG2, но для видеокарт NVIDIA лучше подойдет PureVideo, правда, за него придется заплатить.

Итак, сформулируем первый вывод — очень многое зависит от выбранного декодера. При правильном выборе не понадобится даже разрекламированная поддержка аппаратного декодирования и постобработки от видеокарт, при неправильном — может не помочь и она. Тестовый процессор Athlon 64 3200+ смог отлично справиться с проигрыванием видеороликов всех распространенных форматов и всех разрешений, вопрос лишь в выборе кодека. В оптимальном варианте для ATI (CoreAVC для H.264, WMVideo для WMV и любой из двух для MPEG2, в зависимости от предпочтений пользователя) и NVIDIA (то же самое, но для MPEG2 лучше подойдет PureVideo, хотя и CyberLink вполне справится) проблем, связанных с производительностью, при проигрывании роликов любого формата не возникло. Многие, в том числе и автор статьи, считают, что сравнение видеокарт по производительности и трате ресурсов на декодирование видео имеет мало практического смысла, ведь мало кто одновременно смотрит фильмы и выполняет на том же ПК другие ресурсоемкие задачи в то же самое время.

Вывод по качеству: за исключением нескольких случаев (бандинг на WMV, странный выбор метода деинтерлейсинга для MPEG2 у ATI и неидеальные установки контрастности и яркости у NVIDIA по умолчанию), с качеством воспроизведения видео всё в порядке. Особых отличий в картинке, кроме указанных выше, нет. Отдельно по форматам можно отметить, что с WMV HD возникает меньше вопросов, так как декодер для них существует один — встроенный в Windows Media Player. Для H.264 нужно тщательно подбирать декодер, одним из лучших на данный момент является CoreAVC, полностью программный декодер, обеспечивающий отличное качество и производительность как на ATI, так и на NVIDIA. А MPEG2 является наиболее распространенным, но и проблемным. Так как видеоданные в этом формате часто бывают чересстрочными, для них нужна постобработка в виде деинтерлейсинга, а именно с ней возникает больше всего проблем. Данная статья не может ответить на все вопросы по MPEG2, поэтому по воспроизведению материалов в этом формате, оказавшемся наиболее проблемным, с точки зрения качества, по результатам наших тестов, планируется более подробное исследование, посвященное сравнительному тестированию видеокарт ATI и NVIDIA.