Похоже, теперь и процессоры для ИИ будут потребителями памяти на том же уровне, что и ускорители, основанные на GPU. Ресурс Sedaily сообщает, что производители ИИ-процессоров сейчас рассматривают возможность оснащать свои будущие чипы заметно большим объёмом памяти, нежели ранее.

Речь идёт о 300-400 ГБ, что сопоставимо с лучшими ускорителями для ИИ на основе GPU. Для сравнения, даже у ускорителя Nvidia Vera Rubin «лишь» 288 ГБ памяти, хотя у того же AMD Instinct 400 будет 432 ГБ. Тут стоит уточнить, что речь идёт о памяти HBM. Это важно, так как уже упомянутый ускоритель Vera Rubin кроме неё имеет ещё и огромный массив памяти SOCAMM2.

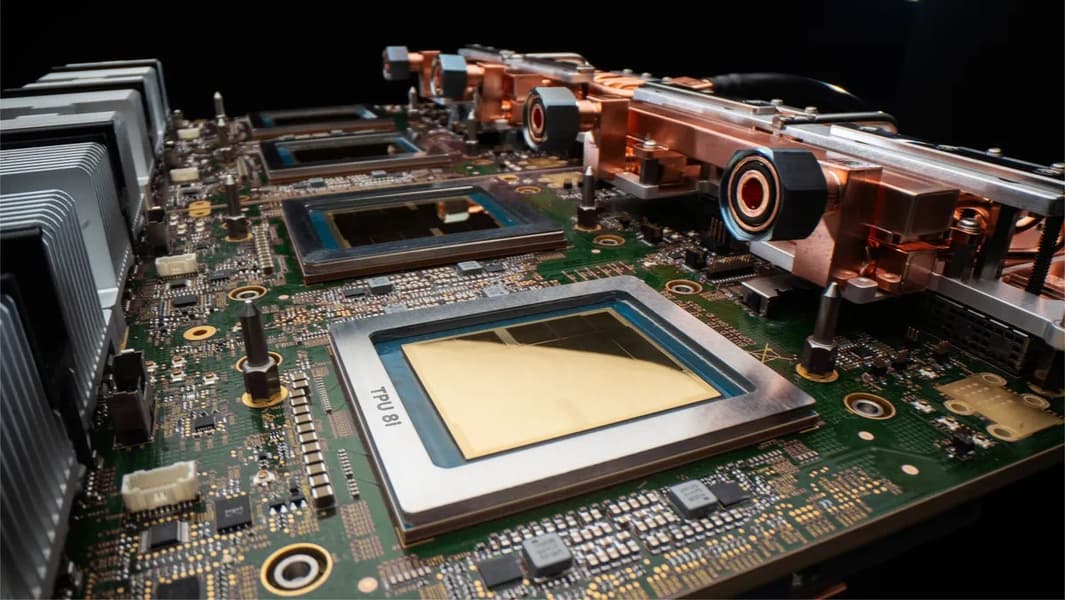

Что касается именно ИИ-процессоров, к примеру, новейший TPU 8i от Google имеет 288 ГБ памяти, а у многих CPU, вышедших ранее, лишь около 100 ГБ.

Эта тенденция крайне важна для рынка, так как с появлением агентных ИИ рынку нужно всё больше процессоров. Если ранее соотношение GPU и CPU в ИИ-ЦОД составляло около 8:1, то теперь это уже примерно 4:1, и ожидается, что показатель может приблизиться к 1:1. Само собой, не путём уменьшения количества необходимых GPU, а путём наращивания количества процессоров, что приведёт к ещё большему перетоку памяти в ИИ-ЦОД.