Как улучшили графику в Death Stranding на ПК

В день выхода Death Stranding на ПК компания Nvidia выложила весьма интересное видео об одной технологии, которая использовалась в порте данной игры. Казалось бы — очередная интересная, но жрущая ресурсы технология от Nvidia, которую мало кто станет использовать из-за сложности интеграции. Как будто первый раз такое. Однако тут оказалось нечто новое — технология улучшила графику и при этом повысила fps. Итак, что же за уличную магию представила нам Nvidia.

А использовали они свою нейронную сеть DLSS версии 2.0, которую представили в этом году. И казалось бы — нейронные сети вроде как требуют много ресурсов, так как же им удаётся не просто на лету повышать детализацию изображения, так ещё и повышать производительность в два раза? Внезапно, всё это возможно благодаря технологии RTX.

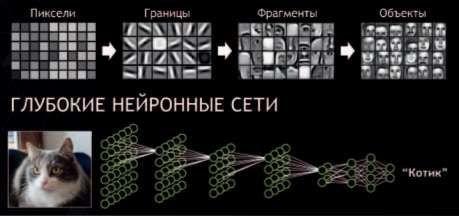

Тут стоит сделать отступление и описать работу нейронных сетей. Если коротко — те нейронные сети, которые работают с изображениями, представляют из себя огромное количество последовательных матриц. Изображение поступает на входные матрицы, они его обрабатывают, выискивают базовые образы (переходы цветов, границы объектов, светотень и т.д.) и передают их в матрицы средних слоёв. Там на изображениях выискиваются уже более обобщённые образы (распознаются простые геометрические фигуры, цветовые схемы объектов, направление света и т.д.) и эти изображения передаются на выходные слои. И уже на них сеть решает, какой именно объект нарисован на изображении. Для некоторых архитектур могут быть свои отличия, но в целом схема выглядит именно так. И ключевой момент — все операции в каждой матрице крайне просты и представляют из себя чаще всего сложение и перемножение. Проблема только в том, что таких вычислений очень много и если рассчитывать такие матрицы на обычных процессорах, это действительно потребует очень много времени.

И именно тут в дело врывается RTX. Сама технология рейтрейсинга подразумевает также массивные расчёты матриц, поэтому видеокарты с этой технологией специально разрабатывались именно под этот вид вычислений. И ускорение матричных расчётов там не в разы, а на порядок. Там, где обычный процессор за один такт рассчитывает значение для одной ячейки памяти, технология RTX позволяет вычислить все значения в матрице. Ещё в момент выхода этой технологии было понятно, что она очень пригодится в нейронных вычислениях, и уже в ближайшие годы стоит ждать множество новых решений на её основе. И вот мы имеем один из первых очень интересных результатов.

Без технологии DLSS при высоких разрешениях видеокарте требуется рассчитать целый массив параметров: для каждой линии каждого полигона строятся грани; для каждой грани находятся позиции опорных точек; рассчитывается светотень; после этого ещё применяется куча постэффектов. А потом ещё требуется корректно соотнести получившуюся картинку с пикселями монитора. Внутри это всё, конечно, немного сложнее, и есть множество технологий, ускоряющих и упрощающих эти вычисления. Но, грубо говоря, для каждого пикселя требуется вычислить положение в игровом пространстве той точки, которую этот самый пиксель будет отображать. Для разрешения 4к таких вычислений потребуется, мягко говоря, немало. И нет ничего удивительного, что современные игры в таком разрешение почти всем видеокартам крайне тяжело обрабатывать со скоростью более 30 fps. А большинство даже до этого показателя не дотягивают.

А что делает DLSS? Для неё видеокарта строит изображение в более низком качестве. А после этого нейронная сеть просто достраивает это изображение «по памяти», сама решая, как раскрасить пиксели. И благодаря расчётным блокам RTX все эти вычисления требуют минимальное количество ресурсов. И вот выходит, что изображение 4к работает при тех же fps, что и изображение 2к, потому что это и есть изображение 2к.

И вот это уже интересно. Технология, которая повышает качество графики и снижает нагрузку на видеокарту пригодится как раз не топовым видеокартам, а бюджетным. Возможность играть на дешёвой видеокарте в том же качестве и с тем же fps, что и на дорогой, выглядит более чем перспективно. Тут у некоторых уже могут загореться глаза или возникнуть скепсис, но в обоих случаях появятся вопросы — почему версия DLSS уже 2.0, вышла она ещё весной, а про неё не трубят все разработчики?

Несколько ложек дёгтя. Это технология исключительно Nvidia и исключительно для видеокарт с RTX. В видеокартах без лучей просто отсутствуют модули расчёта матриц. Технически можно было бы нейросеть заставить работать и на таких картах. Но без этих модулей обработка изображений с DLSS будет требовать больше ресурсов и времени, чем без неё. Ну и, естественно, аналогичной технологии у AMD пока нет. Поэтому, на данный момент очень небольшое количество людей могут воспользоваться DLSS.

А вот про DLSS версии 1.0 мало кто слышал потому, что она требовала обучения для каждой игры отдельно. Естественно, это требовало тесной работы с командой Nvidia, что могли позволить себе далеко не все. Внедрение этой сети требовало неоправданно много ресурсов. А вот версия 2.0 уже обучена один раз и не требует дообучения на каждой новой игре. Она представляет из себя уже готовую программную библиотеку, которую уже сейчас можно легко подключить к проекту в том же Unreal Engine и спокойно использовать. И это уже совсем другой разговор. Выход именно Death Stranding с интеграцией DLSS как раз очень интересен тем, что эта игра является портом с консолей, где этой технологии естественно не было. И этот случай как раз должен продемонстрировать простоту в использовании новой версии DLSS.

Подводя итог, можно сказать, что данная технология отличается от многих разработок Nvidia. Она действительно очень полезна для всех игровых проектов. А так как технология RTX со временем будет распространяться всё сильнее, то определённо стоит ожидать, что и DLSS будут развивать и внедрять во многие игры. Глобально же стоит ожидать и новых технологий на базе нейросетей, которые будут брать на себя расчёты физики и анимации. Уже сейчас Nvidia ведёт работу над подобными технологиями и DLSS можно считать лишь первой ласточкой серии подобных нейросетей. Да и от AMD определённо стоит ожидать в будущем подобных же разработок, учитывая, что они очень тесно сейчас работают с Microsoft в этом направлении. Так что и команда красных вряд ли останется в стороне.

20 комментариев

Добавить комментарий

Стоимость PS4 на той же площадке начинается с 30к и выше.

Дальше уже есть карточки и получше, но и различаются они в цене от стартовой не особо сильно, начиная от 1.5-2к.

Как по мне, больше переплачивать смысла особо нет, за исключением очень редких моментов.

PC просто более универсальны, и, например, я использую тензорные ядра RTX для обучения нейросетей. Но если вам не нужна универсальность (и портативность, но это уже немного другое) — купите приставку и не делайте нервы ни нам, ни себе!

И черных экранов давно как-то не видел — а уж, тем более, вернувшихся.

Но — это другой стиль, чем у тебя. И даже страна и часть света.

Добавить комментарий