Какая нейросеть лучше: сравниваем Kimi, Qwen, GLM и DeepSeek

Я уже написал одну подробную статью-сравнение зарубежных нейронок. И многие правильно сказали: в РФ куда популярнее китайские нейронки, потому что с ними можно работать бесплатно и доступ к ним не заблокирован. Поэтому я решил сделать эту статью и сравнить китайцев на том же наборе задач: анализ информации, генерация текста, анализ и генерация изображений.

Для сравнения возьмем 4 сервиса: Kimi, Qwen, GLM и DeepSeek.

| В статье буду сравнивать нейронки на точечных задачах. Проверять их на генерацию презентаций и кода не буду — это отдельные большие темы, о которых стоит рассказать в отдельной статье. |

Kimi

Сайт: https://www.kimi.com

Стоимость: бесплатная версия с лимитами. Подписка Moderato — $19/мес. Из России оплатить напрямую нельзя.

Доступ из России: без ограничений.

Kimi — китайская нейросеть от компании Moonshot AI, которая часто позиционирует себя как модель для кодинга и анализа. Актуальная модель K2.5 умеет превращать макеты, скриншоты и текстовые описания в рабочий фронтенд-код. Сервис поддерживает русский язык и работает через сайт, мобильные приложения и отдельный инструмент Kimi Code для программирования.

В бесплатной версии можно работать в четырех режимах.

В режиме Instant нейросеть будет отвечать быстро и без долгих рассуждений. Если задача посложнее, стоит переключиться на Thinking — тогда модель перед ответом будет рассуждать пошагово и выдавать более продуманные ответы.

В режиме Agent нейронка возьмет на себя исследования и подготовку документов: она сама найдет информацию в интернете, проанализирует ее и соберет результат в готовый файл.

Режим Agent Swarm пригодится для по-настоящему масштабных задач — в нем нейронка координирует до 100 агентов параллельно, каждый из которых работает над своей частью работы.

Помимо текстовых задач, Kimi умеет создавать документы в форматах Word и PDF, собирать презентации, работать с таблицами и строить сайты прямо из чата.

Qwen

Сайт: https://chat.qwen.ai

Стоимость: полностью бесплатно без ограничений по количеству сообщений.

Доступ из России: без ограничений.

Qwen — китайская нейросеть от Alibaba с большим набором функций. Актуальная модель Qwen 3.5 понимает текст, изображения и видео, а в ответ может не только написать текст, но и нарисовать картинку или создать видеоролик. Сервис работает через сайт и мобильные приложения.

Сервис поддерживает три режима.

Auto включает адаптивное мышление, где нейросеть сама решает, нужно ли ей подумать подольше, поискать в интернете или запустить режим для работы с кодом.

Thinking заставляет модель рассуждать пошагово — это полезно для сложных логических и математических задач.

Fast дает мгновенный ответ без этапа размышлений и подходит для простых вопросов.

Главная фишка Qwen — большое количество инструментов. Пользователь сможет рисовать и редактировать картинки через встроенную модель Qwen-Image, создавать видеоролики, анализировать документы, искать в интернете и выполнять код.

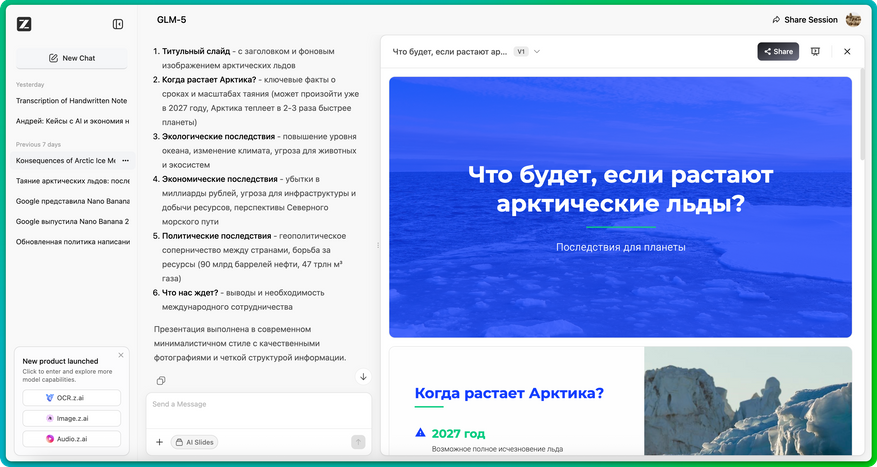

GLM

Сайт: https://z.ai

Стоимость: бесплатная версия без ограничений по сообщениям. Coding Plan: Lite — $3/мес, Pro — $15/мес, Max — от $80/мес.

Доступ из России: без ограничений.

GLM — китайская нейросеть от компании Zhipu AI, которая особенно хорошо справляется с кодом и сложными агентными задачами.

В бесплатной версии на z.ai доступны два режима.

Chat работает как классический диалог: нейросеть будет отвечать на вопросы, писать тексты и помогать с кодом.

Agent подключает инструменты — нейросеть сможет искать информацию в интернете, создавать документы, презентации и таблицы, а также анализировать загруженные файлы.

Сами разработчики говорят, что модель больше заточена под работу с кодом и справляется с ним не хуже, чем западные конкуренты.

Помимо кода, GLM умеет собирать документы в форматах Word, PDF и Excel прямо в чате, создавать презентации и рисовать картинки через отдельную модель GLM-Image.

DeepSeek

Сайт: https://chat.deepseek.com

Стоимость: полностью бесплатно без ограничений по количеству сообщений.

Доступ из России: без ограничений.

DeepSeek — китайская нейросеть, которая работает в России без ограничений.

Сервис поддерживает два режима работы.

В обычном режиме DeepSeek быстро отвечает на вопросы, пишет тексты, помогает с кодом и анализирует документы.

Режим Deep Think включает цепочку рассуждений: модель сначала думает над задачей, а потом выдает ответ. В этом режиме качество ответов будет выше, но на их подготовку нейросеть потратит больше времени.

DeepSeek хорошо справляется с кодом на популярных языках, понимает русский язык и умеет анализировать изображения. В диалог можно загружать файлы и работать с ними. Интерфейс простой: веб-версия и мобильные приложения. Рисовать картинки и создавать видео нейросеть не умеет.

| Теперь давайте проверим, как каждая нейронка справится с разными задачами: написать текст, обработать данные и изображения. Код в этой статье трогать не будем — это отдельная крупная задача, которую я раскрою в другом материале. |

Какая нейросеть лучше пишет и анализирует информацию

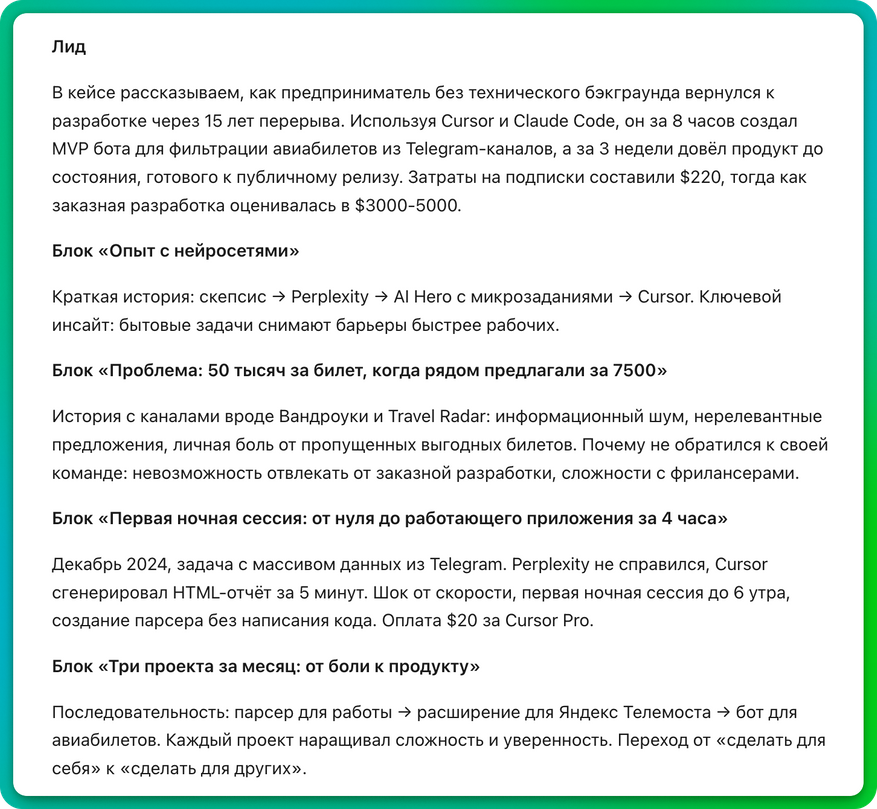

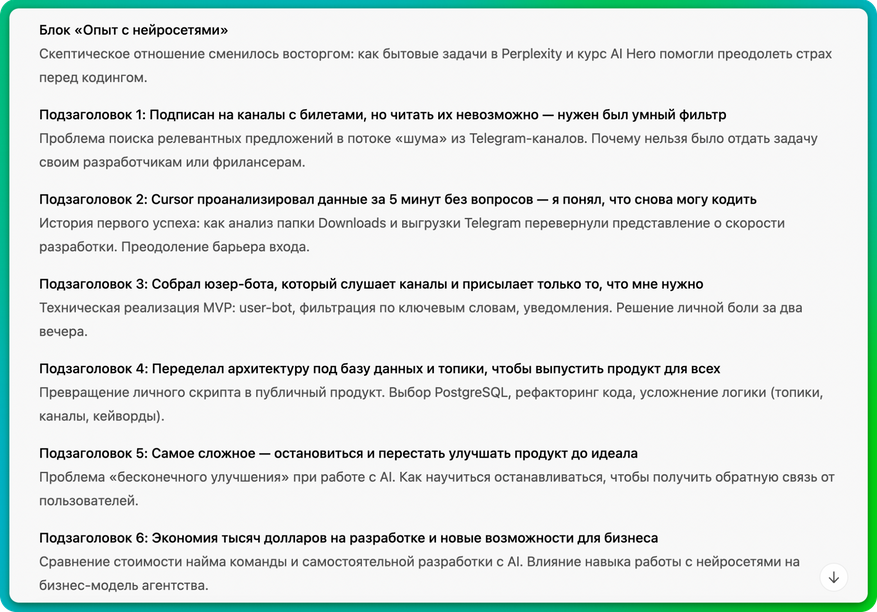

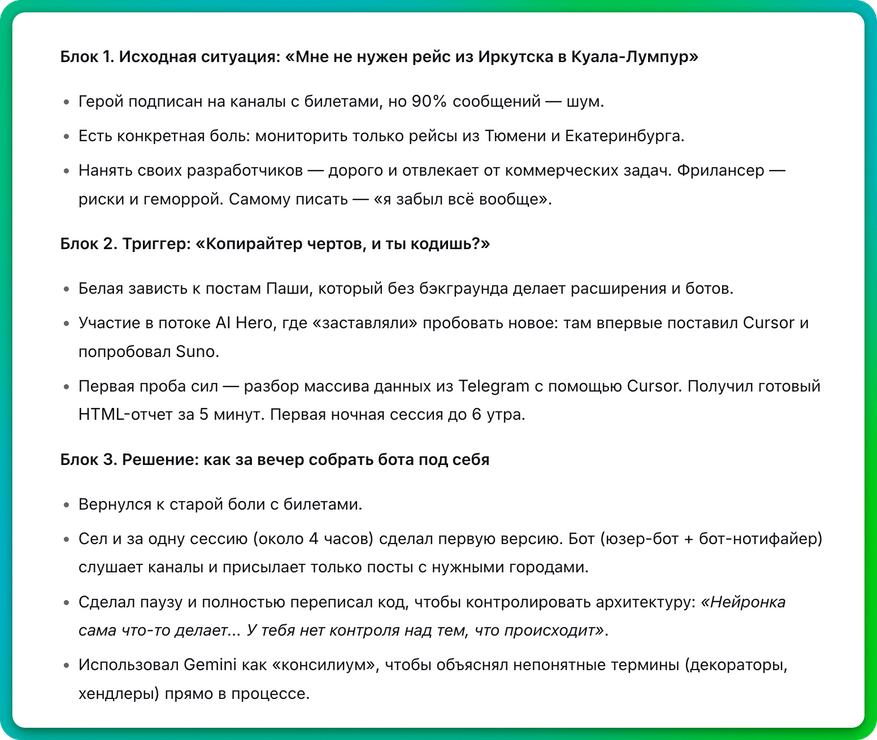

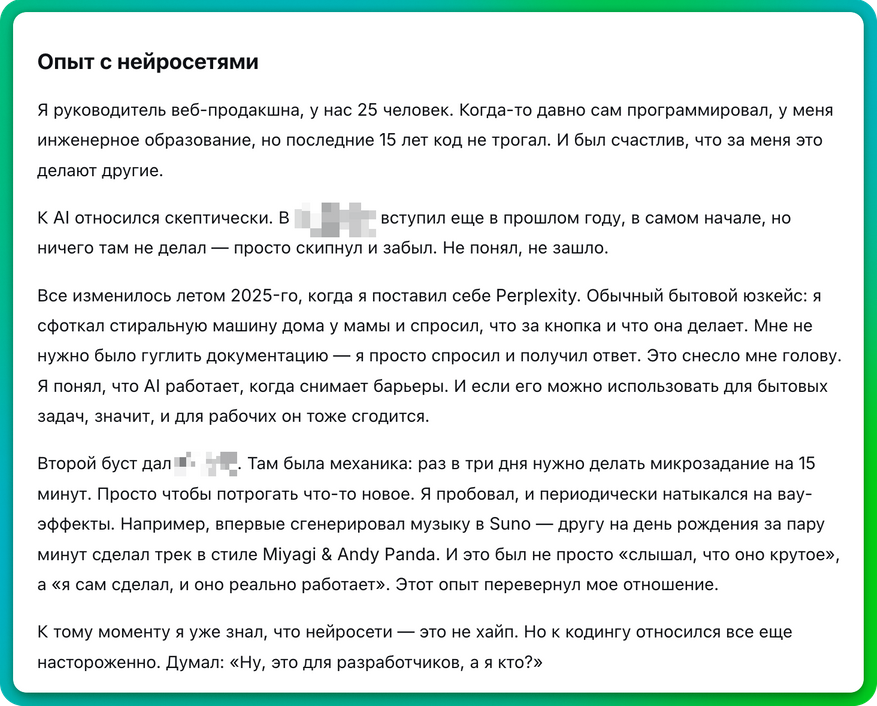

В прошлый раз мы анализировали транскрибацию вебинара. Теперь возьмем транскрибацию кейса: я заранее поговорил с человеком, как он использует нейросети и на основе нашей беседы попробую написать текст.

Текст буду писать по правилам редполитки — большого и подробного документа с пояснениями, как ИИшка должна обрабатывать информацию, формулировать мысли

В редполитике описано, как нейросеть должна анализировать транскрибацию, как продумывать структуру кейса и как затем складывать слова в предложения.

Работу построю так: загружу в нейросеть транскрибацию кейса вместе с редполитикой и попрошу все проанализировать.

Чтобы не растягивать статью, скажу сразу — все 4 нейросети отлично справились с анализом. Ни одна из них не поймала галлюцинаций и не придумала ничего лишнего. Все модели детально разобрали транскрибацию и выделили все главные моменты. Так что в этом плане все нейронки получают 10 из 10.

Но вот с планами повествования у всех есть огрехи, давайте разбираться.

Сначала проверим Kimi

В Kimi мне не понравился план повествования, а точнее его структура. Хронологически он ничего не нарушил, но вот подал информацию очень сжато. Непонятно, о чем он хочет говорить в каждом блоке, не будет ли дублей или, наоборот, потери важной инфы.

Плюс подзаголовки получились максимально нейронными и из-за этого даже просто сканировать план сложновато. Оцениваю на 7 из 10.

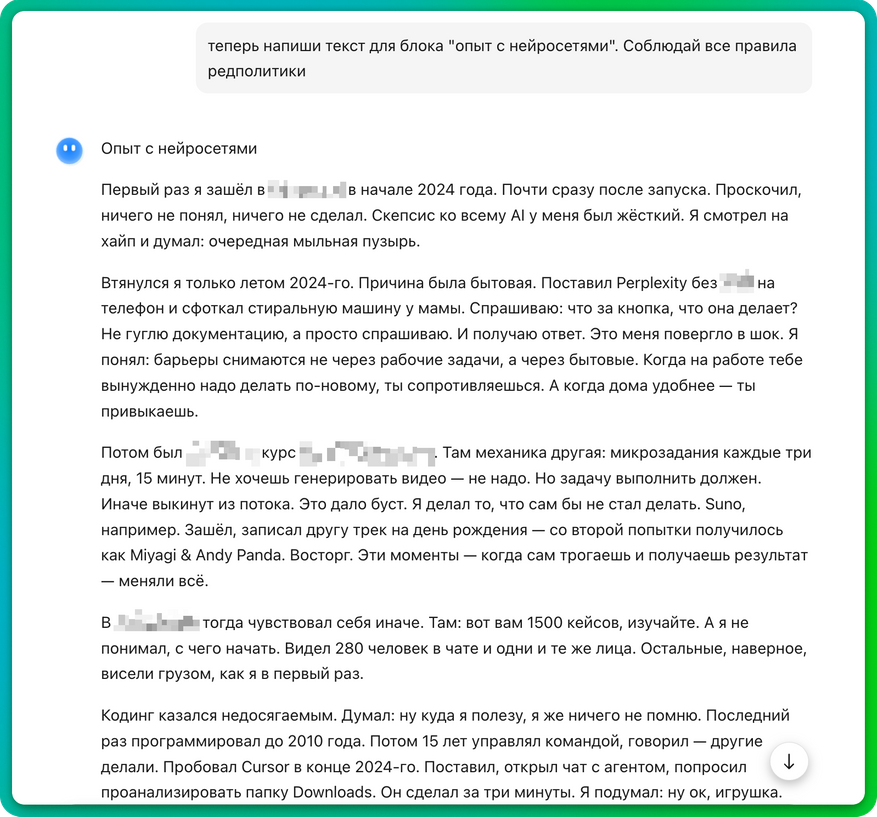

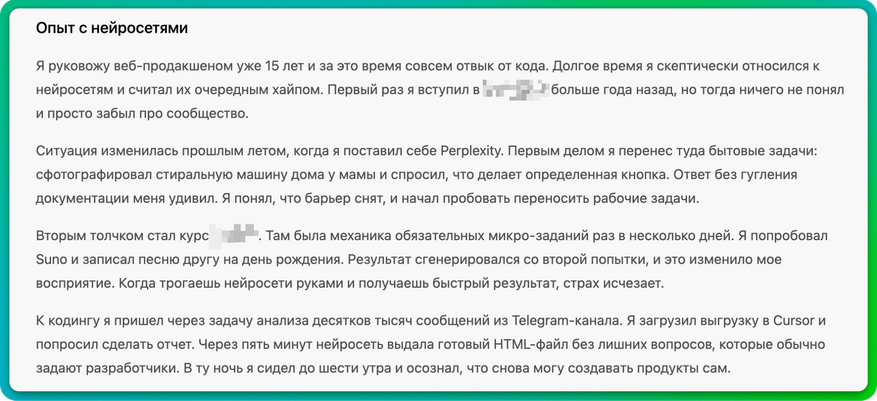

Теперь проверим, как она напишет текст по блоку «Опыт с нейросетями»

Меня ответ не порадовал. Текст получился очень растянутым и скучно. Его физически сложно читать. Предложения рваные, ритмики никакой нет, нейросеть не вводит читателя в контекст и не ведет по истории человека. Каждый абзац будто живет своей жизнью. В общем, больше 5 поставить не могу.

Переходим к Qwen

Здесь мне вообще трудно хоть как-то оценить план, потому что его по сути нет. Вместо нормальной структуры нейронка выдала маленькую табличку с подзаголовками и одной строкой содержанием. Такой план не подходит, потому что по нему нельзя понять, о чем конкретно нейросеть хочет сказать. А гадать не хочется.

Но подзаголовки получились куда лучше, чем в Kimi. По ним можно сформировать цельную картинку кейса, поэтому лишний балл с радостью накину. В общем Qwen набирает 5 из 10.

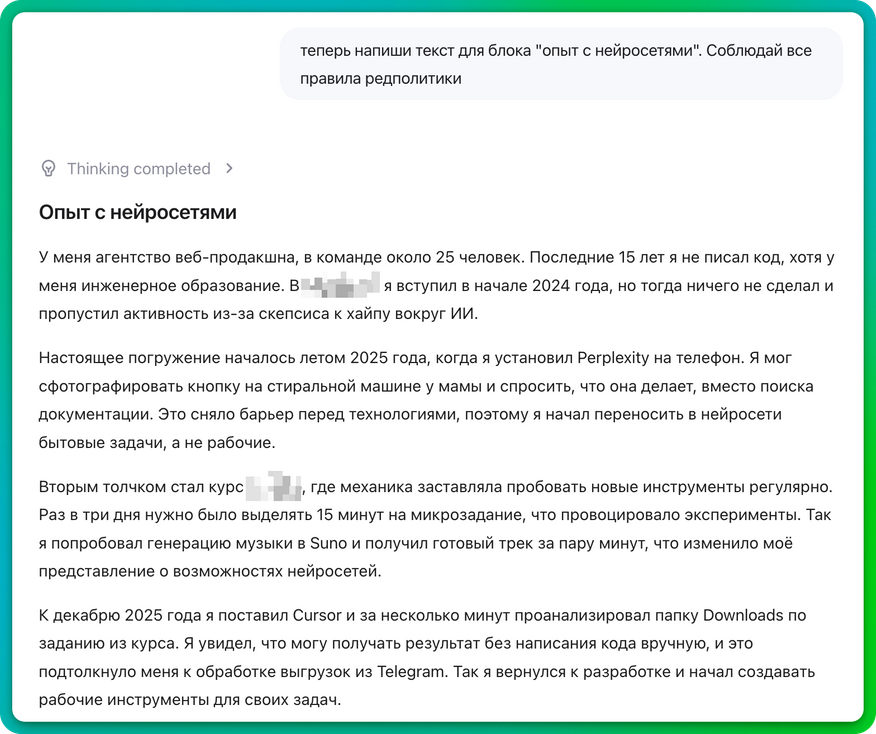

Посмотрим, как он справится с текстом.

Qwen могу похвалить только за то, что он не лил воду и написал краткий текст. К самому же тексту есть вопросы. Например, во втором абзаце явные проблемы с модальными глаголами, предложения не согласовываются между собой по времени. Но при этом 3 и 4 абзацы написаны неплохо.

В любом случае ответ лучше, чем у Kimi, поэтому Qwen получат 7 баллов.

Тестируем GLM

К GLM у меня точно такие же вопросы, как и к Kimi. Он вроде и выдал правильную информацию, но сделал все сжато и без деталей. По его плану сложно понять, про что он хочет написать в каждом блоке, плюс подзаголовки получились слабые и цельной истории не формируют.

Оцениваю план на 6 из 10.

Теперь генерируем текст.

Он похож на ответ Qwen, даже во втором абзаце примерно такие же проблемы с временами и глаголами. Но GLM намудрил еще и в 3 абзаце, поэтому получает только 6 баллов.

Проверяем DeepSeek

Остался последний боец. DeepSeek, на мой взгляд, сделал лучший план. Он раскрыл каждый блок по пунктам и подробно расписал, что будет в каждом подзаголовке. Править такой план куда проще.

Но вот подзаголовки получились так себе. Единую картину повествования они не создают, за это минус балл. Но с учетом сильной структуры я оценю ответ на 8 из 10. Структура в любом случае важнее слов в подзаголовках ;)

Теперь проверим текст.

С текстом, на мой взгляд, DeepSeek тоже справился лучше остальных. Его придется править и править сильно, но тут хотя бы нет таких проблем с временами и плавностью повествования. С учетом ответов соперников DeepSeek заслуживает 8 баллов.

Какая нейросеть лучше работает с изображениями

Тут сравним по 2 критериям — умение генерировать картинки (и их качество) и качество анализа рукописного русскоязычного текста.

DeepSeek и Kimi генерировать картинки не умеют, поэтому сразу получают по 0 баллов.

В Qwen и GLM создавать изображения можно, так что их и протестируем.

Qwen сразу получает 3 бонусных балла, потому что умеет перерисовывать референсы и редактировать картинки по текстовому запросу. В GLM картинки можно генерировать только с нуля и через отдельный сайт.

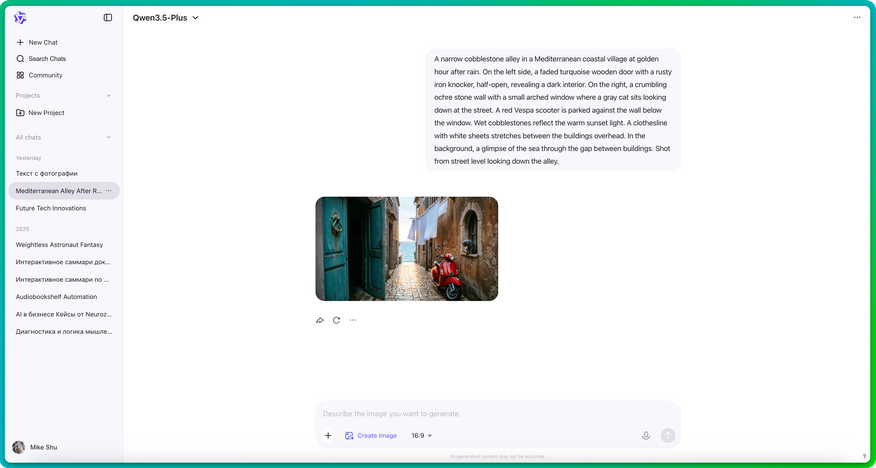

Попросим сгенерировать картину атмосферной средиземноморской деревни с мощеной дорогой в золотой час после дождя.

| A narrow cobblestone alley in a Mediterranean coastal village at golden hour after rain. On the left side, a faded turquoise wooden door with a rusty iron knocker, half-open, revealing a dark interior. On the right, a crumbling ochre stone wall with a small arched window where a gray cat sits looking down at the street. A red Vespa scooter is parked against the wall below the window. Wet cobblestones reflect the warm sunset light. A clothesline with white sheets stretches between the buildings overhead. In the background, a glimpse of the sea through the gap between buildings. Shot from street level looking down the alley. |

Первым проверим Qwen

Считаю, что результат отличный. Нейросеть учла все вводные и даже не нарисовала артефактов. По крайней мере, их не видно. Оцениваю картинку на 9 из 10 только из-за легкого мыла.

Теперь очередь за GLM

Его работу проще не комментировать;)

Нейросеть вроде и учла все требования, но при этом сделала очень зернистую картинку. Такое ощущение, что это работа нейронки из 2024 года, а не 26.

Поставлю 5 баллов за старания.

Теперь проверим анализ изображений на примере рукописного текста. Во все нейронки будем грузить такой текст:

Сразу спойлер: этот текст я уже проверял в DeepSeek — и он не справился. Поэтому получает 0 баллов.

Теперь проверим остальных.

Qwen допустил только одну ошибку — добавил словой «одной», которого в тексте не было. Поэтому получает 9 баллов.

Kimi тоже ошибся один раз и вместо «оформленного ядра» написал «ограниченный запас еды». Считаю эту ошибку более важной, поэтому ставлю 8 баллов из 10.

А вот GLM разочаровал и вовсе ничего не разглядел. Так что заслуженные 0 баллов его!

Какую нейросеть выбрать

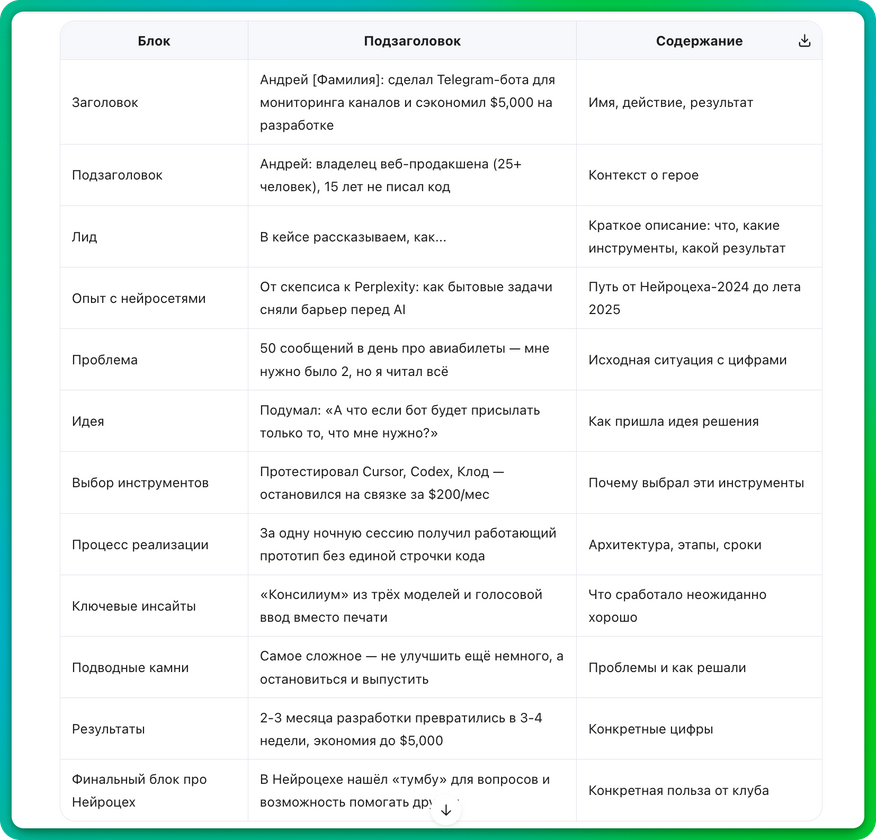

Я протестировал все четыре нейронки на разных задачах и собрал результаты в одну таблицу:

| Параметр | Kimi | Qwen | GLM | DeepSeek |

| Стоимость | Бесплатно с лимитами, Moderato $19/мес | Бесплатно | Бесплатно, Coding Plan от $3/мес | Бесплатно |

| Доступ из России | Без ограничений | Без ограничений | Без ограничений | Без ограничений |

| Контекстное окно | 262K токенов | до 1M токенов | ~200K токенов | 128K токенов |

| Генерация изображений | Нет | Да | Да | Нет |

| Анализ изображений | Да | Да | Да (слабо) | Да (слабо) |

| Генерация видео | Нет | Да | Нет | Нет |

| Генерация презентаций | Да | Да | Да | Нет |

| Создание документов | Да | Да | Да | Нет |

| Агентный режим | Да (до 100 агентов) | Нет | Да | Нет |

| Работа с текстом | 5/10 | 7/10 | 6/10 | 8/10 |

| Генерация картинок | 0/10 | 12/10 | 6/10 | 0/10 |

| Анализ картинок | 8/10 | 9/10 | 0/10 | 0/10 |

| Общий балл | 13/30 | 28/30 | 12/30 | 8/30 |

По итогам тестов Qwen уверенно вырвался вперед с 28 баллами из 30. Он единственный, кто и рисует картинки, и создает видео, и при этом остается полностью бесплатным. Но это не значит, что остальные нейросети бесполезны — у каждой есть свои сильные стороны.

Для работы с текстами лучше всего подошел DeepSeek. Он выдал наиболее проработанный план и написал текст, который проще всего довести до финального варианта. Qwen тоже справился неплохо, но допустил ошибки в согласовании глаголов. Kimi и GLM написали слабее: у обоих сжатые планы без деталей, а тексты страдают от рваного повествования.

Для генерации изображений выбор между Qwen и GLM. Qwen выигрывает по всем фронтам: картинки детализированные, без зернистости, плюс можно редактировать уже существующие изображения. GLM нарисовал то, что просили, но качество картинки напомнило нейросети двухлетней давности.

Для анализа рукописного текста подойдут Qwen и Kimi — обе нейросети распознали почерк почти без ошибок. GLM и DeepSeek с этой задачей не справились вовсе.

Если нужен максимум функций за ноль рублей, стоит начать с Qwen. Он умеет рисовать картинки, создавать видео, собирать презентации, искать в интернете и выполнять код — и все это бесплатно. Для текстовых задач и кода к нему удобно подключать DeepSeek, а для агентных сценариев и масштабной работы с документами — Kimi.

Можно ли совмещать несколько нейросетей

Да. Все четыре сервиса бесплатны и доступны из России, так что их можно использовать параллельно. Например, DeepSeek подойдет для черновиков и повседневных вопросов, Qwen — для генерации картинок и видео, а Kimi — для сложных проектов, где нужно координировать несколько агентов одновременно.

Источник: Nano banana

10 комментариев

Добавить комментарий

-----

также проверял картинки. грок, джеминай, гпт и квен. сразу отмечу лидера — квен точнее всех сгенерировал то что я хотел, все четко по запросу, без ошибок. хотя картинки не понравились, но это личные вкусы. все остальные нейронки упускали одну деталь, которая являлась для меня самой важной — без подробностей, все таки тесты личные, но если вкратце, то все эти нейронки, кроме квена, не знают как выглядит определенный предмет (интересно, является ли это результатом того, что предмет китайский, и квен китайская нейросетка...). хуже всего с запросами справился гпт — он рисовал совершенно не то, что ему было сказано. джеминай +- ок. грок же справился, не считая той самой детали, симпатичнее всех, нарисовал то что нужно. я решил остановиться на его варианте и перейти к редактированию. гпт опять же начал делать полный бред — рисовать не то что надо, не там где надо, рисовать лишние руки, полностью перерисовывать картинку… грок в принципе туда же пошел. и джеминай. хотя они не настолько плохо работали, как гпт. в итоге решил скормить им сгенерированную картинку грока + картинку нужного предмета и запросить редактирование с заменой одного на другое. гпт… даже комментировать не буду. грок последовал за ним. а вот джеминай справился абсолютно превосходно, идеально заменив предмет на картинке на предмет с фото, при этом идеально подогнал рисовку под стиль картинки.

-----

итог моих личных тестов:

текст: грок и точка

генерация картинок: грок и квен

редактирование картинок: джеминай

Хоть и разные картинки там проще всего редачить.

Мой любимчик это клод, я решаю в нем 99% задач

лучшим агрегатором я считаю genspark. там куча всего, безлимит запросов к опусу и все это за 25 баксов

Зато у дикпиковское «Я (где тире?) руководитель веб-продакшна, (мысль обрывается, нужна точка) у нас (кого?) 25 человек. Когда-то давно сам программировал, (тоже точка нужна) у меня инженерное образование, но последние 15 лет код не трогал.» – отлично, 8/10.

В итоге вместо структурированного рассказа которое приятно читать мы получаем сочинение второклассника.

Вот поэтому нужно на своём опыте смотреть, какие нейронки и под какие задачи подходят, а не в слепую верить статьям.

Но на вкус и цвет)

Добавить комментарий