Зачем энтузиасты собирали двухпроцессорные ПК в начале 2000-х

На заре 2000-х, когда большинство пользователей довольствовались обычными домашними компьютерами, некоторые энтузиасты шли на странный, казалось бы, шаг: устанавливали в свои системы два процессора. В те времена даже о двухъядерных CPU никто и не мечтал, а двухпоточных задач, на первый взгляд, и вовсе не существовало.

Тем не менее, материнская плата Abit BP6 стала настоящей легендой среди определённого круга пользователей, а желающих собрать двухпроцессорную систему находилось немало — при том, что удовольствие было совсем не из дешёвых. Что же заставляло людей идти на такие сложности и траты в эпоху, когда даже один производительный процессор считался роскошью?

Тяжёлые будни одноядерной эпохи

На современных компьютерах мы привыкли держать открытыми десятки программ. Браузер с множеством вкладок, редактор графики, мессенджеры, музыкальный плеер — всё работает одновременно, не мешая друг другу. Но в конце девяностых ситуация была кардинально иной: даже простейшие сценарии вроде прослушивания музыки во время работы в Photoshop превращались в настоящее испытание.

Одноядерный процессор, столкнувшись с ресурсоёмкой задачей, практически полностью «подвисал». Winamp начинал заикаться, а интерфейс Windows отзывался с многосекундными задержками. Пользователь буквально слышал, как его компьютер задыхается под нагрузкой — характерные рывки в воспроизведении музыки стали своеобразной «визитной карточкой» проблем с многозадачностью той эпохи.

Даже флагманские модели вроде Pentium III и более поздних Pentium 4 не спасали от проблемы — она крылась в самой архитектуре одноядерных решений. Процессор физически не мог уделять достаточно времени нескольким задачам одновременно, как бы ни старалась система распределить ресурсы. И, хоть появление технологии Hyper-Threading в поздних моделях P4 немного улучшило ситуацию, до настоящего решения было ещё далеко.

То есть, если подводить итоги, многозадачность для ПК того времени — скорее формальность, чем реальность. А на деле — «служба одного окна», предел возможностей которой — пара окон браузера с музыкой в фоне.

Два лучше, чем один

Решение напрашивалось само собой — добавить второй процессор. Windows NT, а затем и Windows 2000/XP прекрасно поддерживали такую конфигурацию, равномерно распределяя нагрузку между CPU. Пользователь мог запустить ресурсоёмкую задачу на одном процессоре, пока второй обеспечивал плавную работу остальной системы.

Подобный подход кардинально менял пользовательский опыт. Теперь не требовалось закрывать все фоновые программы перед запуском тяжёлого приложения — система оставалась отзывчивой даже при серьёзных нагрузках. Сегодня мы считаем такое поведение нормой и даже не задумываемся об этом — спокойно смотрим видео на YouTube при рендеринге в VSDC и ничего не закрываем перед запуском игры.

Пользователи двухпроцессорных систем получали возможность работать в режиме, который стал привычным для всех лишь спустя несколько лет. При этом дополнительная производительность второго CPU (многопоточность программ, которая на тот момент была, скорее, исключением, чем нормой) куда менее важна, чем сама возможность параллельного выполнения задач.

«Народный» дуэт Celeron и двухпроцессорные платы

История массового распространения двухпроцессорных систем среди энтузиастов началась с интересного аппаратного бага в процессорах Intel Celeron на Socket 370. Согласно официальной документации Intel, эти бюджетные CPU не должны были поддерживать работу в многопроцессорном режиме — данная функция намеренно блокировалась производителем для разделения потребительского и серверного сегментов.

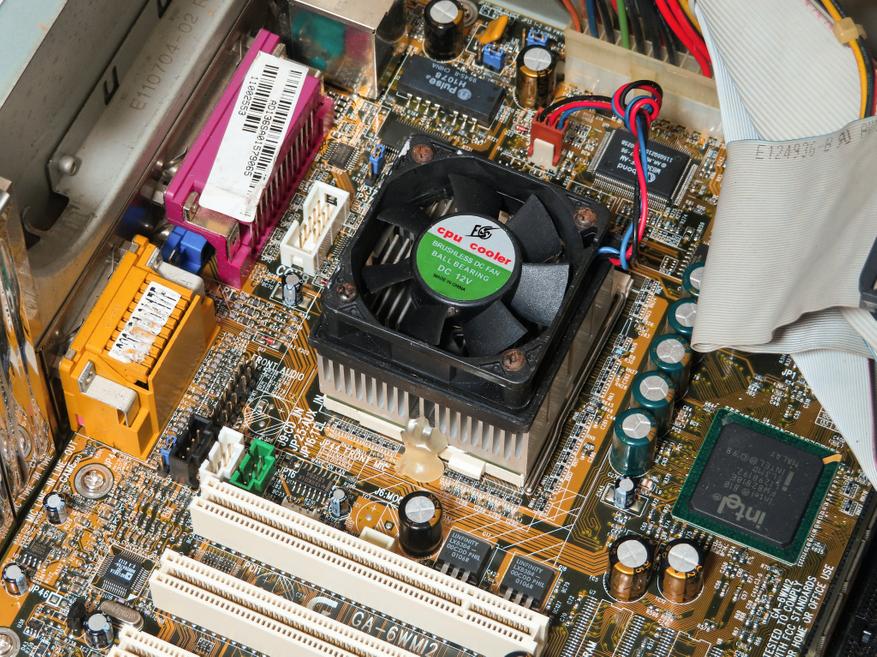

Однако энтузиасты обнаружили, что любые процессоры на этом сокете прекрасно функционируют в паре при доработке BIOS, несмотря на заявленные ограничения. Производители материнских плат не смогли проигнорировать такую возможность — вскоре появились платы, специально спроектированные под установку двух «бюджетных» CPU. Главной звездой среди них стала Abit BP6, позволявшая использовать два бюджетных Celeron вместо существенно более дорогих Pentium III.

Intel никогда официально не признавала эту возможность и не поддерживала подобные конфигурации, но и активных мер против них не предпринимала. Для компании это был удобный компромисс — энтузиасты получили возможность экспериментировать с многопроцессорными системами, не подрывая продажи дорогих серверных решений, для которых такие платы были недостаточно надёжны.

Материнская плата Abit BP6 быстро стала культовой в сообществе. За ней последовали другие производители со своими решениями, но именно BP6 задала стандарт для «народных» двухпроцессорных систем. Её популярность была настолько высока, что платы продолжали пользоваться спросом даже после прекращения производства, а на вторичном рынке цены на них порой превышали первоначальную стоимость.

Цена вопроса

Несмотря на использование относительно доступных процессоров Celeron, двухпроцессорная система всё равно требовала существенных вложений. Помимо стоимости второго CPU, значительную часть бюджета съедала специализированная материнская плата — они были заметно дороже обычных моделей из-за более сложной разводки и дополнительных компонентов, даже если брать сравнительно бюджетные решения вроде той же BP6.

Серьёзные требования предъявлялись и к блоку питания — он должен был обеспечивать стабильное питание двух процессоров в любых режимах работы. Но самой существенной статьёй расходов становилась оперативная память: для полноценной многозадачности требовалось в полтора-два раза больше ОЗУ, чем в обычной системе. При этом память тогда оставалась одним из самых дорогих компонентов компьютера.

Тем не менее, для многих энтузиастов эти затраты окупались возможностью получить принципиально более комфортный уровень работы с компьютером. К тому же, если пользователь уже мог позволить себе топовую видеокарту и другие высококлассные комплектующие, вложение в двухпроцессорную конфигурацию выглядело логичным следующим шагом.

Стоит, к тому же, отметить, что флагманское железо тех времён было куда доступнее относительно среднего заработка, чем современные решения вроде RTX 4090 за 300 тысяч рублей. Даже с учетом планового апгрейда раз в два года и поправки на инфляцию…

На пороге новой эры

Появление первых массовых двухъядерных процессоров, особенно после триумфального выхода линейки Intel Core 2 Duo, поставило крест на эпохе двухпроцессорных домашних компьютеров. Два ядра на одном кристалле оказались эффективнее двух отдельных процессоров — как по производительности, так и по энергопотреблению. А уж про разницу в цене и говорить не приходилось.

Многопроцессорные системы стремительно ушли в сегмент серверов и профессиональных рабочих станций, где требования к производительности оправдывали сложность и стоимость таких решений. Для домашних пользователей и энтузиастов эпоха экспериментов с двумя CPU подошла к концу.

Любопытно, что массовое принятие двухъядерных процессоров произошло вовсе не из-за появления программ, способных эффективно использовать оба ядра — таких приложений ещё долго не существовало. Основным драйвером стала именно та самая многозадачность, ради которой энтузиасты годами ранее собирали свои двухпроцессорные системы.

Более того, первые поколения двухъядерных CPU часто проигрывали однодерным системам в однозадачных сценариях — но удобство мультитаскинга сделало своё дело: будущее явно принадлежало многоядерным решениям.

Опередившие время. Вместо итога

Двухпроцессорные энтузиастские системы начала 2000-х можно смело назвать предвестниками современной многозадачности. Их создатели фактически предугадали то, как мы будем использовать компьютеры в будущем — с десятками открытых вкладок браузера, множеством фоновых процессов и параллельно запущенными приложениями.

Хотя технически такое решение оказалось временным, и даже его обладатели наверняка это понимали, оно позволило определённому кругу энтузиастов «пожить в будущем» на несколько лет раньше остальных. Они получили возможность работать так, как мы привыкли сегодня — не задумываясь о необходимости закрывать фоновые приложения или ждать завершения ресурсоёмких задач.

Вопреки мнению некоторых форумных критиков, двухпроцессорные системы того времени не были «бесполезными понтами». Они стали важной вехой в истории персональных компьютеров, наглядно продемонстрировав преимущества параллельных вычислений для обычных пользователей. Во многом благодаря этому опыту переход на многоядерные процессоры прошёл так естественно — пользователи уже знали, какие преимущества он может принести, даже если не могли позволить себе такую сборку.

Пусть сама технология оказалась тупиковой ветвью эволюции, идеи, стоявшие за ней, во многом определили развитие домашних компьютеров на годы вперёд.

P.S. Материал частично основан на ролике за авторством Cathode Ray Dude со свободной лицензией CC BY 4.0, пропущенном через призму собственного мнения и понимания истории вычислительной техники. Не могу не посоветовать к просмотру и оценке для интересующихся необычным ретро-железом.

Источник: youtu.be

14 комментариев

Добавить комментарий

Пришлось менять на богомерзкий P4 двухядерный (двухкристалльный).

Двухпроцовки ставили на тяжелые задачи, вроде крупной полиграфии, расчетов разных и т.д. Работал за дуальником п3 со скази дисками с гигом оперативы. В те годы это было как сегодня тредриппер какой-нибудь сегодня на 666 ядер. Да, там разница была — машинка гиговые тиффы крутила вподне терпимо, в отличие от бытовых компов.

Для чего можно было собрать двухпроцессорный комп в 2001 году? Ну, наверное, для видеомонтажа, 3D-моделирования.

На ютубе есть интересные видео, где человек тестирует такую систему в современных задачах. Он поставил туда два максимальных Pentium 3 1400 Tualatin. Но работает это вовсе не так хорошо, как какой-нибудь ранний ультрабюджетный двухъядерный процессор или чем даже P4 с гипертредингом. Почти так же плохо, как и на одном P3 Tualatin. Дело в том, что межпроцессорное взаимодействие на этих старых двухпроцессорных материнках крайне медленное. Например, ютуб даже в 360p почти несмотрибелен.

А сегодня, если кто хочет, можно собрать двухпроцессорный домашний комп на материнке с Али с сокетами 2011v3. Ищется по запросам «x99 dual», «2011 v3 kit» и т.п. Максимум там можно получить 22*2 ядра, 44*2 потока если поставить топовые CPU «Xeon E5-2xxx v4», но топовые будут стоить дорого, а можно кратно дешевле взять что-то низкочастотное на 14-18 ядер. Но это Haswell/Broadwell, так что IPC будет невысоким (правда, и цена невысокая). Кому оно надо? Ну, для хостинга виртуалок, для того же видеомонтажа. Для игр и обычной работы за домашним компом оно вовсе не нужно, берите обычный одноядерный комп с процессором на 6-8 ядер.

3d не требовало особой мощи на этапе моделирования (да и сейчас не требует), вот рендер — да. Но уже тогда был сетевой рендер, и большие проекты раскидывали по сети на несколько машин. А в конце 90-х 3д вообще на PC только полулюбительское было, тогда sgi еще рулило в мире проф графики.

Ключевое слово к быстрым дискам в те годы было не «raid», а «scsi». Скази не тормозило проц, как ide, имело в разы большую пропускную. Но и цены были на контроллеры и диски — мое почтение.

Добавить комментарий