Как изменились игровые ПК за 2024 год по данным Steam

Steam ежемесячно публикует занимательную и интересную статистику, которая позже становится объектом споров и дискуссий. Также эта информация, при должной обработке и отслеживании динамики, позволяет анализировать общие тенденции в изменении среднестатистических игровых ПК.

Почему только общие тенденции и только в игровых ПК? Steam является крупнейшим виртуальным магазином в мире, при этом я не отрицаю, что есть локально более успешные лаунчеры, как, например, сервисы от Riot Games или HoYoPlay от HoYoverse, но это платформы для запуска конкретных игр от конкретных студий. Детище Valve же представляет из себя платформу для запуска миллионами игроков тысяч игр от сотен студий по всему миру, что даёт нам возможность отследить общемировую тенденцию. Почему же тогда мы можем довольствоваться только усреднёнными тенденциями? При ответе на подобный вопрос я привожу следующие факты: Steam позволяет отказаться от сбора статистики на конкретном аккаунте, из-за чего неизвестно точно число пользователей в выборке; определённую погрешность создают компьютерные клубы, которые необходимо отсеивать при итоговой обработке; кроме этого, существует множество экономических и политических причин, которые вносят коррективы в возможности по обновлению комплектующих в ПК.

С введением покончено, и можно переходить к основной части: анализу изменений в компьютерных комплектующих за 2024 год. В данной статье я буду опираться на свои новости и рассуждения, которые выходят раз в три месяца и демонстрируют динамику в течение года, а также на прошлогодний материал аналогичного содержания, ссылка на который будет в конце статьи. Рекомендую ознакомиться и с ним тоже, ведь помимо изучения общей динамики, я стараюсь разбавить данные статьи различными рассуждениями и фактами. И если в прошлый раз много было сказано о памяти и шине PCIe, а также о количестве ядер в центральном процессоре, то в этот раз поговорим о комплектующих в разрезе игровых ПК.

Операционные системы

Начнём с изучения распределения по семействам операционных систем.

| Декабрь 2023 | Февраль | Май | Август | Ноябрь | Декабрь 2024 | Изменение за год | |

| Windows | 96,4 | 96,92 | - | 96,78 | 96,78 | 96,1 | -0,3 |

| OSX | 1,63 | 1,32 | - | 1,3 | 1,19 | 1,61 | -0,02 |

| Linux | 1,97 | 1,76 | - | 1,92 | 2,03 | 2,29 | +0,32 |

Почему отсутствует статистика за май? Весной со статистикой Steam были проблемы, в результате чего все переменные показали рост, из-за чего сумма процентов в каждой из категорий превышала 100%, чего быть не может. В связи с этим предлагаю не обращать внимание на данный столбец во всех дальнейших таблицах.

На этом моменте изучим самые популярные версии Windows, ну и кой был самый популярный дистрибутив среди Linux, хотя ответ на второй вопрос более чем очевиден:

| Декабрь | Февраль | Май | Август | Ноябрь | Декабрь | Изменение за год | |

| Win11 | 43,51 | 43,29 | - | 50,81 | 54,87 | 56,8 | +13,29 |

| Win10 | 55,44 | 55,91 | - | 48,66 | 44,85 | 43,84 | -11,6 |

| Дистрибутив Linux | Arch Linux | Arch Linux | - | Arch Linux | Arch Linux | Arch Linux | - |

Что касается Arch, то данный дистрибутив лежит в основе сборки SteamOS, а это, уж извините, фанаты Linux, основной двигатель гейминга на линуксе. Я сам жду возможности установить и оценить возможности все возможности данной ОС, чтобы начать знакомство с данным семейством с довольно понятной и интересной мне системы. Для тех, кто не понимает, почему не ставлю сейчас, то пока официально доступна только SteamOS 2 на основе Debian, а версия SteamOS 3 пока представляет из себя только образ для восстановления SteamDeck и не содержит некоторых функций для полноценной работы на ПК. Кстати, на странице, посвящённой данной ОС, можно найти следующее:

Настоящая SteamOS 3 выйдет спустя какое-то время после запуска Steam Deck (и даже тогда она, скорее всего, не будет работать на вашем тостере).

Valve

В общем, юморок у компании не исчез, что до сих пор заметно. Но сейчас, после обновления рекомендаций по использованию логотипов, где указаны требования в том числе и к устройствам на базе SteamOS, а также новости про сотрудничество с Lenovo, вполне возможен выход полноценной версии SteamOS для всех желающих и на ПК.

Теперь к винде. Люди постепенно обновляются до 11 версии, но быстрого перехода не было как на старте, так и сейчас, спустя несколько лет после релиза. Как мне видится, одной из основных причин, почему нет столь быстрого перехода, особенно среди геймеров, мы ведь Steam-статистику разбираем, это отсутствие новых функций. Про подобное я уже рассказывал в статье про виденье разработчиков, где в небольшой исторической справке указал на то, что прежде выход новой версии Windows приносил новый пакет DirectX, что оставляло за бортом множество ещё относительно мощных карт. Ну и теперь к примерам:

- Windows XP поддерживает только DirectX 9

- Windows Vista привнесла поддержку DX10

- DirectX 11 появился в Windows 7

- Windows 10 предложила игрокам поддержку DX12

Да, есть допущения, такие как появления DX11 в составе Windows Vista SP2 или появление DX12 в некотором виде на Win7 в 2019 году, но глобально картину это не меняет. Выход Windows 11, как и Win8 и 8.1, не привнёс ничего глобально нового в DirectX, ну, а раз мы говорим про геймеров, то для них это значит, что можно отложить обновление на неопределённый срок.

Ну, с операционными системами вроде всё, посмотрим мельком как дела обстоят с пользователями VR, и перейдём к следующему разделу.

| Декабрь 2023 | Декабрь 2024 | |

| Модель | Oculus Quest 2 | Oculus Quest 2 |

| Игроков с VR | 1,84 | 2,13 |

Оперативная и видео- память

Вторым разделом идёт рассказ о памяти. Изменения тут происходят крайне редко, хотя подвижки есть всегда, и для этого сначала изучим самые популярные объёмы RAM и VRAM:

| Декабрь 2023 | Февраль | Май | Август | Ноябрь | Декабрь 2024 | |

| RAM, Гб | 16 | 16 | 16 | 16 | 16 | 16 |

| VRAM, Гб | 8 | 8 | 8 | 8 | 8 | 8 |

А также как происходит распределение объёмов ОЗУ:

| Объём ОЗУ | Декабрь 2023 | Декабрь 2024 | Изменение |

| 8Гб | 14,1 | 10,7 | -3,4 |

| 16 Гб | 48,53 | 45,07 | -3,46 |

| 32 Гб | 24,02 | 32,08 | +8,06 |

В прошлом году я говорил о кол-ве карт и их доле в разрезе объёма видеопамяти, но считалось это вручную для проверки гипотезы о том, что объём VRAM считается отдельно от чипа. Кроме этого, Nvidia продолжает ставить 8 Гб видеопамяти в младшие карты, а карты от Nvidia продолжают тотально доминировать в Steam, из-за чего и столь высокая доля данного объёма.

Но сейчас я бы хотел поговорить о памяти в разрезе игр. Если мы говорим про бюджетный сегмент, как, например, про мою RTX 3050 с 8 ГБ VRAM, то данного объёма хватит сегодня для игры в FHD на средне-высоких настройках, и упираться я скорее буду в урезанную шину PCIe или мощность чипа. Но вот если мы будем говорить про карты классом выше, которые нацелены уже в том числе на ультра настройки или игру в более высоком разрешении, например в 1440р, то ограничивающим фактором уже может выступать 8 ГБ той самой памяти, в которую просто не влезут все необходимые данные. Но тут на помощь могут прийти новые технологии передачи и декомпрессии данных непосредственно на видеокарте, что может отобрать некоторый процент производительности графического чипа на их декомпрессию, но зато позволит меньше занимать шины данных. Собственно, везде есть компромиссы, и без них никуда.

Если же мы берём игры на максимальных настройках и в высоких разрешениях, то тут уже необходимо большее видеопамяти, которую просто так не добавить. Может, конечно, самостоятельно пересадить чипы памяти, но вот только из-за ограничений шины связывающей память с GPU или параметрами vBIOS, данная операция может стать фикцией и карта банально не заработает. Собственно таких экспериментов уже не делали относительно давно. Игры, так же как и остальные программы, при расширении функционала и качества графики начинают требовать всё больше ресурсов. Пример такого я приводил в статье со сравнением Steam и EGS, где клиент от Valve потреблял больше ОЗУ, причём на уверенные ~500 Мб. Также не следует забывать, что каждая новая версия Windows занимает в ОЗУ всё больший и больший объём, что и отражается на системных требованиях. В результате чего на системах с малым объёмом оперативной памяти новые версии ОС могут постоянно загружать ОЗУ на 100%, что, в свою очередь, будут вызывать простои в работе процессора из-за недостатка данных из-за постоянной тасовки данных между диском, ОЗУ и непосредственно процессором.

И кстати, в случае с ОЗУ важен также не только объём, но и другие показатели. В частности, в материале со сравнением памяти я нашёл довольно интересный факт. Один из основных параметров ОЗУ, ПСП (пропускная способность памяти), которой возрастает с увеличением частоты или канальности, обеспечивает основной прирост производительности при упоре в подсистему памяти, в тоже время прирост от снижение таймингов и уменьшения задержек при обращении в ОЗУ заметить сложнее. Так случилось после появления в процессорах иерархии достаточного кэша, который позволяет предварительно загружать необходимые данные в более быстрые кэши, но с появлением многоядерных процессоров тема стала вновь актуальной. В процессорах Intel больший объём кэша не всегда полезен из-за их главного достоинства и недостатка: кольцевой шины, благодаря которой все ядра имеют доступ ко всему объёму кэша третьего уровня. Процессоры AMD имеют чиплетную структуру, что увеличивает межядерные задержки и задержки при обращении в память. И именно это делает столь эффективным процессоры X3D с дополнительными плитками кэша. И вот в моменты, когда идёт упор именно в подсистему памяти,

Новые игры могут занимать на дисках более сотни гигабайт, которые при запуске игры необходимо подгрузить в ОЗУ, чтобы работать с ними было быстрее. Откуда такие объёмы? Повышение детализации, увеличение разрешения текстур, сложность текстур (современные текстуры состоят не из одной или двух развёрток, а из множества отдельных карт). Кроме этого, принимаем во внимание, что в игру зачастую зашиваются текстуры высокого разрешения по умолчанию, а только они могут весить треть или даже до половины от общего веса игры. Отказываться от них? Нет, достаточно тех, кто хочет играть с максимальными настройками и лучшей графикой. В этом плане мне нравится установка игр от Ubisoft (за новые игры сказать не могу, не знаю), ведь устанавливая тот же Watch Dogs 2, я могу отказаться от HD текстур и значительно сократить время ожидание загрузки, а также занимаемое дисковое пространство. И это довольно интересный и важный компромисс: людям, у которых слабый ПК или которые хотят получить максимум производительности, дают возможность сэкономить место, не загружая пак качественных ассетов, в то же время игроки-графоманы или обладатели топовых ПК могут наслаждаться качественными моделями и текстурами, пускай и ценой большего размера игры или несколько сниженной производительности из-за возросшей нагрузки на ПК.

Так что постепенное увеличение объёмов ОЗУ вполне обычная практика, которая преследуют пользователей не первый десяток лет.

Процессоры

Переходим к более интересным темам, в данный момент это изучение процессоров. В материале за 2022 год я пытался определить относительную новизну процессоров и по косвенным признакам удалось узнать что почти 89% из всех процессоров новее 2015 года, сейчас таких процессоров уже почти 95% (более подробно, как я это определяю, можете почитать тут). Можно было бы повторить, тем более что в тот раз я не учитывал SHA-инструкции, но сегодня другая тематика материала.

Для начала оценим разделение рынка процессоров между синими и красными, а также самое популярное число ядер:

| Декабрь | Февраль | Май | Август | Ноябрь | Декабрь | Изменение | |

| Кол-во ядер | 6 | 6 | 6 | 6 | 6 | 6 | 0 |

| Intel | 66,29 | 67,91 | - | 66,69 | 64,23 | 63,46 | -2,86 |

| AMD | 33,66 | 32,05 | - | 33,26 | 35,71 | 38,73 | +5,07 |

Похоже, что раздел с процессорами подвергся ещё одному сбою в конце года, а в других разделах я нашёл всего одну серьезную аномалию, которая позже будет продемонстрирована.

Ну и изучим динамику изменения долей двух-, четырёх-, шести- и восьмиядерных процессоров:

| 2023 | 2024 | Изменение | |

| 4 ядра | 22,82 | 17,54 | -5,28 |

| 6 ядер | 32,11 | 31,67 | -0,44 |

| 8 ядер | 20,43 | 23,59 | +3,16 |

Собственно, тенденция по увеличению «ядерности» процессоров продолжается, что опять же не ново. И вроде как надо бежать за восьмиядерниками, ведь в консолях установлены именно восьмиядерные камни. Но 8 ядер у них только на бумаге и в кремнии, а вот играм доступно не всё. Собственно, из-за этого, а также из-за микроархитектуры Zen2, которая, мягко скажем, не нова, более современные шестиядерники могут показывать производительность сопоставимую, или даже выше, чем консольные псевдо-восьмиядерники. Фокус в том, что в консолях уже не первое поколение используют зарезервированное ядро, которое доступно только системе. И, скорее всего, можно создать сценарии, когда шестиядерники в ПК будут проигрывать процессорам в консолях, но, исходя из теории, в обоих случаях необходимо добиться процессорозависимости, при этом исключив ограничения со стороны памяти и ГПУ. В таком случае нагрузка от фоновых задач будет не отнимать процессорное время у основных ядер, которые заняты обработкой игры, а вынесется на зарезервированное ядро, что позволит избежать статеров в игре. Но это будут лабораторные условия, в которых будут хорошо параллелящиеся задачи, к которым игры относятся лишь отчасти, и даже в современных играх можно наблюдать упор может идти в одно или два ядра. И пока самые тяжёлые расчёты выполняются на самом производительном ядре, остальные ядра могут простаивать, и на эти пустые места вполне себе могут втиснуться фоновые процессы.

Собственно, это, а также другие особенности консоли, такие как используемая ОС и API, не позволят найти абсолютный аналог по игровой производительности. Можно найти аналог по транзисторному бюджету или функциональным возможностям, но никак не полный аналог консоли на потребительском рынке.

Теперь вернёмся к игровой теме разговора. Думаю, многие из читающих эти строки видели или слышали, что если ядер больше 8, то это будет влиять на игровую производительность околонейтрально или даже отрицательно, и лучше иметь 6 или 8 быстрых ядер. Но почему же тогда старшие Ryzen 9, которые прекрасно показывают себя в рабочих и синтетических тестах, могут выступать на уровне номинально более слабых Ryzen 7? Неужели разработчики никак оптимизацией под многоядерные процессоры не займутся? В данном случае вполне нормально применять данный термин, ибо речь идёт о максимально эффективном задействовании ресурсов (а почему оптимизация не всегда ведёт к повышению производительности, я разбирался тут, во вступительном блоке). А ответ на этот вопрос уже частично дан выше: рабочие задачи, такие как расчёт физики или математические вычисления, довольно неплохо параллелятся, в том числе из-за постоянства нагрузки и однородности вычислений. Если же мы говорим про игры, то их распараллелить куда сложнее: можно разделить глобальную задачу на подзадачи, которые будут выполняться на разных потоках, но из-за работы над одним набором данных возникает True Sharing (попытка одновременно несколькими ядрами изменить одно и то же значение переменной, хранящейся в общей памяти), что вызывает дополнительные задержки при синхронизации кэшей. В итоге гораздо легче параллелить более крупные задачи, и если утрировать очень грубо, то одно ядро считает физику, второе — обрабатывает аудио-

В английском языке существует термин Embarrassingly parallel, который можно перевести как «чрезвычайно параллельная задача», что обозначает глобальную задачу, которую легко разделяется на множество подзадач, которые могут выполняться параллельно друг другу. В качестве примеров зачастую приводят задачи, решаемые на GPU, ведь они создавались как раз для решения множества однотипных вычислений, что обусловлено сотнями и тысячами однотипных и простых ядер на кристалле, которые позволяют выполнять простейшие арифметические операции. Для процессоров тоже есть подобные операции, например, числодробилки, но распараллелить задачи на ЦП гораздо сложнее из-за его устройства, которое позволяет выполнять множество типов операций, но никак не множество задач одного типа параллельно. Если мы будем говорить про игры, то для видеокарт это легко паралялящиеся задачи, а вот для процессора нет. И идеальным сценарием работы было бы равномерное распределение задач по потокам, каждый из которых завершал работу одновременно. Но это, опять же, возможно только в лабораторных условиях или рабочих задачах.

И что из этого следует? Процессорная производительность в игре спокойно может упираться в возможности одного ядра, и если у него низкая производительность (из-за низкой частоты, старой архитектуры или промахов в кэш), то большее число потоков не позволит получить кратную прибавку к производительности. Таким образом, имея процессор с 6 или 8 быстрыми ядрами, которые никак не будут ограничиваться со стороны подсистемы памяти, то можно в ближайшее несколько лет не заморачиваться с обновлением процессора (если, конечно, не захочется играть с максимальными настройками и высоким FPS). Но уточнение про память было не зря, ведь от скорости работы с ней зависит и итоговая производительность процессора.

Например, я не переживаю за процессорную производительность своего R5 5500, ведь тут шесть ядер с микроархитектурой Zen3 и монокристальная структура, что положительно сказывается на задержках при обращении в кэш. Так что я могу получить и 30, и 60 кадров в секунду, и в современных играх упор будет в графический процессор. Но данный камень получил урезанный кэш третьего уровня: всего 16 Мб, вдвое меньше, чем у полноценных шестиядерных чипов на Zen3. Будет ли это сказываться на производительности во всех играх? Нет, только где будет явный упор в процессор и скорость работы с данными.

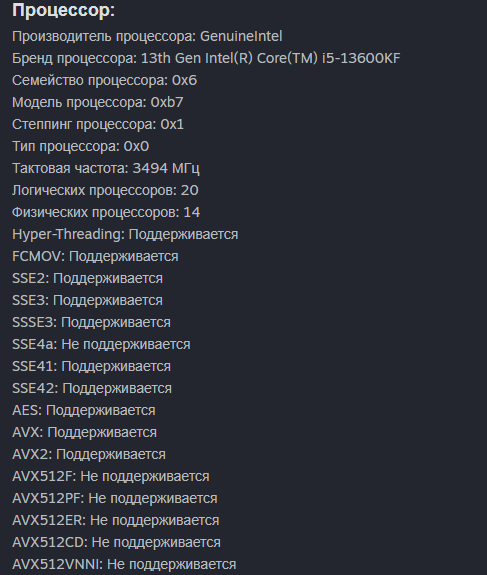

Кстати, если Вас, как и меня, интересовало, как Steam определяет процессоры Intel с разнородными ядрами, то я поспрашивал знакомых и нашёл владельца такого процессора. Steam верно определяет количество ядер и потоков, а также определяет, что процессор поддерживает многопоточность. Меня из всего этого больше интересовала поддержка HT, ведь примерно понимание, сколько процессоров 12, 13 и 14 поколения у игроков Steam, у меня уже было, опять же, из открытой статистики, а вот как определяется поддержка HT для процессора, у которого часть ядер не имеют данной технологии, — меня действительно интересовало.

Видеокарты

Ну и под конец посмотрим, что там в сегменте видеокарт. Декабрьский список самых популярных карт выглядит следующим образом:

| Топ 20 | Декабрь 2023 | Февраль | Май | Август | Ноябрь | Декабрь 2024 | Изменение |

| Доля AMD | 2,17 | 1,98 | - | 1,99 | 3,54 | - | +1,37 |

| Доля Intel | 3,44 | 1,83 | - | 3,43 | 3,57 | - | +0,13 |

| Доля Nvidia | 47,65 | 52,38 | - | 50,95 | 48,39 | - | +0,74 |

| Карт с RT | 10 | 13 | - | 12 | 12 | - | +2 |

| Сумма долей карт из топ 20 | 53,26 | 56,19 | - | 59,37 | 55,5 | - | +2,24 |

Собственно это ещё что, вот так выглядит распределение карт по уровню поддержки DirectX:

Так что, пожалуй, учитывать численные значения за декабрь не будем, хотя в общей статистике всё более-менее адекватно.

| Общий | Декабрь 2023 | Февраль | Май | Август | Ноябрь | Декабрь 2024 | Изменение |

| Самая популярная карта | RTX 3060 | RTX 3060 | RTX 3060 | RTX 3060 | RTX 3060 | RTX 3060 | - |

| Доля AMD | 15,96 | 15,09 | - | 15,41 | 16,24 | 16,52 | +0,56 |

| Доля Intel | 8,15 | 7,59 | - | 7,69 | 7,69 | 7,72 | -0,43 |

| Доля Nvidia | 74,8 | 76,92 | - | 76,57 | 75,76 | 75,43 | +0,63 |

В данных таблицах можете пронаблюдать, как изменялись доли карт от зелёных, красных и синих, какая была самая популярная карта в каждом из месяцев, ну и пара других чуть менее интересных, но тоже важных параметров.

В прошлогодней итоговой статье я решил изучить, как изменяется количество карт, относящихся к первой двадцатке, и в 2023 году их доля снизилась на 3,59%, ну, а в этом году наблюдается обратная ситуация: +2,24%. В остальном же мы наблюдаем относительную стабильность: чипы под брендом Nvidia установлены в подавляющее число видеокарт, ну, а Intel и AMD значительно отстают. Самый популярный ГПУ с лета прошлого года также не изменился, и это место сейчас занимает RTX 3060. И перед тем как мы не перейдём к играм, хотелось бы отметить ещё парочку моментов: насколько бы плохими ни были карты первого поколения Intel Arc, но в списке самых популярных карт появилась данная графа, а это значит, что у них уже начала набираться установочная база. И вторым моментом хотелось бы отметить увеличивающееся число карт в первой двадцатке, которые поддерживают технологию трассировки лучей: в конце 2023 года их было 10, а в ноябре 2024 года уже 12. На этом моменте переходим к играм, и небольшой анекдот перед началом:

- - Даже 4090 не тянет этот ваш RTX!

- -Так почему же она тянет DLSS?

- -А как это связано?

- -Так 4090 и есть RTX

Данный юмористический разговор произошёл между мной и ещё одним человеком в процессе обсуждения забавного комментария под видео с разбором технологии RT, которая, кстати, будет затрагиваться. В чём юмор, попробуйте понять сами, а остальным предлагаю погрузиться в небольшой исторический экскурс.

Уже больше года, с момента как я сел готовить вышедший недавно графический обзор CS2, у меня лежит заготовка для материала про развитие игровой графики, где мне бы хотелось даже в общих чертах продемонстрировать различные графические технологии, которые появлялись в разное время. Как вы понимаете, руки до него не доходят, но определённые наработки имеются. И поздравляя Valve с двадцатым юбилеем Half-Life 2, пересматривая документальный фильм в русской озвучке, запустим данную игру и пробежимся по настройкам. Для создания реалистичных отражений на воде в игре используются планарные отражения, которые якобы гораздо лучше, чем этот ваш новомодный RT, ну что ж, проверим:

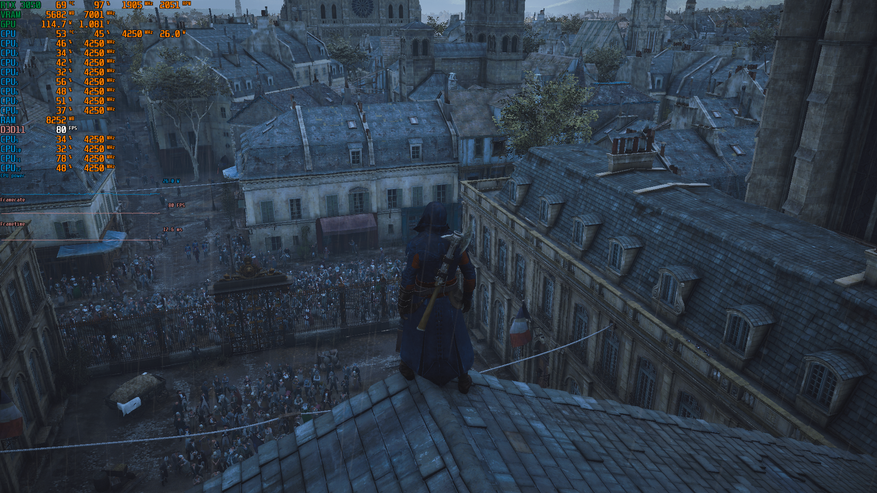

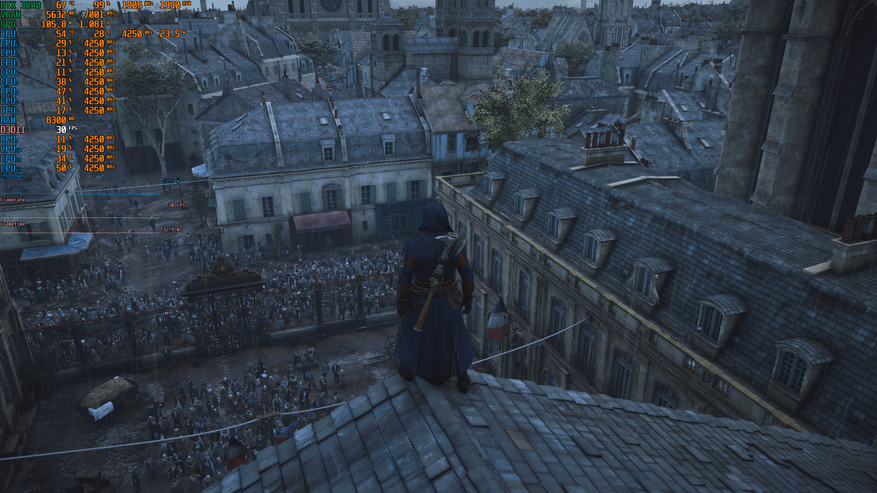

Есть три настройки для отражений, но планарки появляются только при выставлении параметра «Отражать всё». Скажу сразу, в игре кадровая частота постоянно прыгает в диапазоне +-50 FPS от значения на скриншоте, из-за этого я буду апеллировать только к приближенным значениям кадровой частоты. Также я не продемонстрировал настройку «Простой», ведь она практически не отличается от настройки «Отражать мир» как по итоговой картинке, так и по кадровой частоте. И включив планарные отражения, мы теряем почти 150 кадров, а это треть производительности, при этом на железе много мощнее системных требований. Все остальные настройки стоят на максимуме, и единственное, к чему могут докопаться сторонники «Планарки работают без просадок», это загрузка GPU. Ну в какой-то мере они правы, но вот только и с отключенными отражениями он не загружен полностью, а это обозначает, что видеокарта может отрисовать ещё больше fps, только вот ей никто эти кадры не даст. Обратите внимание на API — DirectX 9, и загрузку отдельных ядер: явно выделяются потоки, которые загружены по максимуму. Кроме этого, следует понимать, что у R5 5500 есть явное ограничение по частоте и, следовательно, по производительности на ядро. Но обратите внимание также что остальные ядра не загружены на 0%, на них как раз висят запущенные в фоне программы: Steam, браузер, текстовый редактор. При этом в игре не используется никаких новых технологий, низкая детализация. Что же будет, если мы переместимся на десять лет вперёд и заглянем в Assassin's Creed Unity?

На самом деле не обязательно запускать Unity, и можно было бы обратиться к моей статье про сглаживания, но я всё же зайду ещё раз, тем более что система с того раза обновилась.

Сейчас, как и всё время существования данной настройки, сглаживание может существенно понижать кадровую частоту, и с этим все давно смирились. Но ведь все графические настройки понижают кадровую частоту, вопрос лишь в том, насколько и что они меняют в итоговой картинке. DLSS позволяет получить прибавку к производительности, хотя и является отчасти сглаживанием, за счёт рендера исходного кадра в сниженном разрешении, которое позже апскейлится до нативного. В этом вся суть DLSS 2: снижение исходного разрешения в зависимости от пресета, создание недостающих пикселей путём реконструкции кадра с использованием темпоральных методов и обученных нейросетей. И в этом помогают специальные блоки, тензорные ядра внутри чипа, которые позволяют выполнять математические преобразования с матрицами целиком, а не выносить каждую операцию сложения/умножения отдельно. Но ведь есть DLAA, который сохраняет реализацию сглаживания картинки из DLSS, но только работает в исходном разрешении рендера, что может дать дополнительный прирост в качестве детализации, но и даже снизить производительность. А если и вовсе провернуть обратные к DLSS действия, повысить виртуальное разрешение монитора, что заставит рендерить картинку в более высоком разрешении и даунскейлить до нативного разрешения монитора, то можно получить более качественную картинку и просадку FPS. Называется данная технология у Nvidia DSR, или более новый и продвинутый DLDSR, с использованием нейронных сетей. И данный метод, как и SSAA, являются самыми математически верными: создавая картинку в завышенном разрешении относительно исходного, получается избыточная выборка на каждый пиксель, в результате чего получается более точная картинка, с минимальным числом лесенок и без мыла.

Про отражения поговорили, про производительность и сглаживания поговорили, что же осталось? Ах да, точно, графика в сухом остатке. Из самого нового, что я могу запустить в хорошем качестве, возьмём Control и Cyberpunk 2077. Игры уже не новые, но и у меня не топовая и даже не средняя, а карта начального сегмента, на которой даже не рекомендуют включать трассировку. Собственно, именно это и происходит в Cyberpunk 2077, где для достижения отметки в 60 стабильных кадров при перестрелки, приходится выставлять средние настройки и DLSS на качество. Но если взять более простую игру, Control, где удаётся добиться большей производительности из-за замкнутых пространств, что снижает удельную нагрузку на систему, то в данной игре я спокойно включаю трассировку при средне-высоких настройках, и используя DLSS Качество или Баланс можно добиться стабильной отметки в 60FPS.

Если железо не вытягивает игру с новыми технологиями на определённых настройках, то, возможно, это не вина конкретной игры, а недостаточно мощного железа или несовершенен алгоритм, который используется в данный момент. RT принято критиковать за «тяжесть» и неточность, но это исходит из основного отличия трассировки в реальном времени (в играх) от пререндеров: зачастую в играх расчёт идёт с точностью 1 луч на пиксель, в то время как при создании фильмов или анимаций могут выпустить сотни и даже тысячи лучей. Но даже такое значительное снижение плотности лучей не хватает для быстрого расчёта сцены, в результате чего появляются и другие методы оптимизации. Так, например, карты Nvidia используют аппаратное ускорение BVH, суть которого такова: для более быстрого определения места столкновения луча сцена делится на две части, каждая из которых ещё на две и так далее, при этом деление происходит не геометрически, а исходя из того, чтобы в каждой половине было равное число полигонов. Таким образом возрастает скорость расчёта благодаря более простым математическим вычислениям, которые производятся для каждого луча, в результате чего возрастает скорость работы без ущерба качеству. Можно же, наоборот, пожертвовать качеством: так, например, программный Lumen использует для расчёта упрощённые модели, что позволяет создавать вполне реалистичные отражения на любых картах, но несколько хуже, чем аппаратный Lumen (или же просто RT). Что касается других методов оптимизации, то некоторые разработчики (например, в ремастере Crysis 2) ограничивают дальность полёта лучей при расчёте отражений с RT, что позволяет снизить нагрузку на систему, но, опять же, жертвуя качеством отражений удалённых объектов.

Вывод

Вот в целом и всё, основные итоги года в железном плане подведены, осталось только сделать вывод и перейти к Угадайке.

Железо и софт медленно, но верно движутся в сторону обновления, как бы консерваторы и противники новых технологий не говорили об ненужности всего нового. При этом выходят новые игры с поддержкой трассировки, а сама технология продолжает развиваться. В разделе с операционными системами я приводил информацию о выходе новых версий DirectX, полноценная поддержка которых требовала обновления железа. При этом на старте новых технологий априори не может быть много игр со всеми новыми плюшками, ведь разработчикам надо для начала самим разобраться и подготовить для этого инструментарий. И такое было всегда: выход технологии, её развитие и после её становление стандартом. В статье с обзором WD2 я приводил цитату TechPowerUp, которые сетовали на DX12, хотя сегодня это уже хороший базис. Так что вопрос лишь в том, почему раньше можно было, а сейчас нет.

Но давайте пройдёмся по Угадайке прошлого года: в целом результат можно засчитать 3/3, но с уточнениями. Про пятёрку карт оба вывода были правдивыми, второе место за RT-совместимой картой и GTX 1060 вылетела из топ-5, но я недооценил скорость распространения RTX-карт, и в топе их уже 4. Восьмиядерные CPU тоже не заняли первое место, но потихоньку сокращают разрыв с шестиядерниками. И на этом моменте закончим и составим Угадайку на следующий год:

- 32 ГБ ОЗУ станет самым популярным объёмом

- Все карты из топ-10 будут иметь блоки для ускорения трассировки

- 8 ядер у ЦП станет самым популярным решением

Так же рекомендую ознакомится с материалом за прошлый год (Статистика за 2023) и материалом с разбором статистике за ноябрь 2024.

11 комментариев

Добавить комментарий

Дык и 32 ГБ конкретно DDR3 превратилось в тыкву примерно вместе с ним же. И, кстати, более медленные процессоры и сейчас вполне себе выпускаются и продаются. Так что ничего удивительного, что и сейчас 16 ГБ памяти тоже можно обходиться. В т. ч. и в бюджетном игровом компьютере этого временами может быть вполне достаточно, угу. А в небюджетном уже и 32 с прошлого года может быть мало

А что касается «в небюджетном мало объёма» — я просто рендеря картинки с нашего маленького сервера в Minecraft обнаружил, что прямо тогда неплохо было бы иметь примерно 192 Гб, что можно было только на Xeon-ах, на которые денег у меня не было. Да вообще всегда были задачи, способные сожрать любой объём, поэтому я в рассуждениях ограничиваюсь только компом бытового назначения (так, будучи ещё школьником, я видел мутанта на 386 процессоре с 128 Мб памяти, если не ошибаюсь за давностью лет).

Вообще, я к тому веду, что если видюхи развиваются почти не снижая темпов, процессоры перешли к наращиванию количества ядер, диски стали твердотельными и теперь наращивают ёмкость там, то потребность и навстречу ей количество оперативной памяти уже давно вышло на плато. Кстати, мне кажется, следующие — диски. Возможность хранить всё где-то на серверах и загружать к себе по мере надобности снижают требования к накопителю бытового устройства.

Потребности разные. Зависят от задач. Тут конкретная.

«Да вообще всегда были задачи, способные сожрать любой объём, поэтому я в рассуждениях ограничиваюсь только компом бытового назначения»

Так я собственно конкретно про игровые — чтоб не отходить от темы. Вот в них уже 32 ГБ мало, хотя в принципе можно и обойтись. А в недорогие и сейчас ставят 16 ГБ нередко. А в том же 2012 году ставили 8 ГБ обычно. И вообще — в статистике Steam за апрель 2012 года (поскольку вокруг неё танцуем) 5 ГБ и более — лишь 30% компьютеров. А от 2 до 4 ГБ — 62%

То, что конкретно вы поставили 32 ГБ… ну поставили и поставили. А сейчас это не кто-то поставил, а новая _норма_ норма для игрушек. На которую уже приходится бОльшая доля, чем на _всё_ 4+ в 2012.

Хотя никто не мешает сейчас и просто 192 ГБ поставить в обычный домашний писюк. Для игрушек оно, естественно, не нужно — ну дык и 32 ГБ для игрушек никто не ставил не только 12 лет назад, но и лет пять назад ещё. И сейчас ещё не все — но уже многие

В общем, где-то в восемь раз объём памяти стало быть вырос. Такое себе «плато»

За предыдущие 12 чуть больше, конечно — но за это большое спасибо NT6 как раз в этот период попавшей и вообще переходу с х86 на х64

«если видюхи развиваются почти не снижая темпов»

Доразвивались в итоге до того, что в 4/5 компьютеров дискретных видеокарт уже и не осталось, ага…

Тут, конечно, совсем иной случай, но… Steam Deck к нему вполне так относится

Так что да, данный проц просто перешёл из топового сегмента в бюджетный за эти годы

А на DDR3 было бы здорово посадить нынешний X3D чип, я думаю, что был бы сюрприз, в скольких задачах она дала бы незначительное и даже незаметное падение. Да чего уж: в порядке бреда можно представить схему наподобие Lunar Lake, где 32 Гб LPDDR5-8533 это кэш 4 уровня, а дальше вагон дешманской DDR3.

Добавить комментарий