СОДЕРЖАНИЕ

- Особенности видеокарты

- Конфигурации стендов, список тестовых инструментов, качество в 2D

- Описание системной платы Gigabyte K8NXP-SLI

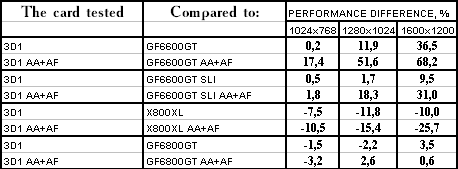

- Результаты тестов: TRAOD

- Результаты тестов: FarCry Research

- Результаты тестов: FarCry Regulator

- Результаты тестов: FarCry Pier

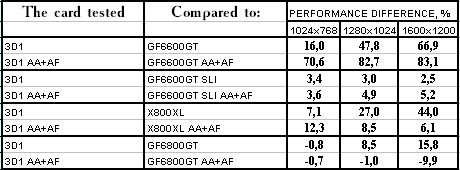

- Результаты тестов: Half-Life2, ixbt01

- Результаты тестов: Half-Life2, ixbt02

- Результаты тестов: Half-Life2, ixbt03

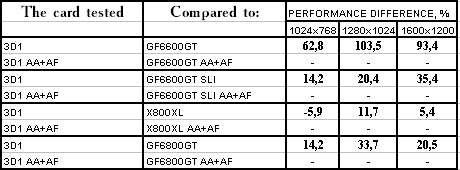

- Результаты тестов: DOOM III

- Результаты тестов: 3DMark05 Game1

- Результаты тестов: 3DMark05 Game2

- Результаты тестов: 3DMark05 Game3

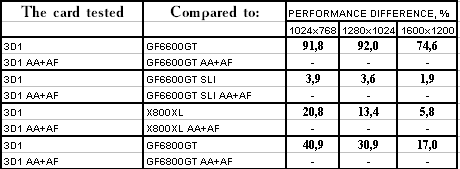

- Результаты тестов: 3DMark05 MARKS

- Выводы

Сегодня не совсем обычный обзор, поскольку он посвящен не отдельной видеокарте, или видеокартам, а целому комплекту, состоящему из уникального акселератора, базируемого на двух GeForce 6600GT; и системной платы, основанной на NVIDIA nForce4 SLI.

Это решение вызвано политикой самого производителя Gigabyte относительно новой видеокарты 3D1, которая может работать только совместно с системной платой Gigabyte K8NXP-SLI. Поэтому нет смысла отдельно изучать видеокарту, которая жестко привязана к некоей системной плате.

Будет ли продаваться 3D1 самостоятельно или только как компонент набора — мы не знаем. Gigabyte пока не определился с этим. И такая видеокарта будет выпущена ограниченным тиражом. Естественно, что системная плата K8NXP-SLI без 3D1 появится в продаже. Да и будет, как обычно, модификация без «XP», то есть менее «навороченная» по комплектации.

Чем вызвана идея разместить два процессора GeForce 6600GT на одной PCB? Ведь все равно изделие будет требовать наличия системной платы с SLI! Я долго размышлял над целесообразностью такого решения, и кроме маркетинговых и рекламных соображений на ум ничего не приходило.

Да, разумеется, 3D1 гарантирует образование SLI, ибо понятное дело, что две условных видеокарты на одной PCB точно идентичны. Как показали наши тесты, SLI — вещь весьма капризная, и не каждая пара видеокарт легко сумеет его образовать: драйвер придирчиво «ощупывает» каждую из видеокарт. Но так же понятно и другое: покупка двух GeForce 6600GT от одного производителя на 99% гарантирует то, что SLI будет, тем более, если покупать их вместе.

Разница в цене? Безусловно, две видеокарты стОят дороже, чем одна, даже такая навороченная. Но при этом теряется одно из преимуществ SLI: гибкое наращивание мощности графической подсистемы — если позволяют финансы, покупаем один ускоритель, как снова появятся свободные средства — покупаем второй и наращиваем силу 3D. В данном случае мы вынуждены покупать сразу два акселератора, пусть и на одной плате. Повторяю, что смысл есть только в том случае, если цена на него будет значительно ниже суммарной цены за две карты.

Может ли такая видеокарта потенциально работать не только на системной плате на базе nForce4 SLI, но и, например, на iE7525? К тому же, тот же Gigabyte объявил о выпуске материнки на базе i915, но с поддержкой SLI. Теоретически ничего мешать не должно, но повторяю, что 3D1 может работать только на K8NXP-SLI. Во всяком случае, пока. Возможно, дальше будет поддержка со стороны материнки на базе i915.

Производитель заявил о том, что скорость 3D1 превосходит GeForce 6600GT SLI (из 2-х видеокарт). Это и не удивительно. Почему — расскажу ниже. Поскольку самое время рассмотреть главного героя.

Плата

| Gigabyte 3D1 (2xGeForce 6600GT) | |

|---|---|

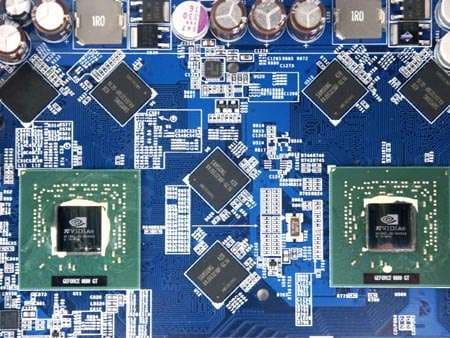

Карта имеет интерфейс PCI-Express x16, в сумме 256 МБ памяти GDDR3 SDRAM, размещенной в восьми микросхемах на лицевой стороне PCB. Микросхемы памяти Samsung. Время выборки у микросхем памяти 1,6 ns, что соответствует частоте работы 625 (1250) МГц, память же работает на частоте 570 (1140) МГц. Частота работы обоих GPU — 500 MHz. Шина обмена с памятью — по 128 бит на каждый процессор. 8 пиксельных конвейеров и 3 вершинных у каждого GPU. Хочу обратить внимание на повышенную частоту работы памяти — 570 МГц против 500 МГц у серийных GeForce 6600GT. Не в этом ли и заключается то самое превосходство по скорости, которое нам обещает производитель? |  |

| Сравнение с эталонным дизайном, вид спереди | |

|---|---|

| Gigabyte 3D1 (2xGeForce 6600GT) | Reference card NVIDIA GeForce 6600GT 128MB |

|  |

| |

Прекрасно видно, что над дизайном работали люди, наверно, решившие под Новый Год приукрасить карту необычным узором из микросхем памяти, потому что невозможно понять — зачем надо было их ставить под углом в 45 градусов. Особенно если сами процессоры установлены без смещений. Чуть позже я получил от Gigabyte следующую информацию: такое решение предполагает расположение микросхем памяти на равном расстоянии от процессора, что, по мнению разработчиков, экономит место на PCB, делая плату более компактной.

Разумеется, по совместному питанию двух GPU и удвоенного числа микросхем памяти, плата уже вышла за пределы лимита PCI-E подсистемы в 75Вт, поэтому мы видим на карте разъем для внешнего питания, как у старших моделей.

Посмотрим на графический процессор.

Очевидно, что эти два чипа ничем не отличаются от обычных 6600GT, устанавливаемых на одиночные карты.

Сама видеокарта работает хитро: ее PCI-E x16 разъем на самом деле вовсе не x16, а сдвоенный x8. Просто на одной PCB разместили две карты совершенно независимые друг от друга, и лишь аналог того самого адаптера- синхронизатора, который мы обычно одеваем на две SLI-видеокарты, вмонтированный в PCB, соединяет их между собой. Система же видит ДВЕ ВИДЕОКАРТЫ.

Поэтому ясно, что под такую видеокарту подойдет только материнка, умеющая подавать на PCI-E x16 слот два сигнала X8. Отсюда вывод, что продукт обречен на привязку к системным платам от Gigabyte. Хоть все системные платы на NForce4 SLI и умеют менять x16 на x8, но одновременно на первый слот подать 2x8 — вряд ли.

Кстати, когда 3D1 появился, первым делом я вставил ее в ASUS A8N SLI, что стояла на стенде до сего момента. Система запустилась, дошло дело до установки драйверов под видеокарту, после чего при инициализации видеокарты все зависло. Что и требовалось доказать.

Продолжим изучать видеокарту.

Комплектацию в данном разделе не рассматриваем, ибо она общая с системной платой (поэтому рекомендую прочитать следующий раздел по K8NXP-SLI).

Системная плата Gigabyte K8NXP-SLI

Чтобы не загромождать материал, краткий очерк об этом продукте мы вынесли на отдельную страницу.

Установка и драйверы

Конфигурации тестовых стендов:

- Компьютер на базе Athlon64

- процессор AMD Athlon64 2400 MHz (218MHz x 11; L2=512K) (~3800+);

- системная плата Gigabyte K8NXP-SLI на чипсете NVIDIA nForce4 SLI; Включен режим работы с ОДНОЙ видеокартой!

- оперативная память 1 GB DDR SDRAM 400MHz;

- жесткий диск WD Caviar SE WD1600JD 160GB SATA.

- операционная система Windows XP SP2; DirectX 9.0c;

- мониторы

ViewSonic P810 (21") иMitsubishi Diamond Pro 2070sb (21"). - драйверы ATI версии 6.497 (CATALYST 4.12); NVIDIA версии 71.20.

VSync отключен.

По умолчанию в драйверах обеих компаний включены оптимизации трилинейной фильтрации.

Надо сказать, что 3D1 прекрасно распознается RivaTuner-ом, поэтому проблем по разгону нет. Что касается самих частот, то подняться они смогли всего до 540/1250 МГц (по GPU — не особенный разгон). Но тут есть серьезные ограничения, связанные с разводкой карты, да и стабильностью работы обоих процессоров при излишнем нагреве.

Результаты тестов

Перед тем, как кратко дать оценку качеству в 2D, я еще раз поясню, что на настоящий момент НЕТ полноценной методики объективной оценки этого параметра по следующим причинам:

- Практически у всех современных 3D-акселераторов качество 2D может сильно зависеть от конкретного экземпляра, а отследить все карты невозможно физически;

- Качество 2D зависит не только от видеокарты, но и от монитора, соединительного кабеля;

- В последнее время огромное влияние на этот параметр стали оказывать связки: монитор-карта. То есть, встречаются мониторы, «не дружащие» с теми или иными видеокартами.

Что касается протестированных экземпляров, то совместно с Mitsubishi Diamond Pro 2070sb платы продемонстрировали одинаковое отменное качество в следующих разрешениях и частотах:

| Gigabyte 3D1 (2xGeForce 6600GT) | 1600x1200x85Hz, 1280x1024x100Hz, 1024x768x120Hz |

|---|

Результаты тестов: сравнение производительности

В качестве инструментария мы использовали:

- Tomb Raider: Angel of Darkness v.49 (Core Design/Eldos Software) — DirectX 9.0, Paris5_4 demo. Тестирование проводилось при максимально установленном качестве, выключены были лишь Depth of Fields PS20.

- Half-Life2 (Valve/Sierra) — DirectX 9.0, demo (ixbt01, ixbt02, ixbt03 Тестирование проводилось при максимальном качестве, опция -dxlevel 90, в файле dxsupport.cfg убраны предустановки для видов карт.

- FarCry 1.3 (Crytek/UbiSoft), DirectX 9.0, мультитекстурирование, 3 demo из уровней Research, Pier, Regulator (запуск игры с опцией -DEVMODE), настройки тестирования все Very High.

- DOOM III (id Software/Activision) — OpenGL, мультитекстурирование, настройки тестирования — High Quality (ANIS8x), demo ixbt1 (33MB!). Имеется пример автоматизации запуска с увеличением скорости и уменьшением числа рывков (прекешинг) d3auto.rar. (НЕ ПУГАТЬСЯ черного экрана после первого меню, так и должно быть! Он будет секунд 5-10, а потом должна пойти демка)

- 3DMark05 (FutureMark) — DirectX 9.0, мультитекстурирование, настройки тестирования — trilinear,

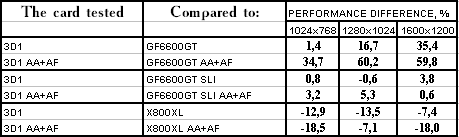

TR:AoD, Paris5_4 DEMO

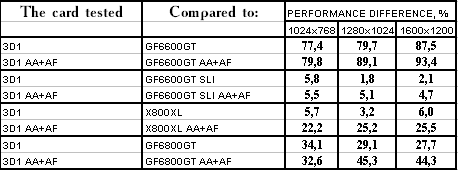

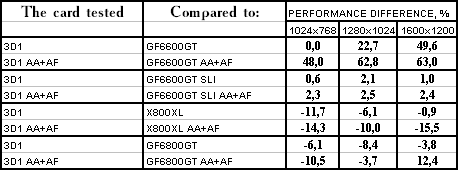

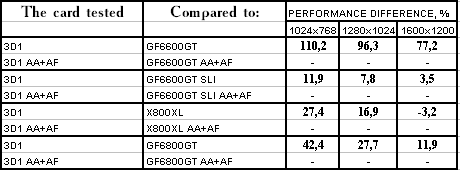

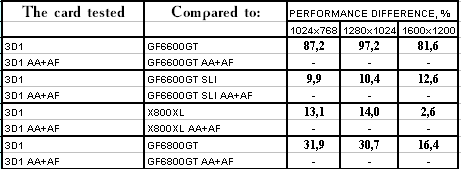

Этот тест по сути показывает мощность шейдерных блоков. Поэтому очевидно, что 3D1 тут бескомпромиссный лидер. Причем прирост относительно обычного 6600GT — чуть-чуть не достигает 100%. Хотя не забываем, что у данной карты память работает на повышенных частотах.

FarCry, Research

Результаты тестов: FarCry Research

Прирост относительно 6600GT не превысил 63% — это объясняется процессорозависимостью игры, и даже максимальные нагрузки на карту не исчерпали ее ресурсов. Кстати, и от SLI почти нет отличий. Относительно соперничества с ATI — проигрыш как X800 XT (это более дорогая карта, поэтому ничего страшного), так и X800 XL (а здесь уже не очень хорошо для 3D1).

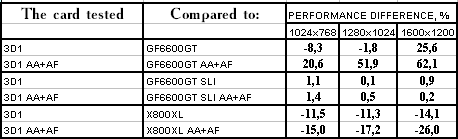

FarCry, Regulator

Результаты тестов: FarCry Regulator

FarCry, Pier

Результаты тестов: FarCry Pier

Комментарии излишни, все то же соотношение сил. В этой игре продуктам NVIDIA уже давно не везет :).

Half-Life2: ixbt01 demo

Результаты тестов: Half-Life2, ixbt01

Игра еще более процессорозависимая, и потому мы видим, что эффект от 3D1 (как и от SLI вообще) даже не достигает 50% прироста скорости. И снова проигрыш соперникам из стана ATI. Хотя надо сказать, что относительно GeForce 6800GT выступили не очень плохо.

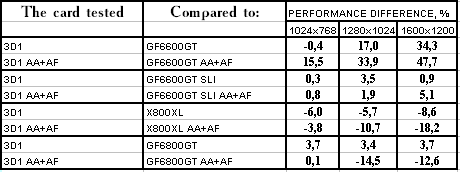

Half-Life2: ixbt02 demo

Результаты тестов: Half-Life2, ixbt02

Картина почти аналогичная, с той лишь разницей, что 3D1 потеряла чуть больше очков, значительнее проиграв ATI и своему старшему брату 6800GT.

Half-Life2: ixbt03 demo

Результаты тестов: Half-Life2, ixbt03

Интересный момент. Несмотря на то, что в данном тесте X800 XL явно выигрывает, но зато какой ощутимый прирост относительно 6600GT SLI! Именно в режимах с АА+АФ (память играет роль?). И еще: практически паритет с 6800GT, а последний точно дороже.

DOOM III

Эта игра снова использует технологические преимущества NV4x архитектуры, и мы видим — какой сильный прирост дает SLI. Повышенная частота работы памяти принесла 5% перевеса над 6600GT SLI, и очень неплохая картина в соперничестве с 6800GT (о том, что ATI X800-карты отстали, уже даже говорить не приходится).

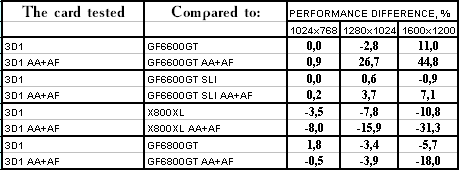

3DMark05: Game1

Результаты тестов: 3DMark05 Game1

3DMark05: Game2

Результаты тестов: 3DMark05 Game2

3DMark05: Game3

Результаты тестов: 3DMark05 Game3

3DMark05: MARKS

Результаты тестов: 3DMark05 MARKS

В принципе, результат предсказуем уже после тестов в TRAoD, поскольку 3DMark05 делает главный упор на производительность шейдеров. А здесь два процессора по 500 МГц, в сумме 16 конвейеров, сами понимаете — это сила. И потому разумеется, 3D1 — безусловный лидер.

В конце исследования я хотел бы сказать, что на драйверах 71.20 все ранее замеченные проблемы с качеством у SLI-карт, пропали. Что не может не радовать.

Выводы

Можно сказать, что успех КОМПЛЕКТА зависит от его цены! Если она будет адекватной, то мы имеем:

- прекрасную системную плату с полным набором всех современных технологических решений под платформу AMD Athlon 64/FX (Socket939). Минусы у нее тоже есть (пока обсуждаем чисто конструктивные особенности платы) — они описаны тут.

- очень сильное решение в виде 3D1, по мощности почти достигающее 6800GT, но дешевле последнего. Очевидно, что чем больше будет игр, ориентированных на повсеместное использование шейдеров, тем больше преимущества будет у 3D1.

Но есть и отрицательные моменты для 3D1. Во-первых, это практически проигрыш более дешевому сопернику в лице X800 XL в популярных играх, кроме DOOM III. Во-вторых, требования к питанию (напомню, что внешнее питание обязательно, когда как тому же X800 XL уже не требуется).

В третьих, большие размеры 3D1, а поскольку эта карта не может использоваться нигде кроме как совместно с K8NXP-SLI, то значит SATA гнезда, расположенные как раз под видеокартой, будут уже недоступны.

В четвертых, отключение второго PCI-E слота при работе с 3D1 не дает возможности использовать его для установки, например, второй видеокарты с целью вывода картинки на 4 монитора.

Основной вывод: востребованность такого решения в целом. Опять-таки, если цена будет нормальной, и ниже, чем та, при которой можно купить аналогичную материнку, плюс два 6600GT, то еще есть смысл. А ежели будет дешевле, чем комплект материнка+X800 XL, то успех гарантирован.

А теперь смотрим на календарь и видим, что начался 2005 год, а это означает, что пока рынок делится на AGP- и PCI-E — решения как 95 к 5%. И отсюда вопрос: станет ли такой комплект, или продажа K8NXP-SLI отдельно, тем локомотивом, который все же вытащит PCI-E из болота крайне низкого спроса?

Время покажет.

Более полные сравнительные характеристики видеокарт этого и других классов вы можете увидеть также в наших 3DGiТогах.

По результатам исследования Gigabyte 3D1 (2xGeForce 6600GT) получает награду в номинации «Оригинальный дизайн» (за январь)