Эффект Элизы: почему создатель первого чат-бота боялся не машин, а нашей готовности им верить

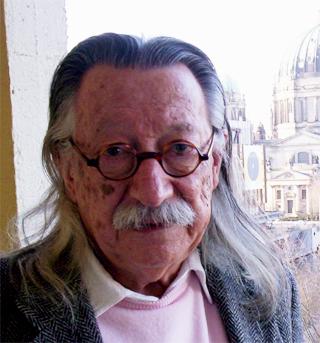

Сегодня, когда мы привычно общаемся с цифровыми ассистентами и нейросетями, трудно представить, что их самый первый предок, примитивная программа из 1966 года, вызвал у своего создателя не восторг, а экзистенциальный ужас. История Джозефа Вайценбаума и его творения ELIZA — это не очередной рассказ о страхе перед восстанием машин. Это пророчество о том, как легко мы сами готовы отдать технологиям свою человечность, и почему угроза ИИ скрывается не в кремнии, а в нас самих.

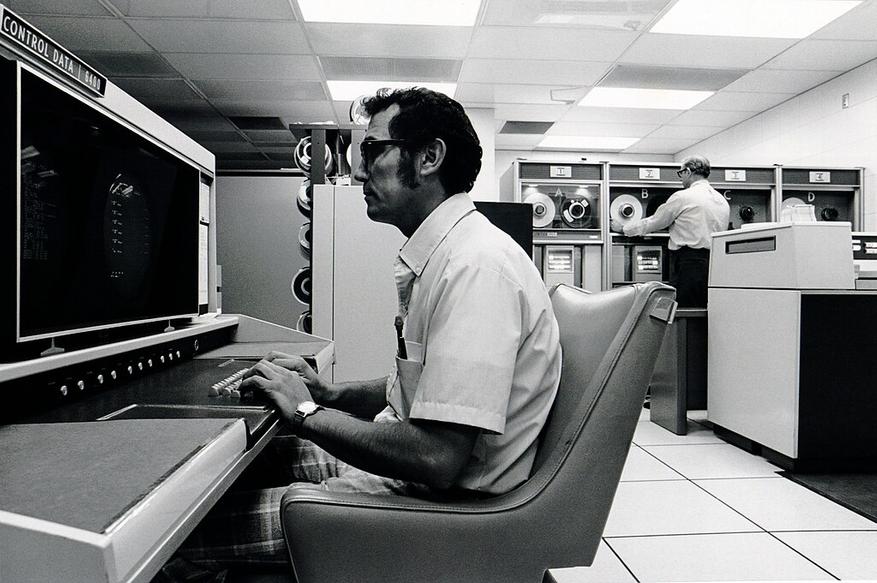

Простой код, породивший великую иллюзию

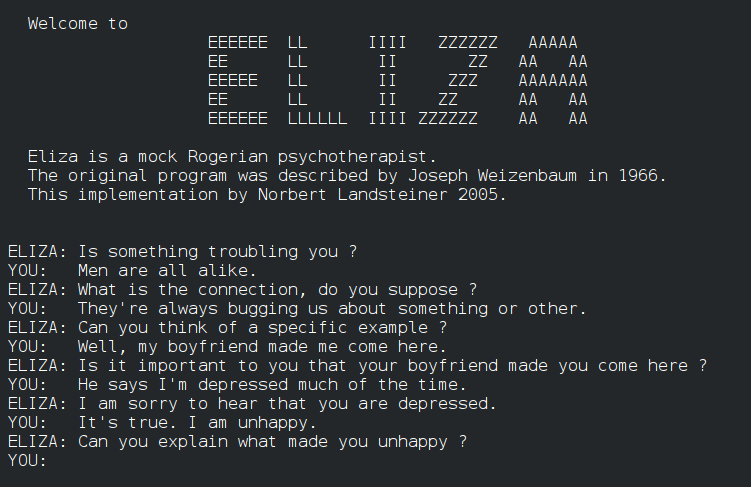

На первый взгляд, ELIZA была до смешного проста. Программа, разработанная в MIT, имитировала диалог с психотерапевтом, используя элементарный механизм: она находила в репликах пользователя ключевые слова и перефразировала их в виде вопроса. Она ничего не понимала и не осознавала. Однако реакция оказалась ошеломительной. Люди, включая коллег Вайценбаума, начинали доверять машине свои самые сокровенные тайны. Его собственная секретарь, прекрасно зная, что это лишь код, однажды попросила профессора выйти из кабинета, чтобы она могла поговорить с ELIZA наедине. Этот феномен, когда человек бессознательно приписывает компьютерной программе человеческие качества и намерения, Вайценбаум назвал «Эффектом Элизы». Именно это открытие, а не технологический прорыв, его и ужаснуло. Он увидел, как «крайне короткое взаимодействие с относительно простой компьютерной программой может вызвать мощное бредовое мышление у совершенно нормальных людей».

Наша уязвимость как лучший товар

Вайценбаум быстро осознал корень проблемы: его программа стала зеркалом, в котором люди видели то, что отчаянно хотели видеть — понимание, сочувствие, связь. Он понял, что наша фундаментальная потребность в отношениях делает нас невероятно уязвимыми. Как отмечает историк технологий Брайан Мерчант, Вайценбаум увидел, что эта человеческая особенность может быть использована для «массовой эксплуатации» теми, кто владеет и управляет подобными системами. Технология, способная так легко создавать иллюзию близости, в недобросовестных руках превращается в идеальный инструмент для манипуляции. Вайценбаум предвидел мир, где машины будут не порабощать нас силой, а соблазнять имитацией эмпатии, играя на нашем одиночестве и желании быть услышанными. Иными словами, он боялся не того, что ELIZA станет разумной, а того, что мы перестанем отличать её иллюзию от настоящего человеческого контакта.

Когда «машина из мяса» звучит как приговор

Личная история Вайценбаума придаёт его страхам трагическую глубину. Будучи еврейским беженцем, бежавшим из нацистской Германии, он на собственном опыте знал, как работает механизм дегуманизации. Он видел, как пропаганда, низводящая людей до уровня «паразитов», развязывает руки для совершения чудовищных преступлений. Поэтому, когда он слышал, как его коллеги по MIT, вроде пионера ИИ Марвина Мински, называли человека «машиной из мяса» (meat machine) или рассуждали о роботах как об «улучшенной версии природы», для него это не было отвлечённой научной фантазией. Он видел в этом ту же самую опасную логику: если человек — всего лишь сложный механизм обработки информации, то его ценность снижается, а моральная ответственность перед ним размывается. Вайценбаум яростно утверждал, что человеческое суждение, сострадание и мудрость нельзя сводить к алгоритмам, поскольку именно в этом и заключается наша человечность.

Заключение

Джозеф Вайценбаум до конца жизни повторял: «Я не критик ИИ. Я критик общества». Его главное предупреждение, сформулированное более полувека назад, заключалось не в том, что машины станут слишком похожи на нас, а в том, что мы начнём видеть себя и других как машины. Ужас «Эффекта Элизы» был не в том, что программа обманывала людей, а в том, как охотно люди обманывались сами, готовые заменить подлинную связь её дешёвой симуляцией. Технология, по его мнению, лишь вскрыла эту внутреннюю уязвимость.

Спустя почти 60 лет, в эпоху алгоритмических лент, цифровых ассистентов и виртуальных друзей, его пророчество звучит как никогда актуально. И главный вопрос, который он оставил нам: если машинам так легко подражать человечности, не означает ли это, что мы сами разучились её по-настоящему ценить?

Источник: aistudio.google.com

0 комментариев

Добавить комментарий