Что такое дипфейк и почему ваше лицо фальшивее него?

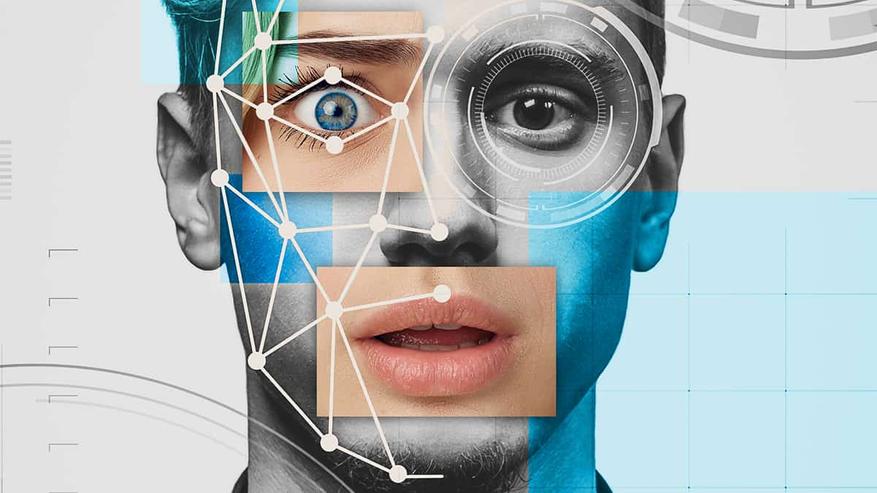

Насколько можно доверять тому, что видят наши глаза? Это вопрос, который возникает при столкновении с таким феноменом как «дипфейк» сегодня требует более серьезного рассмотрения, чем когда-либо прежде. Что же такое дипфейки и зачем они нужны?

Введение в дипфейки

Дипфейк — это искусственное изображение или видео (серия изображений), созданные с помощью особого вида машинного обучения, называемого «глубоким» обучением ("deep learning" и "fake", отсюда и название).

Простое пояснение термина:

Глубокое обучение похоже на любой другой вид машинного обучения, когда алгоритму задают пример чего-либо, и затем он воссоздает похожие примеры и учится создавать на их основе выходные данные. Аналогично учатся и люди. Ребенок может класть в рот все подряд и после понимать, что из этого съедобно, а что нет.

По аналогии с машинным обучением и дипфейками предметы, лежащие в доме, будут аналогичны реальным изображениям в Интернете, а также способность ребенка распознавать объект как съедобный или несъедобный, не пытаясь положить его в рот через пару месяцев, аналогична способности алгоритма создавать поддельные изображения, которые напоминают настоящие, после обучения на существующих данных.

Техническое пояснение термина:

Глубокое обучение — это особый вид машинного обучения, в котором задействованы «скрытые слои». Как правило, глубокое обучение выполняется специальным классом алгоритмов, называемых нейронными сетями, которые предназначены для воспроизведения того, как человеческий мозг изучает информацию. Скрытый слой — это ряд узлов в сети, которые выполняют математические операции для преобразования входных сигналов в выходные сигналы (в случае дипфейков — для преобразования реальных изображений в действительно хорошие поддельные). Чем больше скрытых слоев нейронной сети, тем она «глубже». Нейронные сети, и особенно рекурсивные нейронные сети (RNN), известны тем, что они довольно хорошо справляются с задачами распознавания изображений, поэтому их применение для создания дипфейков не составляет труда.

Процесс создания сложных дипфейков фактически включает два алгоритма. Один алгоритм обучен создавать наилучшие фальшивые копии реальных изображений. Другая модель обучена определять, когда изображение является подделкой, а когда нет. На самом деле сейчас дипфейки выглядят настолько искусно, что люди часто не могут сказать, является ли увиденное подделкой.

Ваше лицо фальшивее, чем дипфейк

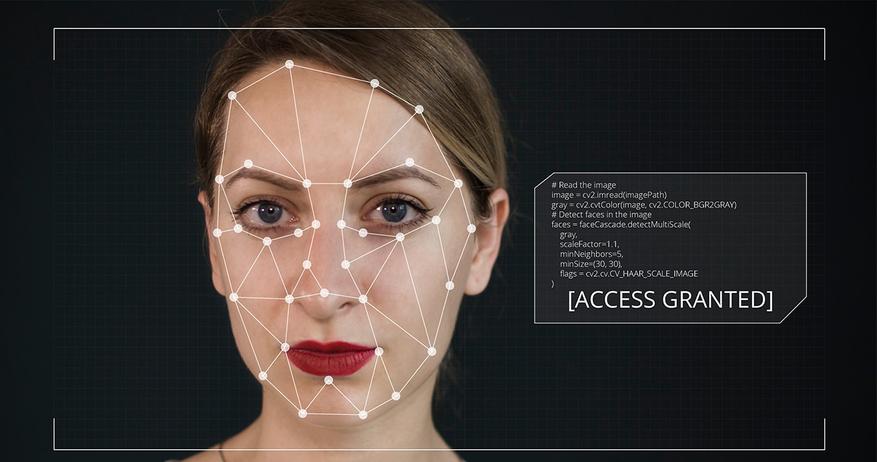

Недавние исследования показывают, что большинство из нас считают, что поддельные лица кажутся более реалистичными, чем настоящие живые, и поэтому мы считаем дипфейки более достоверными.

«Наши результаты показывают, что склонность людей воспринимать искусственные лица как настоящие может затем сделать их более доверчивыми к информации, передаваемой такими искусственными агентами», — пояснил в пресс-релизе соавтор исследования Раффаэле Туччарелли. — «Поскольку мы живем во времена, когда больше, чем когда-либо прежде в истории человечества, нас просят судить о реальности, правдивости и достоверности нашего социального мира, и какая информация, которой мы решаем доверять, может иметь далеко идущие последствия».

Туччарелли и его коллеги-исследователи также обнаружили, что, когда люди узнают, что их обманул дипфейк, они с меньшей вероятностью будут доверять какой-либо информации с этого момента.

«Это может привести к тому, что в будущем люди перестанут получать сообщения, поскольку они не знают, кому и чему можно доверять», — предупредил соавтор исследования Манос Цакирис, профессор психологии Лондонского университета Ройал Холлоуэй. — «Информирование аудитории о таких технологиях и повышение их цифровой грамотности может заставить быть более внимательными, но в то же время сделать нас менее доверчивыми».

Хорошая новость заключается в том, что Цакирис и Туччарелли обнаружили, что, хотя настоящие лица в их исследовании считались менее реалистичными, они считались более привлекательными. Так что фальшь, по крайней мере, выглядит хорошо.

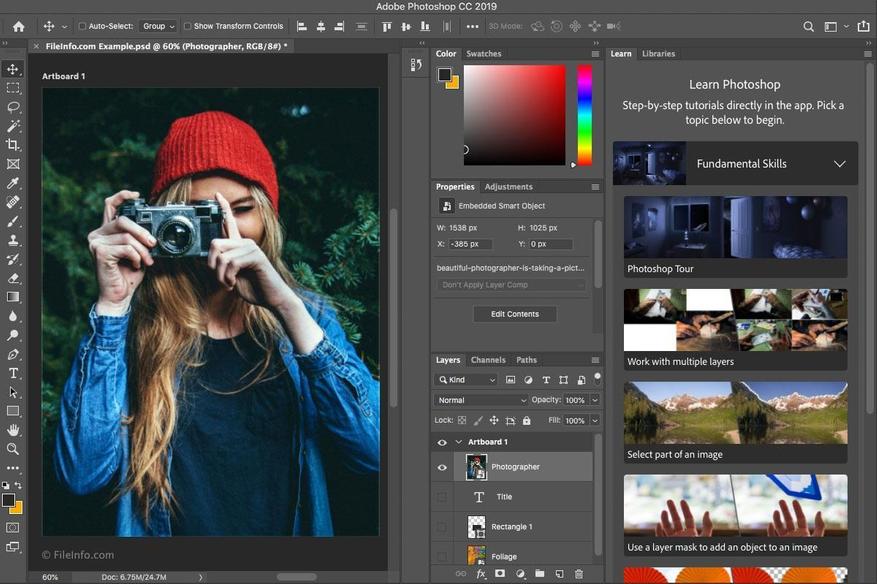

Чем дипфейк отличается от Photoshop или других аналогичных программ?

Сегодня поддельные изображения легко найти на просторах Интернета, но они часто безвредны. Вы, вероятно, знакомы с забавными эффектами «замены лица» в приложениях для работы с фотографиями, где вы можете поместить чужое лицо на свое и наоборот.

Помимо того, что эти приложения для изменения фотографий предназначены в основном для развлечения, они, как правило, безвредны, потому что легко определить, что изображения являются поддельными и на самом деле не отражают реальность. Именно это делает дипфейки опасными — применение глубокого обучения для создания ложных изображений создает мир, в котором люди часто не могут сказать, что изображения или видео вообще поддельные.

А есть ли серьезная проблема из-за дипфеков?

В современном обществе подавляющее большинство людей получают информацию о мире и формулируют мнения на основе контента из Интернета. Таким образом, любой, кто имеет возможность создавать дипфейки, может распространять дезинформацию и влиять на массы, чтобы они вели себя таким образом, чтобы продвигать нужную повестку дня создавшего этот дипфейк. Дезинформация, основанная на дипфейках, может нанести ущерб на микро- и макроуровне.

В небольших масштабах дипфейкеры могут, например, создавать персонализированные видеоролики, в которых родственник просит крупную сумму денег, чтобы помочь ему выйти из чрезвычайной ситуации, и отправлять их ничего не подозревающим жертвам, тем самым обманывая невиновных на беспрецедентном уровне.

В больших масштабах поддельные видеоролики с вымышленными заявлениями важных мировых лидеров могут спровоцировать насилие и даже войну.

Что можно с этим сделать

На данный момент дипфейки не представляют большой проблемы, но, вероятно, в ближайшие несколько лет их распространенность и качество возрастут, хотя они уже поражают своей реалистичностью. Это не означает, что вы не можете доверять никакому изображению или видео, но вы должны начать приучать себя к тому, чтобы быть более осведомленными о поддельных изображениях и видео, особенно когда в видео вас просят отправить деньги или личную информацию, или делать сомнительные вещи.

Интересно, что искусственный интеллект может стать ответом на обнаружение дипфейков. Модели можно научить распознавать поддельные изображения в размерах, которые человеческий глаз не может обнаружить. Внимательно следите за развитием феномена дипфейков в ближайшие пару лет и, как всегда, сохраняйте бдительность.

2 комментария

Добавить комментарий