Почему сайты в 2026 году грузятся медленнее, чем 15 лет назад: парадокс современного интернета

Домашние роутеры раздают гигабитный интернет, смартфоны работают в сетях 5G, а мощности процессоров хватает для рендеринга сложной 3D-графики. При этом обычная текстовая страница в браузере почему-то не открывается мгновенно. Иногда сайт висит белым экраном несколько секунд, рывками подгружает элементы и дергается при скроллинге. И это происходит на канале связи, скорость которого позволяет скачать фильм в высоком разрешении за несколько минут. Причина кроется вовсе не в провайдерах или плохом сигнале Wi-Fi. Современные сайты устроены совершенно иначе, чем раньше. То, что мы по привычке называем «веб-страницей», давно превратилось в монструозный программный комплекс, пожирающий ресурсы устройства.

Эпоха чистого HTML: как выглядели сайты раньше

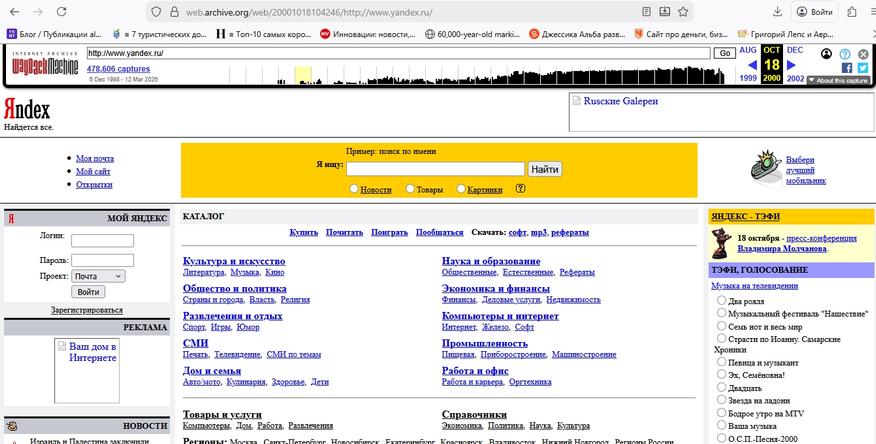

Чтобы понять масштаб проблемы, достаточно оглянуться на начало двухтысячных годов. Эпоха Web 1.0 была аскетичной. Интернет состоял из документов, связанных между собой гиперссылками.

Основой любого ресурса был голый HTML-код и немного простейших стилей. Дизайн строился на таблицах, а в качестве графики использовались крошечные GIF-изображения. Технология JavaScript если и применялась, то лишь для того, чтобы сделать выпадающее меню или добавить примитивную анимацию снежинок на главную страницу.

Такие сайты весили всего несколько десятков килобайт. Даже на медленном модемном соединении(привет Dial-UP в 56 кбит/с), сопровождавшемся характерным телефонным писком, текстовые страницы загружались относительно быстро. Браузеру нужно было просто получить текст и отрисовать его на экране. Никаких сложных вычислений не требовалось.

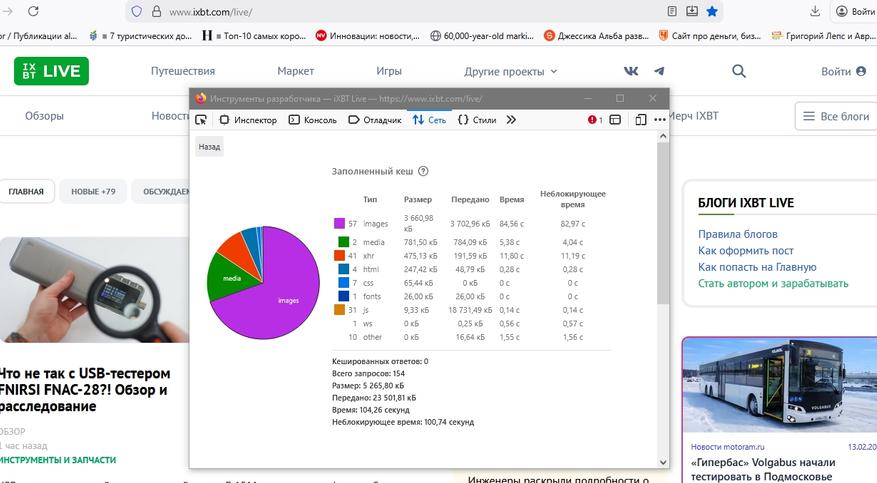

Сколько на самом деле весят современные страницы

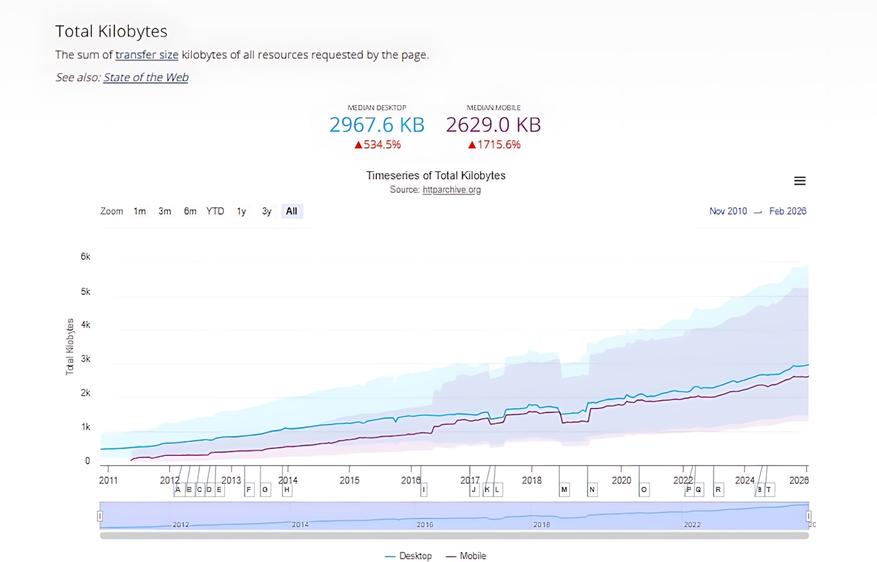

Цифры показывают пугающую динамику. По данным проекта HTTP Archive, который регулярно сканирует миллионы адресов, вес интернета непрерывно растет.

Пятнадцать лет назад средняя веб-страница весила около 400-500 килобайт. Сегодня этот показатель пробил отметку в 2,5 мегабайта для мобильных устройств и перевалил за 3 мегабайта для десктопных версий. А крупные новостные порталы или интернет-магазины могут выгружать в браузер пользователя по 10-15 мегабайт данных при каждом обновлении страницы. Не хило, да?

Для сравнения: культовая игра Doom, перевернувшая индустрию в 1993 году, весила чуть больше 2 мегабайт. Сегодня столько же может весить один рекламный лендинг с описанием кофеварки.

Мегабайты пикселей, которые съедают трафик

Первая и самая очевидная причина веб-ожирения — это визуальный контент. Картинки стабильно занимают больше половины веса любой современной страницы.

Появление Retina-экранов и мониторов с разрешением 4K заставило дизайнеров использовать графику высочайшего качества. Вместо аккуратных иконок сайты встречают пользователя огромными фоновыми видеороликами, полноэкранными баннерами и каруселями из фотографий в сверхвысоком разрешении. Зачастую эти медиафайлы не оптимизированы, а разработчики забывают использовать современные легковесные форматы вроде WebP или AVIF.

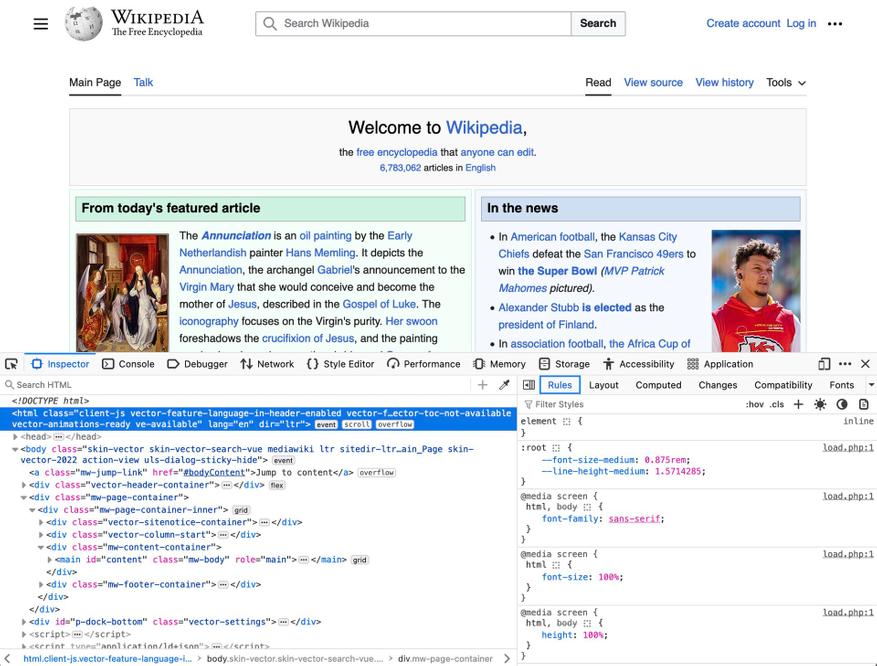

Сайты превратились в тяжелые приложения

Если графика забивает канал связи, то следующая технология бьет прямо по процессору устройства. Речь идет о JavaScript (JS).

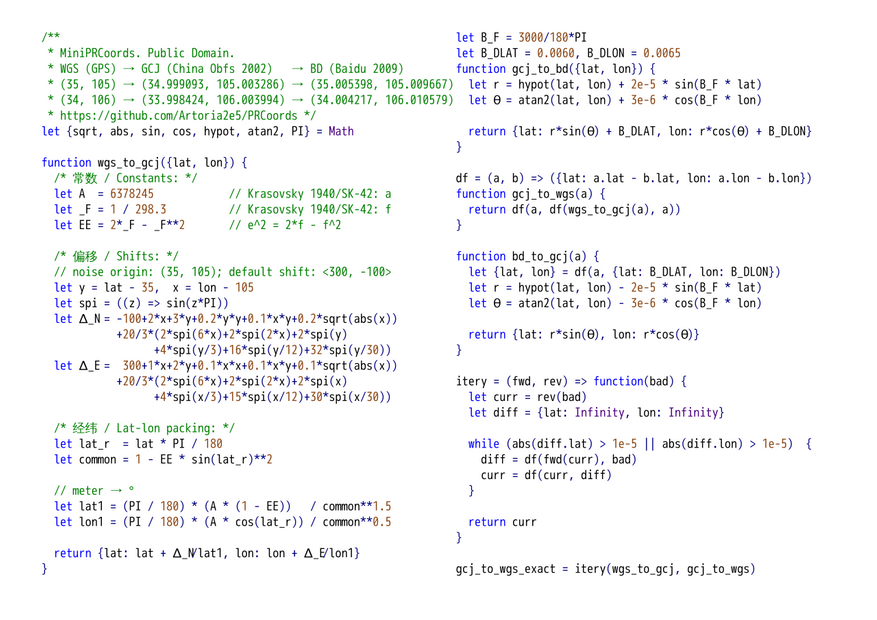

Современный веб отказался от статических страниц в пользу SPA (Single Page Applications — одностраничных приложений). Популярные фреймворки вроде React, Vue или Angular позволяют создавать красивые, плавные интерфейсы, которые не требуют перезагрузки страницы при каждом клике.

Но за эту красоту приходится платить. Браузер больше не просто читает текст. Он скачивает мегабайты нечитаемого сжатого кода, распаковывает его, компилирует и выполняет. По сути, каждый раз, когда вы открываете сайт, ваш телефон или компьютер скачивает и запускает полноценную компьютерную программу.

Но есть еще одна скрытая причина тормозов, о которой пользователи почти никогда не задумываются, ругая свой браузер.

Чужие скрипты и сервисы

Когда вы вводите в адресную строку URL-адрес одного сайта, ваш браузер на самом деле подключается к десяткам других серверов. Это называется сторонними скриптами (Third-party scripts).

Владельцу бизнеса нужно знать, кто к нему заходит. Он ставит системы аналитики (Яндекс.Метрику, Google Analytics). Маркетологам нужны онлайн-чаты для общения с клиентами. Дизайнеры подключают красивые шрифты со сторонних серверов. SMM-специалисты встраивают виджеты комментариев из соцсетей.

Каждый такой скрипт требует отдельного сетевого запроса. Браузер вынужден устанавливать защищенное соединение с десятками разных серверов по всему миру, прежде чем банально отобразить вам текст статьи.

Рекламные сети, убивающие производительность

Отдельная и самая тяжелая категория сторонних скриптов — это реклама. В современном интернете баннеры не лежат на сервере сайта. Они загружаются через сложные системы аукционов в реальном времени (RTB).

За те миллисекунды, пока вы открываете страницу, рекламные трекеры успевают проанализировать ваш профиль, провести микро-аукцион среди рекламодателей, выбрать победителя и подгрузить тяжелый видеобаннер откуда-нибудь с другого континента. Добавьте к этому скрипты, которые пытаются обойти блокировщики рекламы (AdBlock). В результате процессор захлебывается, а скроллинг страницы превращается в слайд-шоу.

Цена универсальности: мобильные версии

Еще десять лет назад разработчики делали два разных сайта: один для компьютеров, другой (обычно на поддомене «m.») — для кнопочных телефонов. Сегодня царит эпоха адаптивного дизайна.

Сайт должен одинаково красиво выглядеть на 27-дюймовом мониторе, на планшете и на узком экране смартфона. Чтобы это работало, программисты используют массивные CSS-фреймворки (Bootstrap, Tailwind). Проблема в том, что смартфон скачивает абсолютно все стили и правила разметки, даже те, которые предназначены исключительно для огромных мониторов. Гигабайты мусорного кода ежедневно передаются по сетям просто «на всякий случай».

Парадокс современного интернета

В IT-индустрии давно существует негласное правило, известное как закон Вирта: программы становятся медленнее быстрее, чем компьютеры становятся быстрее.

Широкополосный интернет и внедрение 5G оказали медвежью услугу веб-разработке. Имея доступ к гигантским скоростям, создатели сайтов просто перестали бороться за каждый килобайт. Зачем тратить часы на оптимизацию кода и сжатие картинок, если оптоволокно пользователя и так «прожует» страницу весом в 10 мегабайт? Высокая скорость сетей стала оправданием для ленивой разработки.

Неожиданный факт: сегодня метрика «время полной загрузки» почти потеряла смысл. Разработчики ориентируются на TTI (Time to Interactive) — время, через которое сайт начинает реагировать на нажатия. Иногда браузер выполняет сотни невидимых операций на фоне, пока кнопка «Читать далее» наконец-то станет кликабельной.

Можно ли остановить эту тенденцию?

Вернуть интернет в эпоху легковесного текстового HTML уже не выйдет, технологии шагнули слишком далеко. Однако добросовестные разработчики активно применяют методы жесткой оптимизации.

Внедряется «ленивая загрузка» (lazy loading), при которой картинки скачиваются только тогда, когда пользователь до них доскроллил. Тяжелые приложения переводят на серверный рендеринг (SSR), заставляя мощные сервера отдавать в браузер уже готовую картинку, а не заставлять смартфон просчитывать логику сайта. Но внедрение этих технологий требует времени и денег, которые бизнес далеко не всегда готов тратить.

Современные сайты стали медленнее не потому, что провайдеры предоставляют плохой интернет. Причина в том, что сами веб-страницы превратились в тяжеловесные операционные системы. Интернет перестал быть просто библиотекой документов — сегодня это гигантская платформа для запуска программ, показа рекламы и сбора данных. И за этот функционал приходится расплачиваться мощностью наших устройств и нашим временем ожидания.

А вы замечали, что некоторые привычные сайты сегодня грузятся и тормозят сильнее, чем много лет назад на слабом интернете? Какой ресурс, по вашему опыту, самый «тяжелый» и неоптимизированный?

Источник: www.veo3ai.io

1 комментарий

Добавить комментарий