Runway и Nvidia представили ИИ-модель, генерирующую видео в реальном времени

Компания Runway совместно с Nvidia продемонстрировала новую модель искусственного интеллекта, способную генерировать видео с задержкой менее 100 миллисекунд на один кадр. Презентация состоялась 18 марта 2026 года на ежегодной конференции Nvidia GTC в Сан-Хосе, Калифорния.

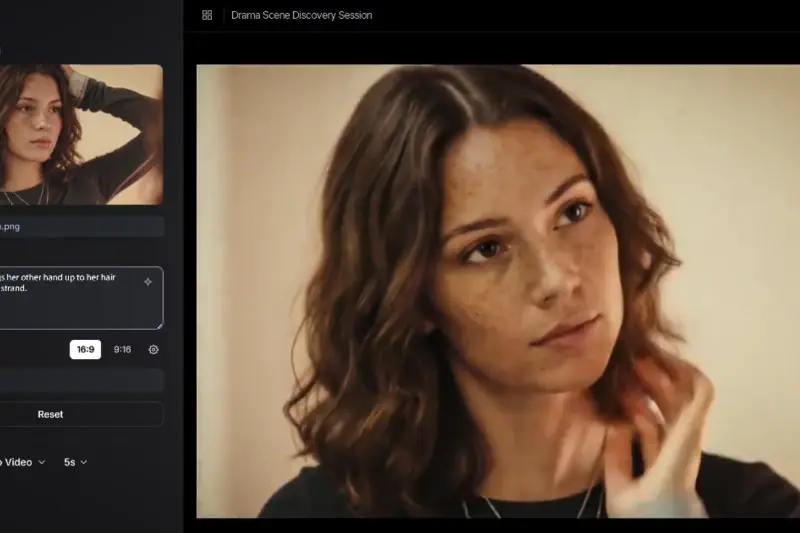

Модель, пока не получившая официального названия, стала первым инструментом генерации видео с помощью ИИ, который начинает потоковую передачу изображения в высоком разрешении практически мгновенно. На основе статичного изображения и текстового запроса система создаёт видеоряд, формируя каждый следующий кадр быстрее, чем длится моргание человеческого глаза.

Демонстрация проходила на суперкомпьютере Nvidia Vera Rubin — новейшей платформе компании, предназначенной для задач искусственного интеллекта. Система оснащена 36 процессорами Vero, 72 графическими процессорами Rubin, 54 терабайтами оперативной памяти и 20,7 терабайтами видеопамяти. На текущем этапе работа модели требует именно таких вычислительных мощностей, что ограничивает её применение уровнем крупных корпораций и исследовательских центров.

Runway ранее уже публиковала исследовательскую демоверсию проекта Real-time Worlds, направленного на создание интерактивных игровых миров, генерируемых нейросетью покадрово в ответ на действия пользователя. Новая модель развивает это направление, приближая технологию к практическому применению в интерактивных средах и виртуальной реальности.

Конференция GTC традиционно служит площадкой для анонсов ключевых продуктов Nvidia в сфере ИИ-инфраструктуры. Платформа Vera Rubin была представлена как следующее поколение в линейке вычислительных систем компании, начавшейся с DGX-1 десятью годами ранее.

Источник: New Atlas

0 комментариев

Добавить комментарий